随着人类对海洋资源的不断开发, 水下图像被广泛采集和应用. 然而, 水下环境具有特殊性, 成像受光的衰减和散射影响, 捕获图像具有细节模糊、清晰度低、颜色失真等问题, 严重影响了后续水下机器视觉任务的开展[1]. 因此水下图像增强技术对于海洋作业具有重要的意义[2].

传统的水下图像增强算法分为基于物理模型的方法[3,4]和非物理模型的方法. 虽然物理模型的方法在图像锐化, 颜色校正方面有良好的效果, 但先验知识无法描述所有的水下场景, 鲁棒性较差. 非物理模型的方法通过修改像素的灰度值来增强视觉效果, 其中, 基于直方图的增强算法处理后的图像易丢失细节[5,6]. 基于多级小波变换的增强方法, 能在频率域将图像分解为多个尺度, 并在不同尺度上对包含颜色的低频信息和包含细节的高频信息进行处理, 从而更好地重构图像[7]. 王晓琦等人[8]提出了颜色恒常性和多尺度小波水下图像增强(CMWE), 它先利用多尺度小波变换框架初步实施颜色及细节增强, 再利用伽马校正和锐化方法进一步校正不均匀光照, 锐化边缘细节. 非物理模型的方法具有简洁高效的优势, 但因忽略图像的先验信息, 增强结果难以恢复原始场景的特征.

近年来, 深度学习的方法在水下图像增强领域取得了巨大的成功, 可分为卷积神经网络的增强方法[9,10]和生成对抗网络的增强方法[11]. 卷积神经网络的增强聚焦于不同水类型产生的降质, 如Anwar等人[12]提出了水下增强网络(UWCNN), 通过对10种不同Jerlov水类型图像分别训练, 达到增强不同水类型图像的效果. Wang等人[13]将HSV和RGB颜色空间整合到一个神经网络中, 以去除不同水类型的干扰. 为进一步提高水下增强网络的泛化能力, Wang等人利用水下生成对抗网络UWGAN)生成真实图像, 再利用U-Net复原水下图像. Islam等人[14]进一步通过感知损失函数, 增强条件生成对抗网络(CGN)的性能, 学习降质水下图像和清晰水下图像间的非线性映射关系, 提升增强效果. 上述方法虽然考虑了不同水类型引入的降质问题, 但增强结果仍存在边缘模糊, 噪声干扰, 红通道颜色丢失等问题, 这是由于水下图像不但受多样水类型的影响, 还受到噪声、光的衰减和散射作用影响.

综上所述, 本文将感知图像多重降质因素的对比学习模型和基于非物理模型的多级小波变换增强策略相结合, 提出了降质感知的小波变换水下图像增强网络, 它包括基于对比学习的降质表征提取网络和基于多级小波变换的图像增强网络. 不同于已有的网络模型仅考虑单一降质因素, 降质表征网络通过对比学习, 能产生描述所有降质因素导致的降质表征. 而基于多级小波变换的图像增强网络, 以传统的小波增强算法为多级小波变换模块构建的指导思想, 旨在从频率域上, 多尺度增强细节和颜色. 将代表图像先验信息的降质表征引入到多级小波变换的水下图像增强网络中, 可使网络感知降质, 在频率域有效地实施增强. 大量结果表明, 本文算法能去除多重降质因素的干扰, 有效增强细节, 校正色偏.

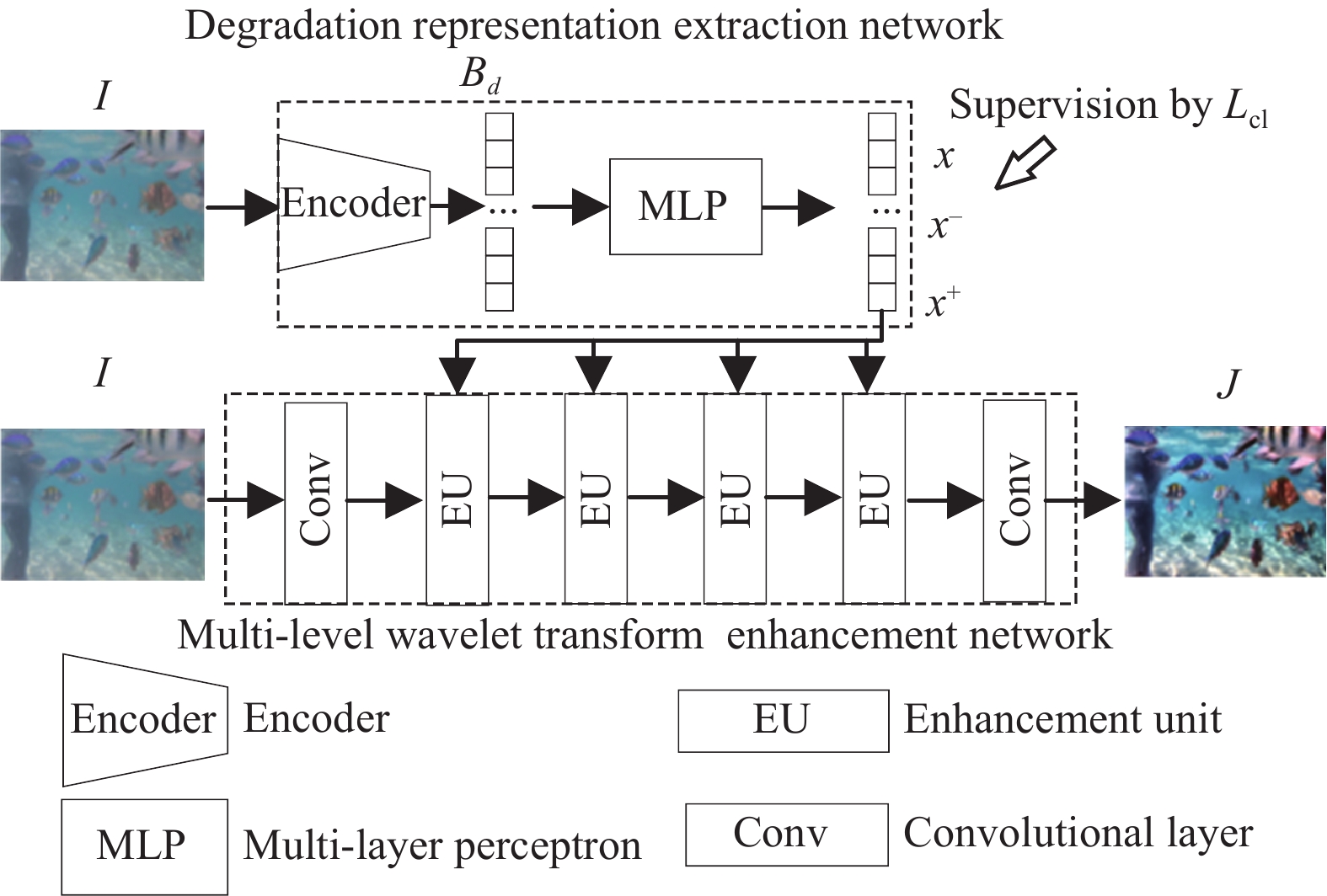

1 本文算法基于降质感知的多级小波变换水下图像增强网络包含对比学习的降质表征提取网络和多级小波变换的图像增强网络(见图1). 多级小波变换的水下图像增强网络采用多级小波变换模块来构建网络框架的基本增强单元, 有效地增强了水下图像的高低频特征. 然而, 仅利用多级小波变换模块来学习和处理图像的特征, 并不能感知图像的降质信息, 无法有效解决复杂因素导致的降质问题. 这里, 降质表征提取网络被用来提取水下图像的降质信息, 它利用编码器和对比学习提取图像的降质表征, 并将此表征作为图像的先验信息引入到多级小波变换的水下图像增强网络, 使其感知降质, 有效地校正颜色和锐化边缘.

|

图 1 网络总体框架图 |

1.1 对比学习的降质表征提取网络

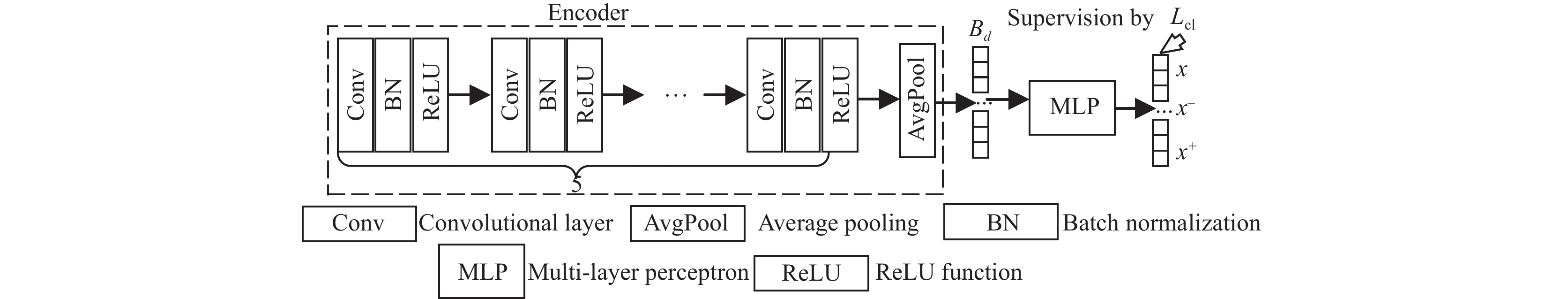

降质表征网络旨在以非监督学习的方式, 从水下降质图像中提取降质表征. 这里, 我们利用编码器和多层感知器对降质图像进行编码, 再利用对比学习生成降质表征. 如图2, 编码器包括5个卷积模块和1个自适应平均池化层, 其中每个卷积模块包括1个3×3的卷积层, 1个归一化层和1个ReLU函数.

|

图 2 降质表征提取网络的编码器结构图 |

当图像进入编码器编码后, 编码结果将进一步输入MoCo动量对比框架[15]提供的多层感知层(见图2), 以产生对比学习所需的数据样本. 实际上, 对比学习是将待查询数据特征与正负数据特征对比, 来学习样本特征表示的方法, 又称为表征提取法. 假设x是待查询的数据特征, {

| Lcl=−logex⋅x+/τ∑Ni=1ex⋅x−i/τ | (1) |

其中,

针对水下图像增强, 如何构建用于对比学习的查询数据和正负样本是值得探索的问题, 这里将图像降质过程描述:

| I=J⊗k+n | (2) |

其中, k为降质核;

| Lcl=∑Mj=1−logexj⋅x+j/τ∑Ni=1exj⋅x−i/τ | (3) |

通过最小化式(3), 训练降质表征提取网络100 epoch, 即可获得训练好的模型. 向预训练好的降质表征提取网络模型输入降质图像I, 即可获得准确的降质表征Bd.

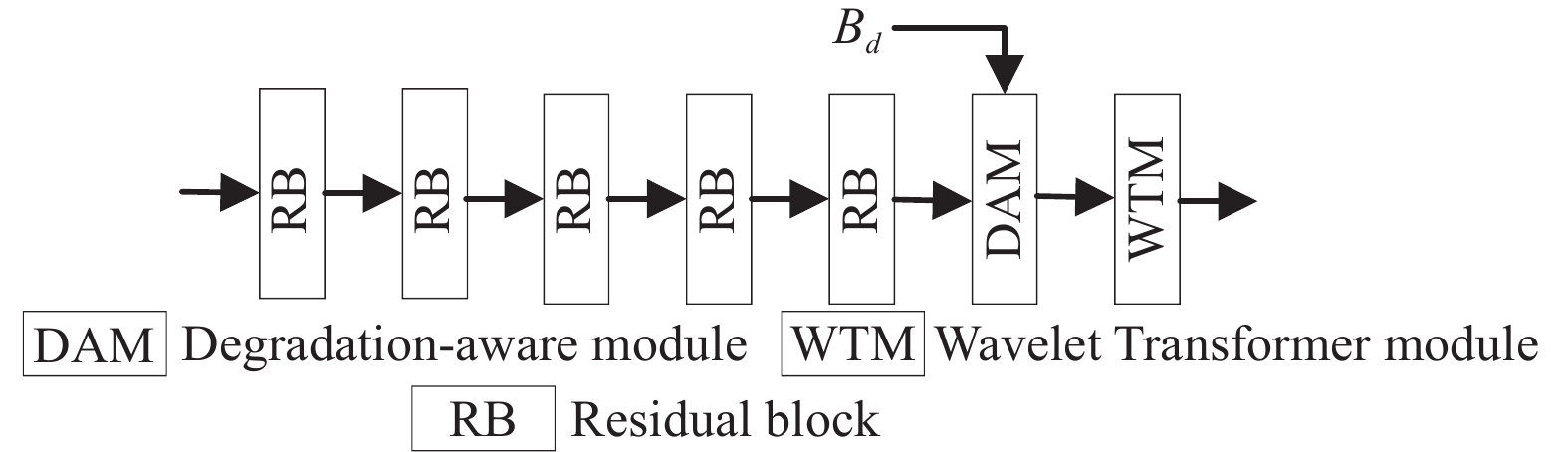

1.2 多级小波变换的水下图像增强网络在降质表征Bd的引导下, 多级小波变换的水下图像增强网络能感知降质, 对图像的颜色和细节实施有效地增强. 多级小波变换的水下图像增强网络结构如图1下半部分所示, 它包含2个卷积层和4个堆叠的增强单元, 每个增强单元的结构如图3所示, 均包含4个残差模块[16]、1个降质感知模块和1个三级的小波变换模块. 假设输入的水下图像为I, 在降质表征Bd的引导下, 增强图像J可由式(4)计算得到.

|

图 3 增强单元结构 |

| J=H2c(H4e(H3e(H2e(H1e(H1c(I),Bd),Bd),Bd),Bd)) | (4) |

其中,

| Fo=HHaar(Haware(H4RB((H3RB(H2RB(H1RB(Fc))),Bd)))) | (5) |

其中, Fc为图1中第1个卷积层输出特征;

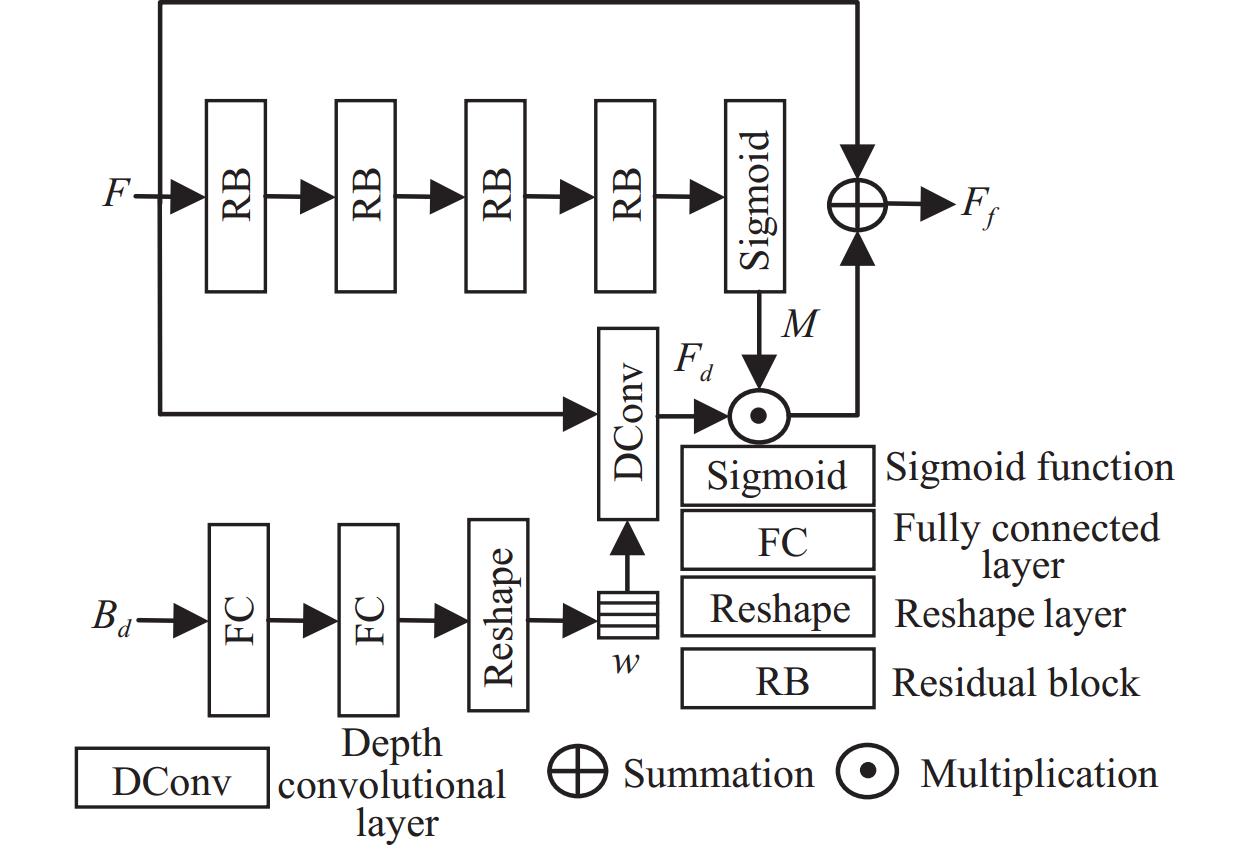

为了使多级小波变换的水下图像增强网络感知降质, 设计了降质感知模块. 该模块旨在从降质表征Bd中学习降质感知的特征, 并将此特征与多级小波变换增强网络学习的图像特征自适应融合, 作为后续三级小波变换模块的输入, 以便三级小波变换模块实施增强. 具体来说, 第1.1节中获取的降质表征Bd将被输入2个全连接层和1个Reshape层来估计权重

| Ff=F+Fd⋅M | (6) |

其中,

|

图 4 降质感知模块结构图 |

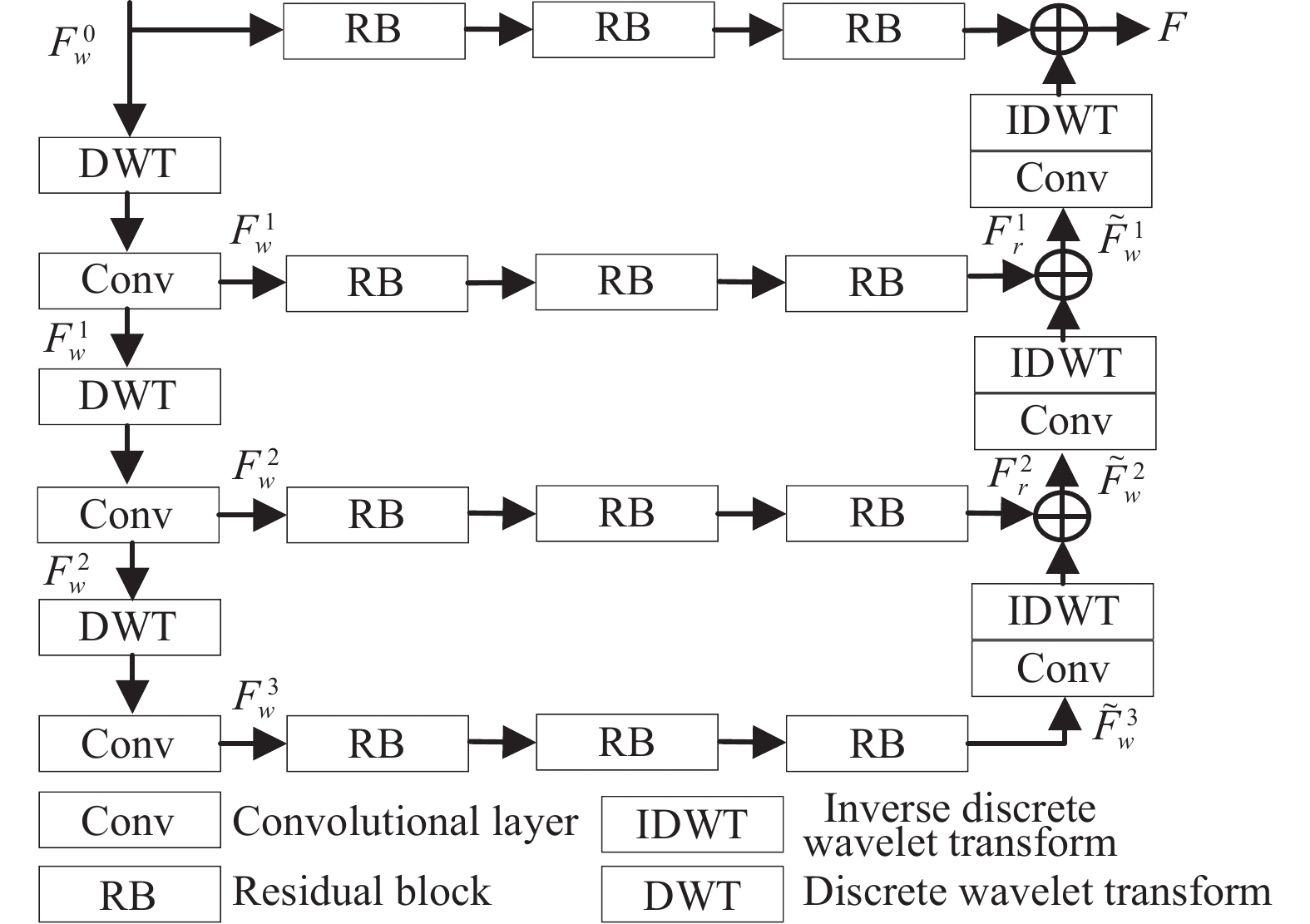

1.4 三级小波变换模块

多级Haar小波变换是基于短时傅里叶变换思想的多尺度增强方法, 它利用低通滤波器和高通滤波器将空间域的图像信号映射到频率域, 并分为多个层次, 进而在频率域逐步细化增强频率信号, 最后再通过反小波变换将处理后的频率域映射到空间域. 考虑到Haar小波变换具有多分辨率, 由粗到细逐步细化高频图像信号(包含细节信息)和低频图像信息(包含颜色信息)的优势, 并在传统的图像增强领域取得了令人满意的增强效果, 我们将其引入到水下图像增强网络中, 提出了基于Haar的三级小波变换模块, 它包含Haar小波变换操作, 信号增强操作和反Haar小波操作, 其结构图如图5所示.

|

图 5 三级小波变换模块 |

在三级Haar小波变换模块中, 首先使用Haar小波变换操作获得不同尺度的高低频特征, 以第n级小波变化操作为例:

| Fnw=Hc([HDWT(Fnw)]),n=1,2,3 | (7) |

其中,

随后, 利用3个残差模块对

| Fnr=H3RB(H2RB(H1RB(Fnw))),n=1,2,3 | (8) |

其中, HRB为残差模块函数,

特征细化后, 进一步采用反Haar小波操作将频率域的信号映射到空间域, 并加入上一级反小波操作的输出, 作为当前第n级反Haar小波操作最后输出的结果.

| ˜Fn−1w = HIDWT(Hc(˜Fnw))+Fn−1r,n=2,3 | (9) |

其中,

为训练多级小波变换的水下图像增强网络, 采用式(10)定义的损失函数:

| L = L2 + Lcl | (10) |

其中, Lcl的定义见式(3). L2定义如下:

| L2 = 1NN∑t=1‖Jt−ˉJt‖2 | (11) |

其中,

本文选用了文献[13]提供的合成图像训练集及两个真实图像测试集UIEB[17]和UCCS[18]分别进行训练和测试. 合成图像训练集包含10种不同水类型的图像, 如I, IA, IB, II和III公共水域类型图像, 1, 3, 5, 7, 9沿海水域类型图像. 在合成过程中, 文献[13]选用

在评估指标方面, 不但选用了有参考图评价指标峰值信噪比(PSNR)和结果相似性(SSIM), 还选取了无参考图评价指标(UIQM). PSNR将增强结果与真实结果相比对, 获得增强结果相对真实结果的失真程度. SSIM则从对比度、结构和亮度3个方面来评价增强结果与真实结果的相似度. PSNR和SSIM值越高, 增强结果越逼近真实结果. UIQM综合衡量图像的颜色, 清晰度及对比度, 其值越高则代表增强结果综合质量越好.

2.2 实验设置基于降质感知的小波变换水下图像增强网络在NVIDIA RTX 2080Ti GPU配置环境下, 利用PyTorch框架实现. 在训练阶段, 使用Adam优化器来训练模型, 学习率为

为验证降质表征提取网络和三级小波变换模块对水下增强网络模型性能的影响, 在参数一致的情况下, 分别从完整网络模型中删除降质表征提取网络和三级小波变换模块, 进行对比实验. 这里将完整网络模型中删除了降质表征提取网络的变异模型记为无降质感知模型(w/o DW), 该模型中增强单元里的降质感知模块(见图4)因删除了Bd输入的分支及信息融合操作, 故仅保留4个残差模块. 将完整网络模型中删除了三级小波变换模块的变异模型记为w/o DT, 该模型的增强单元(见图3)删除了最后的三级小波变换模块(WTM). 变异模型和完整模型(Ours)在合成图像测试集上的性能对比如表1, 从中可见w/o DW和w/o DT均有大幅度的性能下降, 表明降质表征提取网络和三级小波变换模块在感知降质, 及在频率域上增强颜色和细节有重要贡献.

| 表 1 消融实验结果 |

2.4 对比实验

本节将所提算法与近年来传统的水下图像增强算法, 如ULAP[4], UNTV[5]和CMWE[8]和基于深度学习的图像增强算法如UWCNN[12], UWGAN[13]和CGN[14]相对比. 其中, UWCNN[12]分别对10种不同水类型的图像进行训练, 获得了10个训练的模型. 这里选择训练图像为沿海水域类型1的模型作为对比实验中UWCNN的模型.

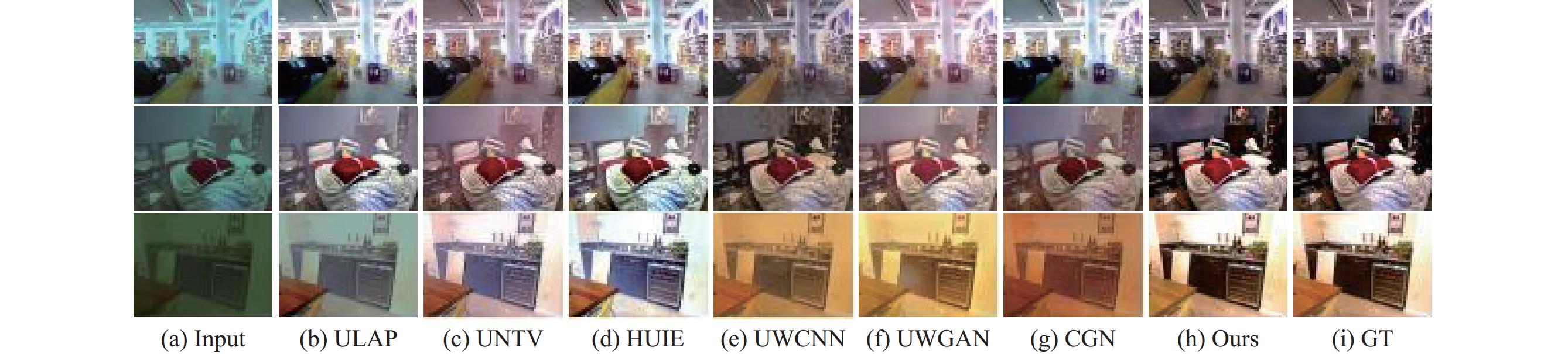

(1)合成数据集上测试结果

合成图像测试集共包含合成水下图像

|

图 6 合成图像测试集上的视觉结果对比 |

| 表 2 合成图像测试集的量化评估结果 |

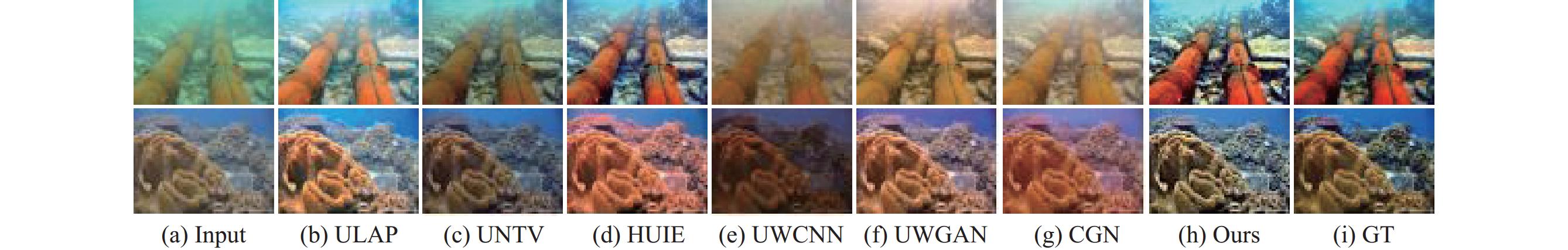

(2)真实数据集上测试结果

本节进一步在UIEB和UCCS真实数据集上进行测试, 以验证算法的鲁棒性. UIEB和UCCS数据集分别包含了不同水下场景的降质图像及不同类型的色偏图像. 首先, 从UIEB中选取了两张不同降质程度的水下图像(见图7(a)), 本文算法及水下增强算法的视觉结果如图7(b)–(h), 数据集提供的高质量增强参考图如图7(i)所示. 由图7可见, UNTV、HUIE、UWCNN、CGN方法增强的结果存在明显色偏, 如图7(c)–(g)第2行的图像颜色出现失真的暗蓝或暗红色. ULAP算法虽能校正颜色, 但细节恢复能力较差, 如7(b)第2行的珊瑚纹理较模糊. 相比而言, 本文算法不但能保留细节, 有效纠正色偏, 甚至比参考结果(图7(i))具有更高的细节恢复能力, 如图7(h)较图7(i)的细节和清晰度更高.

|

图 7 UIEB图像测试集上的视觉结果对比 |

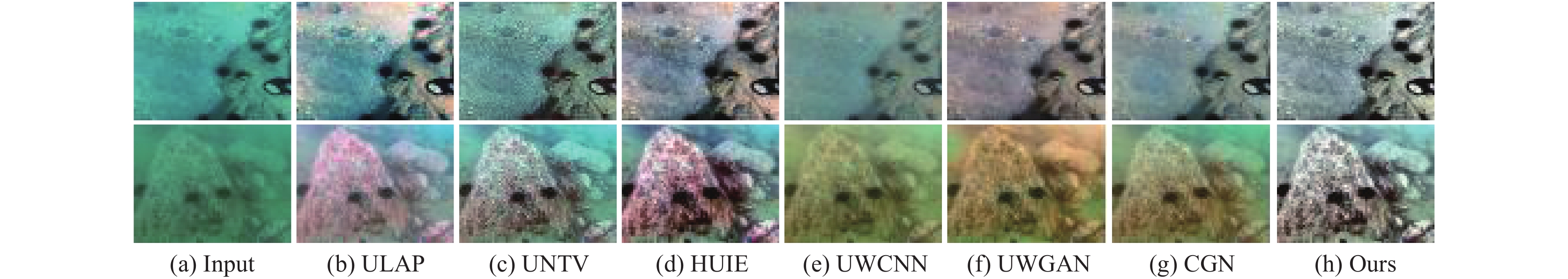

随后, 从UCCS数据集中选取了蓝色调及绿色调的真实水下图像(见图8(a)), 各算法的增强结果见图8(b)–(h). 由图8可见, UWGAN, UWGAN, CGN算法细节信息丢失, 且颜色校正效果不理想, 图8(e)–(g)第2行中的图像引入了明显的黄色偏. ULAP、UNTV、HUIE虽能增强细节, 有效去除蓝绿色背景, 但对局部区域过度增强, 导致丢失真实的颜色特征, 如图8(b)–(d)第2行中岩石的颜色呈现红色. 各算法在UIEB和UCCS数据集上的平均量化结果如表3和表4所示. 由于UCCS数据集没有提供参考增强结果, 故仅测量UIQM指标. 从表3、表4可见, 本文算法依旧获得最高的量化指标值, 尤其在UIEB数据集上, 本文算法的PSNR提升了16%, SSIM提升了9%, UIQM提升了14%.

|

图 8 UCCS图像测试集上的视觉结果对比 |

| 表 3 UIEB图像测试集的量化评估结果 |

| 表 4 UCCS图像测试集的量化评估结果 |

3 结论

针对已有的水下图像增强网络不能感知降质, 易丢失细节, 无法有效纠正色偏等问题, 提出了降质感知的小波变换水下图像增强网络, 它主要包含对比学习的降质表征提取网络和多级小波变换的水下图像增强网络. 考虑到水下图像降质受多重因素影响, 且每张水下图像的降质信息不同, 采用降质表征提取网络来提取水下图像的降质特征, 即利用对比学习策略提取编码器生成的降质表征. 另一方面, 多级小波变换增强方法能在不同尺度下, 从频率域增强细节和颜色特征, 因此进一步提出了多级小波增强模块, 并以此模块构建了多级小波变换的水下图像增强网络. 将提取的降质表征引入到多级小波变换的水下图像增强网络中, 引导该网络有效地实施图像增强. 在大量合成图像和真实图像上的测试结果表明, 本文算法对不同降质程度的水下图像均能有效地保留细节, 校正色偏, 提升清晰度, 较已有的增强算法在结构相似性, 峰值信噪比, 水下图像质量指标上均有明显提升.

| [1] |

陈清江, 王炫钧, 邵菲. 基于多尺度残差注意力网络的水下图像增强. 应用光学, 2024, 45(1): 89-98. |

| [2] |

谢俊, 邸江磊, 秦玉文. 深度学习在水下成像技术中的应用(特邀). 光子学报, 2022, 51(11): 1101001. |

| [3] |

Drews PLJ, Nascimento ER, Botelho SSC, et al. Underwater depth estimation and image restoration based on single images. IEEE Computer Graphics and Applications, 2016, 36(2): 24-35. DOI:10.1109/MCG.2016.26 |

| [4] |

Song W, Wang Y, Huang DM, et al. Enhancement of underwater images with statistical model of background light and optimization of transmission map. IEEE Transactions on Broadcasting, 2020, 66(1): 153-169. DOI:10.1109/TBC.2019.2960942 |

| [5] |

Xie J, Hou GJ, Wang GD, et al. A variational framework for underwater image dehazing and deblurring. IEEE Transactions on Circuits and Systems for Video Technology, 2022, 32(6): 3514-3526. DOI:10.1109/TCSVT.2021.3115791 |

| [6] |

胡振宇, 陈琦, 朱大奇. 基于颜色平衡和多尺度融合的水下图像增强. 光学精密工程, 2022, 30(17): 2133-2146. |

| [7] |

袁国铭, 杨光, 王金峰, 等. 由粗到细的多级小波变换水下图像增强. 光学精密工程, 2022, 30(22): 2939-2951. |

| [8] |

王晓琦, 赵宣植, 刘增力. 基于颜色恒常性和多尺度小波的水下光学图像增强. 激光与光电子学进展, 2022, 59(16): 1601002. |

| [9] |

Zhang YF, Jiang Q, Liu PD, et al. Underwater image enhancement using deep transfer learning based on a color restoration model. IEEE Journal of Oceanic Engineering, 2023, 48(2): 489-514. DOI:10.1109/JOE.2022.3227393 |

| [10] |

袁红春, 赵华龙, 高凯. 基于多阶段协同处理的水下图像增强. 激光与光电子学进展, 2024, 61(8): 0837003. |

| [11] |

胡雨航, 赵磊, 李恒, 等. 多特征选择与双向残差融合的无监督水下图像增强. 电子测量与仪器学报, 2023, 37(9): 190-202. |

| [12] |

Anwar S, Li CY, Porikli F. Deep underwater image enhancement. arXiv:1807.03528, 2018.

|

| [13] |

Wang N, Zhou YB, Han FL, et al. UWGAN: Underwater GAN for real-world underwater color restoration and dehazing. arXiv:1912.10269, 2019.

|

| [14] |

Islam MJ, Xia YY, Sattar J. Fast underwater image enhancement for improved visual perception. IEEE Robotics and Automation Letters, 2020, 5(2): 3227-3234. DOI:10.1109/LRA.2020.2974710 |

| [15] |

Chen XL, Fan HQ, Girshick R, et al. Improved baselines with momentum contrastive learning. arXiv:2003.04297, 2020.

|

| [16] |

He KM, Zhang XY, Ren SQ, et al. Deep residual learning for image recognition. Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas: IEEE, 2016. 770–778.

|

| [17] |

Li CY, Guo CL, Ren WQ, et al. An underwater image enhancement benchmark dataset and beyond. IEEE Transactions on Image Processing, 2020, 29: 4376-4389. DOI:10.1109/TIP.2019.2955241 |

| [18] |

Liu RS, Fan X, Zhu M, et al. Real-world underwater enhancement: Challenges, benchmarks, and solutions under natural light. IEEE Transactions on Circuits and Systems for Video Technology, 2020, 30(12): 4861-4875. DOI:10.1109/TCSVT.2019.2963772 |

2024, Vol. 33

2024, Vol. 33