2. 安徽大学 计算机科学与技术学院, 合肥230601

2. School of Computer Science and Technology, Anhui University, Hefei 230601, China

合成孔径雷达(synthetic aperture radar, SAR)是一种有源微波传感器, 利用脉冲压缩技术提高距离分辨率, 同时利用合成孔径技术提高方位分辨率, 从而实现二维高分辨率成像[1]. 它克服了光学和红外系统的局限性, 可以进行全天候、全天时的对地观测, 广泛应用于军事民用领域[2,3]. 是地球遥感任务的关键技术之一.

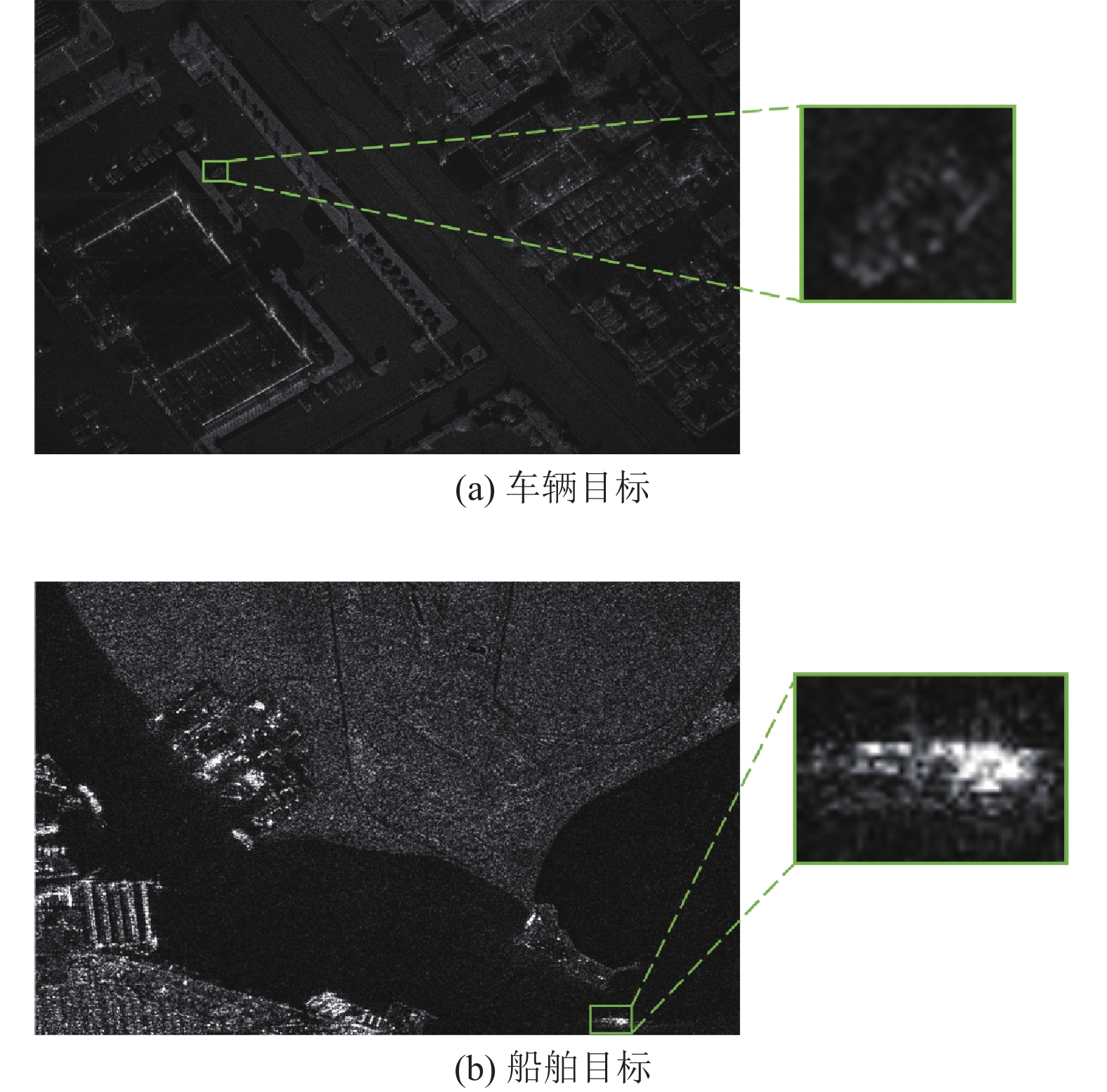

SAR系统的成像过程受到复杂背景与杂波干扰, 同时, 其大范围观测和高分辨率成像使得图像中往往存在大量特征微弱、尺寸较小的“弱小”目标(图1). 基于SAR图像的弱小目标检测任务由于其在民用与军事领域中不可或缺的作用而备受关注[4,5]. 对于具有高价值且时间敏感的航空目标, 精准的探测能为现代机场管理以及军事决策提供可靠的信息支持[6].

|

图 1 SAR图像弱小目标示例 |

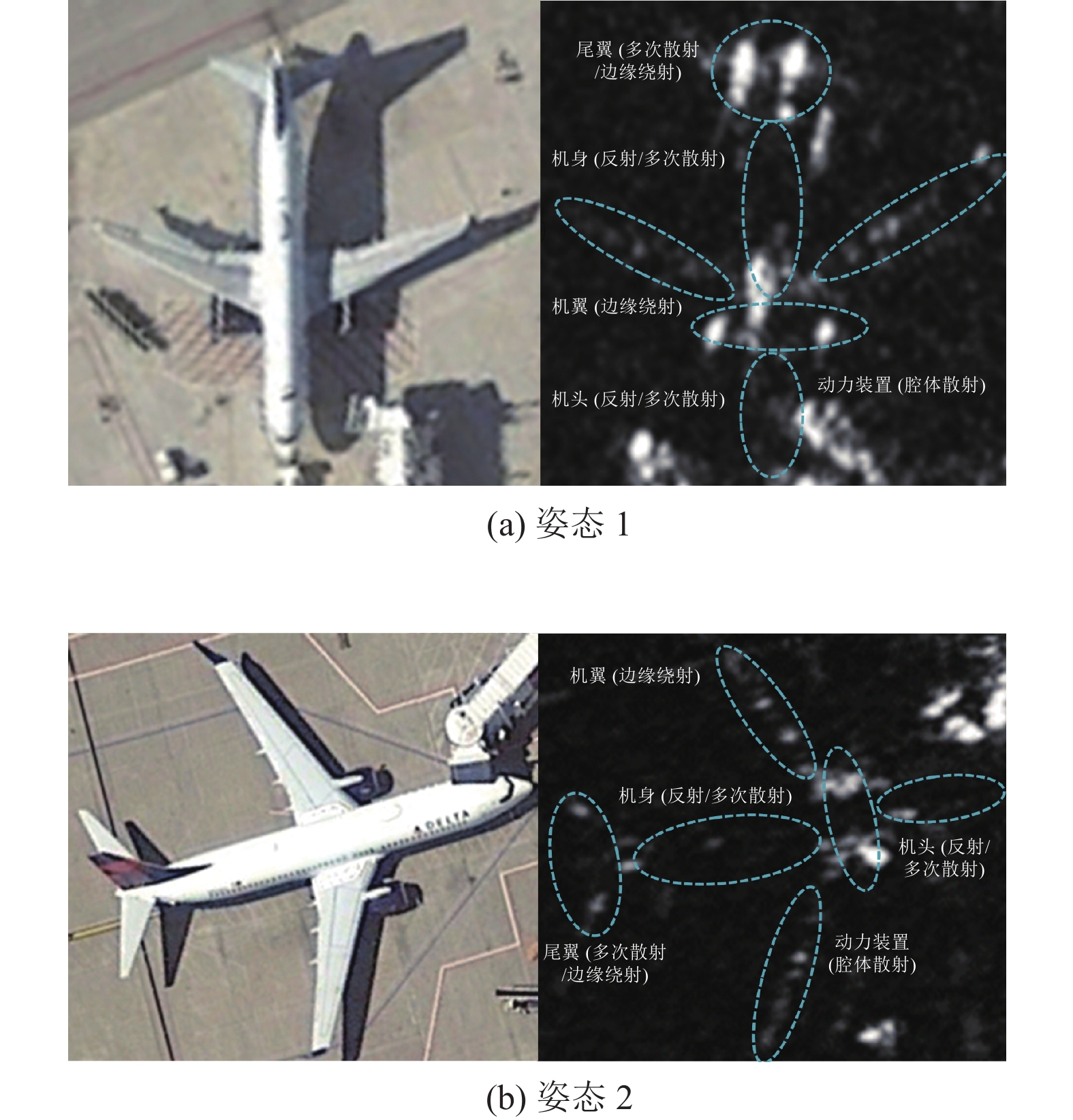

SAR系统通过接收地物目标的散射回波来生成图像, 图像中的明暗像素反映了该处回波强度的大小. 由于不同类型的散射回波强度差异较大, 地物目标的影像实际上是其散射特性的映射. 例如, 飞机目标的机翼主要是边缘绕射, 散射回波弱, 而机身主要是反射和多次散射, 散射回波强, 这种强弱差异在图2中表现为机身区域比机翼在视觉上更加显著.

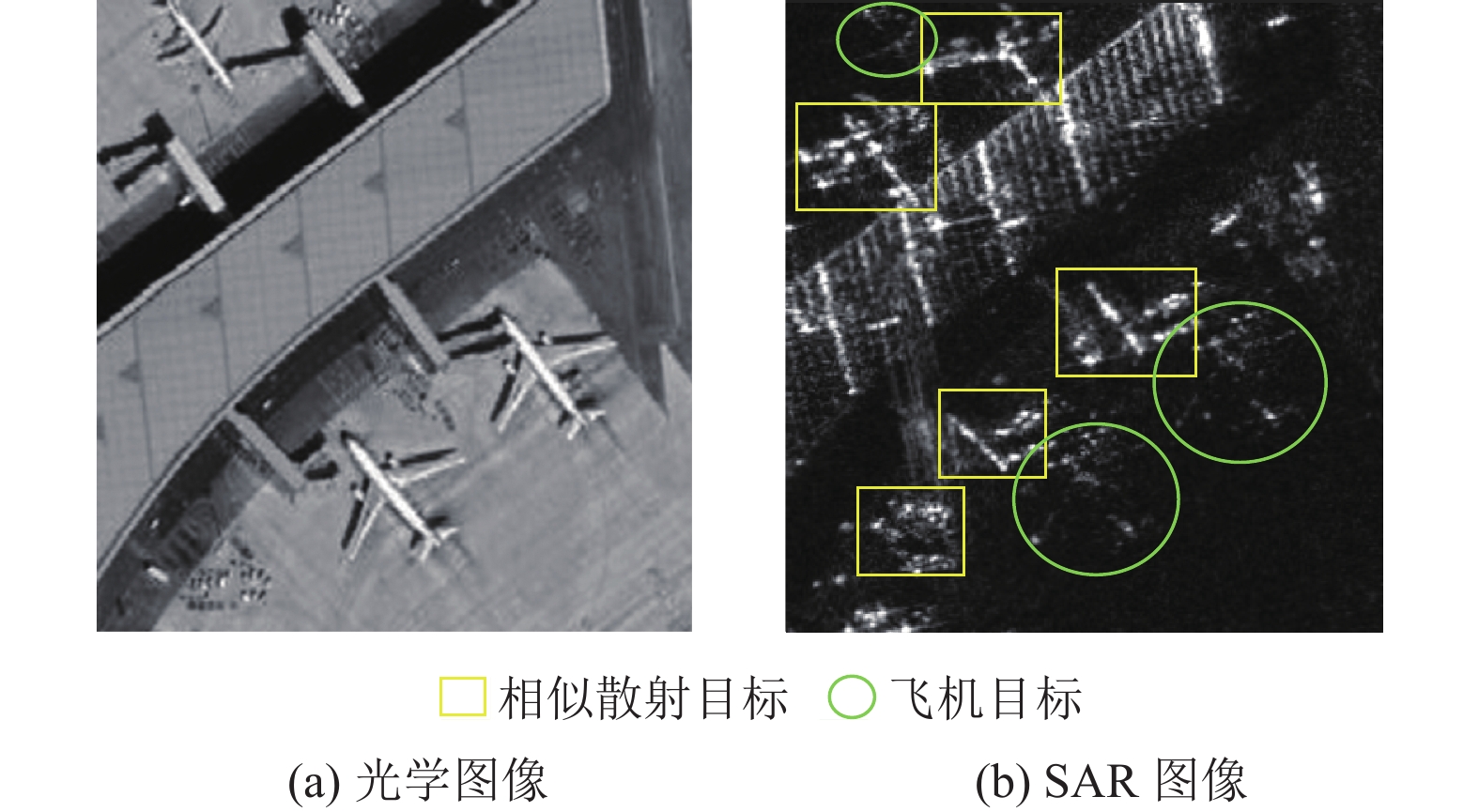

SAR图像弱小目标的回波信息易受到杂波等噪声的影响, 导致目标成像模糊不清, 尤其是对于车辆、船舶等观测目标[7]. 此外, 弱小目标周围常存在复杂背景的强干扰. Chen等[8]研究发现, 飞机场中的登机桥和舷梯与飞机具有相近的散射特性和纹理, 容易导致虚警. 并且, 由于内部尺寸差异大, 弱小目标难以在深层网络中保留和提取高级语义信息, 需要对网络结构进行精细化调整.

|

图 2 飞机主要部件成像以及方位角变化成像差异图示 |

图像检测是SAR自动目标识别(automatic object recognition, ATR)系统的首要步骤, 其执行效果对后续识别任务影响深远. 传统的SAR图像检测方法是对目标的几何特征、灰度统计特征和纹理特征进行建模, 主要依赖于人工设计的模板来区分目标与背景, 对特定场景的识别率较高. 基于杂波统计与阈值提取的恒虚警率算法(constant false alarm rate, CFAR)是经典的传统算法, 它通过对背景噪声建模, 分离背景与目标. 尽管CFAR降低了检测的损失率, 但对背景杂波的假设分布有依赖性, 抗强杂波干扰能力不强, 需要人为设定合适的检测窗口尺寸, 因此, 鲁棒性和泛化性较弱, 无法建立可靠的预测模型.

随着成像分辨率的提升和观测范围的扩大, 手动设计特征难以应对种类与数量上越来越多的弱小目标. SAR图像解译任务对智能化处理的需求更为紧迫.

深度学习通过处理大量复杂的图像数据来学习数据之间的内在联系, 获取图像目标的深度特征. 深度特征的表征能力在通用检测任务上效果卓著, 因此, 将通用目标检测中的主流模型引入到SAR图像弱小目标检测中成为当前的研究趋势. 然而, 这些检测模型在SAR图像检测中的效果普遍不如在光学图像中的表现. 主要原因是两种遥感图像存在显著差异: SAR图像的成像波长范围从3 cm到几米, 远高于光学图像, 因此其图像分辨率相对较低、信噪比较低, 图像中所包含的振幅信息远达不到光学图像的成像水平. 视觉上, SAR图像中的目标不连续, 是由多个离散的不规则散射中心亮斑构成(如图2所示), 其纹理信息与轮廓信息不显著, 成像结果难以直观理解, 方位变化导致成像差异大[9]. 同时, 由于尺寸差异和杂波干扰等因素, 弱小目标在经过卷积层时, 目标区域的特征容易被背景或其他具有相似散射特性的物体所干扰, 这不利于网络提取目标精确的高维语义特征.

此外, 模型设计与训练数据上的问题也亟待解决. 1) 在实际研究中, 主流检测模型的网络设计往往更注重提升整体精度, 这可能会牺牲一部分小目标的检测精度. 例如, 小目标并不需要深度的特征提取网络, 优化中大型目标表征提取能力的同时, 可能会导致小目标信息的一定程度损失. 这种性能优化平衡可能会损害部分小目标的检测效果. 2) 数据是深度学习技术的基础支撑. 然而, 与光学遥感目标检测数据集相比, 当前的SAR弱小目标检测数据集在样本规模和标注精度上存在明显的不足. 这主要是因为SAR图像难以直观解读, 人工标注容易出现误差, 准确的标注依赖于专家经验, 因此获取高质量数据集的成本昂贵.

针对SAR弱小目标检测所存在的问题和挑战, 本文以算法和数据集为研究对象, 全面回顾了本任务的研究工作. 首先, 从SAR系统成像机理出发, 阐述了弱小目标特性和检测任务面临的主要挑战; 然后, 对基于深度学习的SAR弱小目标检测方法和研究现状进行了梳理; 最后, 汇总了本领域内的公开数据集, 在代表性数据集上通过本领域检测任务的常用评估指标对典型算法进行分析, 总结了当前的研究现状并对未来进行了展望.

1 弱小目标特性与检测挑战随着SAR成像技术的发展, 探测范围的扩大使图像包含的场景增多, 分辨率的提升使各类场景下可以观测到越来越多的小尺寸目标. 在SAR图像解译任务朝更细粒度方法发展的趋势下, 对这类目标进行精确的检测是有必要的. 然而, 它们普遍尺寸小、特征弱, 同时目标稠密相连、自身成像多变, 需要检测方法针对其目标特性进行更精细化的改进. 本节将通过分析目标特性来定义弱小目标, 并阐述弱小目标检测当前所面临的主要挑战.

1.1 弱小目标定义在SAR图像中, “弱小”目标具有两个主要特征: “弱”和“小”.

“弱”指的是目标特征微弱. 由于SAR图像目标成像时不连续, 且易受复杂背景和杂波的干扰, 其可解释性较弱. 这意味着非专业人员很难分辨出目标的类别、方位朝向等重要特征信息.

“小”则指的是目标的尺寸小于一定的阈值. 对于“小目标”的定义, 学界尚无统一的定论, 通常从绝对尺度和相对尺度两个角度来定义. 绝对尺度: 从目标的绝对像素大小角度来定义小目标. COCO数据集[10]与SODA-A数据集[11]将面积小于等于32×32 (即1024)像素的实例视为小目标. 相对尺度: 从目标与图像的相对比例角度来定义小目标. Chen等[12]定义了一般小目标: 同一类别中所有目标实例的相对面积(即边界框面积与图像面积之比)的中位数在0.08%–0.58%之间, 根据不同任务要求, 这个比例也会有一定的浮动. 本文参考COCO与SODA-A数据集的定义, 将面积小于等于32×32 (即1024)像素的目标实例视为小目标. 第3节公开数据集的指标统计也基于此标准.

弱小目标种类较多, 每一类的特征主要由其自身的散射特性、物理结构、形状尺寸、方位角和极化方式等因素决定. 以飞机、船舶、建筑物这3类典型目标为例, 飞机的机翼末端、驾驶舱、尾翼和动力装置的后向散射较强, 这些部分在图像上的对应位置表现为明亮的光斑. 而飞机的其他部分表面光滑, 后向散射较弱, 对应位置的像元颜色较深, 图像上呈现为黑色区域. 因此, 飞机目标视觉上由多个离散光斑构成; 船舶船头(尾)部分的雷达等功能区域与边缘结构散射比甲板区域强, 在背景杂波干扰较小的情况下, 船体结构较为清晰; 油罐、桥梁、海上平台等建筑物的主体部分后向散射较弱, 只有边缘部分或者一些功能结构部分(如围栏、楼梯等)的散射较强, 因此这类目标视觉上表现为线状结构或者多边形区域结构. 此外, 有些目标的成像对于方位角的变化较为敏感, 不同方位角下的成像差异较大. 同时, 极化方式等雷达参数的变化也会引起目标图像特征的变化. 因此, 在实际任务中, 需要结合检测识别目标的散射特性和雷达参数等因素进行综合分析.

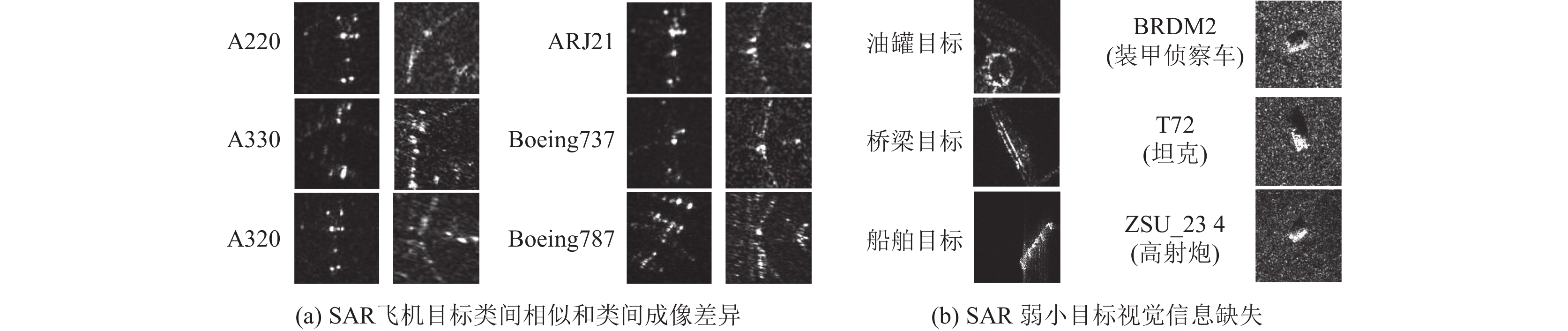

1.2 SAR弱小目标检测主要挑战SAR图像弱小目标检测面临着多方面的挑战. 首先, 随着成像技术进步, 分辨率升高致使像素点增多, 导致计算复杂性增加. 从训练效率和时效性上限制了深度学习方法在实际任务中的应用. 其次, 与光学图像小目标类似, SAR弱小目标检测任务存在目标密集排列、相似散射干扰、性能优化平衡等难题. 不同于光学目标较小的成像变化, SAR图像目标的成像易变性较高(图3(a)), 即同一目标在不同的成像条件下(如方位角、姿态、极化方式等)会产生显著的视觉差异, 这给目标的识别和定位带来了困扰. 再者, SAR图像本身易受散斑噪声和复杂背景干扰, 图像的信噪比和对比度较低, 目标与相似散射目标的混淆程度较大. 在SAR图像目标缺乏颜色、纹理等丰富的视觉信息(图3(b))的情况下, 常规的特征提取方法难以有效地描述弱小目标的形状、结构和边缘等特征. 以下是对SAR弱小目标检测面临挑战的详细分析.

|

图 3 SAR弱小目标成像差异与视觉信息缺失图示 |

1.2.1 图像分辨率高, 计算复杂度大

随着SAR系统成像技术的发展, 图像分辨率已经可达到亚米级, 而所包含的场景变得更加复杂. 在这些场景中存在着大量密集的弱小目标, 它们的特征微弱且相似度高. 此外, 由于高分辨率图像具有高动态范围, 可能会影响弱小目标的可见性, 导致网络的漏检或虚警现象.

高分辨率同时意味着更多的像素点和数据: 一景图像中包含的像素点可达千万, 目标数量过万. 这增加了计算和存储的需求, 使得检测任务的计算复杂性上升, 处理数据变得更加耗时. 弱小目标检测在应用场景中需要及时且准确的检测结果, 以便做出正确的决策. 因此, 对于高分辨率图像的检测, 需要针对性优化网络结构, 来解决计算复杂度高导致的检测效率低的问题, 提升弱小目标检测技术的实际应用效果.

1.2.2 成像易变性高, 目标姿态多变SAR成像的过程, 实质上是将地面的回波信号转化为图像强度的过程. 由于散射条件(例如电磁波的入射角度和方位角度等)的变化, 在不同条件下的目标姿态多变, 目标的散射特征也会随之发生相应的变化, 这导致了SAR图像目标的成像易变性较高. 以飞机舰船类目标为例, 其由2个或3个相互垂直的光滑表面构成的二面角和三面角结构的散射特性较为显著, 且只有当方位角达到90°时, 散射回波的强度才会达到最大. 从可视化的角度来看, 回波强度越大的位置, 显示的光斑也就越明亮. 如图3(a)所示, 由于不同朝向的飞机各组件与电磁波形成的方位角不同, 各组件的回波强度也会随之产生大幅度的变化, 从而使得形成的SAR图像具有显著的视觉差异.

1.2.3 噪声干扰强, 表征提取难SAR成像基于相干原理, 当雷达目标与发射平台之间存在相对运动(例如多数移动平台)时, 多个散射体与雷达之间会具有不同的路程长度和不同的径向速度. 这导致回波信号产生随机起伏, 在SAR图像中产生不可避免的散斑噪声. 这种噪声可能会导致光学图像中具有相同散射特性的区域在SAR图像中出现不规则的亮斑[8]. 同时, 在许多复杂的场景下, 容易出现与目标具有相似散射特性和纹理的物体, 这可能导致检测过程中产生虚警. 例如, 在机场场景中, 登机桥、舷梯以及其他建筑物都可能与飞机产生混淆(图4所示).

从视觉上看, 弱小目标由强暗像素构成, 其特征离散且不连通, 边缘信息不显著, 细节信息缺失. 这种情况下, 通常需要借助对比光学图像进行解读. 离散的特征可能会误导网络生成多个预测框, 从而导致误检或检测不完整的问题. 其次, 同一类型的目标尺寸差异可能很大, 飞机和舰船中的小尺寸目标在特征提取过程中容易被忽视. 在常规的检测框架的主干网络中, 为了提高计算速度和防止过拟合, 通常会采用下采样和池化操作. 然而, 这些方法在提取SAR弱小目标特征时, 可能会导致严重的信息损失. 这是因为目标本身尺寸较小, 经过多层卷积和池化后, 特征响应可能会几乎消失. 一个32×32的小目标在下采样倍数为32的主干网络中, 最终输出可能仅为1个像素点, 这种严重的信息丢失会导致弱小目标检测精度的下降.

|

图 4 相似散射目标干扰图示 |

此外, 深度学习算法的高性能依赖于大规模数据的支持, 但现有的SAR公开数据集在质量上难以与光学数据集相比. 在有限的数据下, 神经网络难以学习到令人满意的特征提取能力.

因此, 如何在少样本的情况下, 规避背景干扰, 对特征离散的弱小目标进行有效的特征提取, 是当前检测任务亟待解决的主要问题.

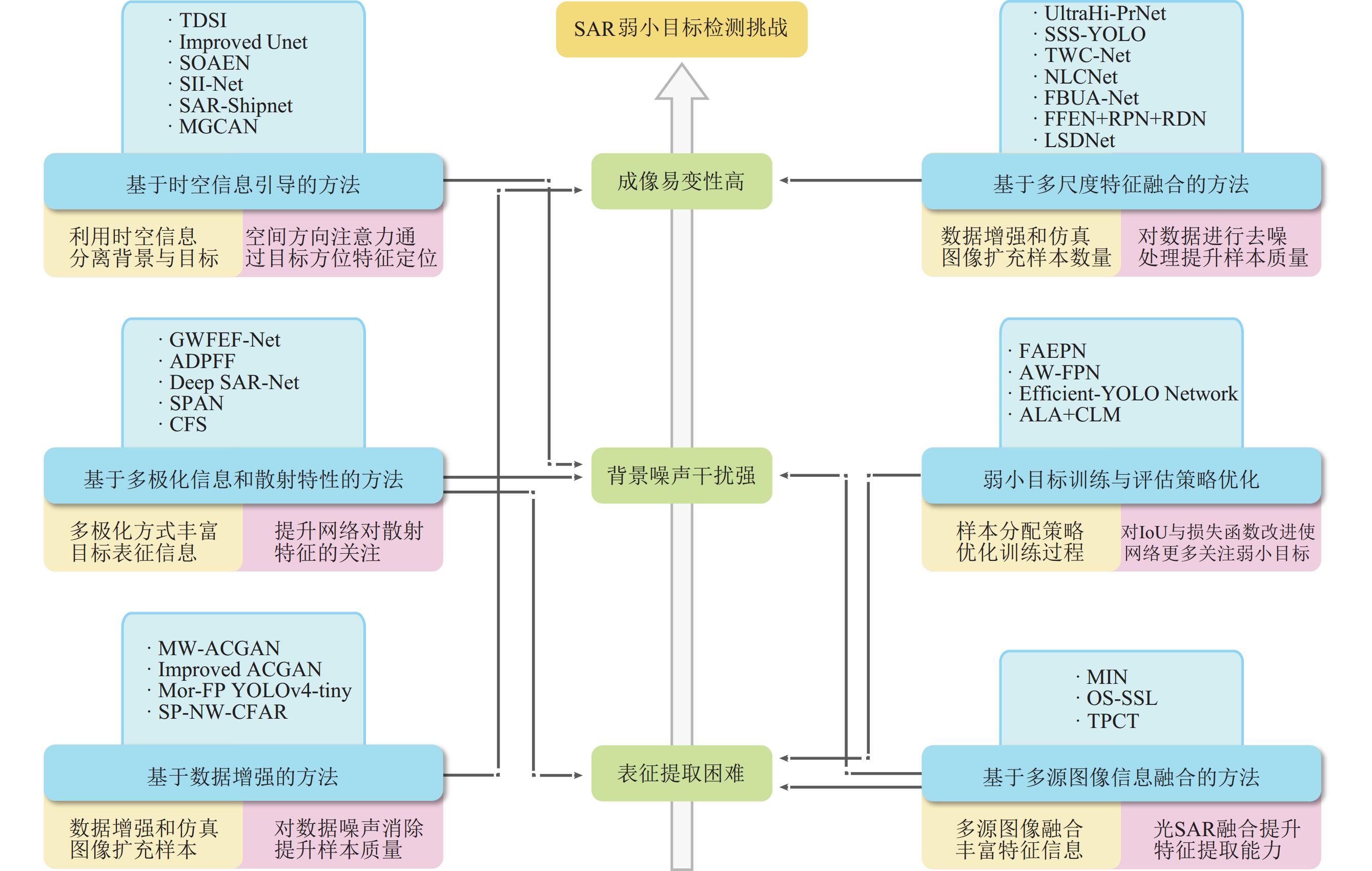

2 基于深度学习的SAR弱小目标检测算法SAR弱小目标检测的主流方法主要采用深度学习技术. 这是因为传统检测方法通过人工设计的特征来区分目标与背景, 只适用于特定的场景应用, 其泛化和鲁棒性较弱, 对于弱小目标的检测效果并不理想. 深度学习方法通过对大量SAR图像数据的分析和学习, 能够形成具有较高鉴别性的高维特征表示, 从而显著提升弱小目标的检测精度. 但传统方法的可解释性是基于深度学习的SAR弱小目标检测方法在未来研究中需要提升和完善的方面. SAR弱小目标检测方法总结见图5.

|

图 5 SAR弱小目标检测方法总结 |

传统的SAR图像目标检测技术主要基于特征和分类器的应用. 常见的特征包括结构、纹理、尺寸、灰度和散射特征等. 较为典型的方法有常虚警率检测器(CFAR)[13]、基于特征的检测方法、基于模型的检测方法以及基于机器学习的检测方法, 这些方法通过动态调整阈值、提取特征、定义目标模型, 实现了对SAR图像的有效检测. 这类传统方法对数据的需求较少, 计算量较低, 解释性较强, 但需要手动设计和选择特征, 模型相对简单, 只针对特定环境检测任务, 泛化性弱.

随着深度学习的发展, 其在SAR图像检测中的应用也日益受到关注, 虽然深度学习方法需要大量的标注数据和强大的计算资源, 且模型的解释性较弱, 但在SAR图像弱小目标检测任务中, 展现出了强大的性能和潜力. 近年来, 研究者们从SAR图像弱小目标特性出发, 对通用目标检测算法进行了针对性的调整和改良. 目前, 本任务的深度学习算法的常用策略大致可以从6个改进方向进行总结: 基于数据增强的方法、基于多尺度特征融合的方法、基于多极化信息和散射特性的方法、基于时空信息引导的方法、基于多源图像信息融合的方法以及基于弱小目标训练与评估策略优化的方法.

2.1 基于数据增强的方法相较于光学图像, SAR图像中的弱小目标样本数据相对有限, 且注释难度大, 这使得以数据驱动的深度学习方法在此任务上难以充分发挥其优势. 可以通过数据增强或仿真样本生成的方法扩充样本数量, 或通过对源图像进行噪声消除和超像素等操作来提升样本质量.

常规的数据增强方法有噪声添加、滤波和翻转[14]. 此外, 研究者们也利用深度学习方法来获取仿真数据, 生成对抗网络(GAN)通过生成器和判别器两个网络的互相博弈, 使得生成器能生成逼近真实数据分布的图像, 有助于避免模型过拟合并提升其泛化能力. Zou等[15]利用多尺度Wasserstein距离和梯度惩罚损失对原辅助分类器生成对抗网络进行改进, 使得改进后的网络能稳定生成高分辨率的SAR舰船图像. Li等[16]提出了一种改进的残差条件生成网络, 以提升生成图像的质量. Shi等[17]提出了改进的自注意力生成对抗网络(ISAGAN) 将SAR图像的方位和类别添加到网络中, 生成高质量的多类全方位SAR图像. Wang等[18]设计了一种方位角可控的生成对抗网络来生成精确的SAR目标图像, 利用相似判别器和方位预测器保证生成的SAR目标图像的准确性和方位角可控性, 一定程度上解决了小样本问题. 除了扩充样本, 图像质量增强也是一个可探索的方向. SAR的斑点噪声与光学噪声的形成机理不同, Zhao等[19]提出使用形态学网络去除斑点噪声, 并通过边缘提取来增强图像边缘的清晰度, 以此提供空间高频信息. Zhang等[20]则通过将超像素引入到CFAR检测中, 使用超像素来估计待测像素的杂波参数, 可以消除许多杂波虚警.

基于数据增强的方法通过扩充样本数量和提升样本质量来改善目标检测性能, 但在使用时需要关注一些潜在的问题和挑战. 生成对抗网络可以生成高质量SAR图像, 但存在模式崩溃、训练不稳定、评价困难等问题, 而且需要大量的训练数据. 图像质量增强可以改善SAR图像的视觉效果和检测性能, 但是也可能会损失一些细节或引入一些伪影, 从而影响目标的检测识别效果.

2.2 基于多尺度融合的方法基于多尺度特征融合的方法是将深层语义特征与浅层位置特征融合, 加强网络对弱小目标的关注. 常用的方法有深浅层特征融合、锚框匹配策略和感受野增强等.

在深浅层特征融合方面, Zhou等[21]提出了一种超高精度深度学习网络(UltraHi-PrNet), 用于同时检测SAR图像中存在的超大和超小尺寸目标. Wang等[22]根据SAR图像中的船只特征重新设计特征提取网络, 并提出路径增强融合网络(PAFN)来改善不同特征图的融合效果. Yu等[23]提出了基于双向卷积结构和多尺度特征映射模块, 分别提升了特征提取能力和深浅特征的融合能力.

在锚框匹配策略方面, Feng等[24]提出了LPEDet的无锚框算法, 提升了获取船只目标表征的能力. Bai等[25]通过特征平衡和联合注意力(FBUT-Net), 用基于关键点的策略来预测边界框, 消除锚框影响. Xu等[26]则通过优化锚框的生成, 降低了多尺度特征的优化难度.

在感受野增强方面, Dai等[27]融合自下而上和自上而下的特征图, 通过增强小目标特征的感受野来显著增强多尺度船只的位置和语义特征. Liu等[28]引入了一种改进的接收野块(RFB)结构, 增强了网络的特征提取能力. Bai等[29]在提取高级特征时引入空洞卷积, 增加了对弱小船只目标的空间特征感知.

多尺度特征融合能够提升网络对弱小目标的关注度, 然而, 此方法也存在一些局限性. 深浅层特征融合可能增加计算复杂性和内存消耗, 导致信息损失或噪声增加. 锚框匹配策略可能增加模型复杂性, 并在处理大量目标或复杂背景时降低检测精度. 感受野增强可能导致计算量增大, 过大的感受野可能引入背景噪声, 影响检测精度.

2.3 基于多极化信息和散射特性的方法弱小目标的图像特性显著, 尤其是目标的散射特性会随着成像条件(方位角、极化方式、波长等)的变化而改变. 这样的成像易变性导致了弱小目标类内语义特征差异大, 网络难以精确检测. 因此, 研究人员使用多极化图像丰富目标的特征信息, 或利用散射特性来引导网络学习目标更具鉴别性的特征表示.

在SAR系统成像过程中, 目标对雷达波束的反应各异, 不同极化方式形成的图像所包含的目标结构与纹理信息有所差异. 早期的SAR图像主要以单极化模式为主, 使用垂直极化(VV)或者水平极化(HH). 现在的数据集极化方式越来越丰富, 将多种极化图像进行融合有利于丰富目标的特征信息. 由于单极化SAR图像的特征不足以抑制杂波干扰和提取目标信息, Xu等[30]提出了一种双极化特征增强(DFE)模块用于丰富特征并抑制杂波干扰. Zhou等[31]提出自适应双极化特征融合, 来过滤由双极化分解获得的多通道特征, 减少特征冗余.

在散射特性方面, 郭倩等[9]对飞机的散射特性进行了充分的分析, 针对性地设计网络进行飞机型号的精细化检测. Huang等[32]提出的Deep SAR-Net充分考虑了复合值SAR图像的空间纹理信息和后向散射模式, 增强了网络对人造目标和自然场景的区分能力. Sun等[33]设计了一种强散射点感知网络(SPAN), 根据捕获的物体散射点的分布特征识别船只类别. Zhang等[34]提出了一个基于散射特征的散射点引导区域建议模块, 以此增加网络对关键散射点附近的注意力并减少对背景噪声的注意力.

基于多极化信息和散射特性的方法可以丰富目标的特征信息, 有助于网络对目标的特征提取, 但是这种方法也存在一些挑战和问题. 首先, 多极化图像特征可能增加计算复杂性并导致类内语义特征差异大, 使网络难以精确检测. 其次, 利用散射特性引导网络学习可能会增加计算量, 并且如果散射特性分析不准确, 在一定程度上会影响检测精度.

2.4 基于时空信息引导的方法复杂环境下的SAR弱小目标检测容易受到特征丢失以及与陆地散射体混淆的影响, 这导致检测近岸船舶和机场飞机等目标性能较差. 因此, 当前有研究者利用SAR图像包含的大量地理空间信息和时序信息来提取时空特征, 以此引导网络分离目标与背景.

在时间信息引导上, An等[35]提出了一种静止海上目标的检测算法, 对按照时间序列输入的SAR图像进行检测, 使用它们的经纬度位置来确定是否为静止目标. Kahar等[36]设计了一种基于SAR时间序列的船只检测方法, 使用时间特征将近岸船只与陆地散射体分开, 实现了动态船只监控.

在空间信息引导上, Ge等[37]提出了一种空间方向注意模块, 将其引入到路径聚合特征金字塔网络中, 可以捕获不同方向的特征变换, 突出对象特征并抑制背景效应. Su等[38]提出了一种空间信息集成网络, 它可以沿着两个空间方向提取位置信息, 以此增强骨干网络的检测能力. Niu等[39]将船只检测定义为多任务学习问题, 不仅包括边界框预测还包含船只方向回归, 实验证明估计船只方向可以弱监督船只检测, 进一步提升准确性. Deng等[40]讨论了神经网络是否可以从SAR图像中提取出有益的特征来改善船只检测, 并进一步提出了基于CenterNet的双向坐标注意力模块, 有效抑制了噪声干扰并增强小物体的特征提取. Chen等[8]则提出了一种地理空间注意力网络架构, 通过关注目标的地理位置信息来实现背景干扰的减少和目标的定位, 极大地提升了飞机检测性能.

基于时空信息引导的方法利用SAR图像中的时空特征, 引导网络分离目标与背景. 该方法面临的挑战和问题主要有两个方面. 其一, 时间信息引导可能会受到时间序列数据质量和完整性的影响, 从而影响检测结果的准确性. 其二, 空间信息引导可能会增加计算复杂性和内存消耗, 如果空间信息提取不准确, 可能会影响检测精度.

2.5 基于多源信息融合的方法多源信息是指从不同来源、不同方式获取的信息. 随着SAR技术的发展, SAR技术的多平台(如星载、弹载、无人机、地基等)搭载使得同一区域的不同源图像数据越来越容易获取, 这些图像数据在目标特征信息上具有互补性. 研究人员借助多基地SAR成像[41]以及SAR与光学图像融合[42]来增强弱小目标的特征信息.

Wang等[43]提出了一种基于目标建议和Copula理论(TPCT)的星载与机载SAR图像融合新方法. 该方法从星载和机载SAR图像中提取目标建议的特征进行融合, 增强其中的共同船只目标区域, 并利用基于Copula的联合概率密度函数来抑制这些目标相交处残留的杂波区域, 生成增强目标和抑制杂波的复合图像. 基于星载和机载SAR实测数据的实验结果表明, 所提出的TPCT融合方法比其他常用的图像融合方法具有更高的复合图像目标杂波比, 在船只检测任务中具有更好的性能.

光学图像由于其丰富的目标边缘、纹理和颜色信息, 与SAR图像的云层穿透观测能力相结合, 可以提供更全面的目标检测信息. 当前的大量研究证明, 光SAR融合的图像在变化检测、土地分类[44,45]等任务上获得成功, 为弱小目标检测任务提供了新的研究思路. Gao等[46]提出了一种融合光学和SAR图像的多路径交互网络(MIN)对飞机进行检测, 与单源融合模型相比, 多源融合模型改进了20%以上, 优于现有方法. Lou等[47]提出了一种由知识转移网络和船舶检测网络组成的生成式迁移学习框架, 知识转移网络生成的伪SAR图像空间分布与标注光学图像一致, 特征分布与SAR图像相似. 这些伪SAR图像进一步用于提高基于卷积神经网络的检测模型的泛化性能. Zhang等[48]利用光学特征来指导SAR特征学习, 提高了网络对SAR特征提取的能力.

多源信息融合技术依托于不同来源及不同方式获取的图像数据, 旨在通过融合算法提升目标检测性能. 然而, 此技术面临若干挑战, 包括数据的预处理、配准及融合过程对计算资源和时间的大量需求. 此外, 来源不同的信息间可能出现不一致性或冲突性这影响了融合结果的可信度. 同时, 缺少客观、量化及统一的评价标准与方法, 使得不同融合技术的有效比较与优化变得困难.

2.6 基于弱小目标训练与评估策略优化的方法基于弱小目标训练与评估策略优化是针对SAR弱小目标的样本特点, 从模型训练策略、度量方式以及函数优化方面进行改进.

在模型训练策略方面, Shi等[49]提出了一种基于特征增强的样本分配策略, 根据空间对齐和从归类结果中选择高质量的样本, 使网络对正负样本的选择更加正确, 从而实现了良好的检测性能.

对于通用目标的评估指标和损失函数, 需要针对弱小目标的特性进行优化. 评估指标中衡量物体定位精度的重要标准是交并比(intersection over union, IoU), 即目标预测边界框和真实边界框的交集和并集的比值. 对于弱小目标, 轻微的位置偏差会导致明显的IoU下降, 进而影响网络收敛. 此外, 在标注信息上, 旋转框标注相比水平框, 可以精确表示目标, 减少弱小目标密集排列情况下的标注重叠. Xu等[50]提出了一种TDIoU损失, 作为斜框回归中损失度量不一致和边界不连续问题的解决方案, 并设计了一种基于三角距离的损失函数来生成更精确的边界框并加速收敛. Yu等[51]提出了一种新的回归损失ECIoU, 以此增强检测框定位精度和模型收敛速度. Zhao等[52]提出了一种基于域适应的自动检测方法, 通过在基线网络上引入对抗学习注意力(ALA)和补偿损失模块(CLM), 实现了SAR图像像素级特征和实例级特征的域对齐, 并且通过损失函数来进一步限制对象特征在两个域中的原型对齐, 所提出的两个模块能够有效地提升检测精度.

基于弱小目标训练与评估策略优化的方法针对SAR弱小目标的样本特点, 从模型训练策略、度量方式以及函数优化方面进行改进. 其主要挑战在于缺乏通用性和鲁棒性, 需要针对不同的SAR弱小目标进行专门的设计和调整. 其次是依赖于高质量的旋转框标注信息, 但这种标注方式成本较高, 难以获取大量的数据. 同时, 该方法增加了计算复杂度和内存消耗, 可能影响模型的实时性和可移植性.

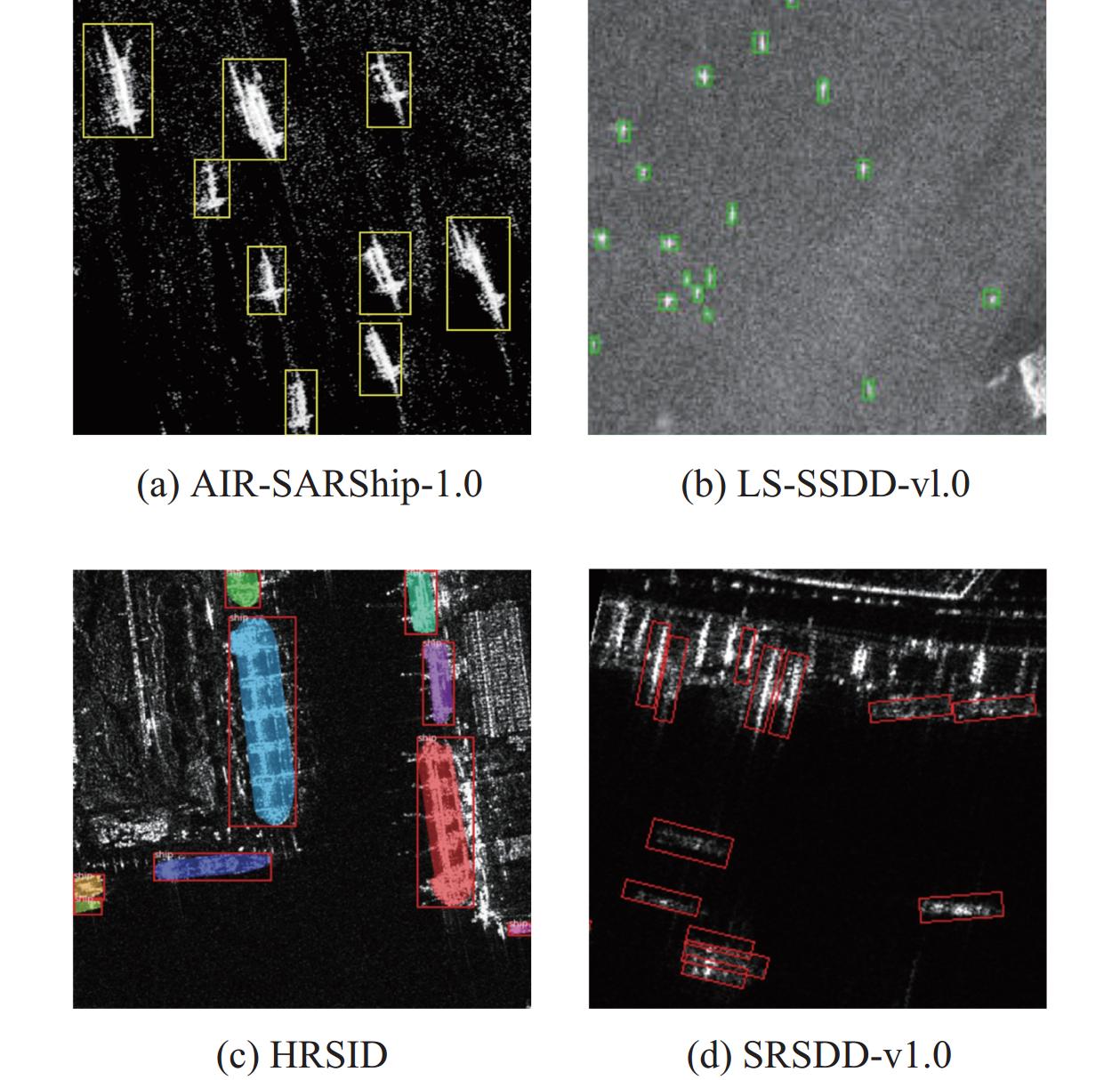

3 SAR公开数据集与评估指标SAR公开数据集主要以舰船和飞机为主, 这两类目标在民用和军事战略中具有重要的应用价值. 表1对当前已公开的SAR图像目标检测数据集的各项指标进行了详细的汇总和整理, 其中弱小目标的占比以32×32 (即1024)像素值为阈值进行统计. 第3.1节对代表性数据集进行详细阐述. 第3.2节在HRSID数据集上, 利用本领域通用的性能评估指标对典型方法进行对比和分析.

3.1 常用数据集下面是对本领域代表性数据集标注信息和数据集特点的详细描述.

1) SSDD数据集[53]于2017年发布, 主要标注的目标类别为舰船. 该数据集采用水平框进行标注, 而其后续版本SSDD+则添加了旋转框标注. 数据集的来源包括RadarSat-2、TerraSAR-X和Sentinel-1卫星. SSDD数据集包含1160张500×500像素的SAR图像, 标注了2456艘舰船目标, 其分辨率范围为1–15 m. 尽管每张图像的平均目标数量仅为2.12, 但该数据集的背景信息丰富, 能够全面覆盖不同海况下的多种尺寸舰船.

| 表 1 SAR弱小目标公开数据集 |

2) AIR-SARShip-1.0数据集[55]于2019年发布, 主要标注的目标类别为舰船, 采用水平框进行标注, 数据来源于高分3号卫星. AIR-SARShip-1.0数据集包含31张主要为3000×3000像素的SAR图像, 标注了512艘舰船目标, 分辨率为1 m和3 m. 尽管从绝对像素值来看, 小目标占比不高, 但从目标像素值占全图比例来看, 绝大多数目标为弱小目标. 这一数据集具有场景大、目标小的特性, 对于目标检测算法来说具有一定的挑战性. AIR-SARShip-2.0是在AIR-SARShip-1.0的基础上进行扩充的数据集, 包含300幅1000×1000像素的图像. 这些图像的场景类型包括港口、岛礁以及不同等级海况的海面, 目标覆盖了运输船、油船、渔船等十余类的数千艘舰船.

3) HRSID数据集[56]于2020年发布, 主要标注的目标类别为舰船, 采用水平框进行标注. 数据来源于Sentinel-1和TerraSAR-X卫星. 包含5604张800×800像素的SAR图像, 共16951艘舰船目标, 分辨率为0.5 m、1 m和3 m. 无论是从绝对尺寸还是像素占比来看, 该数据集的小目标占比都非常高. 此外, 该数据集利用光学图像减少了港口建筑的干扰, 整体的标注效果较好.

4) MSAR-1.0数据集[59]于2022年发布, 标注类别为飞机、油罐、桥梁和舰船, 采用水平框进行标注. 数据来源为高分3号卫星和海思1号卫星. 由主要为256×256 像素的28449张切片构成, 分辨率为1–10 m. 该数据集涵盖机场、港口、近岸、岛屿、远海、城区等多场景下的多种弱小目标, 是极具挑战性的大规模多类SAR目标检测数据集.

5) SADD数据集[61]于2022年发布, 主要标注的目标类别为飞机, 采用水平框进行标注. 该数据集的来源是TerraSAR-X卫星. SADD数据集包含7835张224×224像素的SAR图像切片, 标注了2966架飞机, 分辨率为0.5 m和3 m. 该数据集的小目标特征明显, 其中有3425个实例目标像素小于20, 因此属于极弱小目标数据集. 此外, 数据集中包含大量无目标的背景图像, 这对算法的抗复杂背景干扰能力提出了很高的要求.

6) SAR-AIRcraft-1.0数据集[62]发布于2023年6月, 标注类别为飞机, 标注为水平框, 数据来源于高分3号卫星, 主要选用上海虹桥机场、北京首都机场、台湾桃园机场3个民用机场的影像数据, 包含800×800, 1000×1000, 1200×1200和1500×1500共4种不同尺寸的4368张图片, 涉及7类细粒度飞机类型, 具有场景复杂、类别丰富、目标密集、噪声干扰、任务多样、多尺度性的特点. 图6的部分数据集可视化中显示了SAR图像中目标的特征模糊、背景复杂和散射干扰强等特性.

|

图 6 部分数据集可视化 |

3.2 评估指标与典型算法性能对比

评估算法的性能主要依赖于两个关键指标: 时效性和准确性. 复杂的网络通常具有较高的准确率, 但由于其对计算资源的需求高, 处理图像的速度较慢, 部署能力也相对较弱. 相反, 轻量级的网络虽然在准确率上可能有所欠缺, 但实时性较强, 应用场景更为广泛. 因此, 应根据实际应用场景, 适当地平衡准确率和时效性.

算法时效性主要是靠训练时间、FPS (每秒处理图像数)和单张图片处理时间来评估. 算法准确性的评估标准一般为准确率、召回率、F1值以及平均精度(AP). 准确率P (precision)和召回率R (recall)按下列公式计算:

| P=TPTP+FP | (1) |

| R=TPTP+FN | (2) |

其中, TP (真阳性)是正确检测到的目标数量, FP (假阳性)是错误检测到的目标数量, FN (假阴性)是未检测到的目标数量.

平均精度AP是在0.5和0.95之间的0.05区间内获得 IoU (交并比)准确度的平均值. F1值则表示准确率P和召回率R的调和平均值, 其计算公式为:

| F1=2×P×RP+R | (3) |

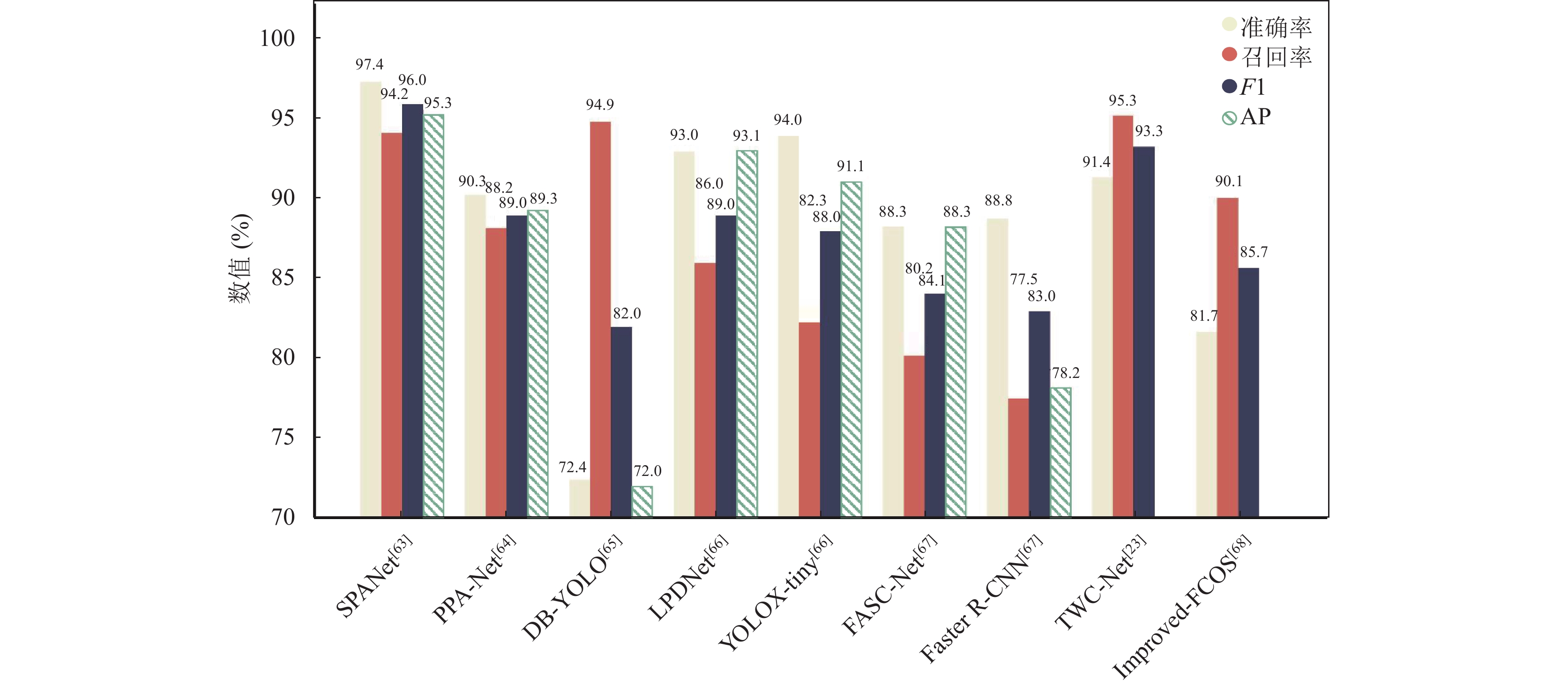

HRSID数据集具有较高的图像分辨率和大量的弱小目标, 且相关研究丰富, 因此它成为评估检测方法的理想选择. 本节采用上述评估指标在HRSID数据集上对典型算法进行比较, 探讨其性能优势, 为后续的相关研究提供参考依据. 由于图7中列出的部分方法的代码并未开源, 且各项实验在硬件设施和一些相关参数上存在差异, 因此, 所列出的实验结果仅供参考.

如图7所示, 近年来的算法在各项评估指标上取得了较为显著的提升[23,63–68]. Chang等[63]设计了一种自平衡位置注意力(SBPA)模块, 它平衡了多个感受野下的局部图像特征, 并聚合全局位置信息和空间上下文信息, 获得极大的定位精度改进, 在保证FPS (51.2, 仅次于YOLOX-tiny)的前提下, 在HRSID数据集上的平均精度达到了95.30%. Tang等[64]提出的PPA-Net, 利用其金字塔型集中注意力模块(PPAM), 减轻背景噪声对船舶检测的影响, 更好地抑制了SAR图像中的背景噪声, 在HRSID数据集和SSDD数据集上分别获得了95.19%和89.27%的检测精度. Zhao等[66]提出了一种基于多级拉普拉斯变换的智能去噪方法, 在基本框架(YOLOX-tiny)的特征融合模块中引入卷积块注意力模块(CBAM)对特征图的每个像素赋予不同的权重, 突出有效特征, 在参数仅有5.1M下, 该轻量级网络在SSDD数据集上以24.68 f/s的速度实现了97.14%的AP. Yu等[67]提出了一种用于复杂背景下多尺度SAR舰船检测的快速轻量级检测网络, 提高检测速度和降低检测参数的同时, 所提出的FASC-Net保持了相当好的检测性能.

在上述方法中, 注意力机制在目标定位、抵抗背景干扰以及特征提取等方面起到了关键的作用. 未来的研究可以进一步探索和挖掘注意力机制在这个领域中的潜力.

|

图 7 基于HRSID数据集的方法指性能比较 |

4 SAR弱小目标检测应用现状和未来展望 4.1 应用现状

合成孔径雷达(SAR)作为一种先进的遥感探测手段, 具有高分辨率成像、全天候工作、大范围观测的优势[69,70]. SAR弱小目标检测作为SAR图像遥感解译的核心环节, 在军事防御、战场态势分析、海洋监测、灾害应急响应、国土测绘、气象观测、交通管理等多个军民领域[71,72]具有广泛而关键的应用.

在军事应用中, SAR弱小目标检测已占据重要地位. 在陆战场中, 该技术主要用于战场态势分析、目标侦查和战术布局. 在海战场中, SAR弱小目标检测主要用于海上弱小军事目标(小型船只、潜艇等目标)的精确检测和识别[73–75]. 由于SAR系统的多种优势, 在复杂环境和恶劣气象条件下, SAR弱小目标检测技术依然能够提供高度可靠的情报.

在民用领域, SAR弱小目标检测也具有广泛的应用. 在灾害应急处理中, 该技术能迅速而准确地定位受影响区域内的各类目标[76], 从而有助于灾害救援和物资分配. 在精准农业中, 该技术能够为农户提供关于土壤湿度监测、作物生长状况、病虫害防治等方面的精确信息. 在环保监测中, 该技术已应用于污染源追踪、矿产勘探、生态系统破坏识别等多个关键环节.

随着算法研究和硬件技术的不断进步, SAR弱小目标检测技术已经展现出不可或缺的价值. 在新一代人工智能技术的加持下, SAR弱小目标检测技术有望实现更高的准确性、实时性和更丰富的应用场景, 为国防军事和社会发展提供有力支撑和技术保障.

4.2 未来展望随着目标检测领域的飞速发展, SAR弱小目标检测领域涌现出很多优秀的研究成果. 然而, 相较于通用遥感目标检测算法的性能, SAR弱小目标检测性能仍然存在不小的差距, 极大地限制了其在现实复杂应用中的推广和落地.

基于现有的研究和相关实验分析, 展望SAR弱小目标检测任务的几个未来发展方向如下.

1) 多源数据融合. 目前, 许多SAR弱小目标检测算法主要基于单一的SAR数据源. 然而, 在现实场景中, 多源数据(如光学遥感、多频段、多极化、多视角SAR数据等)可以提供更全面、更精确的信息. 因此, 探索多源数据融合技术, 以提高SAR弱小目标检测的精度和鲁棒性, 将是一个重要的研究方向.

2) 弱监督和半监督学习. 在许多应用场景中, 获取大量带标签的SAR数据是非常困难和昂贵的. 因此, 弱监督和半监督的方法, 能够利用未标记或者部分标记的数据进行有效学习, 是未来发展的一个重要趋势.

3) 物理可解释模型. 弱小目标成像与物理条件息息相关, 当前的检测大多局限在基于统计的特征提取中, 对于相位、目标散射结构和姿态角等成像物理条件挖掘不深, 后者具有清晰的可解释性. 因此, 在深度学习训练过程中, 引导网络学习成像条件与成像结果之间的内在联系是极有价值且富有挑战的问题.

4) 轻量化网络结构设计. 轻量化网络的设计需要满足应用技术落地的时效性要求, 同时还需要提升检测精度和鲁棒性. 为了实现这一目标, 网络结构应该针对弱小目标的特性进行精细化调整, 以避免在减少特征损失(即网络深度降低)的同时影响网络提取高语义特征的能力. 因此, 设计出具有出色检测效果的轻量化网络对于实际应用而言十分关键.

5) SAR弱小目标检测大规模数据集构建. 对于深度学习而言, 数据是基础, 优秀的网络架构需要使用高质量的大规模数据集进行训练, 以达到良好的检测效果. 然而, 对于SAR数据的标注需要专家的判断, 并且如果涉及军事机密, 还需要进行脱敏处理, 这导致制作大规模数据集的成本非常高. 因此, 在后续的研究中, 可以通过不同单位之间的协作来构建一个大规模且高质量的SAR弱小目标数据集, 这将成为推动深度学习技术在该领域发展的基础支撑.

6)针对SAR成像机理和弱小目标特性量身定制的网络架构. SAR弱小目标与主流检测网络所针对的通用检测对象在成像机理上存在显著差异, 而弱小目标自身的特性导致在特征提取环节中存在不可忽视的信息损失. 这种损失很难在后续处理中进行补偿, 从而影响整体的检测效果. 因此, 设计出适用于弱小目标检测任务的合适网络架构至关重要.

| [1] |

李毅, 杜兰, 杜宇昂. 基于特征分解卷积神经网络的SAR图像目标检测方法. 雷达学报, 2023, 12(5): 1069-1080. DOI:10.12000/JR23004 |

| [2] |

Chen JL, Zhang JC, Jin YH, et al. Real-time processing of spaceborne SAR data with nonlinear trajectory based on variable PRF. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5205212. |

| [3] |

Xu F, Shi YL, Ebel P, et al. GLF-CR: SAR-enhanced cloud removal with global-local fusion. ISPRS Journal of Photogrammetry and Remote Sensing, 2022, 192: 268-278. DOI:10.1016/j.isprsjprs.2022.08.002 |

| [4] |

Pu W. Shuffle GAN with autoencoder: A deep learning approach to separate moving and stationary targets in SAR imagery. IEEE Transactions on Neural Networks and Learning Systems, 2022, 33(9): 4770-4784. DOI:10.1109/TNNLS.2021.3060747 |

| [5] |

Hu RZ, Li XL, Yeo TS, et al. Refocusing and zoom-in polar format algorithm for curvilinear spotlight SAR imaging on arbitrary region of interest. IEEE Transactions on Geoscience and Remote Sensing, 2019, 57(10): 7995-8010. DOI:10.1109/TGRS.2019.2917717 |

| [6] |

Wang Z, Xu N, Guo JX, et al. SCFNet: Semantic condition constraint guided feature aware network for aircraft detection in SAR images. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5239420. |

| [7] |

徐丰, 王海鹏, 金亚秋. 合成孔径雷达图像智能解译. 北京: 科学出版社, 2020.

|

| [8] |

Chen LF, Luo R, Xing J, et al. Geospatial transformer is what you need for aircraft detection in SAR Imagery. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5225715. |

| [9] |

郭倩, 王海鹏, 徐丰. SAR图像飞机目标检测识别进展. 雷达学报, 2020, 9(3): 497-513. DOI:10.12000/JR20020 |

| [10] |

Lin TY, Maire M, Belongie S, et al. Microsoft COCO: Common objects in context. Proceedings of the 13th European Conference on Computer Vision. Zurich: Springer, 2014. 740–755.

|

| [11] |

Cheng G, Yuan X, Yao XW, et al. Towards large-scale small object detection: Survey and benchmarks. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2023, 45(11): 13467-13488. |

| [12] |

Chen CY, Liu MY, Tuzel O, et al. R-CNN for small object detection. Proceedings of the 13th Asian Conference on Computer Vision. Taipei: Springer, 2017. 214–230.

|

| [13] |

Wang XQ, Li G, Zhang XP, et al. A fast CFAR algorithm based on density-censoring operation for ship detection in SAR images. IEEE Signal Processing Letters, 2021, 28: 1085-1089. DOI:10.1109/LSP.2021.3082034 |

| [14] |

Yang R, Wang R, Deng YK, et al. Rethinking the random cropping data augmentation method used in the training of CNN-based SAR image ship detector. Remote Sensing, 2020, 13(1): 34. DOI:10.3390/rs13010034 |

| [15] |

Zou LC, Zhang H, Wang C, et al. MW-ACGAN: Generating multiscale high-resolution SAR images for ship detection. Sensors, 2020, 20(22): 6673. DOI:10.3390/s20226673 |

| [16] |

Li L, Wang C, Zhang H, et al. SAR image ship object generation and classification with improved residual conditional generative adversarial network. IEEE Geoscience and Remote Sensing Letters, 2022, 19: 4000105. |

| [17] |

Shi X, Xing MD, Zhang JS, et al. ISAGAN: A high-fidelity full-azimuth SAR image generation method. Proceedings of the 3rd China International SAR Symposium (CISS). Shanghai: IEEE, 2022. 1–4.

|

| [18] |

Wang CW, Pei JF, Liu XY, et al. SAR target image generation method using azimuth-controllable generative adversarial network. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2022, 15: 9381-9397. DOI:10.1109/JSTARS.2022.3218369 |

| [19] |

Zhao CX, Fu XJ, Dong J, et al. SAR ship detection based on end-to-end morphological feature pyramid network. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2022, 15: 4599-4611. DOI:10.1109/JSTARS.2022.3150910 |

| [20] |

Zhang L, Zhang ZJ, Lu ST, et al. Fast superpixel-based non-window CFAR ship detector for SAR imagery. Remote Sensing, 2022, 14(9): 2092. DOI:10.3390/rs14092092 |

| [21] |

Zhou Z, Cui ZY, Zang ZP, et al. UltraHi-PrNet: An ultra-high precision deep learning network for dense multi-scale target detection in SAR images. Remote Sensing, 2022, 14(21): 5596. DOI:10.3390/rs14215596 |

| [22] |

Wang JP, Lin YQ, Guo J, et al. SSS-YOLO: Towards more accurate detection for small ships in SAR image. Remote Sensing Letters, 2021, 12(2): 93-102. DOI:10.1080/2150704X.2020.1837988 |

| [23] |

Yu L, Wu HY, Zhong Z, et al. TWC-Net: A SAR ship detection using two-way convolution and multiscale feature mapping. Remote Sensing, 2021, 13(13): 2558. DOI:10.3390/rs13132558 |

| [24] |

Feng Y, Chen J, Huang ZX, et al. A lightweight position-enhanced anchor-free algorithm for SAR ship detection. Remote Sensing, 2022, 14(8): 1908. DOI:10.3390/rs14081908 |

| [25] |

Bai L, Yao C, Ye Z, et al. A novel anchor-free detector using global context-guide feature balance pyramid and united attention for SAR ship detection. IEEE Geoscience and Remote Sensing Letters, 2023, 20: 4003005. |

| [26] |

Xu P, Li QY, Zhang B, et al. On-board real-time ship detection in HISEA-1 SAR images based on CFAR and lightweight deep learning. Remote Sensing, 2021, 13(10): 1995. DOI:10.3390/rs13101995 |

| [27] |

Dai WX, Mao YQ, Yuan RA, et al. A novel detector based on convolution neural networks for multiscale SAR ship detection in complex background. Sensors, 2020, 20(9): 2547. DOI:10.3390/s20092547 |

| [28] |

Liu SW, Kong WM, Chen XF, et al. Multi-scale ship detection algorithm based on a lightweight neural network for spaceborne SAR images. Remote Sensing, 2022, 14(5): 1149. DOI:10.3390/rs14051149 |

| [29] |

Bai QL, Gao G, Zhang X, et al. LSDNet: Lightweight CNN model driven by PNF for PolSAR image ship detection. IEEE Journal on Miniaturization for Air and Space Systems, 2022, 3(3): 135-142. DOI:10.1109/JMASS.2022.3203082 |

| [30] |

Xu XW, Zhang XL, Shao ZK, et al. A group-wise feature enhancement-and-fusion network with dual-polarization feature enrichment for SAR ship detection. Remote Sensing, 2022, 14(20): 5276. DOI:10.3390/rs14205276 |

| [31] |

Zhou YS, Zhang FX, Ma F, et al. Small vessel detection based on adaptive dual-polarimetric feature fusion and sea-land segmentation in SAR images. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2022, 15: 2519-2534. DOI:10.1109/JSTARS.2022.3158807 |

| [32] |

Huang ZL, Datcu M, Pan ZX, et al. Deep SAR-Net: Learning objects from signals. ISPRS Journal of Photogrammetry and Remote Sensing, 2020, 161: 179-193. DOI:10.1016/j.isprsjprs.2020.01.016 |

| [33] |

Sun YR, Wang ZR, Sun X, et al. SPAN: Strong scattering point aware network for ship detection and classification in large-scale SAR imagery. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2022, 15: 1188-1204. DOI:10.1109/JSTARS.2022.3142025 |

| [34] |

Zhang YP, Lu DD, Qiu XL, et al. scattering-point-guided RPN for oriented ship detection in SAR images. Remote Sensing, 2023, 15(5): 1411. DOI:10.3390/rs15051411 |

| [35] |

An WT, Lin MS, Yang HJ. Stationary marine target detection with time-series SAR imagery. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2021, 14: 6406-6413. DOI:10.1109/JSTARS.2021.3088845 |

| [36] |

Kahar S, Hu FM, Xu F. Ship detection in complex environment using SAR time series. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2022, 15: 3552-3563. DOI:10.1109/JSTARS.2022.3170361 |

| [37] |

Ge J, Wang C, Zhang B, et al. Azimuth-sensitive object detection of high-resolution SAR images in complex scenes by using a spatial orientation attention enhancement network. Remote Sensing, 2022, 14(9): 2198. DOI:10.3390/rs14092198 |

| [38] |

Su N, He JY, Yan YM, et al. SII-Net: Spatial information integration network for small target detection in SAR images. Remote Sensing, 2022, 14(3): 442. DOI:10.3390/rs14030442 |

| [39] |

Niu YZ, Li YZ, Huang JY, et al. Efficient encoder-decoder network with estimated direction for SAR ship detection. IEEE Geoscience and Remote Sensing Letters, 2022, 19: 4504405. |

| [40] |

Deng YW, Guan DH, Chen YY, et al. SAR-shipnet: SAR-ship detection neural network via bidirectional coordinate attention and multi-resolution feature fusion. Proceedings of the 2022 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). Singapore: IEEE, 2022. 3973–3977.

|

| [41] |

武俊杰, 孙稚超, 吕争, 等. 星源照射双/多基地SAR成像. 雷达学报, 2023, 12(1): 13-35. DOI:10.12000/JR22213 |

| [42] |

Schmitt M, Hughes LH, Zhu XX. The SEN1-2 dataset for deep learning in SAR-optical data fusion. ISPRS Annals of the Photogrammetry, Remote Sensing and Spatial Information Sciences, 2018, IV-1: 141–146.

|

| [43] |

Wang XQ, Zhu D, Li G, et al. Proposal-copula-based fusion of spaceborne and airborne SAR images for ship target detection. Information Fusion, 2022, 77: 247-260. DOI:10.1016/j.inffus.2021.07.019 |

| [44] |

Zhang CX, Feng YK, Hu L, et al. A domain adaptation neural network for change detection with heterogeneous optical and SAR remote sensing images. International Journal of Applied Earth Observation and Geoinformation, 2022, 109: 102769. DOI:10.1016/j.jag.2022.102769 |

| [45] |

Kang WC, Xiang YM, Wang F, et al. CFNet: A cross fusion network for joint land cover classification using optical and SAR images. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2022, 15: 1562-1574. DOI:10.1109/JSTARS.2022.3144587 |

| [46] |

Gao QW, Feng ZX, Yang SY, et al. Multi-path interactive network for aircraft identification with optical and SAR images. Remote Sensing, 2022, 14(16): 3922. DOI:10.3390/rs14163922 |

| [47] |

Lou X, Liu YC, Xiong ZW, et al. Generative knowledge transfer for ship detection in SAR images. Computers and Electrical Engineering, 2022, 101: 108041. DOI:10.1016/j.compeleceng.2022.108041 |

| [48] |

Zhang JS, Xing MD, Sun GC, et al. Multiple statistics contributing to few-sample deep learning for subtle trace detection in high-resolution SAR images. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5210114. |

| [49] |

Shi H, Fang ZH, Wang YP, et al. An adaptive sample assignment strategy based on feature enhancement for ship detection in SAR images. Remote Sensing, 2022, 14(9): 2238. DOI:10.3390/rs14092238 |

| [50] |

Xu ZJ, Gao R, Huang K, et al. Triangle distance IoU loss, attention-weighted feature pyramid network, and rotated-SARShip dataset for arbitrary-oriented SAR ship detection. Remote Sensing, 2022, 14(18): 4676. DOI:10.3390/rs14184676 |

| [51] |

Yu JM, Wu T, Zhang X, et al. An efficient lightweight SAR ship target detection network with improved regression loss function and enhanced feature information expression. Sensors, 2022, 22(9): 3447. DOI:10.3390/s22093447 |

| [52] |

Zhao SY, Zhang ZH, Guo WW, et al. An automatic ship detection method adapting to different satellites SAR images with feature alignment and compensation loss. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5225217. |

| [53] |

Zhang TW, Zhang XL, Li JW, et al. SAR ship detection dataset (SSDD): Official release and comprehensive data analysis. Remote Sensing, 2021, 13(18): 3690. DOI:10.3390/rs13183690 |

| [54] |

Wang YY, Wang C, Zhang H, et al. A SAR dataset of ship detection for deep learning under complex backgrounds. Remote Sensing, 2019, 11(7): 765. DOI:10.3390/rs11070765 |

| [55] |

孙显, 王智睿, 孙元睿, 等. AIR-SARShip-1.0: 高分辨率SAR舰船检测数据集. 雷达学报, 2019, 8(6): 852–862.

|

| [56] |

Wei SJ, Zeng XF, Qu QZ, et al. HRSID: A high-resolution SAR images dataset for ship detection and instance segmentation. IEEE Access, 2020, 8: 120234-120254. DOI:10.1109/ACCESS.2020.3005861 |

| [57] |

Zhang TW, Zhang XL, Ke X, et al. LS-SSDD-v1.0: A deep learning dataset dedicated to small ship detection from large-scale Sentinel-1 SAR images. Remote Sensing, 2020, 12(18): 2997.

|

| [58] |

Lei SL, Lu DD, Qiu XL, et al. SRSDD-v1.0: A high-resolution SAR rotation ship detection dataset. Remote Sensing, 2021, 13(24): 5104.

|

| [59] |

Xia R, Chen J, Huang Z, et al. CRTransSar: A visual transformer based on contextual joint representation learning for SAR ship detection. Remote Sensing, 2022, 14(6): 1488. Xia R, Chen J, Huang Z, et al. CRTransSar: A visual transformer based on contextual joint representation learning for SAR ship detection. Remote Sensing, 2022, 14(6): 1488. |

| [60] |

徐从安, 苏航, 李健伟, 等. RSDD-SAR: SAR舰船斜框检测数据集. 雷达学报, 2022, 11(4): 581-599. DOI:10.12000/JR22007 |

| [61] |

Zhang P, Xu H, Tian T, et al. SEFEPNet: Scale expansion and feature enhancement pyramid network for SAR aircraft detection with small sample dataset. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2022, 15: 3365-3375. DOI:10.1109/JSTARS.2022.3169339 |

| [62] |

王智睿, 康玉卓, 曾璇, 等. SAR-AIRcraft-1.0: 高分辨率SAR飞机检测识别数据集. 雷达学报, 2023, 12(4): 906–922.

|

| [63] |

Chang H, Fu XJ, Lu JH, et al. SPANet: A self-balancing position attention network for anchor-free SAR ship detection. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2023, 16: 8363-8378. DOI:10.1109/JSTARS.2023.3283669 |

| [64] |

Tang G, Zhao HR, Claramunt C, et al. PPA-Net: Pyramid pooling attention network for multi-scale ship detection in SAR images. Remote Sensing, 2023, 15(11): 2855. DOI:10.3390/rs15112855 |

| [65] |

Zhu HZ, Xie Y, Huang HH, et al. DB-YOLO: A duplicate bilateral YOLO network for multi-scale ship detection in SAR images. Sensors, 2021, 21(23): 8146. DOI:10.3390/s21238146 |

| [66] |

Zhao CX, Fu XJ, Dong J, et al. Lpdnet: A lightweight network for SAR ship detection based on multi-level laplacian denoising. Sensors, 2023, 23(13): 6084. DOI:10.3390/s23136084 |

| [67] |

Yu JM, Zhou GY, Zhou SB, et al. A fast and lightweight detection network for multi-scale SAR ship detection under complex backgrounds. Remote Sensing, 2022, 14(1): 31. |

| [68] |

Yang S, An WT, Li SB, et al. An improved FCOS method for ship detection in SAR images. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2022, 15: 8910-8927. DOI:10.1109/JSTARS.2022.3213583 |

| [69] |

Zhang LB, Li CY, Zhao LJ, et al. A cascaded three-look network for aircraft detection in SAR images. Remote Sensing Letters, 2020, 11(1): 57-65. DOI:10.1080/2150704X.2019.1681599 |

| [70] |

Zou B, Qin J, Zhang LM. Vehicle detection based on semantic-context enhancement for high-resolution SAR images in complex background. IEEE Geoscience and Remote Sensing Letters, 2022, 19: 4503905. |

| [71] |

Sun Y, Wang WN, Zhang QY, et al. Improved YOLOv5 with Transformer for large scene military vehicle detection on SAR image. Proceedings of the 7th International Conference on Image, Vision and Computing (ICIVC). Xi’an: IEEE, 2022. 87–93.

|

| [72] |

Kang YZ, Wang ZR, Fu JM, et al. SFR-Net: Scattering feature relation network for aircraft detection in complex SAR images. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5218317. |

| [73] |

Yan GX, Chen ZH, Wang Y, et al. LssDet: A lightweight deep learning detector for SAR ship detection in high-resolution SAR images. Remote Sensing, 2022, 14(20): 5148. DOI:10.3390/rs14205148 |

| [74] |

Song T, Kim S, Kim ST, et al. Context-preserving instance-level augmentation and deformable convolution networks for SAR ship detection. Proceedings of the 2022 IEEE Radar Conference (RadarConf22). New York: IEEE, 2022. 1–6.

|

| [75] |

Sun YR, Sun X, Wang ZR, et al. Oriented ship detection based on strong scattering points network in large-scale SAR images. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5218018. |

| [76] |

Spröhnle K, Fuchs EM, Pelizari PA. Object-based analysis and fusion of optical and SAR satellite data for dwelling detection in refugee camps. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2017, 10(5): 1780-1791. DOI:10.1109/JSTARS.2017.2664982 |

2024, Vol. 33

2024, Vol. 33