2. 淮北师范大学 智能计算及应用安徽省重点实验室, 淮北 235099;

3. 合肥工业大学 工业安全与应急技术安徽省重点实验室, 合肥 230601

2. Anhui Province Key Laboratory of Intelligent Computing and Applications, Huaibei Normal University, Huaibei 235099, China;

3. Anhui Province Key Laboratory of Industry Safety and Emergency Technology, Hefei University of Technology, Hefei 230601, China

优化问题广泛存在现实生活中, 比如投资者试图获得最大化收益和承担最小风险; 工厂期望投入最少的人工成本获得较高的生产效率等. 这些问题都需要考虑多个目标[1–4], 这些目标之间通常存在争议, 不可能同时达到最优结果. 因此, 为了使总体目标尽可能优化, 需要各目标之间的协调与妥协[5]. 近几十年来, 多目标进化算法蓬勃发展[5–8]. 自VEGA算法提出以来[9], 对多目标进化算法(MOEA)的研究一直在稳步增长. 大多数MOEA可以分为3类: 第1类是基于帕累托支配的MOEA, 代表算法有: NSGA[10]和NSGA-II[11]. 第2类基于分解的MOEA, 代表算法有: MOEA/D[12]、RVEA[13]和MMOPSO[14]. 第3类MOEA侧重于基于性能指标的MOEA, 代表算法有: IBEA[15]、HypE[16]和GrEA[17,18]. 随着科学技术的进步, 实际生产生活中的多目标优化问题日趋复杂, 问题决策变量的数量大幅增加. 例如, 神经网络的训练问题, 车辆的路径规划问题等. 虽然大规模单目标优化领域发展非常成熟[19], 但在处理大规模多目标优化问题(LSMOP)时, 大规模单目标优化和大规模多目标优化仍然存在一定的差异[20], 因此解决LSMOP成为研究热点. 大规模多目标优化算法主要分为以下3类: 第1类使用的是分而治之的思想[21]. Potter等人是CC框架的最初支持者[22]. 协同进化的分组方法包括固定分组[23]、随机分组[24]、Delta分组[25]、动态分组[26]和差分分组[27]. 这类算法的性能依赖于正确的分组, 且有较大的局限性. 第2类是基于决策变量分析的求解方法, 主要是挖掘决策变量与优化问题之间的相关性, 典型的例子是MOEA/DVA[28], LMEA[29]. 这类算法由于变量之间存在相关性, 难以划分, 因此会导致变量的分类不正确, 并且会因为分组而增加计算量. 第3类是问题转换的方法, 问题转换策略是将LSMOP转化为小规模MOP, 然后使用传统的进化算法进行优化. 代表算法有: WOF[30]和LSMOF[31]. 这类算法由于问题的重构, 没有考虑到一些决策变量的信息, 使得算法的多样性不好. 除此之外, 学者们还提出了其他一些解决LSMOP的方法. 例如, DGEA算法[32]和SparseEA算法[33]. 该类算法计算量大, 收敛速度慢.

MOEA/D算法能够有效解决多目标问题, 但是在处理大规模优化问题时存在以下不足: 当初始种群质量较差时, 可能会限制算法对搜索空间的覆盖范围, 导致算法难以找到更优解. 此外, 固定的邻域结构并不适用于所有测试问题. 同时, 单一的突变策略可能会导致算法收敛速度较慢, 并需要大量函数求值才能跳出局部最优解. 为了解决这些问题, 本文提出了一种基于多策略的大规模多目标优化算法(MSMOEA/D). 该算法采用混合初始化策略来增加种群的多样性, 通过优化邻域调整来提高算法的全局搜索能力, 并采用多种突变策略来弥补单一突变策略的不足. 这些改进措施旨在帮助算法更有效地探索搜索空间, 避免局部收敛, 并最终找到更优解.

1 相关背景知识 1.1 大规模多目标优化问题多目标优化问题(MOP)可表述为:

| $\left\{ \begin{gathered} \min {\text{ }}F(x) = {({f_1}(x), {f_2}(x), \cdots, {f_M}(x))^{\mathrm{T}}} \\ {\text{s.t. }}x = ({x_1}, {x_2}, \cdots, {x_D}) \in {R^D} \\ \end{gathered}\right. $ | (1) |

其中,

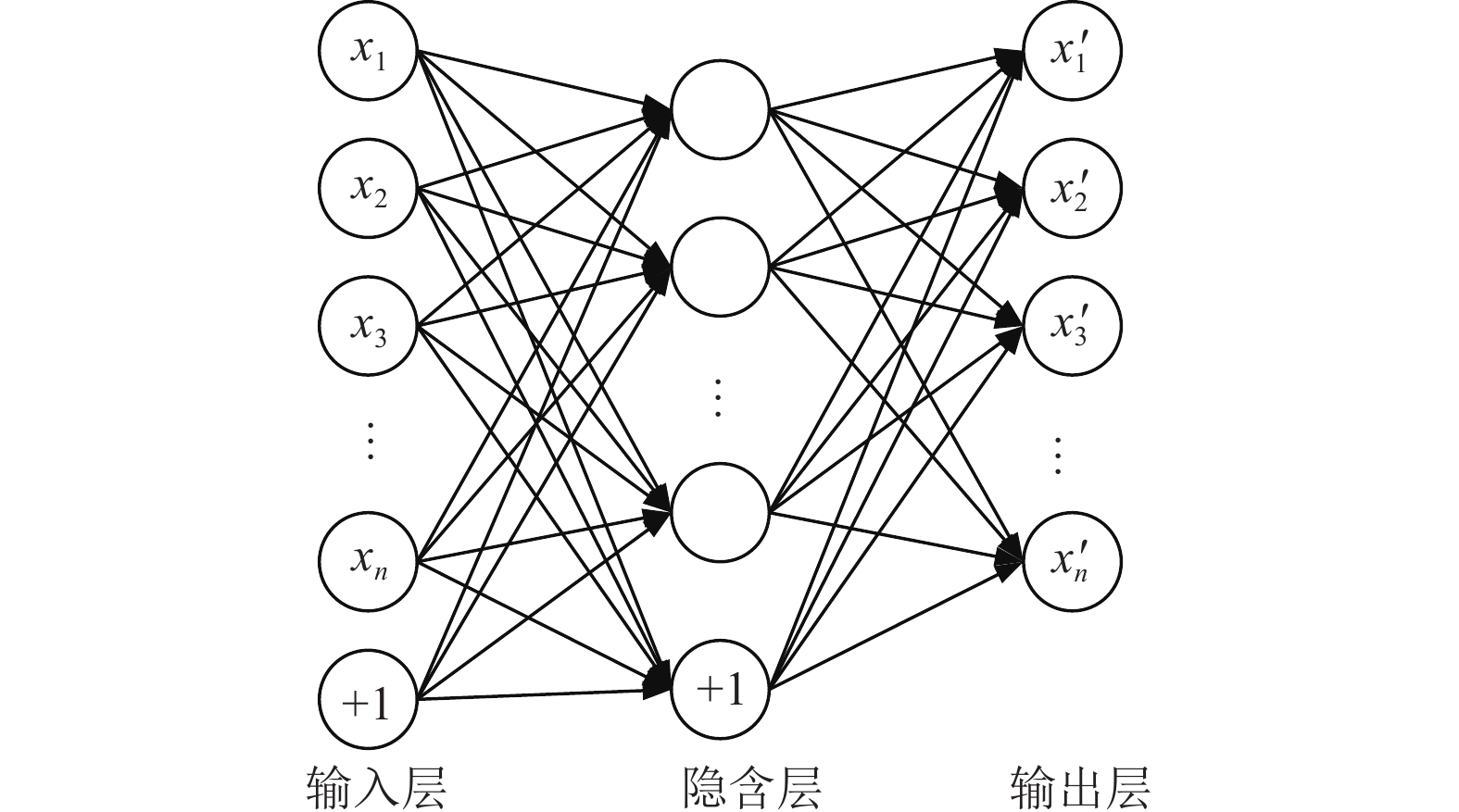

自动编码器(AE)是一种用于半监督学习和无监督学习的人工神经网络, 它能够学习数据的有效特征, 广泛应用于机器学习的多个任务中, 如数据压缩[34]、特征提取[35]、数据重构[36]和生成模型[37]. 它由两部分组成: 编码器和解码器. 编码器包含输入层和隐藏层, 将高维输入转换为低维潜在变量, 以便神经网络捕获最具信息量的特征. 解码器包含隐藏层和输出层, 将低维变量恢复到原始维度. 在训练过程中, 通过最小化输入数据与解码器输出之间的重构误差, 自动编码器获得数据的压缩表示, 这种表示捕获了输入数据的基本特征, 允许自编码器保留关键特征信息[38]. 3层自动编码器模型如图1所示.

|

图 1 一个3层自动编码器模型 |

2 多策略大规模多目标优化算法

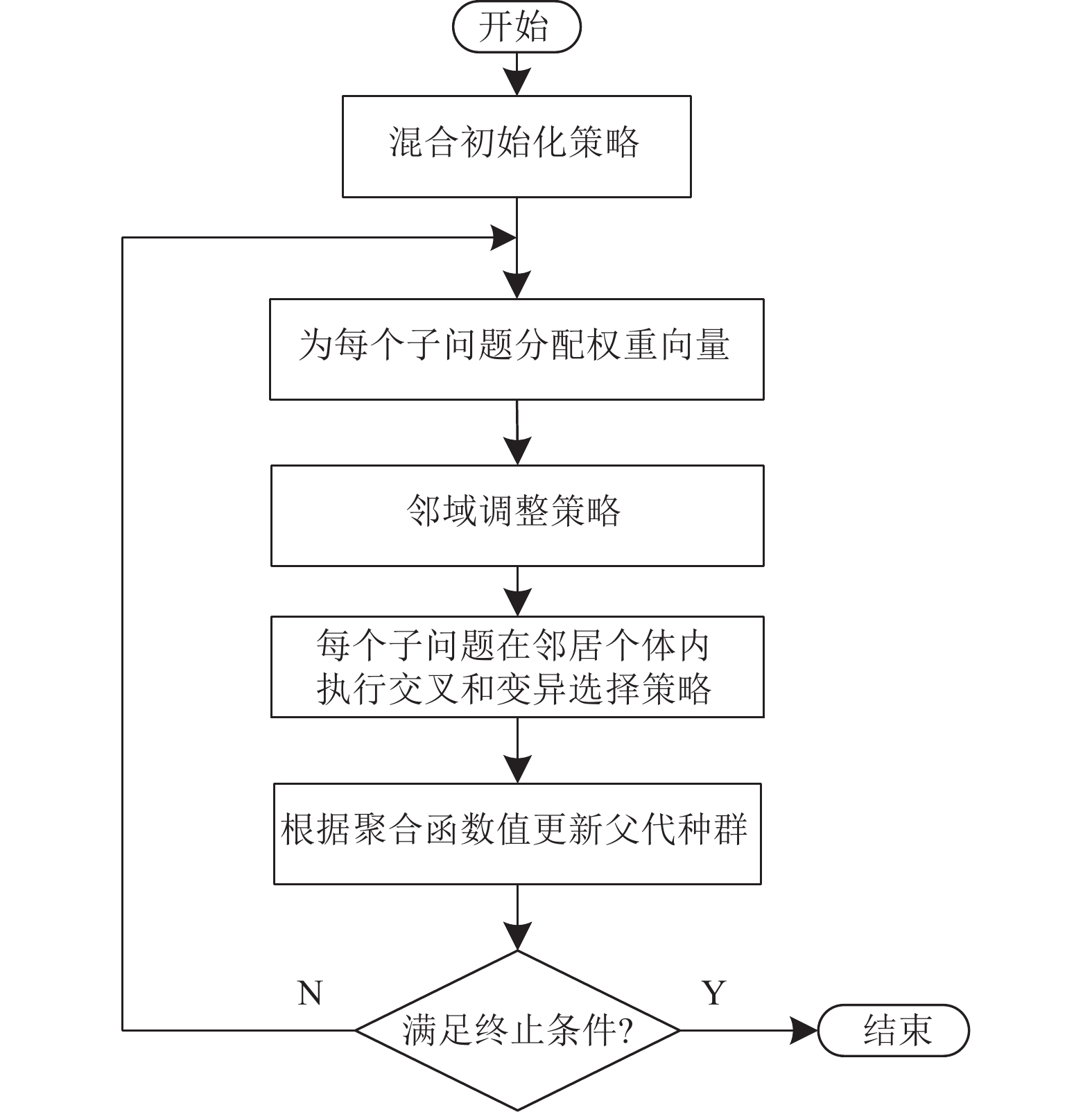

本文将从混合初始化策略、邻域调整策略和突变选择策略3个方面介绍多策略的大规模多目标优化算法. 图2是算法的主要流程图.

|

图 2 算法的主要流程图 |

2.1 基于自动编码器的混合初始化策略

种群初始化在优化算法中非常重要, 它直接影响了算法的搜索效率和最终的优化结果. 在高维空间中, 种群初始化容易受到维度诅咒的影响, 导致种群分布不均匀, 从而阻碍了对搜索空间中有价值信息的有效探索和利用. 自动编码器可以学习数据的特征表示, 有助于捕获数据中的重要特征. 这些学习到的特征可以用于初始化种群, 从而提高算法对问题的理解和搜索效率. 因此, 本文在种群初始化阶段使用了基于自动编码器的混合初始化策略. 通过自动编码器的数据不是直接从输入映射到输出. 自动编码器的编码过程能够从输入数据中学习到隐藏的特征, 而解码则使用新获取的特征重建输入数据. 通过利用神经网络的非线性特征提取能力, 自动编码器可以实现有效的数据表示.

由于这一特点, 本文使用自动编码器从随机初始化的种群中提取特征. 首先使用随机生成的种群对自动编码器进行训练, 然后利用训练好的自动编码器对输入数据进行重构, 以更清晰地表示决策变量的特征, 并降低计算成本, 获得更好的结果. 然而, 自动编码器重构的种群可能过于集中, 导致算法的多样性下降. 因此, 本文将自动编码器重构的种群与随机生成的种群合并, 并进行环境选择. 这一步骤利用非支配排序和拥挤距离来选择最终的初始种群, 从而为后续优化过程提供更好的初始种群, 加快收敛速度并找到更优的解决方案. 本文将隐藏层的大小设置为10, 输入和输出层的数量对应于决策变量的维度.

混合初始化策略的伪代码如算法1.

算法1. 混合初始化策略

输入: 当前优化问题(MOP), 种群数(N).

输出: 最终种群(Pop).

1. 随机生成种群population

2. autoencoder=训练自动编码器(population)

3. reconstructed_population=重构(autoencoder, population)

4. merged_population=合并种群(population, reconstructed_population)

5. Pop=环境选择(merged_population)

2.2 基于聚合函数值的邻域调整策略邻域大小对进化算法的效果有显著影响. 较大的邻域可以加速算法的收敛速度, 但可能会牺牲种群的多样性, 从而限制了局部搜索能力. 相反, 较小的邻域可以保持种群的多样性, 增强局部搜索的效果, 但可能会导致算法陷入局部最优解[39]. 在算法的早期阶段, 种群的进化速度较快, 收敛性较强, 因此需要适当减小邻域的大小, 以保留种群的多样性. 在中间阶段, 种群的进化速度减慢, 此时可以适当增加邻域的大小, 以避免种群进入进化停滞状态. 在算法发展的后期, 需要特别关注种群的多样性, 因此应适当减小邻域的大小, 以确保种群在Pareto前沿的分布更加均匀.

不同的进化过程对邻域大小有不同的要求. 为了提高种群进化效率, 本文提出了基于聚合函数值的邻域自适应调整策略, 该策略根据当前种群的进化进程和聚合函数值的变化程度动态调整邻域. 具体措施如下: 如果当前进化代数超过10并且评价次数小于最大评价次数的0.8倍时, 根据聚合函数的改进程度值(improve)每隔10代调整邻域大小, 具体邻域调整过程如下: 如果聚合函数的改进程度大于0.01, 则表明种群处于快速进化状态, 需要减小邻域大小, 因此邻域等于最小邻域值, 以防止陷入局部最优, 否则邻域等于最大邻域值, 以防止陷入进化停滞, 增加产生更好后代的概率. 如果当前进化代数小于10, 或者评价次数大于等于最大评价次数的0.8倍, 采用包含评价次数的公式来调整邻域大小. 这种邻域调整方法可以有效地在算法的收敛性和多样性之间取得平衡. 聚合函数改进程度值“improve”公式如下:

| $ improve = \frac{{\dfrac{{\displaystyle\sum\limits_{i = 1}^N {(g_{gen}^{te}({x^i})) - (g_{{gen-}10}^{te}({x^i}))} }}{N}}}{{\dfrac{{\displaystyle\sum\limits_{i = 1}^N {(g_{{gen-}10}^{te}({x^i}))} }}{N}}} $ | (2) |

其中,

对于双目标优化问题, 当邻域大小超过70时, 算法的有效性不受邻域大小选择的实质性影响. 对于三目标优化问题, 当邻域大小超过40时, 邻域大小的设置对算法的有效性影响不太显著. 然而, 当邻域大小小于10时, 算法的有效性显著下降. 因此, 本文将最大邻域指定为40, 最小邻域指定为10.

基于聚合函数值的邻域调整策略的伪代码如算法2所示.

算法 2. 邻域调整策略

输入: 当前代数(gen), 评价次数(FES), 最大评价次数(MAXFES), 聚合函数值改进程度(improve), 最大邻域值(nmax), 最小邻域值(nmin).

输出: 邻域大小(niche).

1. if gen>10&&FES<0.8×MAXFES

2. if improve>0.01

3. niche=nmin;

4. else

5. niche=nmax;

6. end

7. else

8. D = FES/MAXFES;

9. niche=ceil(nmin+(nmax–nmin)×sin(π×D));

10. end

2.3 基于非支配排序的突变选择策略突变因子(

不同的变异策略具有各自独特的特点, 即使是相同算法在不同阶段采用相同的变异策略, 也会呈现不同的效果. 在算法进化的早期阶段, 全局搜索能力较强的突变策略更有优势, 而在算法的后期阶段, 局部搜索能力较强的突变策略更有优势. 因此, 在算法进化的各个阶段采用合适的突变策略可以提高算法的有效性. 其中, DE/rand/1突变方法具有较强的全局搜索能力, DE/current-to-rand/2突变方法具有较强的局部搜索能力.

本文选择的突变方法操作如下.

(1) DE/rand/1

| $ newPop = x_{r_1}^G + F\times(x_{r_2}^G - x_{r_3}^G) $ | (3) |

其中,

(2) DE/current-to-rand/2

| $ newPop = x_i^G + K \times (x_i^G - x_{r_1}^G) + F \times (x_{r_2}^G - x_{r_3}^G) + F \times (x_{r_4}^G - x_{r_5}^G) $ | (4) |

其中,

对种群进行非支配排序, 当处在第1级的种群数较多时, 可以说明种群的收敛性较好, 反之, 种群的多样性较好. 本文使用非支配排序来进行突变策略的选择. 在基因重组过程中, 首先选择高斯随机数作为变异算子, 然后, 对邻域种群进行非支配排序, 使用NUM来评价种群的收敛性. 具体操作如下: 首先, 对邻域种群进行非支配排序, 如果NUM大于等于

以LSMOP1为例, 该问题具有两个目标和100个决策变量维度. 在参数选择过程中, 需要考虑算法的性能指标, 其中包括generation distance (GD)和spacing (SP).

由表1可知, 当NUM大于或等于邻域种群数量的一半时, GD和SP值最小, 因此我们选择NUM大于或等于niche/2.

| 表 1 由LSMOP1上的GD和SP决定b的值 |

基于非支配排序的突变策略选择伪代码如算法3.

算法 3. 突变选择策略

输入: 邻域大小(niche), 非支配排序等级 (FrontNo).

输出: 新的后代.

1. 从邻居中随机选择5个个体

2. 基于高斯分布生成变异因子F

3. if length (find (FrontNo==1))>=niche/2

4. 执行DE/rand/1变异策略生成新的后代

5. else

6. 执行DE/current-to-rand/2变异策略生成新的后代

7. end if

8. 对新的后代执行高斯变异, 并防止超过上限和下限的值

9. 计算新后代的适应度值

10. 返回新的后代

3 实验结果分析 3.1 实验设置和比较算法为了评估MSMOEA/D算法的有效性, 选择了二目标和三目标LSMOP测试问题[41], 以及三目标DTLZ1-4和DTLZ6[42]测试问题进行性能评估. 本文的比较算法在PLATEMO[43]平台上运行, 改进后的算法在Matlab 2020b上运行. 为了确保公平性, 所有算法在64位Windows 10系统上独立运行了20次, 使用的处理器为Intel (R) Core (TM) i5-4460 CPU@3.20 GHz, 内存大小为4.00 GB.

本文的比较算法有: MOEA/D[12]、CCGDE3[23]、RVEA[13]、MMOPSO[14]、LMEA[29]、DGEA[32].

3.2 参数设置和评价指标(1)参数设置: 当目标数为3时, 种群大小设置为300. 当目标数为2时, 种群大小设置为100. 由于DTLZ和LSMOP属于不同类型的多目标优化问题, 它们具有不同的问题特征和搜索空间结构. 所以参数设置不同. LSMOP测试问题中决策变量的维数设置为100、200和500维. 最多可进行D×10000次评估. 对于DTLZ测试问题, 将决策变量的维数设置为500和

(2)评价指标: 采用收敛性指标GD[44]和多样性指标SP[45].

3.3 实验结果 3.3.1 DTLZ上各种算法的实验结果及分析表2和表3分别给出了MOEA/D、CCGDE3、RVEA、MMOPSO、LMEA、DGEA和改进算法在500维和

统计结果表明, 改进算法在DTLZ1、DTLZ3、DTLZ6问题上表现出较好的收敛性, MOEA/D算法在DTLZ2、DTLZ4问题上表现出较好的收敛性. 共有10个问题, 改进后的算法在平均值方面有6个优势. 综上所述, 改进后的算法在大多数测试问题上表现出比对比算法更好的性能, 可以推断出在上面的DTLZ测试问题时, 该算法的收敛性优于其他算法.

改进算法在DTLZ1、DTLZ3和DTLZ6问题上的收敛性优于MOEA/D算法. 与CCGDE3、MMOPSO、LMEA和DGEA算法相比, 改进算法在DTLZ1–DTLZ4和DTLZ6问题上具有更好的收敛性. 在DTLZ1、DTLZ3、DTLZ6问题上, 改进算法的收敛性优于RVEA算法.

统计结果表明, 改进算法在DTLZ3、DTLZ4、DTLZ6测试问题上具有较好的多样性, 而DGEA算法在DTLZ1测试问题上表现最好. RVEA算法在DTLZ2测试问题上表现最佳. 总共有10个问题, 改进后的算法在平均值方面有6个优势. 可以得出结论, 该算法在上面的DTLZ测试问题上比其他比较算法具有更好的多样性.

与MOEA/D算法相比, 改进算法在DTLZ3、DTLZ4、DTLZ6测试问题上具有更好的多样性. 改进算法在DTLZ1–DTLZ4和DTLZ6测试问题上的多样性优于CCGDE3和LMEA算法, 在DTLZ1、DTLZ3、DTLZ4和DTLZ6测试问题上的多样性优于RVEA和MMOPSO算法. 在DTLZ2、DTLZ3、DTLZ4、DTLZ6测试问题上的多样性优于DGEA算法的多样性.

|

表 2 500维和 |

|

表 3 500维和 |

|

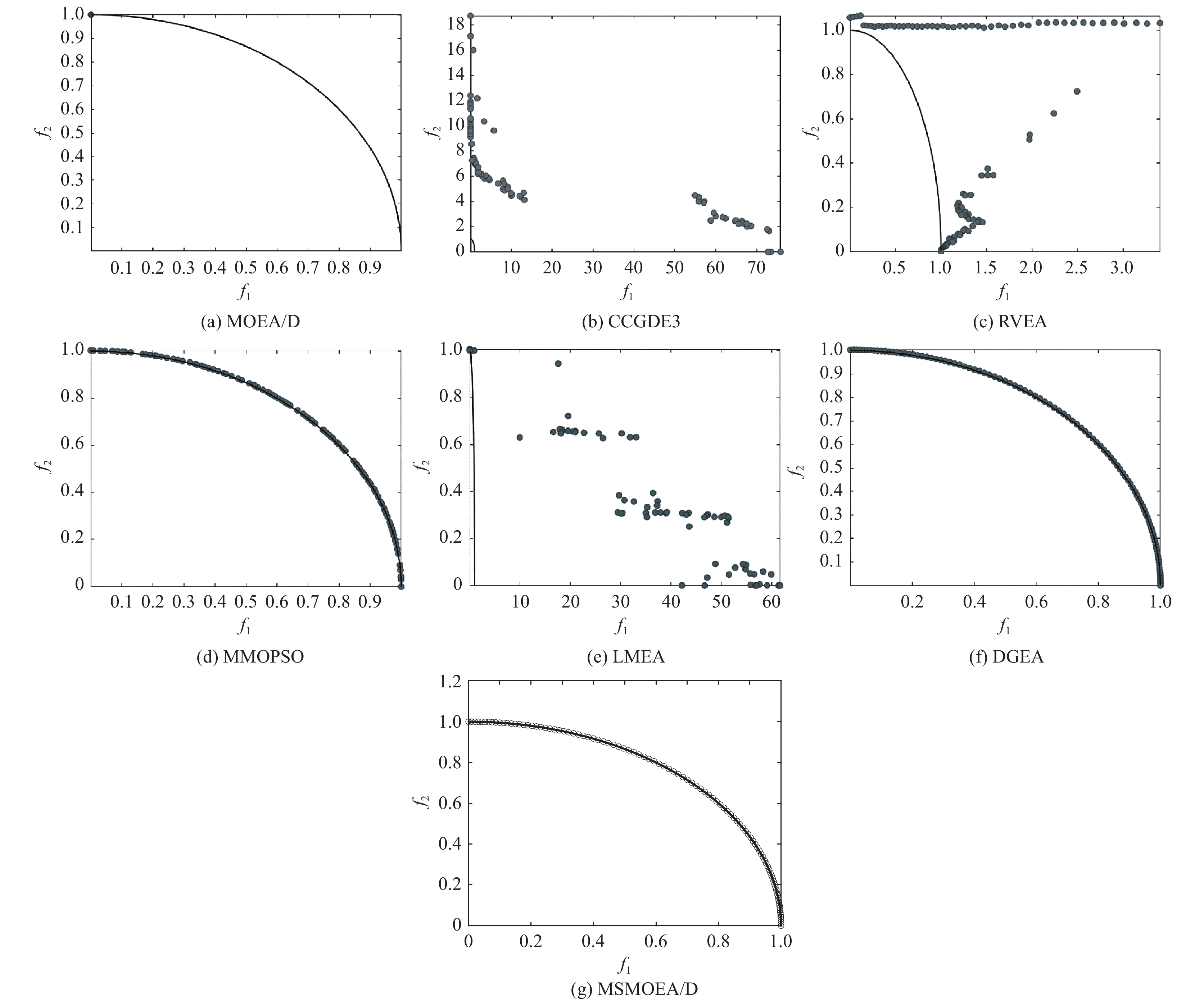

图 3 7种算法在三目标500维DTLZ6测试问题上找到的非支配解 |

由图3可以看出, 改进算法在三目标500维DTLZ6测试问题上取得了比其他算法更好的PF. 改进后的算法相比对比算法在收敛性和多样性上都有显著提高.

3.3.2 LSMOP上各种算法的实验结果及分析表4和表5分别给出了MOEA/D、CCGDE3、RVEA、MMOPSO、LMEA、DGEA和改进算法在100维、200维和500维二目标LSMOP测试问题上的GD和SP结果. 记录实验中GD和SP指标的平均值, 方差值在括号中. 根据结果的平均值, 用粗体形式强调了比较算法中较优的结果.

统计结果表明, 改进算法在LSMOP1、100维LSMOP2、LSMOP4、LSMOP5、LSMOP8、LSMOP9测试问题上均有较好的收敛性. RVEA算法在LSMOP3测试问题上表现最优. MMOPSO算法在500维LSMOP7测试问题上表现最优. 在200维和500维LSMOP2、LSMOP6, 100维和200维LSMOP7测试问题上, DGEA算法表现最优. 测试问题共27道, 改进后的算法在平均值上有16个优势. 可以推断该算法在二目标LSMOP测试问题上比其他对比算法具有更好的收敛性.

统计结果表明, 改进算法在LSMOP1、100维LSMOP2、LSMOP4、LSMOP5、100维和200维LSMOP8测试问题上具有良好的多样性, 其中RVEA算法在LSMOP3测试问题上表现最好. MMOPSO算法在200维、500维LSMOP6、500维LSMOP7、LSMOP9测试问题上表现最好. DGEA算法在200维和500维LSMOP2、100维LSMOP6、100维和200维LSMOP7、500维LSMOP8测试问题上具有良好的多样性. 共有27个测试问题, 改进后的算法在平均值方面有12个优势. 可以推断该算法在双目标LSMOP测试问题上比其他比较算法表现出更好的多样性.

| 表 4 在二目标LSMOP上的GD值 |

| 表 5 在二目标LSMOP上的SP值 |

|

图 4 7种算法在二目标100维LSMOP5测试问题上找到的非支配解 |

从图4可以明显看出, 改进算法在二目标100维LSMOP5测试问题上取得了比其他算法更好的效果. 与比较算法相比, 改进算法在收敛性和多样性方面都有了明显的改进.

表6和表7分别给出了MOEA/D、CCGDE3、RVEA、MMOPSO、LMEA、DGEA和改进算法在100、200和500维三目标 LSMOP测试问题上的GD和SP结果. 记录实验中GD和SP指标的平均值, 方差值在括号中. 根据结果的平均值, 用粗体形式强调了比较算法中较优的结果.

统计结果表明, 改进算法对500维LSMOP3、LSMOP5、LSMOP6、LSMOP7、500维LSMOP8、LSMOP9测试问题具有较好的收敛性. MOEA/D在LSMOP1、100维LSMOP2、LSMOP4、100维和200维LSMOP8测试问题上具有良好的收敛性. MMOPSO在100维和200维LSMOP3测试问题上表现最好. DGEA在200维和500维LSMOP2测试问题上表现最好. 共有27个测试问题, 改进后的算法在平均值方面有14个优势. 可以得出结论, 在三目标LSMOP测试问题上, 改进算法在收敛性上相较于比较算法有了明显的提高.

统计结果表明, 改进算法在100维、200维LSMOP5、LSMOP6、LSMOP7测试问题上具有较好的多样性. MOEA/D算法在200维LSMOP1、500维LSMOP3、100维LSMOP8、LSMOP9测试问题上具有较好的多样性. RVEA算法在500维LSMOP1、200和500维LSMOP2、200和500维LSMOP4、500维LSMOP5测试问题上表现最优. MMOPSO算法在100维和200维LSMOP3测试问题上表现最优. 在100维LSMOP1、100维LSMOP2、100维LSMOP4、200维和500维LSMOP8测试问题上, DGEA算法表现最优. 总共有27个测试问题, 改进后的算法在平均值上有8个优势. 在三目标LSMOP测试问题上, 该算法在多样性方面表现较差.

| 表 6 在三目标LSMOP上的GD值 |

| 表 7 在三目标LSMOP上的SP值 |

|

图 5 7种算法在三目标100维LSMOP9测试问题上找到的非支配解 |

从图5可以看出, 在三目标 100维LSMOP9测试问题上, 改进算法与其他算法相比收敛性更优.

4 结论和展望MSMOEA/D算法首先引入了基于自动编码器的混合初始策略, 以获得更优质的初始种群, 为后续的优化过程提供良好的起点, 从而使算法能够更充分地探索解空间. 接着, 根据当前种群和聚合函数值的变化程度动态调整邻域, 以在不同的进化阶段更好的交换信息. 最后, 采用基于非支配排序的变异选择策略, 以实现算法全局和局部搜索能力的平衡. 在LSMOP和DTLZ测试问题上的实验结果表明, 与其他算法相比, 改进的MSMOEA/D算法在解决LSMOP问题上是有效的.

解决大规模优化问题是进化算法领域的一个重要挑战, 得到了众多学者的关注. 虽然提出的改进算法具有更强的收敛能力, 但在三目标LSMOP测试问题上的实验结果表明, 种群在Pareto前沿分布不均匀. 因此, LSMOP的解决方案还需要进一步研究. 未来, 我们可以考虑使用决策空间中的方向向量来指导有前途后代的生成, 并扩展算法在高维目标优化问题和实际问题中的应用.

| [1] |

黄杰, 武瑞梓, 李均利. 进化算法在复杂网络中的应用综述. 计算机系统应用, 2023, 32(4): 16-41. DOI:10.15888/j.cnki.csa.009037 |

| [2] |

Zhang L, Pan HB, Su YS, et al. A mixed representation-based multiobjective evolutionary algorithm for overlapping community detection. IEEE Transactions on Cybernetics, 2017, 47(9): 2703-2716. DOI:10.1109/TCYB.2017.2711038 |

| [3] |

常大亮, 史海波, 刘昶. 具有紧时高能耗工序特征的多目标调度优化问题求解. 中国机械工程, 1–12. http://kns.cnki.net/kcms/detail/42.1294.th.20240308.1647.008.html. (2024-03-10)[2024-04-19].

|

| [4] |

姜涛, 梁振宇, 程然, 等. GPU加速的演化算法求解多目标流水车间调度问题. 计算机应用, 2024, 44(5): 1364-1371. DOI:10.11772/j.issn.1001-9081.2024010028 |

| [5] |

Zhou AM, Qu BY, Li H, et al. Multiobjective evolutionary algorithms: A survey of the state of the art. Swarm and Evolutionary Computation, 2011, 1(1): 32-49. DOI:10.1016/j.swevo.2011.03.001 |

| [6] |

谢承旺, 余伟伟, 郭华, 等. DAV-MOEA: 一种采用动态角度向量支配关系的高维多目标进化算法. 计算机学报, 2022, 45(2): 317-333. DOI:10.11897/SP.J.1016.2022.00317 |

| [7] |

顾清华, 骆家乐, 李学现. 基于小生境的多目标进化算法. 计算机工程与应用, 2023, 59(1): 126-139. DOI:10.3778/j.issn.1002-8331.2207-0006 |

| [8] |

Huband S, Barone L, While L, et al. A scalable multi-objective test problem toolkit. Proceedings of the 3rd International Conference on Evolutionary Multi-criterion Optimization. Guanajuato: Springer, 2005. 280–295.

|

| [9] |

Schaffer JD. Some experiments in machine learning using vector evaluated genetic algorithms (artificial intelligence, optimization, adaptation, pattern recognition) [Ph.D. thesis]. Nashville: Vanderbilt University, 1985.

|

| [10] |

Srinivas N, Deb K. Multiobjective optimization using nondominated sorting in genetic algorithms. Evolutionary Computation, 1994, 2(3): 221-248. DOI:10.1162/evco.1994.2.3.221 |

| [11] |

Deb K, Pratap A, Agarwal S, et al. A fast and elitist multiobjective genetic algorithm: NSGA-II. IEEE Transactions on Evolutionary Computation, 2002, 6(2): 182-197. DOI:10.1109/4235.996017 |

| [12] |

Zhang QF, Li H. MOEA/D: A multiobjective evolutionary algorithm based on decomposition. IEEE Transactions on Evolutionary Computation, 2007, 11(6): 712-731. DOI:10.1109/TEVC.2007.892759 |

| [13] |

Cheng R, Jin YC, Olhofer M, et al. A reference vector guided evolutionary algorithm for many-objective optimization. IEEE Transactions on Evolutionary Computation, 2016, 20(5): 773-791. DOI:10.1109/TEVC.2016.2519378 |

| [14] |

Lin QZ, Li JQ, Du ZH, et al. A novel multi-objective particle swarm optimization with multiple search strategies. European Journal of Operational Research, 2015, 247(3): 732-744. DOI:10.1016/j.ejor.2015.06.071 |

| [15] |

Zitzler E, Künzli S. Indicator-based selection in multiobjective search. Proceedings of the 8th International Conference on Parallel Problem Solving from Nature. Birmingham: Springer, 2004. 832–842.

|

| [16] |

Bader J, Zitzler E. HypE: An algorithm for fast hypervolume-based many-objective optimization. Evolutionary Computation, 2011, 19(1): 45-76. DOI:10.1162/EVCO_a_00009 |

| [17] |

Yang SX, Li MQ, Liu XH, et al. A grid-based evolutionary algorithm for many-objective optimization. IEEE Transactions on Evolutionary Computation, 2013, 17(5): 721-736. DOI:10.1109/TEVC.2012.2227145 |

| [18] |

Tian Y, Zhang XY, Cheng R, et al. Guiding evolutionary multiobjective optimization with generic front modeling. IEEE Transactions on Cybernetics, 2020, 50(3): 1106-1119. DOI:10.1109/TCYB.2018.2883914 |

| [19] |

Li MQ, Yang SX, Liu XH. Diversity comparison of Pareto front approximations in many-objective optimization. IEEE Transactions on Cybernetics, 2014, 44(12): 2568-2584. DOI:10.1109/TCYB.2014.2310651 |

| [20] |

Tian Y, Si LC, Zhang XY, et al. Evolutionary large-scale multi-objective optimization: A survey. ACM Computing Surveys, 2022, 54(8): 174. |

| [21] |

Jian JR, Zhan ZH, Zhang J. Large-scale evolutionary optimization: A survey and experimental comparative study. International Journal of Machine Learning and Cybernetics, 2020, 11(3): 729-745. DOI:10.1007/s13042-019-01030-4 |

| [22] |

Potter MA, De Jong KA. A cooperative coevolutionary approach to function optimization. Proceedings of the 3rd Conference on Parallel Problem Solving from Nature. Jerusalem: Springer, 1994. 249–257. [doi: 10.1007/3-540-58484-6_269]

|

| [23] |

Antonio LM, Coello CAC. Use of cooperative coevolution for solving large scale multiobjective optimization problems. Proceedings of the 2013 IEEE Congress on Evolutionary Computation. Cancun: IEEE, 2013. 2758–2765. [doi: 10.1109/CEC.2013.6557903]

|

| [24] |

Omidvar MN, Li XD, Yang ZY, et al. Cooperative co-evolution for large scale optimization through more frequent random grouping. Proceedings of the 2010 IEEE Congress on Evolutionary Computation. Barcelona: IEEE, 2010. 1–8. [doi: 10.1109/CEC.2010.5586127]

|

| [25] |

Omidvar MN, Li XD, Yao X. Cooperative co-evolution with delta grouping for large scale non-separable function optimization. Proceedings of the 2010 IEEE Congress on Evolutionary Computation. Barcelona: IEEE, 2010. 1–8.

|

| [26] |

Li XD, Yao X. Cooperatively coevolving particle swarms for large scale optimization. IEEE Transactions on Evolutionary Computation, 2012, 16(2): 210-224. DOI:10.1109/TEVC.2011.2112662 |

| [27] |

Omidvar MN, Li XD, Mei Y, et al. Cooperative co-evolution with differential grouping for large scale optimization. IEEE Transactions on Evolutionary Computation, 2014, 18(3): 378-393. DOI:10.1109/TEVC.2013.2281543 |

| [28] |

Ma XL, Liu F, Qi YT, et al. A multiobjective evolutionary algorithm based on decision variable analyses for multiobjective optimization problems with large-scale variables. IEEE Transactions on Evolutionary Computation, 2016, 20(2): 275-298. DOI:10.1109/TEVC.2015.2455812 |

| [29] |

Zhang XY, Tian Y, Cheng R, et al. A decision variable clustering-based evolutionary algorithm for large-scale many-objective optimization. IEEE Transactions on Evolutionary Computation, 2018, 22(1): 97-112. DOI:10.1109/TEVC.2016.2600642 |

| [30] |

Zille H, Ishibuchi H, Mostaghim S, et al. A framework for large-scale multiobjective optimization based on problem transformation. IEEE Transactions on Evolutionary Computation, 2018, 22(2): 260-275. DOI:10.1109/TEVC.2017.2704782 |

| [31] |

He C, Li LH, Tian Y, et al. Accelerating large-scale multiobjective optimization via problem reformulation. IEEE Transactions on Evolutionary Computation, 2019, 23(6): 949-961. DOI:10.1109/TEVC.2019.2896002 |

| [32] |

He C, Cheng R, Yazdani D. Adaptive offspring generation for evolutionary large-scale multiobjective optimization. IEEE Transactions on Systems, Man, and Cybernetics: Systems, 2022, 52(2): 786-798. DOI:10.1109/TSMC.2020.3003926 |

| [33] |

Tian Y, Zhang XY, Wang C, et al. An evolutionary algorithm for large-scale sparse multiobjective optimization problems. IEEE Transactions on Evolutionary Computation, 2020, 24(2): 380-393. DOI:10.1109/TEVC.2019.2918140 |

| [34] |

Yildirim O, Baloglu UB, Tan RS, et al. A new approach for arrhythmia classification using deep coded features and LSTM networks. Computer Methods and Programs in Biomedicine, 2019, 176: 121-133. DOI:10.1016/j.cmpb.2019.05.004 |

| [35] |

宁安安, 张俊, 年梅. 基于自编码器的网络游戏流量分类. 计算机系统应用, 2023, 32(7): 113-120. DOI:10.15888/j.cnki.csa.009158 |

| [36] |

Rui T, Zhang S, Ren TW, et al. Data Reconstruction based on supervised deep auto-encoder. Proceedings of the 18th Pacific-Rim Conference on Multimedia Information Processing. Harbin: Springer, 2018. 869–879.

|

| [37] |

卢学明, 于在川, 许升起. 基于深度生成模型的煤矿运输皮带异物检测. 计算机系统应用, 2022, 31(5): 358-363. DOI:10.15888/j.cnki.csa.008468 |

| [38] |

贾文娟, 张煜东. 自编码器理论与方法综述. 计算机系统应用, 2018, 27(5): 1-9. DOI:10.15888/j.cnki.csa.006336 |

| [39] |

李二超, 陈瑞婷. 基于变异算子和邻域值自适应的MOEA/D算法. 计算机工程与应用, 2019, 55(9): 49-55. DOI:10.3778/j.issn.1002-8331.1808-0028 |

| [40] |

Qin AK, Suganthan PN. Self-adaptive differential evolution algorithm for numerical optimization. Proceedings of the 2005 IEEE Congress on Evolutionary Computation. Edinburgh: IEEE, 2005. 1785–1791. [doi: 10.1109/CEC.2005.1554904]

|

| [41] |

Cheng R, Jin YC, Olhofer M, et al. Test problems for large-scale multiobjective and many-objective optimization. IEEE Transactions on Cybernetics, 2017, 47(12): 4108-4121. DOI:10.1109/TCYB.2016.2600577 |

| [42] |

Deb K, Thiele L, Laumanns M, et al. Scalable multi-objective optimization test problems. Proceedings of the 2002 Congress on Evolutionary Computation. Honolulu: IEEE, 2002. 825–830. [doi: 10.1109/CEC.2002.1007032]

|

| [43] |

Tian Y, Cheng R, Zhang XY, et al. PlatEMO: A MATLAB platform for evolutionary multi-objective optimization [Educational Forum]. IEEE Computational Intelligence Magazine, 2017, 12(4): 73-87. DOI:10.1109/MCI.2017.2742868 |

| [44] |

van Veldhuizen DA. Multiobjective evolutionary algorithms: Classifications, analyses, and new innovations [Ph.D. thesis]. Dayton: Air Force Institute of Technology, 1999.

|

| [45] |

Schott JR. Fault tolerant design using single and multicriteria genetic algorithm optimization [Master’s thesis]. Cambridge: Massachusetts Institute of Technology, 1995.

|

2024, Vol. 33

2024, Vol. 33