部分线性模型兼具参数模型和非参数模型之长, 以其灵活性著称. 自从Engle等[1]首次提出该模型用于描述城市气候对电力消耗的影响以来, 已获得众多学者关注, 涌现出大量相关研究[2–4]. 样条方法[5]、分段多项式近似方法[6], 以及缺失数据的情况[7–9]等, 都已被纳入这一模型的讨论中. 这些工作极大丰富了部分线性模型的理论和实践应用. 然而, 它们并未考虑大数据应用的两个重大挑战: 计算时间和数据存储. 尤其在数据流场景下, 随着数据的不断积累, 存储需求激增, 每次新数据收集之后都需要对整个数据集重复进行统计分析. 冗杂的计算过程和过高的计算成本, 使得部分线性模型的传统估计计算方法变得不切实际.

近年来, 大数据模型的分析主要遵循3种方法. 第1种是子采样方法(subsampling-based)[10–14], 该方法在回归模型中得到有效应用, 能有效处理大多数大数据场景. 然而, 经过子抽样获得的有限样本可能会遗漏关键信息, 导致估计不准确; 第2种方法是分治集成法[15–18](divide-and-conquer), 其主要思路是将大数据集划分为若干子集从而把问题化繁为简. 例如, 在部分线性模型研究中, Zhao等[19]提出的集成核岭回归方法、Lian等[20]基于分治集成的投影样条方法. 然而分治集成法和子采样法均依赖于完整数据集, 在现实问题中, 大数据的完整收集通常需要漫长的等待时间. 如果是数据流形式的大数据, 数据更是持续生成而不会停止.

除了前面提到的两种方法, 第3种用于处理大数据模型的方法就是顺序更新法 (sequential-updating). 该方法特别适用于数据流, 因为它能够实时分析, 无需大量存储. 本文后面内容将这种方法称作在线估计方法, 英文写作“ONLINE”, 以区别于每次需要使用所有原始数据重新运行分析的传统方法, 把传统方法写作“OFFLINE”. 近年来关于在线估计方法的研究多见于线性回归模型[21–24], 对于非参数回归模型, Kong等[25]提出了一种基于核回归的在线估计方法, 并将其扩展到变系数模型. 由于部分线性模型是一种特殊的变系数模型, 所以也能勉强算作一种部分线性模型的在线估计方法. 然而该方法是根据每一个新到数据点更新估计, 并且基于协变量固定在某点处进行在线计算. 如果使用这种方法处理部分线性模型, 需要假设变系数模型的某些函数项为常数以作为部分线性模型的参数

本文旨在解决将部分线性模型应用于大数据流时遇到的分析挑战. 为此提出了一种基于部分线性模型两步估计方法的在线更新估计方法. 与以往的研究不同, 本文方法在更新估计参数时不需要考虑选取协变量为合适的给定值. 对于非线性部分, 本文基于Nadaraya-Watson回归和局部线性核回归给出两个在线更新估计量. 通过对线性部分和非线性部分的分开估计从而完成了整个部分线性模型的在线估计. 本文的方法以数据块为单位进行处理, 仅利用当前数据和每次更新的一些汇总统计量, 从而确保了每次更新计算时间的基本一致. 与OFFLINE方法相比, 该方法不会因总样本量的增加而导致计算时间和存储需求的不断增加, 因此在计算效率和成本控制方面具有明显优势.

1 部分线性模型与其大数据估计计算问题本节首先给出本文研究的对象, 即部分线性模型, 然后再阐述传统方法在数据流场景下所面临的计算难题.

1.1 部分线性模型假设有n个i.i.d.随机样本

| yi=x⊤iβ+g(zi)+εi,i=1,⋯,n | (1) |

其中, 协变量

考虑样本以数据流的形式依次独立被收集, 根据Li[26]的参数估计方法, 有:

| ˆβ=[n∑i=1˜xi˜x⊤iˆf2i]−1n∑i=1˜xi˜yiˆf2i | (2) |

其中,

式(2)的传统方法在数据流场景下的计算问题在于, 每次新数据的到来, 使用式(2)进行更新计算

考虑流数据以数据块的形式依次独立被收集, 则式(1)的模型改写为:

| yl=Xlβ+g(Zl)+εl,l=1,2,⋯ | (3) |

其中, 样本矩阵

本节将详细介绍针对式(3)的模型而设计的在线估计方法, 以解决第1节中传统方法带来的问题. 该方法基于两步估计过程, 首先是对模型参数部分的在线估计, 这一步骤涉及对模型中的参数进行动态更新. 然后是非参数部分的在线估计, 给出基于局部核回归的具体计算过程以及带宽的选取方式.

2.1 参数部分的在线更新估计当第k个数据块到达时, 单独使用该样本子集对参数获得一个估计

| ˆβk,nk=(˜X⊤kWk˜Xk)−1(˜X⊤kWk˜yk) | (4) |

其中,

| ˜βk=(Vk−1+˜X⊤kWk˜Xk)−1(Vk−1˜βk−1+˜X⊤kWk˜Xkˆβk,nk) | (5) |

其中,

式(5)的在线估计量

值得注意的是, 在普通最小二乘(OLS)估计中, 通常假设设计矩阵是列满秩的. 同样, 在式(4)和式(5)中也需要确保可逆性假设. 然而式(4)可以给出另一种表达形式

两步估计法通过用估计结果替换部分线性模型的参数部分, 从而将模型简化成非参数回归估计. 因此, 本文方法第2步的目标是对非参数部分进行在线更新估计, 即估计

为简化处理, 这里首先定义几个重要的汇总统计量, 旨在有效压缩并准确概括截止至时间点k的累积数据集信息. 具体定义如下所示:

| Gk(z,y)=k∑l=1nl∑m=1Khl(zl,m−z)yl,m | (6) |

| Gk(z,X)=k∑l=1nl∑m=1Khl(zl,m−z)xl,m | (7) |

以及

| Gk(z)=k∑l=1nl∑m=1Khl(zl,m−z) | (8) |

其中, 符号

通过这些汇总统计量, 结合第2.1节得到的参数估计

| ˆgk(z|˜βk)=Gk(z,y)−G⊤k(z,X)˜βkGk(z) | (9) |

式(9)所采用的在线估计方法与第2.1节式(5)的参数估计更新方法存在细微差别. 具体地, 式(5)通过保留前一时刻的估计值

为了下文清晰地阐述, 记

| Sk(z,y)=1Nkk∑l=1Z⊤l(z)Ωl(z)yl | (10) |

| Sk(z,X)=1Nkk∑l=1Z⊤l(z)Ωl(z)Xl | (11) |

以及

| Sk(z)=1Nkk∑l=1Z⊤l(z)Ωl(z)Zl(z) | (12) |

其中,

| ˜gk(z|˜βk)=e⊤[Sk(z)]−1[Sk(z,y)−Sk(z,X)˜βk] | (13) |

其中,

在核密度估计和核回归中, 带宽的选择显著影响估计的效果. 因此, 在处理部分线性模型中的X对Z的回归, y对Z的回归, 以及非参数成分对Z的回归时, 选择合适的带宽参数尤为关键. 为了提高估计精度, 本文的方法为每个数据子集中的参数和非参数部分各自使用不同的带宽. 具体地, 在子数据集不大的情况下采用CV (cross-validation)方法[27], 而对规模较大的子数据集采用DPI (direct plug-in)方法[28].

3 数值模拟本节是数值模拟实验部分, 目的是验证本文提出的在线估计方法的有效性, 并与OFFLINE方法的估计结果进行数值对比分析.

3.1 随机数生成实验所用随机数据根据式(1)的部分线性模型生成. 协变量z为一维情况下, 设真实函数

Case 1:

Case 2:

Case 3: 设定函数

每种情形都重复实验

在所有模拟计算中, 本文使用高斯核函数进行核估计. 由于涉及的部分子数据集样本量较大, 计算全程采用DPI法选取带宽. 所有实验均在配备16 GB RAM的Intel Core i5-8265U CPU上完成.

3.3 评估指标为了评估在线估计方法和传统方法在参数

| MSE(⌣β)=s−1∑si=1(⌣βi−β)2 | (14) |

其中,

对于非参数部分, 本文在100个评估点上进行计算, 所以其评估指标MSE计算为:

| MSE(⌣g)=∑100i=1(⌣g(ti)−g(ti))2/100 | (15) |

其中,

(1) 计算时间对比

表1和表2分别列出了在线估计方法和传统方法的平均计算时间, 其中ONLINE列的时间表示的是在线方法单次更新估计的计算耗时, OFFLINE列代表传统方法更新估计的计算耗时, “LCR”和“LLR”分别代表基于局部常数核回归和局部线性核回归的在线估计方法. 表1和表2的结果表明本文的方法比起OFFLINE方法显著减少单次更新耗时: ONLINE方法更新参数

| 表 1 固定总样本量NK, 改变子样本量n时ONLINE方法和OFFLINE方法的计算时间对比(s) |

| 表 2 改变总样本量NK, 固定子样本量n时ONLINE方法和OFFLINE方法的计算时间对比(s) |

(2)

表3和表4和分别展示了使用ONLINE方法和OFFLINE方法估计

| 表 3 固定总样本量NK, 改变子样本量n时ONLINE方法和OFFLINE方法对参数估计的Bias (10−3), SE (10−3), MSE (10−4) |

| 表 4 改变总样本量NK, 固定子样本量n=1000时ONLINE方法对参数估计的Bias (10−3), SE (10−3), MSE (10−4) |

|

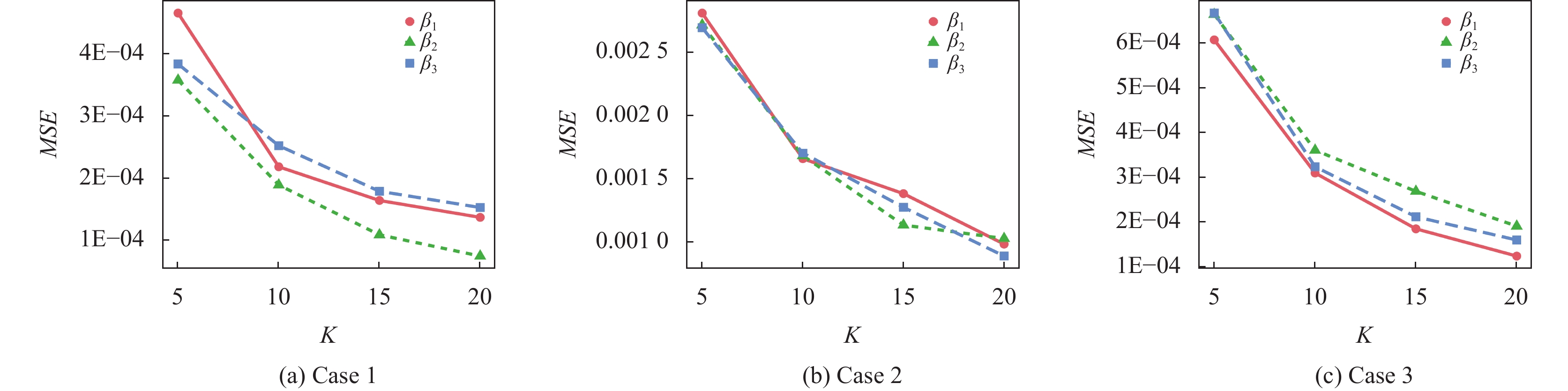

图 1 子样本量n=1000时, ONLINE方法参数估计的MSE随更新次数K变化趋势 |

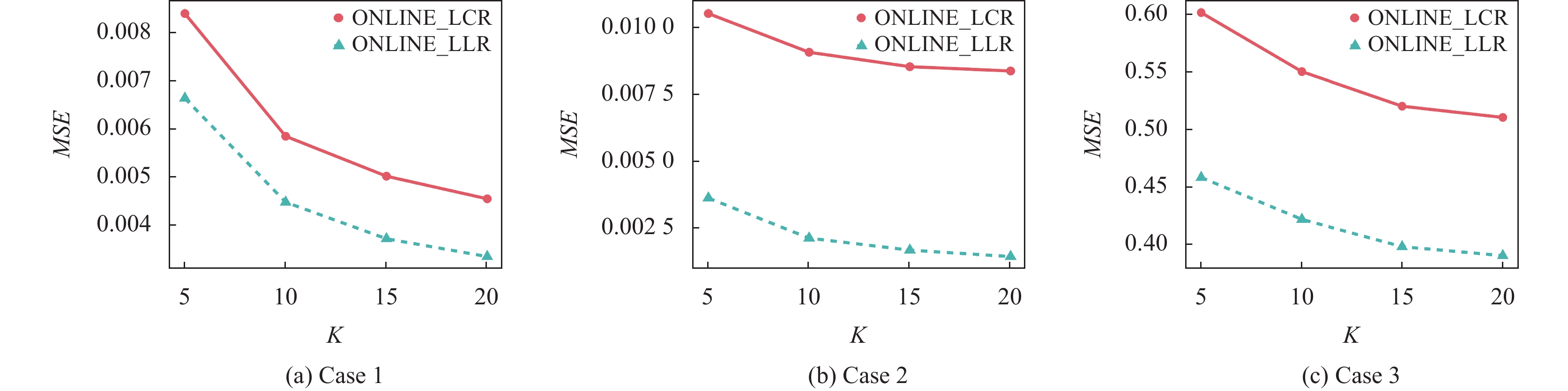

(3) 函数

表5和表6给出了两种方法对非参数部分估计的实验结果. 表中列出100次重复实验的偏差平方、方差以及经验均方误差的平均值. 尽管在线估计量的偏差平方大多略高于OFFLINE方法, 但其值仍然较低. 此外, 估计结果的方差均低于OFFLINE方法. 结果表明, 更大的单位子样本量虽然有助于减少偏差, 但是会导致方差的增大. 而在相同的单位子样本量下, 随着更新次数的增加, 偏差平方和方差都有所降低. 总体而言, 本文的在线方法通过多次更新, 能够逐渐降低估计非参数部分的MSE, 如图2所示. 值得注意的是, 在实验的所有情形中, 基于LLR的在线估计方法相较于基于LCR的在线估计方法具有更低的MSE, 其在经验均方误差上的表现更接近于OFFLINE方法, 表明在偏差和方差之间的平衡上, 该方法具有更好的控制性能.

|

表 5 固定总样本量NK, 改变子样本量n时ONLINE和OFFLINE方法对函数 |

|

表 6 改变总样本量NK, 固定子样本量n=1000时ONLINE方法对函数 |

|

图 2 子样本量n=1000时, ONLINE方法对非参数部分估计的MSE随更新次数K变化趋势 |

图3进一步展示Case 1 和Case 2中非参数部分估计的图形. 其中, 黑色实线表示真正的函数形式, ONLINE方法和OFFLINE方法的估计以不同颜色的圆点代表. 基于LCR的在线估计方法主要劣势在于拟合边界处表现出更多的边缘效应, 但其在内部点上的估计基本上接近OFFLINE方法的估计. 相比之下, 基于LLR的在线估计在边界和内部点上均表现优异, 几乎与传统方法的估计完全重叠. 图4展示了在Case 3中, 当z为二维时的估计图形, 其中, 蓝色“+”表示OFFLINE方法的估计, 红色圆点表示ONLINE方法的估计. 基于LCR和LLR的在线方法仍然表现出与OFFLINE方法几乎一致的估计结果.

综上所述, 通过考虑协变量之间的不同关系以及z为一维和二维情况下的模拟实验, 本文的方法不仅表现出估计准确性和稳定性, 同时相较于传统方法具有显著的计算效率优势.

|

图 3 当总样本量NK=20000, 子样本量n=1000时, ONLINE和OFFLINE方法对未知函数 |

|

图 4 当总样本量NK=10000, 子样本量n=1000时, ONLINE方法和OFFLINE方法对Case 3中未知函数的逐点估计 |

4 实际数据分析

本节应用本文的在线估计方法对我国劳动年龄人口的生活质量进行实际数据分析, 研究相关因素对生活质量的影响, 以及提高生活品质的可行途径.

4.1 数据预处理基于CGSS数据集, 本文采用2017年、2018年、2021年最近3次的调查数据以及时反映当下的社会情况, 聚焦于处于社会中流砥柱的劳动年龄人口, 根据国际标准将18–65岁年龄段的样本筛选出来. 进一步地, 将其中仍在上学阶段和已经离/退休的人群排除, 数据清洗后总共获得

(1) 因变量

由于本文关注的对象是现今劳动年龄群体的生活质量, 旨在真实反映人们的获得感、幸福感、安全感. 因此, 这里将主观生活质量综合指标设定为因变量. 该指标基于个体对身体健康、心理健康、幸福程度、社会地位和经济水平5个方面的自我评价构建而成, 分别对应于问卷中的A15、A17、A36、A43a和A43e项. 在此基础上, 将这些指标视为同等重要的变量. 鉴于A43a的原始数据采用十分制, 而其他变量采用的是五分制, 所以在计算中A43a项的权重调整为其他变量的一半. 特别地, 由于原始数据中A43e项将经济地位阶层由高到低标记为1–5, 所以本文将其重新赋值, 以1–5表示从低到高的经济地位. 通过采用min-max标准归一化处理5项变量加权求和的结果, 并将其转换为百分制以直观展示生活质量的综合得分, 使用记号“score”来表示该因变量.

相关变量的描述统计见表7, 频数分布见图5, 图示生活质量综合得分(score)的频数分布图总体呈现钟形分布, 生活质量极高与极低的频率均较低, 样本中大多数劳动年龄群体的生活质量集中在中等水平, 反映出样本总体的生活质量分布较为均衡.

| 表 7 生活质量综合指标相关变量的描述统计 |

(2) 解释变量

选择合适的解释变量, 对于分析影响生活质量的相关可能尤为重要, 所幸CGSS提供了全面广泛的社会信息. 本文通过对问卷回答的分析, 从人口属性、家庭环境、生活方式、工作环境、社会保障、经济收入6大因素来选择解释变量. 具体变量描述统计见表8, 并在图6展示变量之间的相关系数矩阵图.

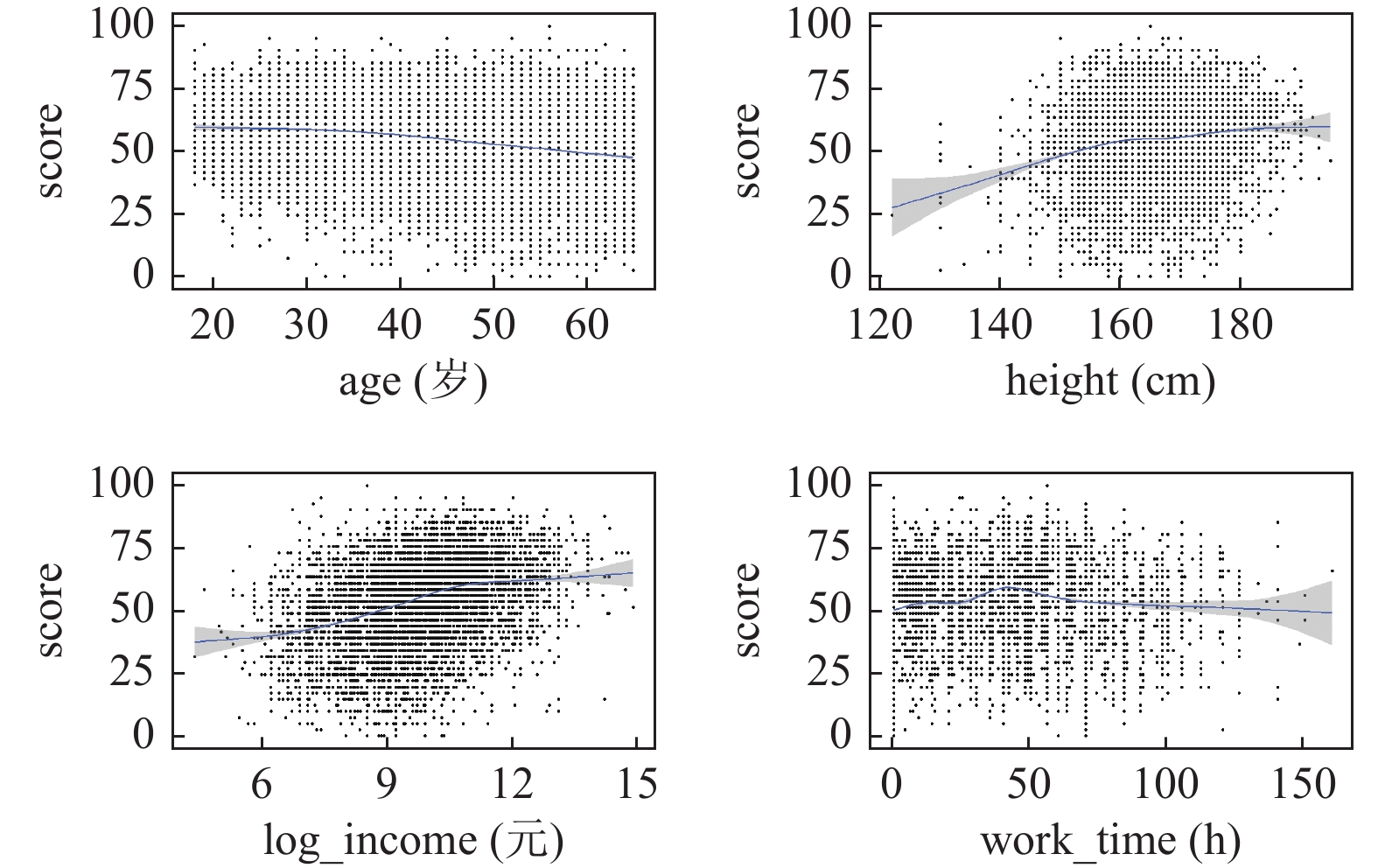

(3) 基本分析

首先, 本文通过图7的散点图辅助分析上述若干解释变量中的连续变量与因变量之间的关系: 其中, 变量age、height、log_income与score之间的散点图呈现出大体上的线性关系, 但在周工作时间与score的散点图上, 拟合曲线显示出不规则的波动, 表明工作时间与生活质量之间存在可能的非线性关系. 结合图6显示各变量之间的线性相关性较弱, 因此, 本文决定采用部分线性模型进行建模, 并将周工作时间作为模型中的非线性因素, 其余变量则纳入模型的线性部分进行分析.

|

图 5 生活质量综合指标相关变量的频数分布图 |

| 表 8 解释变量的描述统计 |

|

图 6 变量之间相关系数矩阵图 |

|

图 7 连续变量与因变量之间关系的散点图 |

其次, 考虑到部分变量是定序变量, 本文进一步对包括定序变量在内的相关变量与因变量之间的线性关系进行了逐一检验 (见表9). 结果表明, 除了bmi变量的线性影响不显著外, 其余变量的线性回归估计均通过了检验. 据此, 在后续的回归分析中, 本文将bmi变量通过哑变量处理后纳入模型, 而将其他的定序变量按原有的序列性质直接纳入模型的线性部分, 避免不必要的数据转换.

4.2 模型构建基于第4.1节的数据预处理, 本节将构建部分线性模型, 以准确反映各因素对生活质量的影响, 并应用先前提出的大数据在线估计方法进行分析. 模型以主观生活质量综合得分 (score) 作为响应变量, 选取周工作时间作为非线性部分的协变量. 对于模型的线性部分, 协变量X1表示年龄; X2表示为学历水平; X3表示为身高; 并将bmi变量转换为哑变量, 以身体质量正常组为对照组, X4、X5、X6和X7分别代表消瘦、过重、肥胖和过度肥胖组. 其他线性协变量包括: X8户口类别, X9婚姻状态, X10运动频率, X11社交频率, X12参与医保状态, 以及X13人均年家庭收入的对数.

| 表 9 各变量逐一与因变量的线性关系检验 |

视2017–2021年间3次问卷调查数据为流数据, 假设数据分批次到达, 单位子数据集样本量

(1) 参数部分估计结果

本文的在线估计方法进行更新计算35次后, 得到参数估计结果如表10所示.

| 表 10 模型参数的在线估计结果 |

表10的估计结果表明, 健康因素对生活质量的影响尤为显著. 与健康直接相关的变量, 如参与医保、适中的bmi指数、规律运动和社交活动均与生活质量显示出正相关性, 这些因素共同凸显了保持良好健康状况对于提高生活质量的重要性. 此外, 随着年龄的增长, 生活质量可能面临下降的风险, 社会支持和职场环境需更加关注中老年人群的特定需求, 如健康维护、职业培训及心理健康服务.

教育程度和婚姻状况对劳动年龄人口的生活质量呈正相关. 这在一定程度上说明, 提升教育水平和支持家庭稳定性不仅有助于促进个人职业发展和生活满意度的提高, 也有助于构建更和谐文明的社会环境.

而在经济因素上, 结果表现出与劳动年龄人口的生活质量密切相关. 家庭年收入的增加和城市户口直接关联到生活质量的提升. 推动经济发展是改善生活质量的有效途径, 但同时也需要重视资源公平分配, 确保所有群体尤其是低收入和边缘群体能够获得提升生活质量的机会.

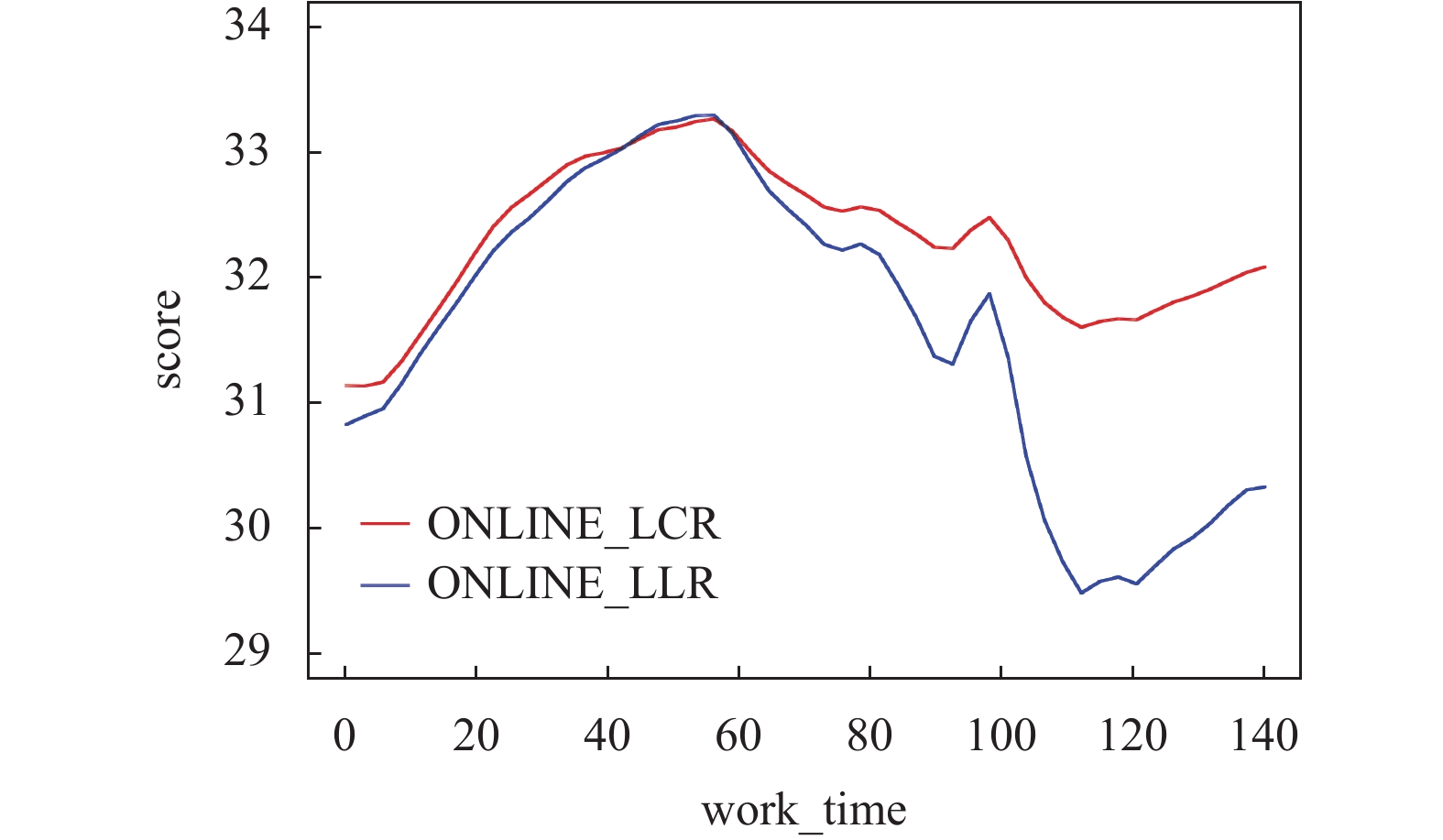

(2) 非参数部分估计结果

在非参数部分的估计结果如图8所示. 曲线趋势表明, 当周工作时间超过60 h, 生活质量开始显著下降, 而超过100 h后, 生活质量的下降幅度加剧, 呈现出明显的断崖式下跌. 这种趋势暗示长时间工作可能引发健康或家庭等方面的问题, 从而对生活质量产生负面影响. 另一方面, 当周工作时间少于30 h, 生活质量亦呈现下滑趋势, 这可能与经济收入减少、职业发展受限等因素有关.

|

图 8 周工作时间对生活质量 (score) 的影响曲线 |

而生活质量最高的群体是周工作时间在30–60 h之间的全职工作者. 一份稳定的全职工作不仅提供了必要的经济支持, 也带来了个人生活满意度的提升. 基于这一发现, 建议社会政策制定应关注失业和不完全就业的问题, 推广灵活且科学的工作时间配置, 以确保劳动者能够在保持生产力的同时, 享有足够的休息和个人时间, 创造一个健康、高效的工作环境.

5 总结本文提出了一种在线估计方法, 专为数据流场景下的部分线性模型而设计. 这一方法的核心优势在于其快速的计算能力和对数据存储需求的大幅降低, 有效地解决了部分线性模型大数据分析的重点难题. 经过数值模拟验证, 本文的方法展现了高效的计算能力, 并在均方误差方面的表现与传统方法相当, 是一种快速且有效的数据流计算方法, 为大数据时代下的部分线性模型分析提供了新的视角和工具.

| [1] |

Engle RF, Granger CWJ, Rice J, et al. Semiparametric estimates of the relation between weather and electricity sales. Journal of the American Statistical Association, 1986, 81(394): 310-320. DOI:10.1080/01621459.1986.10478274 |

| [2] |

Robinson PM. Root-N-consistent semiparametric regression. Econometrica, 1988, 56(4): 931-954. DOI:10.2307/1912705 |

| [3] |

Speckman P. Kernel smoothing in partial linear models. Journal of the Royal Statistical Society: Series B (Methodological), 1988, 50(3): 413-436. DOI:10.1111/j.2517-6161.1988.tb01738.x |

| [4] |

Auerbach E. Identification and estimation of a partially linear regression model using network data. Econometrica, 2022, 90(1): 347-365. DOI:10.3982/ECTA19794 |

| [5] |

Heckman NE. Spline smoothing in a partly linear model. Journal of the Royal Statistical Society: Series B (Methodological), 1986, 48(2): 244-248. DOI:10.1111/j.2517-6161.1986.tb01407.x |

| [6] |

Chen H. Convergence rates for parametric components in a partly linear model. The Annals of Statistics, 1988, 16(1): 136-146. DOI:10.1214/aos/1176350695 |

| [7] |

Wang QH, Linton O, Härdle W. Semiparametric regression analysis with missing response at random. Journal of the American Statistical Association, 2004, 99(466): 334-345. DOI:10.1198/016214504000000449 |

| [8] |

Liang H, Wang SJ, Robins JM, et al. Estimation in partially linear models with missing covariates. Journal of the American Statistical Association, 2004, 99(466): 357-367. DOI:10.1198/016214504000000421 |

| [9] |

Liang H, Wang S, Carroll RJ. Partially linear models with missing response variables and error-prone covariates. Biometrika, 2007, 94(1): 185-198. DOI:10.1093/biomet/asm010 |

| [10] |

Ma P, Mahoney MW, Yu B. A statistical perspective on algorithmic leveraging. The Journal of Machine Learning Research, 2015, 16(1): 861-911. |

| [11] |

Wang HY, Zhu R, Ma P. Optimal subsampling for large sample logistic regression. Journal of the American Statistical Association, 2018, 113(522): 829-844. DOI:10.1080/01621459.2017.1292914 |

| [12] |

Wang HY, Yang M, Stufken J. Information-based optimal subdata selection for big data linear regression. Journal of the American Statistical Association, 2019, 114(525): 393-405. DOI:10.1080/01621459.2017.1408468 |

| [13] |

Wang HY, Ma YY. Optimal subsampling for quantile regression in big data. Biometrika, 2021, 108(1): 99-112. DOI:10.1093/biomet/asaa043 |

| [14] |

Ma P, Chen YK, Zhang XL, et al. Asymptotic analysis of sampling estimators for randomized numerical linear algebra algorithms. The Journal of Machine Learning Research, 2022, 23(1): 177. |

| [15] |

Lin N, Xi RB. Aggregated estimating equation estimation. Statistics and Its Interface, 2011, 4(1): 73-83. DOI:10.4310/SII.2011.v4.n1.a8 |

| [16] |

Chen XY, Xie MG. A split-and-conquer approach for analysis of extraordinarily large data. Statistica Sinica, 2014, 24(4): 1655-1684. DOI:10.5705/ss.2013.088 |

| [17] |

吴梅红, 郭佳盛, 鞠颖, 等. 基于分层筛选和动态更新的并行选择集成算法. 计算机科学, 2017, 44(1): 48-52. DOI:10.11896/j.issn.1002-137X.2017.01.009 |

| [18] |

臧艳辉, 席运江, 赵雪章. 基于MapReduce的分治k均值聚类方法. 计算机工程与设计, 2020, 41(5): 1345-1351. DOI:10.16208/j.issn1000-7024.2020.05.022 |

| [19] |

Zhao TQ, Cheng G, Liu H. A partially linear framework for massive heterogeneous data. The Annals of Statistics, 2016, 44(4): 1400-1437. DOI:10.1214/15-AOS1410 |

| [20] |

Lian H, Zhao KF, Lv SG. Projected spline estimation of the nonparametric function in high-dimensional partially linear models for massive data. The Annals of Statistics, 2019, 47(5): 2922-2949. DOI:10.1214/18-AOS1769 |

| [21] |

Schifano ED, Wu J, Wang C, et al. Online updating of statistical inference in the big data setting. Technometrics, 2016, 58(3): 393-403. DOI:10.1080/00401706.2016.1142900 |

| [22] |

Lee J, Wang HY, Schifano ED. Online updating method to correct for measurement error in big data streams. Computational Statistics & Data Analysis, 2020, 149: 106976. DOI:10.1016/j.csda.2020.106976 |

| [23] |

Luo L, Song PXK. Renewable estimation and incremental inference in generalized linear models with streaming data sets. Journal of the Royal Statistical Society Series B: Statistical Methodology, 2020, 82(1): 69-97. DOI:10.1111/rssb.12352 |

| [24] |

Luo L, Song PXK. Multivariate online regression analysis with heterogeneous streaming data. Canadian Journal of Statistics, 2023, 51(1): 111-133. DOI:10.1002/cjs.11667 |

| [25] |

Kong EF, Xia YC. On the efficiency of online approach to nonparametric smoothing of big data. Statistica Sinica, 2019, 29(1): 185-201. DOI:10.5705/ss.202015.0365 |

| [26] |

Li Q. On the root-N-consistent semiparametric estimation of partially linear models. Economics Letters, 1996, 51(3): 277-285. DOI:10.1016/0165-1765(96)00821-X |

| [27] |

Härdle W, Liang H, Gao JT. Partially Linear Models. Berlin: Springer, 2000.

|

| [28] |

Ruppert D, Sheather SJ, Wand MP. An effective bandwidth selector for local least squares regression. Journal of the American Statistical Association, 1995, 90(432): 1257-1270. DOI:10.1080/01621459.1995.10476630 |

2024, Vol. 33

2024, Vol. 33