2. 呼伦贝尔农垦集团有限公司, 呼伦贝尔 021008;

3. 山东产业技术研究院智能计算研究院, 济南 250100

2. Hulun Buir Agricultural Reclamation Group Co. Ltd., Hulun Buir 021008, China;

3. Intelligent Computing Research Institute of Shandong Industrial Technology Research Institute, Jinan 250100, China

呼伦贝尔大河湾[1, 2]智慧农业模式可以将土地、作物、农机等众多资源要素整合, 使得原有分散种植方式转向统一集中种植方式, 形成了一种大面积、规模化的种植模式. 如今, 该智慧农业模式已经从单一的田间管理延伸到“耕、种、管、收”全流程覆盖. 其中, “管”是“耕、种、管、收”中最为重要的一环, 精准决策是“管”阶段的重要组成部分[3]. 而作物全生命周期的标准生长模型的建立是指导如何对作物精准决策的必要手段. 其具体解释为: 当作物实际生长模型与系统建立的标准生长模型不匹配时, 系统会及时感知作物所处外界环境的变化(如: 干旱、病虫害等), 从而进行精准决策. 而智能作物生育期识别是构建作物标准生长模型的重要技术之一. 因此, 在大河湾大面积、规模化种植形势下, 如何能够有效并及时地采集作物表型数据、识别作物生育期种类, 是一个亟待解决的重要问题.

在作物表型数据采集阶段, 国内采取了众多措施, 但是都比较单一, 局限性很强. 文献[4]设计了小型手持设备Crop Sense, 获取作物表型数据相对准确. 然而, 该技术存在时效性差且数据采集区域局限等问题. 文献[5]研究了智能柑橘巡检机器人, 提出了一种通过巡检机器人对柑橘果实表面信息进行获取的方式及计分方法. 文献[6]研究设计了新型作物表型监测机器人, 提出了能够进行轮距与监测平台高度调节的表型监测机器人总体设计方案. 文献[7]设计了一种4轮独立驱动、独立转向的田间作物表型检测平台, 并在采集过程中形成移动暗室, 有效降低外界环境对表型信息采集效果的影响. 虽然该技术获取的作物表型数据相对准确, 并节省人力成本. 但巡检机器人巡田的路径较为固定, 且巡田面积非常局限性, 对于较大面积的农田无法巡检全部区域. 为了改善数据采集局限性问题, 文献[8]设计了一套基于无人机的小麦生长信息获取系统, 该技术能够测量数以千计的田间小区的生长情况, 能够准确高效地评估小麦拔节期的生长情况. 文献[9]采用消费级无人机搭载数码相机用于小麦长势的快速无损监测, 在小麦各生长阶段均表现较好. 无人机巡检技术相对于巡检机器人来说采集范围更大、获得数据更多, 但是无人机巡检拍摄图像的清晰度不高, 一般只能拍摄到顶部, 拍摄的作物表型数据有限, 大大降低了后期作物生育期识别的准确性.

在作物生育期识别方面国内也有了一定的研究基础. 文献[10]针对目前设施农业数字化栽培调控技术中对作物的生育期实时检测与分类问题, 提出一种改进YOLOv4的温室环境下草莓生育期识别方法. 杨振忠等人[11]开展了基于机器学习结合植被指数阈值的水稻关键生育期识别的研究, 构建基于K近邻分类(K-nearest neighbor, KNN)算法的水稻生育期识别模型, 对无人机数据的识别准确率可达86.04%. 文献[12]利用更快速的基于区域的卷积神经网络(Faster R-CNN)方法对图像进行训练、分类, 构建枸杞开花期和果实成熟期的识别算法, 平均识别精度均值(mean average precision, mAP)达到74%. 文献[13]等利用卷积神经网络(convolutional neural network, CNN)进行训练, 对玉米雄穗进行识别进而对玉米抽雄期进行判识, 其识别率达到了99.42%. 通过上述可以得出当针对作物单一生育期识别时, 识别准确率很高. 然而, 在实际应用中, 系统需要对同一作物不同生育期进行识别, 传统算法由于训练种类较多会导致识别准确率大幅度下降. 因此, 目前来看系统整体识别的精确性和普适性还有提升的空间.

综上分析, 现针对大面积、规模化种植(如: 农垦、兵团等), 如何快速采集并识别作物生育期情况, 至今都没有一个标准化的解决思路, 国内也没有相关的非常成功的案例. 因此, 有必要探索出一套高精度、高时效的作物智能生育期识别系统. 该系统主要的赋能有: 首先能够建立及时准确的数据采集体系; 其次能够快速精准识别不同作物所处的生育期阶段. 基于此, 本文主要做的贡献如下.

(1)在数据采集阶段, 本文提出了一套完整的“空-地-人”一体化作物表型数据采集体系. 在该体系中, 将多种数据采集方式进行多源异构融合, 从而避免各个单一数据采集方式存在的缺陷.

(2)在数据识别阶段, 本文对神经网络模型结构进一步优化, 从而形成一种新颖的作物生育期识别体系.

1 智能作物生育期识别决策系统构建结合大河湾实际情况[1, 2], 黑土粮仓, 大河湾示范区青年突击队提出了一套完整的智能作物生育期识别系统. 该系统按照作物生育期识别顺序主要从以下3方面进行构建: (1) “空-地-人”一体化生育期数据采集体系. (2)物联网大数据多源异构云平台. (3)作物精准生育期识别体系. 下面分别对这3个方面进行详细介绍.

1.1 “空-地-人”一体化生育期数据采集体系在作物生育期数据采集阶段, 针对传统人工巡田或使用单一采集传感器存在采集时效性低、采集范围局限等问题, 本文综合利用各种技术手段, 提出了一套完整的“空-地-人”一体化作物生育期数据采集体系, 真正实现了时间、空间的有效交叉与融合. 该数据采集体系主要包括3方面: “空”“地”“人”. 下面将分别介绍各个方面所包含的采集设备以及技术组成.

1.1.1 “空”——无人机周期性巡检无人机系统的组成元素包括能量系统、数据传输系统、自动驾驶模块、相机传感器等. 在实际应用过程中, 切实依照需求与场景, 预先在无人机上搭载传感器装置, 全面采集作物生育期数据. 至于传感器, 在选择时要充分考虑无人机荷载能力及其对无人机产生的制约效果, 保证设备体积小、功耗低, 且安全性能良好. 无人机数据采集系统主要工作原理是: 借助北斗卫星导航定位以及惯性导航单元(IMU)等来实现按照既定路线开展自主飞行、自主避障以及自动路径修正, 同时借助RGB相机进行对作物周期性的数据采集, 并把数据传输到地面部分.

无人机系统的数据采集流程可分为以下几步: (1)前期准备工作(包括: 飞行频率设定、飞行申请、飞行条件评估、飞行区域调查等). (2)设定飞行路径, 依照数据影像要求完成周期性巡检. (3)数据获取阶段, 实时拍摄高清作物表型数据信息. (4)数据传输质量检测.

无人机巡检频率: 无人机巡检面积和周期的选择与实际地块作业面积以及无人机本身硬件性能有关, 比如, 本文在对系统实际验证时需要每台无人机在呼伦贝尔大河湾地区从播种到收获(5–11月)进行每周2次, 400亩地/次的周期性巡检. 因此, 无人机的巡检周期以及巡检面积可以针对实际作业任务及需求进行针对性设置, 本系统提出的作物表型数据采集体系具有一定的普适性.

无人机采样数据大小: 为保障无人机在巡检过程中系统能够对不同作物或者相同作物不同生育期的精准识别, 我们要求无人机拍摄的图片应具有高特征信息及高分辨率的特点. 因此, 为满足无人机拍摄图片的质量要求, 我们对不同作物或者相同作物在不同生育期设定的无人机飞行高度做了系统性测试. 以呼伦贝尔大河湾地区玉米生育期数据采集为例, 我们通过无人机对玉米不同生育期进行实际航拍, 以航拍图片具有高特征信息及高分辨率为评价准则, 根据专业农艺知识的指导, 系统性的总结出大河湾地区玉米不同生育期无人机所采取的最大飞行高度, 如表1所示. 在实际应用中, 我们将无人机在玉米任意生育期都能拍摄到高特征信息及高分辨率的图片以及无人机实际飞行的安全高度作为评价指标, 最终选择无人机的巡检高度为15 m. 另外, 我们选择每台无人机一亩地采集一张照片, 因此每次巡检采集照片总量为400张. 相同高度无人机采集的单张照片大小也会存在一定差异(与摄像头硬件性能有关), 但在实际应用中一般稳定在10 MB以下.

| 表 1 呼伦贝尔大河湾地区玉米生育期航拍高度(m) |

虽然无人机数据采集技术能够提供大量的作物表型信息, 作业效率高、节省人力成本, 但是无人机巡检拍摄图像的清晰度不高, 一般只能拍摄到顶部, 拍摄的作物部位受限, 大大降低了后期生育期识别的准确性.

1.1.2 “地”——固定物候相机+巡检机器人实时监测固定物候相机主要包括CCFC光学摄像机、无线网络传输设备、太阳能板等部件组成. 其中, CCFC光学摄像机是专门为远程观测室外应用设计的高质量, 高分辨率户外变焦视频和静态图像摄像机. 因此, 本系统主要采用该摄像机输出的RGB图像对作物生育期表型情况进行数据采集. 在大田内安装完毕之后, 每个固定物候相机采样点从播种到收获(5–11月)对附近作物以1次/天的频率进行实时数据收集, 每次分4个角度进行拍摄, 因此每次采集照片总量为4张. 通过以上手段来达到对附近作物表型信息短周期、高精度的数据采集. 在实际应用中固定物候相机单张图片大小一般为10 MB以下.

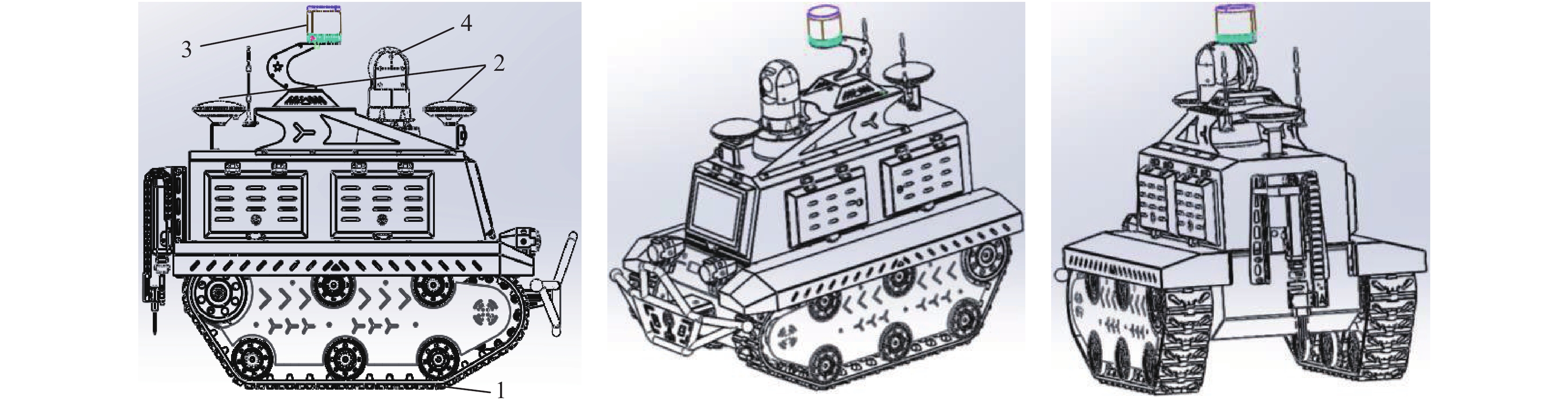

巡检机器人能够监测不同地块作物的表型数据, 如图1所示是本团队自主研发的智能巡检机器人. 图中智能机器人主要包含的硬件部分有: (1)双履带式底盘、(2)北斗卫星接收器、(3)激光雷达、(4)球型相机. 所有的组成部件都有与技术条件相一致的出厂合格证. 首先, 双履带式底盘是保证机器人能够在恶劣地形下稳定行驶的必要条件, 表2给出了底盘的相关参数信息. 第二, 该机器人在田间行驶时, 主要由北斗卫星定位模块进行定位, 并且定位精度稳定在3 cm左右. 第三, 当机器人前方遇到障碍物时, 激光雷达模块会对障碍物信息进行监测, 同时避障系统启动, 使得机器人能够智能决策的绕过障碍物行驶. 第四, 当机器人到达作物附近时, 通过球型相机对作物表型数据进行实际高清拍摄. 通过上述一系列流程来达到巡检机器人对作物表型数据进行采集的目的.

|

图 1 智能巡检机器人 |

| 表 2 双履带式底盘相关参数 |

在实际应用中我们选择每台巡检机器人从播种到收获(5–11月)对400亩地进行3次/周的周期性巡检, 每次巡检时生育期图片信息采集点间隔为50 m, 因此每次巡检采集照片总量为41张(按地块周长). 当机器人到达作物附近时, 通过球型相机对作物表型数据进行实际高清拍摄, 单张图片大小一般为10 MB以下.

1.1.3 “人”——建立人工巡田制度由专人对田块进行随机或定时定向巡检, 以目视方式获取作物生育期所处阶段, 并及时采用手持图像采集设备收集不同部位、不同数量的图像数据.

本团队以400亩地块为例, 对应分配2名巡田员, 从播种到收获(5–11月)进行2次/周的全面巡查, 每次巡查点间隔为50 m, 每个巡查点不同角度采集3张照片, 因此每次巡检采集照片总量为318张(按地块面积). 每张照片信息都会按照专业农艺标准进行采集, 采集完毕都会及时进行图像数据的上传. 另外, 在实际应用中单张图片大小一般为10 MB以下. 人工巡田方式灵活度最高, 采集方式最多样, 信息把握最精准.

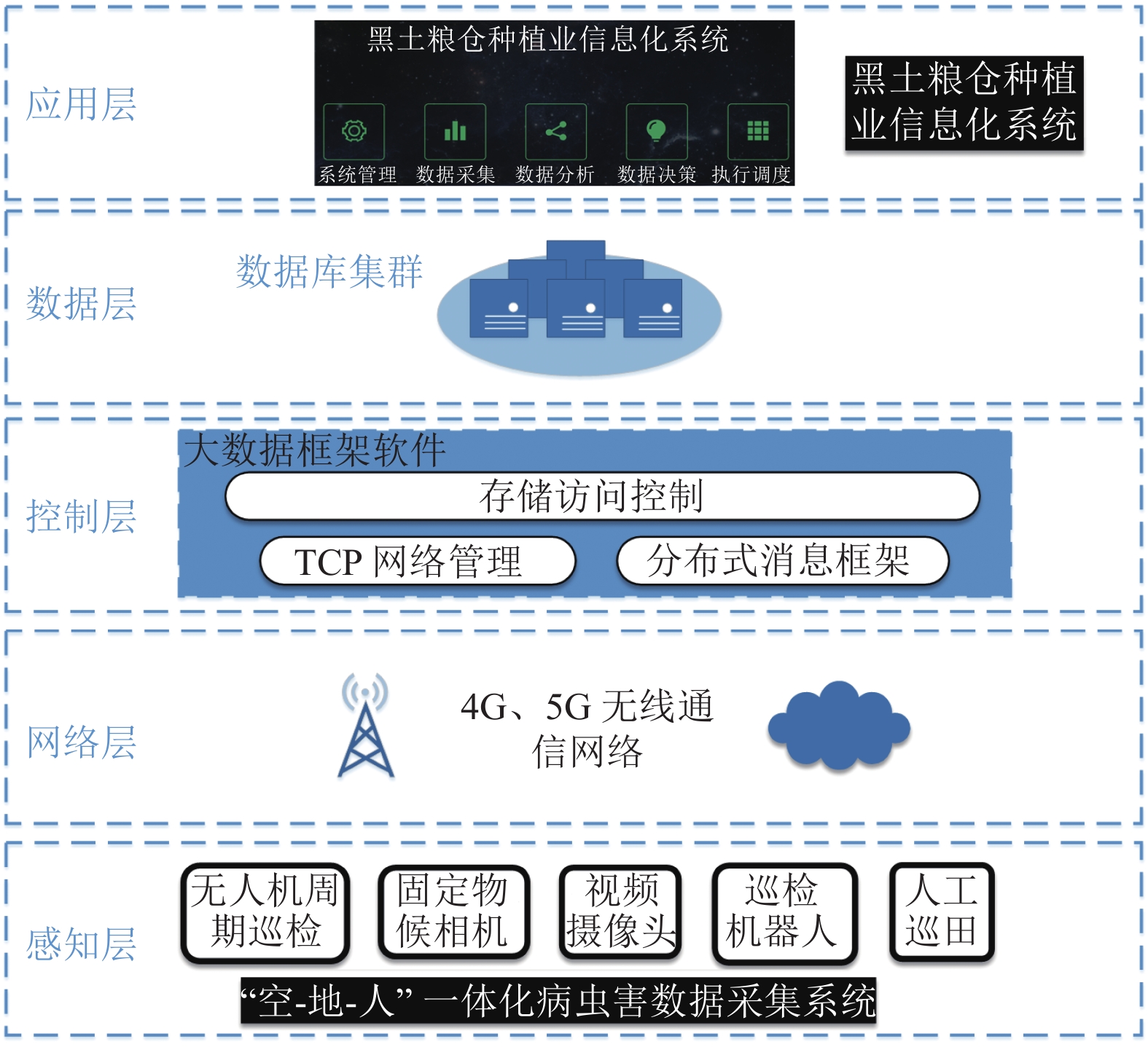

1.2 物联网大数据多源异构平台通过一体化数据采集体系将作物表型数据信息全方位的采集之后, 接下来需要将采集到的数据信息进行多源信息异构. 因此, 本系统使用了一种物联网大数据多源异构平台来实现这一目的. 多源信息异构平台架构如图2所示. 该系统自下而上按功能和执行主体, 分为感知层、网络层、控制层、数据层、应用层、客户端.

|

图 2 多源信息异构平台架构图 |

感知层: 由无人机航拍、巡检机器人、固定物候相机、视频摄像头等终端构成, 由这些设备完成对作物不同生育期表型的数据采集.

网络层: 基于4G、5G的无线通信网络.

现有无人机在飞行时不存在网络信号, 因此无人机在进行航拍时, 是暂时将拍摄的图片存在内存卡上, 拍摄完需要进行本地导出及后台上传. 由于无人机巡检时间较短, 因此该操作不会影响数据采集的实时性, 室内4G网络完全可以满足上传需求.

巡检机器人+固定物候相机+人工固定点拍摄: 通过第1.1节可以得出, 使用巡检机器人、固定物候相机、人工固定点拍摄时每张图片数据大小在10 MB以下. 另外, 本系统在进行实时后台传输过程中采用了无损图片压缩技术[14]对图片进行预处理, 可以将图片大小降低为6 MB以下. 同时, 为了保证实时性, 本系统在实际应用中需要在10 s时间内完成一张图片的完整传输过程, 因此, 一秒钟传输数据量为0.6 MB. 综上, 本系统需要满足的带宽为大于6 Mb/s[15]. 另外, 4G网络的上行速率为50 Mb/s, 因此本系统所需的带宽可以通过4G网络完全得到满足.

控制层: 由“大数据底层框架软件”提供的“TCP网络管理”和“消息队列”功能构成, 主要负责接收“感知层”设备上传的数据, 并对设备进行统一管理.

数据层: 基于Redis+MySQL企业级分布式数据存储以实现海量存储的目标, 并由“大数据底层框架软件”的“存储管理系统”对数据的存取进行控制, 以实现高并发、高扩展能力.

应用层: 黑土粮仓种植业信息化系统. 该系统是我们自主研发的针对黑土地保护相关的数据处理系统.

1.3 作物精准生育期识别体系将多传感器采集到的作物表型数据信息通过物联网大数据云平台进行多源异构之后, 接下来通过神经网络模块对不同作物生育期进行精准的分类识别. 另外, EfficientNetV2神经网络模型[16-18], 采用了新的网络模块Fused-MBConv, 通过渐进式学习策略使得训练更快. EfficientNetV1神经网络模型关注的是准确率、参数量以及 FLOPS, 而EfficientNetV2神经网络模型进一步关注模型的训练速度, 该模型相比EfficientNetV1在训练时间和推理时间上都有较大的优势. 因此, 本文提出的系统主要使用优化的EfficientNetV2神经网络算法对不同作物生育期进行智能识别分类. 另外, 本文针对大河湾示范区不同作物生育期分别收集了大量的表型数据作为数据集的一部分. 下面将详细介绍作物表型数据集选取规则.

本文的作物表型数据集主要选取的是大河湾地区典型代表作物: 玉米和大豆. 根据专业农艺知识的指导, 玉米生育期数据集共涵盖了出苗期、拔节期、小喇叭窗口期、大喇叭窗口期、抽穗期、开花期、吐丝期、乳熟期、蜡熟期、完熟期等共计10个玉米不同生育时期图片, 共5.23万张. 大河湾地区玉米生育期典型代表图如图3所示. 我们以地块400亩为例, 分别通过6个方面对作物表型数据信息进行收集.

|

图 3 大河湾地区玉米生育期典型代表图 |

(1)在呼伦贝尔大河湾地区采用多台无人机进行周期性巡检. 每台无人机从播种到收获(5–11月)进行每周3次, 400亩地/次的周期性航拍, 每台无人机一亩地采集一张照片, 每次巡检采集照片总量为400张/台.

(2)在呼伦贝尔大河湾地区架设多台固定物候相机进行作物生育期信息采集. 每台固定物候相机从播种到收获(5–11月)对附近作物以1次/天的频率进行实时数据收集, 每台相机每次分4个角度进行拍摄, 每次采集照片总量为4张/台.

(3)在呼伦贝尔大河湾地区部署多台巡检机器人进行周期性巡检. 每台机器人从播种到收获(5–11月)进行每周3次, 400亩地/次的周期性巡检, 每次巡检时生育期图片信息采集点间隔为50 m, 每次巡检采集照片总量为41张/台(按地块周长).

(4)采用人工巡田方法对不同作物生育期进行不同角度的拍摄. 每两人从播种到收获(5–11月)进行每周2次, 400亩地/次的全面巡查, 每次巡查点间隔为50 m, 每个巡查点不同角度采集3张照片, 每次巡检采集照片总量为318张(按地块面积).

(5)通过与中科院内相关单位如: 合肥物质研究院等科研院所合作来获取不同作物不同生育期的图片数据积累.

(6)基于中国气象局发布的中国主要农作物生长发育数据集(V2.0)[19]对本系统的精准识别体系进行训练样本的扩充.

通过以上6种手段可以保证本文提出系统所需数据集的数量和种类, 并且采集手段以及采集装备都经过专业的农艺指导, 在保证采集数量的同时也能很好的兼顾采集图片的质量. 另外, 本采集手段可以保证对模型数据集进行实时更新, 通过长时间的不间断数据采集来不断提高系统的识别精准性和鲁棒性, 起到正反馈的目的.

其次, 大豆生育期数据集共涵盖了出苗期、花期、开花结荚期、鼓粒期、成熟期等共计5个大豆不同生育时期图片, 共2.56万张(收集方式同上). 如图4(a)和图4(b)分别为大河湾地区大豆出苗期和鼓粒期(以这两种生育期为典型代表)表型图片.

|

图 4 大河湾地区大豆生育期典型代表图 |

数据集准备好之后, 接下来就是进行神经网络的训练. 然而, 在识别阶段由于无人机拍摄的作物表型数据信息与巡检机器人+固定物候相机+人工固定点拍摄的作物表型数据信息是不同的, 因此不能仅通过单一网络进行整体化训练. 基于此, 本文提出了一种基于作物生育期的两步识别模型. 首先, 建立整体地块的作物生育期识别模型. 采用无人机拍摄的作物表型数据信息并基于EfficientNetV2神经网络模型对整体地块的作物生育期数据进行训练, 将训练好的模型用于作物生育期“初判断”. 其次, 建立局部作物生育期识别模型. 采用巡检机器人周期性巡检+固定物候相机+人工巡田等技术拍摄的作物表型数据信息并基于EfficientNetV2神经网络模型对作物不同生育期数据进行精细化训练, 将训练好的模型用于作物生育期“再判断”.

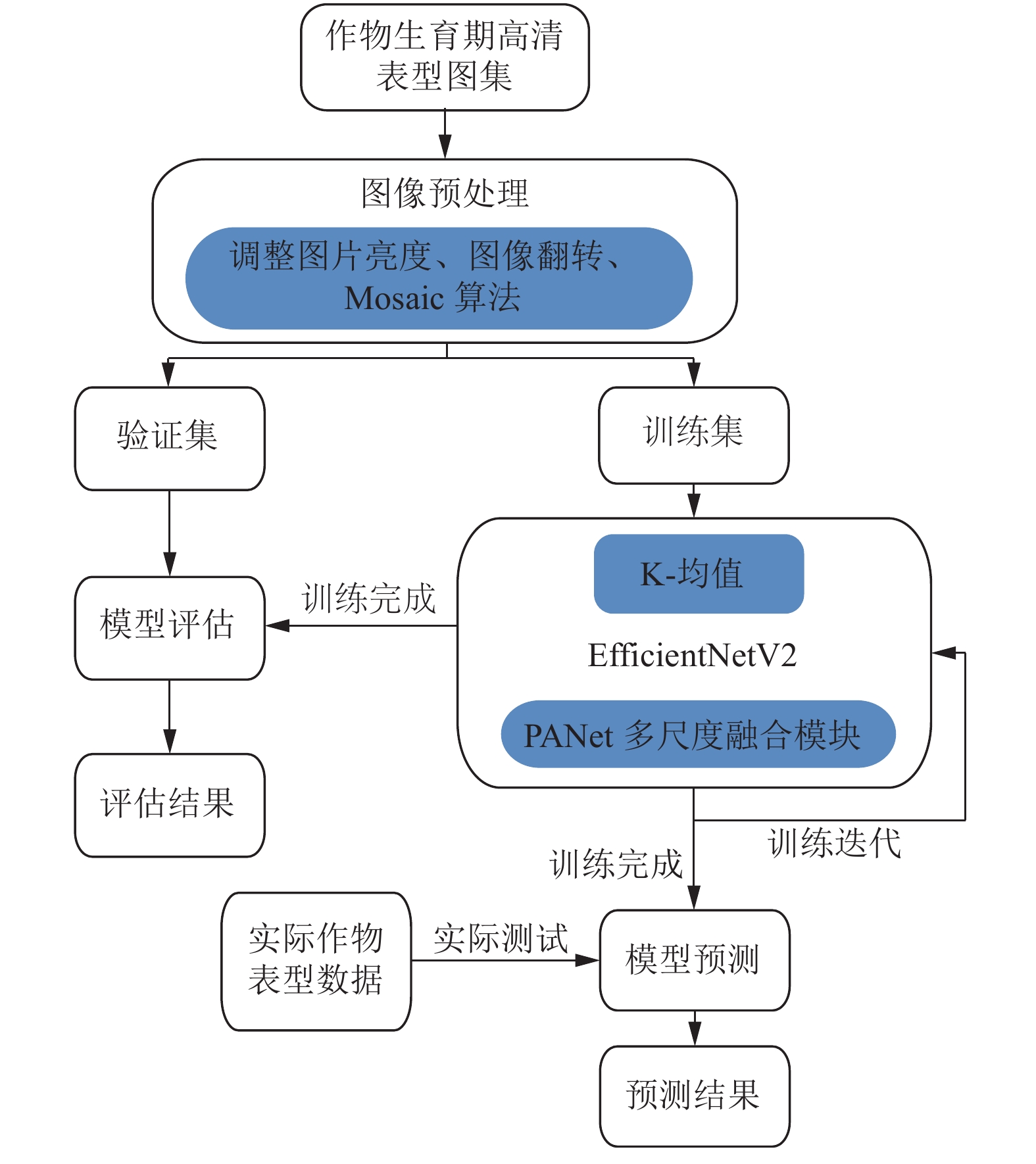

另外, 本文在传统EfficientNetV2神经网络基础上提出了一种优化EfficientNetV2神经网络的识别技术, 具体优化模型如图5所示. 首先, 在数据集准备阶段, 采用调整图片亮度、图像翻转以及马赛克(Mosaic)算法对数据集进行扩充和增强. 其次, 在神经网络训练阶段, 采用K-均值对训练锚框大小进行预处理, 使得训练速度和精确性更高. 最后, 引入PANet多尺度融合模块将主干网络和池化层输出的数据进行上采样和下采样的循环融合来提高先验框和真实框的交并比(inter-section over union, IoU).

|

图 5 优化EfficientNetV2神经网络模型 |

本文提出的基于作物生育期识别体系可以在保证检测实时性的同时大大提高检测的精准性和系统的鲁棒性.

2 实验效果分析本文提出的由“空-地-人”一体化生育期数据采集体系、物联网大数据多源异构云平台、作物精准生育期识别体系组成的一套完整的智能作物生育期识别系统已经在呼伦贝尔大河湾地区进行了真实环境中的部署验证, 并通过从软件到硬件体系的整体迭代升级, 使得系统可以支持实时的数据分析服务. 为了分析本文提出系统的稳定性和普适性, 接下来我们从神经网络作物生育期分类识别方面进行可视化验证.

在本实验中, 主要使用优化的EfficientNetV2神经网络对大河湾实际作物的生育期进行分类的效果分析. 不同作物对应的不同生育期训练标准在第1.3节已经详细描述. 另外, 神经网络选取的实验数据比例为: 训练集:测试集:验证集=7:2:1, 并且选择epoch=30, batch size = 60. 由于大河湾地区玉米、大豆为一般种植作物的典型代表, 因此本文主要对这两类作物进行分析.

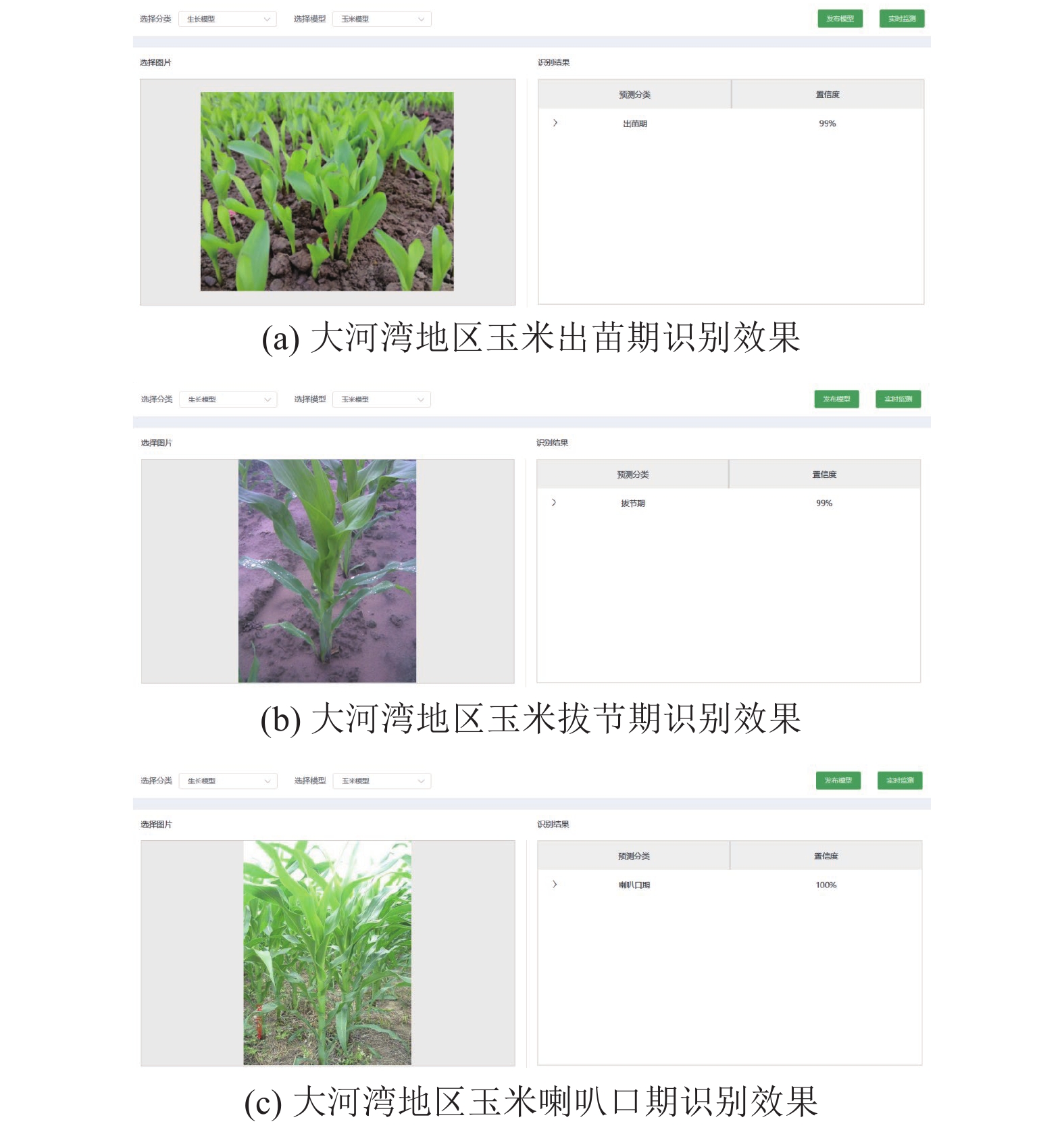

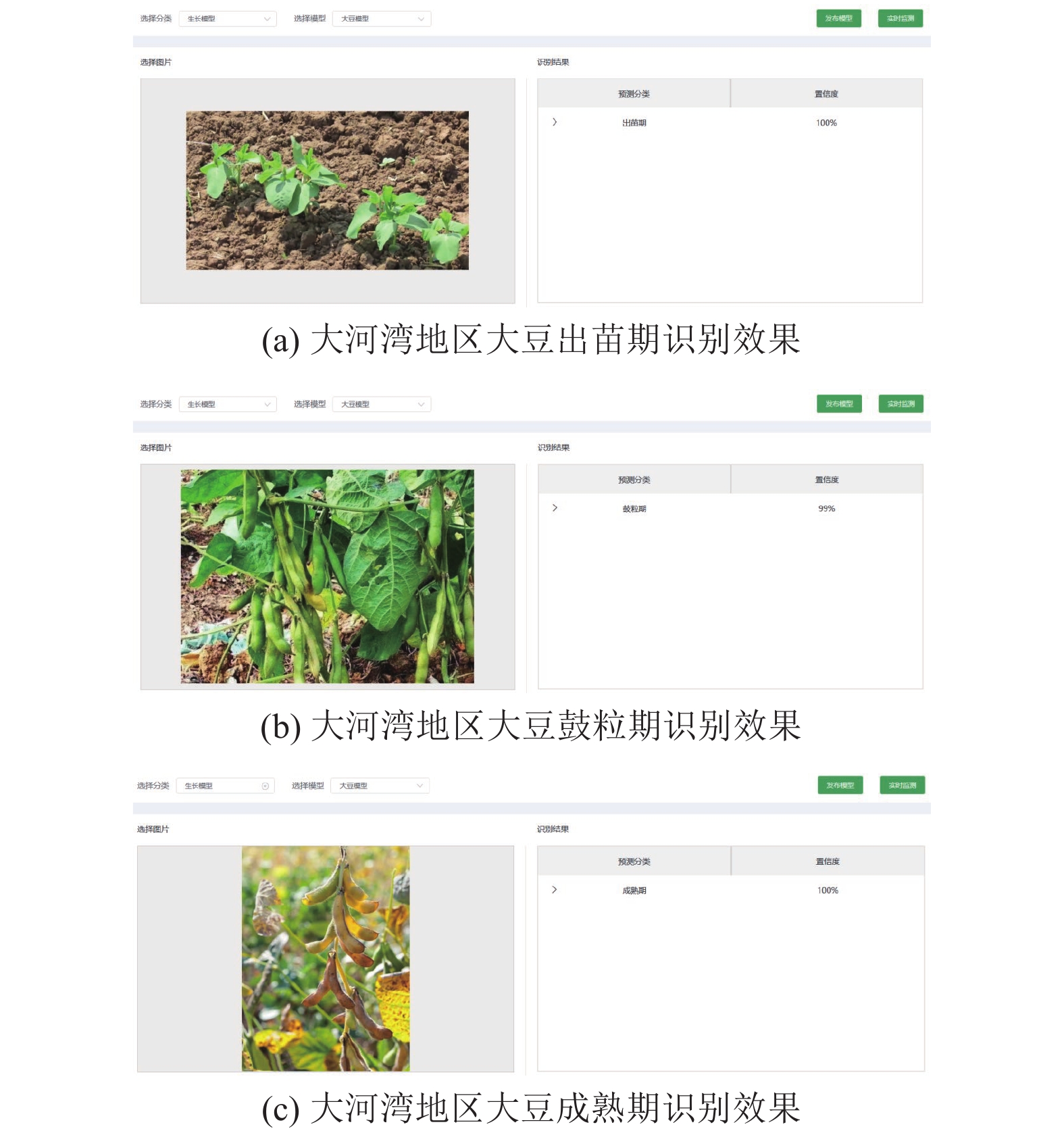

图6(a)、图6(b)和图6(c)分别表示为大河湾地区玉米在出苗期、拔节期和喇叭口期阶段(以这3个阶段为典型代表)的识别效果图. 由图6中可以看出, 系统在判断作物生育期阶段可以精准地对玉米生育期进行识别, 实际平均识别均值准确率为99%以上, 可以完全满足实际应用需求. 值得注意的是, 系统能产生这么高的识别准确率是由于不同生育期玉米表型数据差异较为明显, 从而使得神经网络分类效果明显. 图7(a)、图7(b)和图7(c)分别表示为大河湾地区大豆在出苗期、鼓粒期和成熟期阶段(以这3个阶段为典型代表)的识别效果图. 由图7中可以看出, 神经网络对于大豆不同生育期的表型数据依旧能发挥很好的分类效果, 并且实际平均识别均值准确率为99%以上, 可以完全满足实际应用需求. 综上分析, 本文提出的系统对大河湾地区的典型代表作物对应的不同生育期都可以进行高普适性和高准确性的识别. 该系统为后续作物全生命周期的标准生长模型的建立提供了重要依据.

|

图 6 大河湾地区玉米表型数据生育期识别分析 |

3 结论与展望

本文主要在呼伦贝尔大河湾地区大规模作物种植的形势下, 针对传统人工经验或使用单一传感器进行作物生育期识别的方式会导致识别的范围局限、时效性差的问题, 提出了一套高精度的快速智能作物生育期识别系统. 在实际应用中, 本文提出的系统将专业的农艺知识融入严谨的系统判定逻辑中, 完全避免了人工识别存在的弊端, 保障了大面积作物种植情况下生育期识别的精准性和时效性. 同时, 该系统在大河湾已经开始实验验证, 接下来应该进一步完善数据体系来扩大数据集, 同时优化网络结构来提高识别精准度. 另外, 未来随着系统长时间(比如在同一地区观测10年)的数据积累, 会不断统计出作物不同生育期周围环境对其长势的影响, 从而找出每个生育期最优的生长曲线, 以此来建立作物全生命周期的标准生长模型. 最终该标准模型用来对作物生长状况进行最佳决策. 该系统有助于推进大河湾地区智慧农业技术的发展, 为我国智慧农业的发展提供了一种全新的作物生育期识别体系.

|

图 7 大河湾地区大豆表型数据生育期识别分析 |

| [1] |

陈海华, 田林鑫. 构建黑土地保护“大河湾模式”. 中国农垦, 2022(3): 18-19. DOI:10.16342/j.cnki.11-1157/s.2022.03.009 |

| [2] |

孙凝晖, 张玉成, 王竑晟, 等. 农业模拟器: 用智能技术打通黑土地保护的数据流. 中国科学院院刊, 2021, 36(10): 1165-1174. DOI:10.16418/j.issn.1000-3045.20210810001 |

| [3] |

张绮雯, 林青宁, 毛世平. 国际视角下中国智慧农业发展的路径探寻. 世界农业, 2022(8): 17-26. DOI:10.13856/j.cn11-1097/s.2022.08.002 |

| [4] |

王娇娇, 徐波, 王聪聪, 等. 作物长势监测仪数据采集与分析系统设计及应用. 智慧农业, 2019, 1(4): 91-104. |

| [5] |

何宇. 巡检机器人全方位获取柑橘果实表面信息方法研究与试验[硕士学位论文]. 重庆: 重庆理工大学, 2020.

|

| [6] |

袁华丽. 作物表型监测机器人结构设计与实现[硕士学位论文]. 南京: 南京农业大学, 2019.

|

| [7] |

卢少志, 杨蒙, 杨万能, 等. 田间作物表型检测平台设计与试验. 华中农业大学学报, 2021, 40(4): 209-218. |

| [8] |

杨立国, 杨雅静, 常晓莲, 等. 基于无人机的小麦生长信息获取系统的设计与试验. 农机化研究, 2022, 44(7): 82-87. |

| [9] |

江杰, 张泽宇, 曹强, 等. 基于消费级无人机搭载数码相机监测小麦长势状况研究. 南京农业大学学报, 2019, 42(4): 622-631. |

| [10] |

龙洁花, 郭文忠, 林森, 等. 改进YOLOv4的温室环境下草莓生育期识别方法. 智慧农业(中英文), 2021, 3(4): 99-110. |

| [11] |

杨振忠, 方圣辉, 彭漪, 等. 基于机器学习结合植被指数阈值的水稻关键生育期识别. 中国农业大学学报, 2020, 25(1): 76-85. |

| [12] |

朱永宁, 周望, 杨洋, 等. 基于Faster R-CNN的枸杞开花期与果实成熟期识别技术一. 中国农业气象, 2020, 41(10): 668-677. |

| [13] |

李涛, 吴东丽, 胡锦涛, 等. 基于深度学习的玉米抽雄期判识. 电子测量技术, 2019, 42(11): 102-106. DOI:10.19651/j.cnki.emt.1802449 |

| [14] |

Yang L, Song XW, Hou CP, et al. A method of H.264-based still stereoscopic pictures compression. Proceedings of the 2006 Canadian Conference on Electrical and Computer Engineering. Ottawa: IEEE, 2006. 306–309.

|

| [15] |

Yang X, Feng G. Bandwidth reallocation for bandwidth asymmetry wireless networks based on distributed multiservice admission control. IEEE Transactions on Mobile Computing, 2008, 7(11): 1311-1324. DOI:10.1109/TMC.2008.52 |

| [16] |

Li CX, Zhao WJ, Meng LC, et al. Fungi recognition based on coordinate attention and EfficientNetV2. Proceedings of the 5th International Conference on Artificial Intelligence and Big Data (ICAIBD). Chengdu: IEEE, 2022. 427–432.

|

| [17] |

Sunil CK, Jaidhar CD, Patil N. Cardamom plant disease detection approach using EfficientNetV2. IEEE Access, 2022, 10: 789-804. DOI:10.1109/ACCESS.2021.3138920 |

| [18] |

Koumparoulis A, Potamianos G. Accurate and resource-efficient lipreading with EfficientNetV2 and Transformers. Proceedings of the 2022 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). Singapore: IEEE, 2022. 8467–8471.

|

| [19] |

高静. 中国主要农作物生长发育数据集(V2.0). https://kns.cnki.net/KCMS/detail/detail.aspx?dbname=SNAD&filename=SNAD000001918125. (2020-10-12).

|

2023, Vol. 32

2023, Vol. 32