根据显微图像进行血细胞检测在疾病识别领域发挥着重要作用. 血细胞在医学上分为3种类型: 白细胞(WBC)、血小板(platelets)和红细胞(RBC)[1]. 成年男性的正常血细胞数目数约为每毫升4.7–610万, 女性的正常血细胞数目约为4.2–540万, 这些血细胞的数目和形态对临床诊断而言是至关重要的, 当人体发生感染或者其他疾病时, 医生可以通过血细胞的检查来辅助诊断[2]. 血细胞的检测早期普遍采用人工镜检的方式, 即先手工制片、染色, 再通过人工分类来完成. 人工检测血细胞的方法容易受到主观因素的影响, 且由于数据量大且目标小, 容易导致准确率不高且耗费人力[3, 4] 而使用基于深度卷积神经网络的自动检测算法来准确高效地检测血细胞已经取得了较好的检测效果, 提高医疗系统的检测效率[5-7].

随着深度学习领域的发展, 越来越多的目标检测方法被提出, 目标检测技术广泛应用于医疗影像、缺陷检测、自动驾驶等领域中. 主流的目标检测法大致分为两类: 一类是两阶段检测, 比如R-CNN算法[8], 该算法在第1阶段生成候选对象区域放入深度网络中提取特征, 在第2阶段将候选区域进行分类, 这样的两阶段检测虽然运行速度缓慢但精度很高. 另一类是单阶段检测: 比如YOLO系列[9-12]和SSD算法[13], 其相较两阶段检测的检测速度有所提升, 准确率也在逐渐提高.

综上, 本文选择YOLOv5-6.0算法作为基础网络, 在复杂度低的同时有较高的识别精度, 对检测精度以及速度要求较高的血细胞检测上, 具有较高的实用性. 本文在YOLOv5的骨干网络中, 加入了坐标注意力[14], 增强特征提取的能力, 将YOLOv5模型的FPN[15]+PAN[16]结构引入BiFPN[17]的思想进行多尺度特征融合, 在三尺度检测的基础上增加了一个小目标检测层. 通过在公共血细胞检测数据集上的对比实验验证, 本文方法的检测效果显著提升, 可以很好地应用于血细胞检测任务中.

2 算法原理YOLOv5是YOLO系列的第5代目标检测算法, 包含了1.0、5.0、6.0等多种版本, 包含了 YOLOv5s、YOLOv5m、YOLOv5l、YOLOv5x 等多种规模的网络, 模型的大小依次增加、精度也依次增加. YOLOv5-6.0沿用v3、v4的整体布局, 具有更高的检测精度和速度, 与YOLOv5差距不大. YOLOv5-6.0由输入端、主干网络、颈部网络、预测分类器4个部分组成. 本文选择的基础网络YOLOv5-6.0的整体结构如图1所示.

2.1 输入端输入端将尺寸不同的输入样本采用自适应图片缩放的方式将图像尺寸缩放到一个固定的尺寸, 进行自适应填充, 再送入主干网络中进行训练. YOLOv5的数据增强采用了和YOLOv4一样的Mosaic数据增强的方式, 用于解决数据集样本不足以及尺寸分布不均衡的问题, Mosaic数据增强将4张图片通过随机裁剪、随机亮度调整、翻转等方式进行拼接, 减少了GPU的使用, 增强了网络的鲁棒性.

2.2 主干网络YOLOv5-6.0的主干网络将将卷积结构中的激活函数改为SiLU函数, 并将Focus模块换成了一个卷积核(kernel)为6, 步长(stride)为2, 填充(padding)为2的卷积层, 对于现有的一些GPU设备而言, 使用卷积层比使用Focus模块更高效. YOLOv5-6.0将空间金字塔池化结构(SPP)改为SPPF结构, 并且将SPPF的结构放在主干网络的最后一层. SPPF的结构如图1所示, 将输入串行通过卷积层和多个5×5大小的最大池化层(MaxPool), 提高了计算速度.

2.3 颈部网络YOLOv5-6.0的Neck部分采用特征金字塔网络(FPN)+路径聚合网络(PAN)的结构, 特征金字塔结构通过上采样的方式将深层特征图中较强的语义信息传到浅层. 路径聚合网络通过下采样的方式将浅层的位置信息传递到深层, 进行多尺度的特征融合.

2.4 预测分类器YOLOv5的head用3个1×1的卷积层替代全连接层(FC)进行预测和分类, 分别生成20×20, 40×40, 80×80这3个不同尺度的特征图, 输出结果为4+1+C, 分别为预测框坐标, 目标置信度、类别概率值.

3 改进的YOLOv5算法本实验基于YOLOv5-6.0算法提出了改进网络YOLOv5-CBF. 在主干网络中引入CA模块, 增强模型对3类血细胞目标的定位能力, 其参数如表1所示, Input size表示该层的输入尺寸, Number表示该层的数量, Module表示模块名, Args表示模块的初始化参数, 分别为: 输入通道数, 输出通道数, 卷积核尺寸. 在颈部网络上结合BiFPN的思想, 引入AWFF结构进行加权特征融合, 加强特征的多尺度表达. 在三尺度检测的基础上增加了一个小目标检测层, 提高对数据集中小目标血小板的识别精度, 其检测速度能够很好地满足实时检测的要求, 改进后的YOLOv5-CBF整体结构如图2所示.

|

图 1 YOLOv5-6.0网络结构 |

| 表 1 主干网络参数 |

3.1 注意力机制模块

在深度学习领域, 注意力机制常用来帮助模型更准确地定位和识别感兴趣的对象. 神经网络中的注意机制有通道注意[18]、空间注意[19]和混合注意[20]等多种类型. Hou等的研究成果[14]表明, 通道注意力(例如, SE注意力)虽然可以提升模型的性能, 但它们通常会忽略位置信息, 而CA模块将通道注意力按维度分解, 并分别沿不同的空间方向聚合特征, 捕获跨通道信息和位置信息.

CA模块可以帮助轻量级的模型更加精确的定位和识别感兴趣的目标, 增强YOLOv5-6.0网络的特征表达能力, 进而提高血细胞的检测精度, CA结构如图3所示.

CA对输入的特征图X. 首先使用两个一维的池化核分别沿水平与垂直方向对每个通道进行编码, 第c个通道在其对应的高度和宽度输出可以分别表示为:

| zhc(h)=1W∑0⩽i<WXc(h,i) | (1) |

| zwc(w)=1H∑0⩽j<HXc(j,w) | (2) |

|

图 2 YOLOv5-CBF网络结构 |

|

图 3 CA结构 |

其次, 对两个带有特定方向信息的特征图进行拼接, 得到:

| f=δ(F1([Zh,Zw])) | (3) |

利用激活函数将f分解为2个单独的张量

| yc(i,j)=xc(i,j)×ghc(i)×gwc(j) | (4) |

CA模块增强了特征图的识别能力, 可以帮助轻量级的YOLOv5模型更加精确的定位和识别感兴趣的目标. YOLOv5-CBF在Backbone中加入了两个CA模块, 改进后的 Backbone 网络详细参数如表1所示.

3.2 跨尺度特征融合方法BiFPNYOLOv5的Neck部分采用FPN+PAN的结构. FPN结构将语义特征自顶向下传递, 路径聚合结构将定位特征自底向上传递. 这种多尺度特征的融合将特征图变换成同样的尺寸进行连接, 通常对融合输出特征的贡献是均衡的, 因此无法充分利用不同尺度间的特征. 为更为充分地进行多尺度特征融合, 提高检测精度, 本算法的Neck部分借鉴了一种具有跨尺度连接和加权特征融合的BiFPN结构[17]的思想.

BiFPN结构第1步删除只有一条输入边的节点. 原因是只有一条输入边且不参与特征融合的节点相较于其他集成不同特征的节点的贡献较小. 其次, 如果它们处于同一级别, 我们将从原始输入额外添加一条边到输出节点进行跳跃连接. BiFPN结构将每个双向路径看作一个特征网络层, 并多次复制同一层, 以实现更优的特征融合结构. 上述优化所产生的BiFPN结构如图4所示, 下箭头为上采样, 上箭头为下采样.

|

图 4 BiFPN 特征融合结构 |

为解决在不同深度下特征难以有效融合的问题, 本文提出了注意力加权特征融合(attention-weighted feature fusion, AWFF)结构, 为每一个输入特征设置了一个可学习的特征融合因子, 进行特征加权融合, 获取更多上下层高效的语义特征信息, 进而提高目标检测算法的准确率. YOLOv5-CBF中使用了两个AWFF模块, AWFF网络结构如图5所示.

在AWFF中先用1×1的Conv操作将C3特征图的通道数压缩, 再将输出的特征图F1与Neck部分输出的特征图进行拼接. 再通过Conv操作进行加权融合, 融合公式为:

| Fi=Conv(Concat(β1×Mi,α1×Resize(Conv(Xi)))) | (5) |

| Oi=Concat(β2×Ni,α2×Resize(Conv(Fi)))) | (6) |

其中,

本文借鉴了BiFPN的思想, 采用加权的方式对输入特征设置了可学习的特征融合权重, 改进后的YOLOv5-CBF整体结构如图2所示.

|

图 5 AWFF 网络模块 |

3.3 多尺度检测的改进

通常目标检测算法对中大型目标的数据集(例如COCO数据集)都有较好的检测效果, 而较深的特征图很难学习到血细胞数据集中小目标血小板的特征. 体积小的血细胞的目标区域信息可能在多次卷积后被丢失, 从而导致检测精度降低. 为了改进此问题, YOLOv5-CBF将输入图片的像素调整到640×640×3, 分别在 20×20、40×40、80×80以及160×160 四种不同大小的检测尺度上进行预测, 改进后的模型如图2所示.

YOLOv5-CBF在增加了一个检测尺度之后, 在Neck部分输出为80×80×128的特征图的C3层后增加Conv层、二倍上采样层和C3层. 再将二倍上采样层特征层与主干网络C3层的特征进行融合, 通过Conv层进行下采样, 进行加权特征融合, 并生成160×160的检测尺度.

改进后的模型通过实验检测了3种目标血细胞. 与传统的YOLOv5算法相比, 改进算法YOLOv5-CBF更充分地提取了浅层的特征信息, 提高了检测的精度. 每个网格中会预测3个不同尺寸的边界框, 每个边界框会产生一个 4+1+C 维的向量, 分别为边框坐标、类别置信度、预测类别的置信度(BCCD中为类别3)计算方法如下:

| Confidence=Pr(object)×IoUtruthpred | (7) |

本实验的处理器为Intel Core i7 9750H, GPU为NVIDIA GeForce RTX 2060, 深度学习框架为PyTorch, 开发环境为PyTorch 1.8.1, Python 3.8, Cuda 11.1, 优化器采用Adam优化器.

4.1 数据集处理为了评估本文所提出的YOLOv5-CBF网络, 本实验使用的训练集和测试集均采用公开数据集BCCD, 该数据集包括364张图像, 比例为7:2:1, 即70%的数据用于训练, 20%的数据用于调整模型的超参数, 10%的数据用于测试模型. BCCD数据集包含少量的白细胞(WBC)、血小板(platelets)以及大量的红细胞(RBC), 其中, 检测重叠、粘连的红细胞和小目标血小板是检测的难点.

模型训练时, 需要针对血细胞数据集样本不足的情况进行数据增强, 通过在图像的0到15%之间随机裁剪、随机亮度调整、翻转等操作后对4张图片进行拼接, 丰富了血细胞数据集, 进而间接增大了每批数据量(batch_size)的大小.

所有输入血细胞图像尺寸统一调整为640×640×3, batch size设置为16, 初始学习率设置为0.001, 动量项取0.9, epoch设置为100, 进行训练, 得到最佳的模型权重. 并与Faster-R-CNN[21]、YOLOv4、YOLOv3和YOLOv5网络进行对比实验.

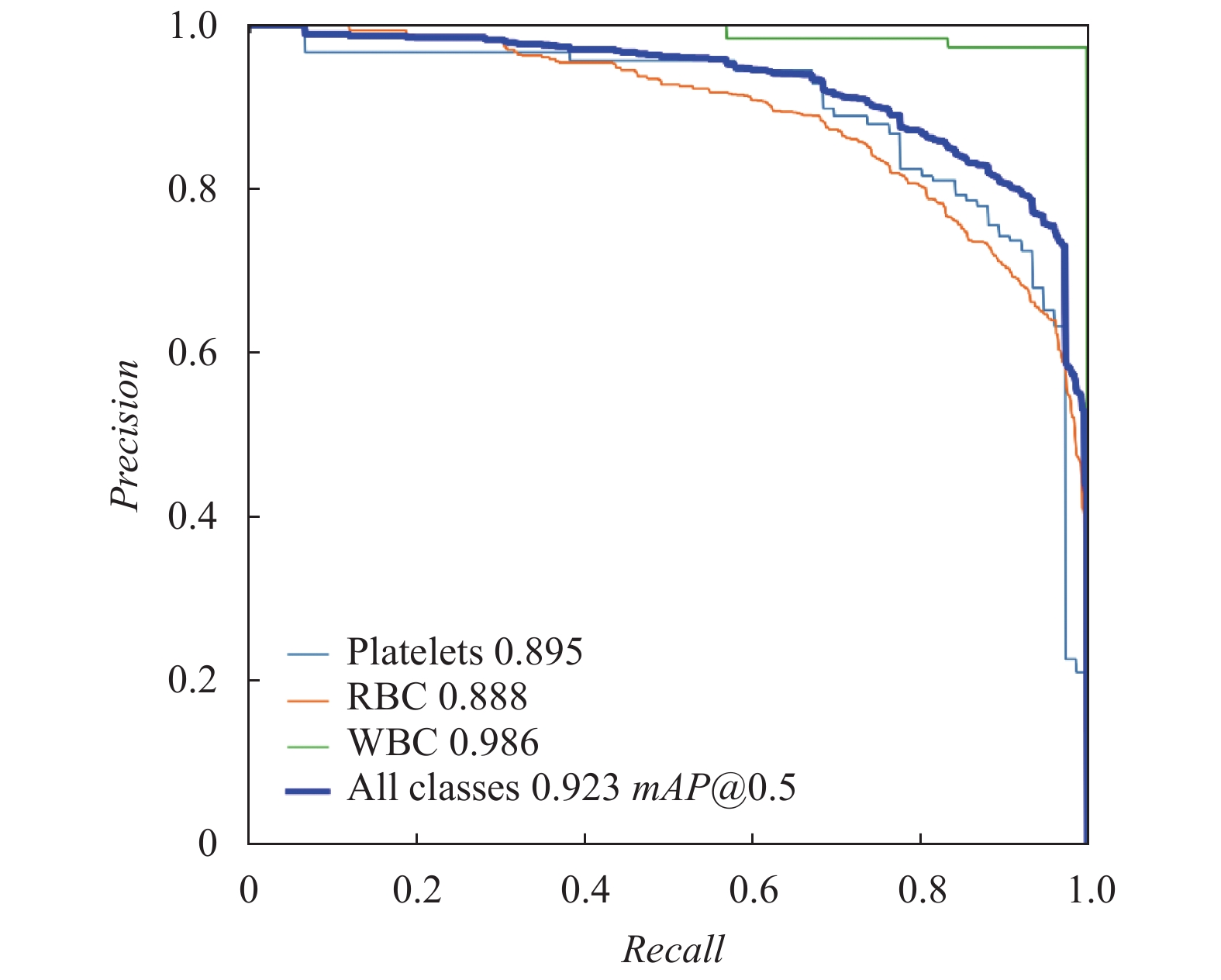

4.2 评价指标本实验对于BCCD检测采用查准率(Precision)、查全率(Recall)、检测精度(AP)、类平均精度(mAP)作为主要的评价指标. 改进后YOLOv5-CBF算法的3类血细胞的P-R曲线如图6所示, 通过计算P-R曲线下方的面积即可获得该类血细胞的mAP值. 红细胞、白细胞和血小板3种类别的mAP值依次为88.8%、98.6%、89.5%.

查准率是衡量在血细胞检测任务中的是所有预测为正样本的结果中, 预测某细胞正确的个数(TP)占正确总个数(TP+FP)的比值.

查全率指的是表示血细胞的真实类别为正, 最后预测得到的结果也为正的个数(TP)占所有应该被检测到的细胞(TP+FN)的比例.

AP用来计算单类别模型平均准确度,N代表类别总数, 血细胞检测任务中的类别总数为3, 各指标具体计算公式如下:

| Precision=TPTP+FP | (8) |

| Recall=TPTP+FN | (9) |

| AP=∫10PRdR | (10) |

| mAP=∑ni=0APin | (11) |

|

图 6 YOLOv5-CBF的P-R曲线 |

4.3 实验结果分析

本文将 YOLOv5-CBF模型与现有的主流的单阶段、两阶段目标检测模型通过同一组血细胞检测图片进行对比分析. 对比结果表2所示.

表2中, FPS (frame per second)为检测速度, 即算法每秒可以检测到的图像数量. 分析表2中的数据可以看出, YOLOv5-CBF相比大部分目标检测网络不仅复杂度较小, 而且精度上也有着明显优势. 相较于Faster-R-CNN[21]、YOLOv4、YOLOv3、TE-YOLOF-B3、ISE-YOLO和YOLOv5-6.0网络模型在mAP@0.5指标上分别高出15.8个百分点, 7.6个百分点, 8.4个百分点, 0.4个百分点、6.6个百分点和2.7个百分点, 对比分析实验表明该算法在mAP@0.5指标上是所有对比模型中最优的. 在检测速率上, YOLOv5-CBF相较于同是用于在公开血细胞数据集BCCD上进行检测的TE-YOLOF-B3和ISE-YOLO算法, FPS分别增加了8.9和17.4, YOLO-CBF在相同的血细胞数据集上的检测速度和精度相较于前两个网络模型都有所提升. 本算法速度不及原始的YOLOv5-6.0网络, 检测单张图片的时间增加了0.03 s, FPS为51.9, 可满足在硬件终端上检测任务的实时性需求, 并有效改善原始的网络误检、漏检的问题. 实验表明本算法在保证了检测速度的基础上, 提升了mAP, 在所有对比模型中综合性能最好.

| 表 2 对比分析实验 |

使用原始的YOLOv5-6.0、Faster-R-CNN、YOLOv3、YOLOv4与改进YOLOv5-CBF目标检测算法从BCCD数据集中随机选取3张图片进行检测, 检测效果如图7所示.

从图7(b)的血细胞检测效果可以看出Faster-R-CNN算法在大目标(WBC)中的检测效果较好, 预测的置信度普遍较高, 但图7 (b2)中血小板存在一个漏检, 左侧重叠与粘连的红细胞部分检测效果很差, 且Faster R-CNN标注框的大小不够精准. 从图7(c)的检测效果可以看出, 相较于Faster-R-CNN算法, YOLOv3算法对于红细胞粘连部分的检测效果有所改善, 但仍存在少量的误检与漏检问题, 如图7(c1)右下角的小目标血小板检测中出现了一个漏检. YOLOv4算法与YOLOv3检测效果差距不大, 对于红细胞粘连部分的检测也存在少量的错检与漏检问题. 如图7(e)所示, YOLOv5-6.0对粘连红细胞的的错检与漏检问题明显改善, 但图7(e2)右侧对小目标血小板的检测仍存在一个漏检. 如图7(f)所示, 采用 YOLOv5-CBF 算法检测左侧重叠的红细胞虽然也存在部分漏检问题, 但相较于其他算法有很大改善. 如图7(f2)所示, YOLOv5-CBF准确检测出4种对比算法均未能检测出的小目标血小板.

4.4 消融实验为了验证各个模块的有效性, 分析各个模块对 YOLOv5-CBF算法精度影响, 本文进行了消融实验, 以 YOLOv5-6.0为基础网络逐步增加改进点, 实验结果如表3所示. 根据表3消融实验的数据显示, 在主干网络中加入CA模块的网络相较于原网络的mAP值提升了1.4%, 说明注意力机制网络能抑制无用特征, 有效提高血细胞检测的性能. 在三尺度检测的基础上增加了一个小目标检测层, 相较于原网络的mAP值提升了2.1%. 嵌入AWFF模块后,mAP提高至 92.1%. YOLOv5-CBF相较于原YOLOv5-6.0网络在3类血细胞检测的平均精度提升2.7%, 提升了检测准确率, 并保持了较好的检测速率, 具有很高的实用性.

5 结论与展望为解决血细胞尺度变化大, 红细胞粘连以及数据样本少导致的检测精度低等问题, 本文提出了一个实时高效的YOLOv5-CBF算法. 针对数据集目标尺度变化大的问题, 本文在主干网络中添加CA模块, 增强模型对目标的精确定位能力, 从而提高检测精度. 为解决颈部网络的特征融合不充分, 导致多特征表达能力下降的问题, 提出了结合了BiFPN思想的特征融合结构, 使目标特征更有效的表达, 在一定程度上减少了红细胞在堆叠情况下由于特征表达能力不足而造成的漏检和误检, 提高了红细胞检测的准确性, 进而提高血细胞的检测精度. 在三尺度检测的基础上增加了一个小目标检测层, 提高血小板的识别精度. 实验结果证明YOLOv5-CBF 算法具有优秀的检测精度和实时检测效果, 能很好地应用于血细胞检测这样的密集小目标检测任务中. 当利用本文算法对严重堆叠的红细胞进行目标检测时, 会存在不同程度的漏检和误检, 下一步工作将针对严重堆叠问题展开进一步研究, 提升检测精度, 进一步优化模型结构与损失函数, 加快模型的收敛速度.

|

图 7 可视化对比图 |

| 表 3 消融实验 |

| [1] |

Atkins CG, Buckley K, Blades MW, et al. Raman spectroscopy of blood and blood components. Applied Spectroscopy, 2017, 71(5): 767-793. DOI:10.1177/0003702816686593 |

| [2] |

Garraud O, Tissot JD. Blood and blood components: From similarities to differences. Frontiers in Medicine, 2018, 5: 84. DOI:10.3389/fmed.2018.00084 |

| [3] |

Biswas S, Ghoshal D. Blood cell detection using thresholding estimation based watershed transformation with Sobel filter in frequency domain. Procedia Computer Science, 2016, 89: 651-657. DOI:10.1016/j.procs.2016.06.029 |

| [4] |

Tiwari P, Qian J, Li QC, et al. Detection of subtype blood cells using deep learning. Cognitive Systems Research, 2018, 52: 1036-1044. DOI:10.1016/j.cogsys.2018.08.022 |

| [5] |

Shahin AI, Guo YH, Amin KM, et al. White blood cells identification system based on convolutional deep neural learning networks. Computer Methods and Programs in Biomedicine, 2019, 168: 69-80. DOI:10.1016/j.cmpb.2017.11.015 |

| [6] |

Liang GB, Hong HC, Xie WF, et al. Combining convolutional neural network with recursive neural network for blood cell image classification. IEEE Access, 2018, 6: 36188-36197. DOI:10.1109/ACCESS.2018.2846685 |

| [7] |

Zhang DD, Zhang PF, Wang LS. Cell counting algorithm based on YOLOv3 and image density estimation. Proceedings of the 2019 IEEE 4th International Conference on Signal and Image Processing. Wuxi: IEEE, 2019. 920–924.

|

| [8] |

Girshick R, Donahue J, Darrell T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation. Proceedings of the 2014 IEEE Conference on Computer Vision and Pattern Recognition. Columbus: IEEE, 2014. 580–587.

|

| [9] |

Redmon J, Divvala S, Girshick R, et al. You only look once: Unified, real-time object detection. Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas: IEEE, 2016. 779–788.

|

| [10] |

Redmon J, Farhadi A. YOLO9000: Better, faster, stronger. Proceedings of the 2017 IEEE Conference on Computer Vision and Pattern Recognition. Honolulu: IEEE, 2017. 6517–6525.

|

| [11] |

Redmon J, Farhadi A. YOLOv3: An incremental improvement. arXiv:1804.02767, 2018.

|

| [12] |

Bochkovskiy A, Wang CY, Liao HYM. YOLOv4: Optimal speed and accuracy of object detection. arXiv:2004.10934, 2020.

|

| [13] |

Liu W, Anguelov D, Erhan D, et al. SSD: Single shot multibox detector. Proceedings of the 14th European Conference on Computer Vision. Amsterdam: Springer, 2016. 21–37.

|

| [14] |

Hou QB, Zhou DQ, Feng JS. Coordinate attention for efficient mobile network design. Proceedings of the 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Nashville: IEEE, 2021. 13713–13722.

|

| [15] |

Lin TY, Dollár P, Girshick R, et al. Feature pyramid networks for object detection. Proceedings of the 2017 IEEE Conference on Computer Vision and Pattern Recognition. Honolulu: IEEE, 2017. 2117–2125.

|

| [16] |

Wang WH, Xie EZ, Song XG, et al. Efficient and accurate arbitrary-shaped text detection with pixel aggregation network. Proceedings of the 2019 IEEE/CVF International Conference on Computer Vision. Seoul: IEEE, 2019. 8439–8448.

|

| [17] |

Tan MX, Pang RM, Le QV. EfficientDet: Scalable and efficient object detection. Proceedings of the 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Seattle: IEEE, 2020. 10778–10787.

|

| [18] |

Hu J, Shen L, Albanie S, et al. Squeeze-and-excitation networks. Proceedings of the 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Salt Lake City: IEEE, 2018. 7132–7141.

|

| [19] |

Jaderberg M, Simonyan K, Zisserman A. Spatial transformer networks. Proceedings of the 28th International Conference on Neural Information Processing Systems. Montreal: MIT Press, 2015. 2017–2025.

|

| [20] |

Woo S, Park J, Lee JY, et al. CBAM: Convolutional block attention module. Proceedings of the 15th European Conference on Computer Vision. Munich: Springer, 2018. 3–19.

|

| [21] |

Ren SQ, He KM, Girshick RB, et al. Faster R-CNN: Towards real-time object detection with region proposal networks. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149. DOI:10.1109/TPAMI.2016.2577031 |

| [22] |

Xu FX, Li XK, Yang H, et al. TE-YOLOF: Tiny and efficient YOLOF for blood cell detection. Biomedical Signal Processing and Control, 2022, 73: 103416. DOI:10.1016/j.bspc.2021.103416 |

| [23] |

Liu C, Li DW, Huang P. ISE-YOLO: Improved squeeze-and-excitation attention module based YOLO for blood cells detection. Proceedings of the 2021 IEEE International Conference on Big Data (Big Data). Orlando: IEEE, 2021. 3911–3916.

|

2023, Vol. 32

2023, Vol. 32