据世界卫生组织统计, 2020年全球女性乳腺癌新增病例226.1万, 新超过肺癌新增病例[1], 其中, 中国境内新增乳腺癌病例约41.6万, 全年乳腺癌死亡病例约11.7万[2]. 据全球疾病负担 (global burden of disease, GBD)数据库统计, 1990–2019年间, 中国女性乳腺癌发病率近年来一直呈上升趋势[3], 尽早开展乳腺检查与治疗可有效降低乳腺癌的死亡率[4].《中国女性乳腺癌筛查与早诊早治指南》建议45岁以上的妇女定期参加乳腺癌筛查, 高风险人群则应适当减小筛查年龄[5]. 乳腺癌筛查时, 为减少不必要活检, 尽量降低筛查对患者的伤害, 首选风险更小的医学成像技术, 包括乳腺X线成像、乳腺超声成像和乳腺磁共振成像等作为筛查手段. 为降低影像科医生工作量, 提高筛查效率, 减少主观因素造成的漏诊误诊, 以人工智能为基础的计算机技术成为影像科医生重要的辅助诊断手段. 目标检测技术因其可对乳腺影像中的病患区域进行定位并进行初步分类, 辅助专业医师进行查阅和诊断而备受关注.

目标检测技术是对目标图片上的各个物体定位并分类的技术[6], 包括选择目标区域、提取目标特征和分类3部分. 选择目标区域是对目标进行定位, 在定位过程中, 目标的大部分属性均未知, 故需大量多尺度滑动窗口, 尽可能覆盖所有可能目标区域; 提取目标特征是利用增强特征的抗形变和表达能力的方法进行特征提取, 以便对目标进行分类;分类则通过事先准备好的分类器进行[7]. 传统目标检测, 如VJ (Viola Jones)[8]、HOG (histogram of oriented gradients)[9]等, 以手工设计为主, 提取特征能力弱且不适用于复杂背景下的检测[10], 准确率差强人意. 近年来, 基于深度学习的目标检测技术发展迅猛, 相较 于传统目标检测技术, 精准度高、速度快且在复杂环境下的鲁棒性高[11], 非常适合对乳腺癌进行检测.

根据是否生成候选区域, 可将深度学习目标检测分为二阶段目标检测算法和一阶段目标检测算法: 二阶段目标检测算法分为两个阶段, 先框定候选区域, 再进行检测, 常见算法包括R-CNN、SPPNet、Fast R-CNN和Faster R-CNN等; 一阶段目标检测算法只有检测过程, 无需框定候选区域, 常见算法包括YOLO系列、SSD和RetinaNet等. YOLO算法作为首个且最成功的一阶段目标检测算法, 对目标检测的发展至关重要. YOLO系列算法种类繁多, 其中YOLOv1–YOLOv5算法因具有代表性和权威性且应用范围较广被称为经典YOLO系列算法. 通过查阅截至2023年4月1日以来万方数据知识服务平台(Wanfang)、中国期刊全文数据库(CNKI)、Web of Science数据库和Engineering Village数据库收录的“乳腺”“YOLO”相关54篇文献, 重点对YOLOv1–YOLOv5算法及其在乳腺癌检测中的应用情况进行梳理, 并根据算法特点分为3个部分论述.

2 YOLO系列算法及其在乳腺癌图像检测的应用 2.1 快速的目标检测算法——YOLOv1与YOLOv2 2.1.1 YOLOv1算法概述2016年, “YOLO之父” Redmon等人首次提出YOLO算法[12], 后被称为YOLOv1算法, 是YOLO系列目标检测算法的基础和重要理论依据.

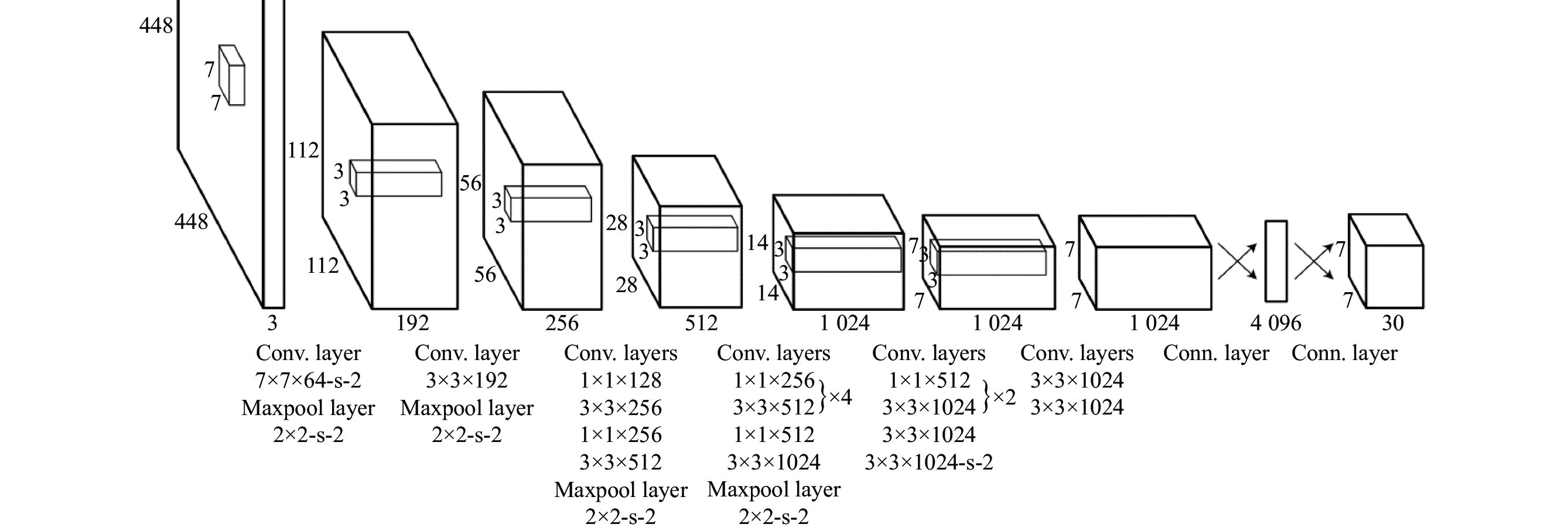

Redmon等人[12]摒弃了二阶段目标检测算法利用滑动窗口寻找候选区域的步骤, 直接通过一个24层的卷积神经网络对整个图像进行检测. 首先将图像分成488×488个网格, 各网格单元负责监测物体中心落入该网格单元的物体, 并预测物体边界框及其对应置信度分数和条件类别概率. 一个边界框由横坐标、纵坐标、宽度、高度和置信度这5个元素组成, 其中横纵坐标用来确定边界框位置, 宽度和高度为整幅图片的宽高与边界框宽高的比值, 置信度为边界框与真实框的交并比. YOLOv1卷积神经网络结构简单, 仅由24个卷积层(convolution layer, Conv. layer)以及2个全连接层(connected layer, Conn. layer)构成网络, 结构如图1[12]所示.

YOLOv1的网络骨架的两个全连接层位于网络骨架的最后, 限制了YOLOv1图像输入的尺寸. 输出为7×7×30的矩阵即为所得结果, 将原图像分为7×7的网格, 每个网格对应30个参数, 其中10个参数代表在框中预测的两个框的位置坐标参数和置信度, 其余20个参数对应所预测20个类的概率值, 最终保留置信度高的框.

YOLOv1的损失函数如式(1)所示, 由位置损失、长宽损失、置信度损失和条件类别概率损失这5部分组成:

| Loss=λcoordS2∑i=0B∑j=01objij[(xi−ˆxi)2+(yi−ˆyi)2]+λcoordS2∑i=0B∑j=01objij[(√wi−√ˆwi)2+(√hi−√^hi)2]+S2∑i=0B∑j=01objij(Ci−ˆCi)2+λcoordS2∑i=0B∑j=01noobjij(Ci−ˆCi)2+S2∑i=01objij∑c∈classes(pi(c)−ˆpi(c))2 | (1) |

该损失函数对预测框位置(横纵坐标分别对应x和y)、预测框规格(长宽分别对应w和h)、预测框所预测的类和除预测框所预测的类以外的其他类(对应C)及预测概率(对应p)进行方差求和运算. 其中λ表示参数, obj即object, 表示所负责的目标, noobj即noobject表示不含所负责目标的其他目标, 其中coord即coordinate, 表示坐标, S2表示网格个数, B表示对应网格中包含预测框总个数, c表示目标对应类别.

|

图 1 YOLOv1 算法的卷积神经网络结构 |

YOLOv1与同时代其他算法比最突出优点是速度快, 但精准率较低, 每个格子仅能预测一个框, 所以对小目标及密集目标检测率低.

2.1.2 YOLOv2算法概述2017年, Redmon等人针对检测精准度、检测速度及可分类数量对YOLOv1进行优化得到YOLOv2算法[13], 主要改变: (1)将卷积神经网络在每一层的最后都增加了批归一化 (batch normalization, BN)层[14], 增加目标图像收敛速度, 以防过拟合; (2)可输入更高分辨率的图像, 进一步匹配硬件环境, 提高算法检测能力; (3)在卷积神经网络中引入锚框, 并借助Faster R-CNN方法[15], 计算坐标偏移量而非直接计算坐标, 减少了运算量; (4)将整幅图分成N×N个网格, 以每个网格的左上顶点为基准点进行偏移量计算, 确定锚框绝对位置, 以预防检测时的不稳定性; (5)锚框比例非手动采取, 而是利用K均值聚类分析得出K种不同比例的锚框进行适应性锚框采取; (6)设计了全新网络骨架Darknet-19, 结构如图2所示.

|

图 2 YOLOv2 的网络骨架 Darknet-19 |

Darknet-19由19个卷积层及5个最大池化层(maxpool layer)组成, 与YOLOv1算法网络骨架相比其主要特点: (1) 无全连接层, 故对输入图像尺寸无限制; (2)每个卷积层后均进行批归一化处理, 整体结构短小精悍; (3)采用全局平均池化进行锚框预测, 并增加细粒度特征识别; (4)借鉴了SSD算法的多尺度检测方法, 在其最大值池化层之后设计直通(pass through)层, 可将低分辨率特征图与高分辨率特征图关联后再预测. 其损失函数基本与YOLOv1相同.

YOLOv2算法通过多尺度训练增强对不同尺度目标的识别程度, 在VOC2007数据集上进行的YOLOv1与YOLOv2的对比实验表明, 后者比前者的 mAP值提高了15.1%. YOLOv2算法虽在速度和性能上有突破, 对小目标不敏感问题也做了处理, 但准确率依然偏低.

2.1.3 YOLOv1与YOLOv2在乳腺癌检测的应用YOLOv1和YOLOv2算法速度均可达到实时检测速度要求, 可被应用于视频和实时检测中, 在乳腺癌检测中也有应用.

Al-Masni等人[16]利用乳腺钼靶筛查的数字数据库 (the digital database for screening mammography, DDSM)中数据设计一基于YOLOv1检测乳腺X线图像的计算机辅助系统, 第1次将乳腺肿块检测与分类合为一体, 既可检测图像中乳房肿块位置, 又可对肿块的良恶性进行初步分类, 这是YOLO系列算法在乳腺肿块识别中的初次应用, 定位和分类的总体准确率分别为99.7%和97%, 与传统卷积神经网络相比, 该算法使得图像中靠近胸肌周围的肿块更易识别, 定位和分类的总体准确率均有提高. 同年, Al-Antari等人[17]设计了一种检测分割分类乳腺X线图像的计算机辅助系统, 仅在定位时使用YOLOv1, 在公共数据集INbreast中实验整体精度为99.7%, F1分数(F1 score)为99.24%, 在分割时使用全分辨率卷积网络 (full resolution convolutional network, FrCN), 在分类时使用深度卷积神经网络, 在相同数据集中总体精度为97%. Al-Masni等人[18]在INbreast数据集中使用YOLOv1算法单独检测乳腺肿块是否存在, 再分别用卷积神经网络、ResNet-50网络和InceptionResNet-V88网络进行分类, 基于YOLO的检测准确率为97.27%, F1分数为98.02%, 比检测和分类均用YOLOv1算法时性能确有提高. Baccouche等人[19]用YOLOv1在413例私人乳腺X线图像数据进行实验, 按照正常乳腺、乳腺结构病变、乳腺钙化、乳腺肿块进行分类, 分类精度分别为94%、95%、88%和94%, 召回率分别为94%、95%、88%和94%, 最大速度为每张0.62 s, 在速度上具有一定优势. 明显可见, YOLOv1算法多用于乳腺位置信息检测, 在病灶定位中具有一定优势, 对病灶分类时多采用其他算法或融合其他算法.

在搜索上文所提数据库时并未查找到基于YOLOv2的乳腺癌图像检测研究结果, 推断原因有二: (1) YOLO系列算法更迭快, YOLOv2尚未取得较好乳腺癌图像相关研究成果即被更优秀的YOLOv3及后续算法取代; (2) 乳腺癌图像病灶种类繁多, 背景复杂, 目标受设备与环境影响较大[20], YOLOv2算法的卷积神经网络骨架深度浅且结构简单, 易被检测背景误导, 导致准确率不高且鲁棒性较差, 并不符合乳腺癌图像检测等高精准度分类需求.

总体来讲, YOLO前期算法对速度过分侧重, YOLOv1的每秒显示帧数 (frame per second, FPS)达45 Hz, YOLOv2的FPS达67 Hz, 它们的轻量化模型的FPS更高, 而保持动作流畅的FPS最低是30 Hz, 所以在实际应用中会出现速度溢出, 即运算速度远超当时实时监测速度, 造成不必要浪费, 但对于乳腺癌图像检测等应用, 为避免造成误诊事故, 精准度才是首要要求, YOLOv1和YOLOv2并不非常适合对乳腺癌进行检测.

2.2 多尺度的YOLO算法——YOLOv3 2.2.1 YOLOv3算法概述YOLOv3算法由Redmon等人[21]于2018年提出, 其中基于Darknet-19和ResNet网络[22]提出的有53个卷积层的卷积神经网络骨架Darknet-53最具特色, 结构如图3所示. 同时, 为解决对小型目标不敏感的问题, YOLOv3融合了特征金字塔结构[23], 利用正向传播和反向传播, 进行上下采样, 将深层特征与浅层特征相结合, 同时保留图像的语义特征与图形特征, 能更精准地提供3种不同尺度目标的输出选项, 分别对应检测的大、中、小型目标.

网络过深易出现网络退化现象, 为此Darknet-53引入用于校准的残差层, 将相同的输入数据输入上下两个通道, 上通道数据保持不变, 下通道数据进行卷积计算, 最后进行比对再输出, 有效防止了梯度爆炸或梯度消失.

此外, YOLOv3算法对检测头也有优化, 使用多标签分类的Logistic分类器取代YOLOv2单标签分类器Softmax, 增加了算法的灵活性; 此外还采用LeakyReLU函数作为激活函数, 增强整体的特征表达能力; 损失函数如式(2)所示, 不仅用均方差, 而是利用均方差函数对坐标信息和宽高信息进行损失计算, 并利用交叉熵函数对置信度和分类信息进行损失计算, 最后求和得到最终损失函数.

|

图 3 YOLOv3 的网络骨架 DarkNet-53 |

| Loss=λcoordS2∑i=0B∑j=0Iobjij[(xi−ˆxji)2+(yi−ˆyji)2]+λcoordS2∑i=0B∑j=01objij(√wji2+√ˆwji2)2+(√hji2+√ˆhji2)2−S2∑i=0B∑j=01objij[ˆCjilog(Cji)+(1−ˆCji)log(1−Cji)]−λnoobjS2∑i=0B∑j=01noobjij[ˆCjilog(Cji)+(1−ˆCji)log(1−Cji)]−S2∑i=0Iobjij∑c∈classes[ˆPjilog(Pji)+(1−ˆPji)log(1−Pji)] | (2) |

YOLOv3损失函数中变量意义与式(1)相同.

YOLOv3算法在保持速度优势的同时, 精准度有小幅提高, 对小目标物体的识别率也有提升, 同时, YOLOv3算法在应用中较为轻量化, 灵活性更好, 算法也更易于理解与改进.

2.2.2 YOLOv3在乳腺癌检测中的应用YOLOv3与YOLOv4算法可被应用于图像、视频和实时检测中, 在乳腺癌图像检测分类应用中多位研究人员提出了创新性算法改进. 蒋慧琴等人[24]提出一种基于YOLOv3的乳腺肿块自动检测算法, 利用互相关法自动搜索感兴趣区域, 筛选标注假阳性区域, 在类别损失函数中加入聚焦参数, 在DDSM和迷你乳腺X线摄影数据库 (mini mammographic database, MIAS)公开数据集中实验, 结果比原模型的检测精准率提高了9.62%, 并可以降低假阳性率. 徐立芳等人[25]将融合了压缩和激励 (squeeze and excitation, SE)模块的Res2Net取代YOLOv3算法的Darknet-53, 搭建新的下采样模块并构建Res-DenseNet网络替换原始模型的残差连接方式网络, 结果表明比原始YOLOv3算法mAP提高了4.56%, 作者的实验数据来自专业医生从相关医院数据库选取2015–2019年不同年龄层次、地区和人种的2011例原始病例共13586张图像. Baccouche等人[26]选择YOLOv3算法对DDSM、INbreast和私人数据集的X线乳腺图像分别进行检测, 并将乳腺X线图像进行数据增强和大小调整后重新训练为新的融合模型, 结果显示最佳结果对肿块的检测准确率分别为95.7%、98.1%和98%, 对钙化的检测准确率分别为74.4%、71.8%和73.2%, 优于YOLOv3原始模型. Aly等人[27]对比了YOLOv1、YOLOv2和YOLOv3算法应用于INbreast数据集中乳腺X线质谱检测的分类结果, 发现YOLOv3算法结果最优, 同时发现在利用K均值聚类选取锚框时效果最佳, 分类准确率达89.4%, 在分别用ResNet和InceptionV3取代YOLOv3算法原有多标签Logistic分类器时, 分类准确率分别提升为91.0%和95.5%. 王杉等人[28]收集来自南昌市第三医院1460个女性患者的4个标准角度的乳腺钼靶X线摄影图片, 针对乳腺钼靶图像中小肿块和互相遮挡肿块漏诊问题, 提出一种改进的YOLOv3算法, 为识别小型肿块加入自下而上的路径, 并采用级联和跨层的连接方式, 为识别互相遮挡肿块在Soft-NMS (软非极大值抑制)算法中引入了DIOU, 结果表明新算法在检测小型肿块和互相遮挡肿块时速度与精准度都有提升, mAP达96.1%, 较YOLOv3提高1.8%.

综上, YOLOv3乳腺病灶定位时仍较准确, 还可准确对乳腺病灶进行分类, 在处理小型的病灶以及重叠病灶具有优势. 总体来说, 在对乳腺癌检测中YOLOv3算法虽优于YOLO系列初期算法, 但增强图像数据、更改分类器、增加新模块后结果更好, 检测准确率仍有待提升.

2.3 综合性目标检测算法——YOLOv4和YOLOv5 2.3.1 YOLOv4算法概述Bochkovskiy等人[29]于2020年提出YOLOv4算法, 采用基于Darknet-53和CSPNet[30]改进的CSPDarknet-53网络骨架, 并得到“YOLO之父” Redmon的认可, 主要改进包括: (1)对输入数据利用马赛克数据增强、自对抗训练等技术进行数据增强, 增加了跨阶段部分 (cross stage partial, CSP)模块, 并将ReLU激活函数替换为Mish激活函数; (2)除了特征金字塔结构, 还增加一个自下而上的反向金字塔结构, 称之为双向融合结构[31], 增大感受野的同时还可增强网络骨架的表征能力, 进一步提高算法的特征提取能力.

YOLOv4算法计算位置损失时使用CIOU损失函数, 不仅考虑两点间距离, 还考虑长宽比和交并比重叠面积, 因此更加精密准确. 此外, YOLOv4算法将衰减学习率替换为余弦学习率, 最优化损失函数结果. 具体如式(3)所示:

| Loss=1−IOU(A,B)+ρ2(Actr,Bctr)c2+α.v | (3) |

其中, IOU(A, B)为预测框A与真实框B的交并比, 详情见图4, ρ表示两点间的欧氏距离, Actr和Bctr表示A和B的中心点, c表示A与B最小外接矩形对角线长度, v和α含义分别见式(4)和式(5).

| v=4π2(arctanwgthgt−arctanwh)2 | (4) |

其中, wgt和hgt分别表示真实框的宽和高, w和h表示预测框的宽和高.

| α=v(1−IOU(A, B))+v | (5) |

YOLOv4的网络骨架更深更复杂, 检测颈和检测头应用的新技术更多、损失函数也更精细, 速度与精度也更优. YOLOv4算法整体性能优于YOLOv3算法, 小目标检测的实验结果也优于YOLOv3, 对不同尺度的目标识别率也有进步.

2.3.2 YOLOv5算法概述以YOLOv4算法为蓝本的YOLOv5算法也发表于2020年, 主要优化: (1)采用马赛克增强技术进行数据增强; (2)为统一图像大小进行图像缩放时, 采用计算最小填充方式减少计算量, 提高计算速度; (3)在网络骨架中增加Focus (聚焦)模块, 对特征图像进行分堆重组构建新的特征图, 在特征图像损失较小时即可完成采样, 加入快速空间金字塔池化 (spatial pyramid pooling-fast, SPPF)模块, 继承YOLOv4的CSP模块, 并将其应用到包括网络骨架在内的多个结构中, 加强网络的整体特征融合能力. 此外, YOLOv5算法的损失函数将CIOU损失更改为如式(6)所示的GIOU损失, 可减小预测值与真实值间差距.

| LossGIOU=1−IOU(A,B)+|C−A∪B|C | (6) |

其中, 如图4所示A与B分别代表预测框和真实框, C代表A与B的最小共存框, C与阴影部分的比值即为损失函数的后半部分|C–A∪B|/C, 同时使用非极大值抑制(non-maximum suppression, NMS)筛选生成的多个目标框时, 剔除低于设定IOU阈值与置信度阈值的预测框及重复预测框, 保留唯一最优预测框.

|

图 4 预测框与真实框的交并比 |

YOLOv5综合性能较强, 比YOLOv4更加灵活, 比YOLOv3鲁棒性更强, 且有适应不同场景实际应用的多个子版本, 代码由Ultralytics LLC公司提出, 并持续更新和维护.

2.3.3 YOLOv4和YOLOv5算法在乳腺癌图像上的应用YOLOv4算法本身性能较优, 兼之速度较快, 在乳腺癌图像检测领域应用较多. Hamed等人[32]提出一个基于YOLOv4算法的计算机辅助检测系统, 将INbreast数据集乳腺X图像分为完整路径与裁剪后路径两个路径, 用以二次测试检测的正确性, 算法定位准确率为98%, 分类准确率为95%, 该算法还克服了需将乳腺X线图像调整为更小尺寸方能适应卷积神经网络进行癌症定位的问题. 王杉等人[33]将递归特征金字塔作为特征融合模块, 利用深度可分离卷积替代YOLOv4算法中的普通卷积, 与YOLOv4原算法在乳腺X线图像私人数据集上进行对比试验, 改进后的算法mAP为95.48%, 比原算法提升了1.38%, 每张图像检测时长为0.031 s, 比原算法缩短0.012 s. Kim等人[34]为解决高分辨率图像与低性能设备不匹配导致的准确率偏低问题, 通过对图像通道进行拓展同时对视觉模式进行标准化对YOLOv4进行改进, 用以检测超声通道下的乳腺肿瘤, 作者合并了两个小型乳腺超声数据集得到了1080张乳腺超声图像数据进行实验, 在相同条件下用改进算法与原始YOLOv4、R-CNN、VGG、AlexNet和GoogLeNet这5种算法进行对比试验, 其中改进算法准确率最高, 达94.9%, YOLOv4原算法次之, 达89.4%, 说明YOLOv4比其他几种目标检测算法更适用于乳腺超声图像检测. YOLOv4算法在乳腺X线图像检测中具有较好适应性, 在调整图像尺寸和更换算法模块等问题进行处理能进一步提升算法性能. YOLOv4在乳腺超声检测中也优于大部分算法, 进行适当改进后检测性能更有提高, 存在一定改进空间.

YOLOv5被应用于包括乳腺癌检测的多个领域. Su等人[35]基于YOLOv5算法和LOGO架构设计了一款目标检测算法YOLO-LOGO, 对CBIS-DDSM和INBreast数据集中乳腺X线图像进行乳腺癌检测和分割, 该算法先采用YOLOv5算法定位并裁剪乳腺X线图像中的肿块, 再用修改LOGO架构分别在全局和局部转换器上训练整个图像并裁剪图像, 最后二者合并形成最终算法, 真阳性率达95.7%, mAP为65.0%.Zhang等人[36]利用YOLOv5算法开发了多中心全容积乳腺超声图像数据算法, 收集2016–2020年来自7家医院741例全容积乳腺超声检查病例的2538张图像, 用马赛克数据增强技术和混合数据增强技术进行图像处理, 再采用加权框融合 (weighted boxes fusion, WBF)[37]进行模型融合, 增加变压器编码器模块, 并用3D ResNet[38]检测、验证和比较内外部图像数据, 该算法对所有病变都具有较高的敏感性, 其中内部和外部验证集的整体准确率分别为78.1%和71.2%, 且检出率随着乳腺影像报告和数据系统 (BI-RADS, breast imaging reporting and data system)等级的提高而提高. 李珊珊等人[39]基于YOLOv5算法提出YOLOv5-EA算法, 添加更高效的注意力机制, 引入非对称卷积, 并使用One Cycle学习率调整策略改进CBIS-DDSM数据集乳腺X线图像数据样本少、肿块类别差异不明显、乳腺肿块背景复杂和组织对比度低等特征导致的检测准确率低的问题, 检测乳腺X线的良、恶性肿块及钙化灶的准确率分别达到了93.0%, 88.4%和88.1%, 并用改进算法与Faster-RCNN、SSD、YOLOv3、YOLOv3-Tiny、YOLOv4和YOLOv5进行对比实验, 其中YOLOv5-EA的mAP最高, 达89.8%. Meng等人[40]针对乳腺动态增强磁共振图像对乳腺癌进行检测分类, 收集了2017–2020年间310例患者的乳腺磁共振图像, 并对YOLOv5s, YOLOv5m, YOLOv5l和 YOLOv5x这4个YOLOv5子算法进行对比实验, 发现YOLOv5s的mAP最高, 达89.4%, 召回率最高, 达91.65%, 检测速度最快, 每张1.1 ms, 具有更高的临床应用价值.

综上, YOLOv5应用于乳腺X线、乳腺超声和乳腺MRI这3种常规乳腺图像检测中, 速度和精准度均占优, 综合性较强, 适合多种乳腺图像的检测. YOLOv5的4个子算法中YOLOv5s表现最佳, 比YOLOv5原始算法更优. 在算法改进方面, 除改变数据增强方式和改进或增加算法模块外, 还采用融合框架对算法进行融合, 调整学习率等方法, 以解决乳腺图像质量差和乳腺病灶观察难等问题. 与YOLOv4相比, YOLOv5更加灵活, 改进成本低, 更适合多种复杂环境的多种乳腺图像综合检测.

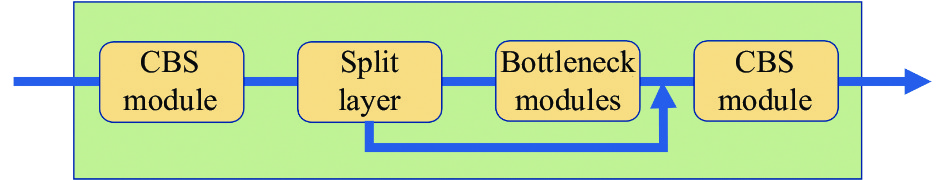

2.4 YOLO系列其他算法及应用近两年YOLO系列算法发展迅猛, YOLOX[41]、YOLOR[42]、PP-YOLO系列[43–45]、YOLOv6[46]、YOLOv7[47]和YOLOv8均为其中佼佼者. YOLOX算法最鲜明标志是采用解耦头结构, 将分类和定位两者放到两个分支进行运算, 一定程度上提升了目标检测任务的精度; YOLOR算法构建了一个多任务网络, 从不同角度处理图像, 并注重隐式知识学习, 在速度与精度上都有较大提升; PP-YOLOv1算法和PP-YOLOv2算法是在YOLOv3的基础上优化而得, 可在计算量与模型参数几乎不变的情况最大化提升精度; PP-YOLOE算法则意味着更轻量化且准确率更高, 可进一步满足工业生产需求; YOLOv6算法加入了RepVGG结构[48], 并使用SIOU损失函数[49], 在测试数据集上表现良好; YOLOv7算法在YOLOv5算法的基础上加入了E-ELEN结构[50], 进一步降低参数量及计算量, 并提高了运算速度与精度; YOLOv8算法是最新YOLO算法, 是目前的SOTA算法, 采用解耦头结构并使用基于YOLOv5最新版本中CBS模块(又称C3模块, 由卷积层、BN层及激活函数组成)和ELEN模块设计的C2F模块(由两个CBS模块、Split层以及Bottleneck模块组组成), 如图5所示.

|

图 5 C2F模块示意图 |

图5中CBS模块的卷积核为3×3步长为1, Split层由Transformer[51]修改而得, 一个Bottleneck模块中的卷积核为1×1, 步长为1. YOLOv8算法目前有适合不同应用场景的5个版本.

因YOLOv5以后的其他算法推出时间短, 目前应用较少, 虽在自动驾驶、农作物检测、卫星遥感监测、航空航拍识别、人脸动作识别等视觉领域已有涉猎, 但在乳腺癌检测中的应用尚待开展.

3 总结与展望随着经典YOLO算法的发展, 其系列算法性能也在不断提升. 经典YOLO系列算法在运算速度方面一直保持较高水平. 初期算法YOLOv1与YOLOv2缺点较多, 准确率较低的同时对小目标及并列目标检测效果差, 在对乳腺癌图像进行检测时会漏检小型病灶, 如钙化点等. YOLOv3准确率提升, 也针对检测小目标效果差这一问题进行处理, 但结果提升并不明显, 其结构相比YOLOv4与YOLOv5更轻量化, 较为贴合未来算法发展方向. YOLOv4与YOLOv5算法检测准确率高, 鲁棒性高, 增加了多尺度以应对小目标检测问题, 较为适合检测乳腺癌图像. 如表1所示[52,53].

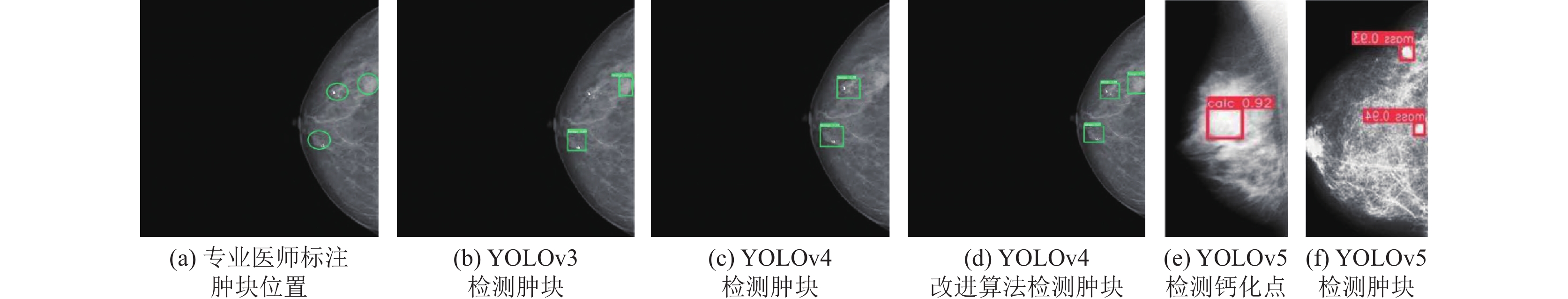

以文献[33]以及文献[54]中YOLOv3、YOLOv4、改进的YOLOv4和YOLOv5的乳腺和钙化病灶定位分类图可以看出在利用YOLO系列原始算法对乳腺癌病灶检测分类过程中, 除需用优秀数据集进行算法模型训练, 还需从数据预处理、解耦头、网络骨架、损失函数、激活函数、融合增加模块这6方面对算法进行针对性改进以得到适合检测乳腺图像模型. 对乳腺肿块位置进行定位和分类检测结果示例如图6[33,54]所示, YOLOv3和YOLOv4原始算法对小目标病灶及靠近胸肌的病灶识别效果差. YOLOv5可识别小型乳腺肿块, 靠近胸肌的肿块也能识别.

| 表 1 经典 YOLO 算法特性对比表 |

|

图 6 YOLO算法检测结果图 |

可以得出如下结论: 现阶段YOLOv1与YOLOv2已不适合乳腺癌图像检测; YOLOv4和YOLOv5与YOLOv3相比更适合乳腺癌图像检测, 其中, YOLOv5检测效果更好; 在利用YOLO算法检测时需进行针对性算法改进才能取得更好检测效果.

YOLO算法在乳腺癌图像检测中主要应用于辅助诊断系统的设计、乳腺定位以及融合其他算法进行乳腺癌相关病变分类这3个方面. 但根据以上资料分析, 在乳腺癌图像检测应用中目前依然存在以下3个问题.

第一, YOLO系列算法及对应子算法并非专门针对乳腺癌图像检测设计, 故须进行针对性改进, 目前尚无研究人员对已有YOLO算法进行较完整对比实验, 以确定乳腺癌图像检测的最优YOLO基础算法模型.

第二, 目前最常用的公开的乳腺癌图像数据集有DDSM和INbreast, 二者均为国外乳腺X线图像数据集. DDSM数据集为2620个患者包括全类型乳腺10480张图像, 被分为良性、恶性、正常3类, 是最大的数字化胶片乳腺X线数据集, 附有患者年龄等其他信息, 但噪声较多且个别病变标记不准确. 其子版本CBIS-DDSM数据集为1644个患者仅包括肿块和钙化二种病变的2015张图像, 被分为良性、恶性、正常3类, 是对DDSM数据集解压缩和重新标记, 但病变种类不全. INbreast数据集为115名患者包括肿块、钙化、结构型病变的410张图片, 病变种类较齐全, 标准精准, 但数据量太少. 我国尚无公开的大型乳腺癌图像数据集[54]. 我国女性与欧美等发达国家女性乳腺发育状况存在差异, 乳腺患病区域也存在差异, 多种优质乳腺癌图像数据集的缺乏, 使乳腺癌图像检测研究特别是针对中国女性的乳腺癌图像检测研究倍加困难.

第三, YOLOv6等版本的算法虽然性能优秀, 但对硬件要求过高, 普通设备无法满足其运行要求, 导致临床实际应用困难.

因此, 为更好地开展YOLO系列算法在乳腺癌图像检测中的应用研究, 尚需在以下3个方面继续努力.

第一, 继续加强对YOLO原理的研究, 同时精研YOLO算法在不同应场景中的应用需求, 选择最适宜的乳腺癌图像检测基础算法, 进行针对性改进生成较优YOLO衍生算法.

第二, 在保障患者隐私权的前提下, 呼吁医院等相关单位提供更多公开中国女性乳腺癌图像数据集并进行定期维护, 以促进我国女性乳腺癌图像数据目标检测研究的持续进步.

第三, 继续保持YOLO算法的轻量化发展方向, 并针对实际应用场景设计更多YOLO子算法以推动乳腺癌检测的精度不断突破, 为降低乳腺癌患者死亡率做出贡献.

| [1] |

Cao W, Chen HD, Yu YW, et al. Changing profiles of cancer burden worldwide and in China: A secondary analysis of the global cancer statistics 2020. Chinese Medical Journal, 2021, 134(7): 783-791. DOI:10.1097/CM9.0000000000001474 |

| [2] |

刘宗超, 李哲轩, 张阳, 等. 2020全球癌症统计报告解读. 肿瘤综合治疗电子杂志, 2021, 7(2): 1-13. |

| [3] |

Yin M, Wang F, Zhang YQ, et al. Analysis on incidence and mortality trends and age-period-cohort of breast cancer in Chinese women from 1990 to 2019. International Journal of Environmental Research and Public Health, 2023, 20(1): 826. DOI:10.3390/ijerph20010826 |

| [4] |

Rakoczy M, McGaughey D, Korenberg MJ, et al. Feature selection in computer-aided breast cancer diagnosis via dynamic contrast-enhanced magnetic resonance images. Journal of Digital Imaging, 2013, 26(2): 198-208. DOI:10.1007/s10278-012-9506-2 |

| [5] |

赫捷, 陈万青, 李霓, 等. 中国女性乳腺癌筛查与早诊早治指南(2021, 北京). 中国肿瘤, 2021, 30(3): 161-191. |

| [6] |

Sriram KV, Havaldar RH. Analytical review and study on object detection techniques in the image. International Journal of Modeling, Simulation, and Scientific Computing, 2021, 12(5): 2150031. DOI:10.1142/S1793962321500318 |

| [7] |

范丽丽, 赵宏伟, 赵浩宇, 等. 基于深度卷积神经网络的目标检测研究综述. 光学 精密工程, 2020, 28(5): 1152-1164. |

| [8] |

Viola P, Jones M. Robust real-time object detection. International Journal of Computer Vision, 2001, 4(34–47): 4.

|

| [9] |

Dalal N, Triggs B. Histograms of oriented gradients for human detection. Proceedings of the 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR'05). San Diego: IEEE, 2005. 886–893.

|

| [10] |

吕璐, 程虎, 朱鸿泰, 等. 基于深度学习的目标检测研究与应用综述. 电子与封装, 2022, 22(1): 010307. |

| [11] |

李柯泉, 陈燕, 刘佳晨, 等. 基于深度学习的目标检测算法综述. 计算机工程, 2022, 48(7): 1-12. |

| [12] |

Redmon J, Divvala SK, Girshick RB, et al. You only look once: Unified, real-time object detection. Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas: IEEE, 2016. 779–788.

|

| [13] |

Redmon J, Farhadi A. YOLO9000: Better, faster, stronger. Proceedings of the 2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Honolulu: IEEE, 2017. 6517–6525.

|

| [14] |

Ioffe S, Szegedy C. Batch normalization: Accelerating deep network training by reducing internal covariate shift. Proceedings of the 32nd International Conference on Machine Learning. Lille: ACM, 2015. 448–456.

|

| [15] |

Ren SQ, He KM, Girshick R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149. DOI:10.1109/TPAMI.2016.2577031 |

| [16] |

Al-Masni MA, Al-Antari MA, Park JM, et al. Simultaneous detection and classification of breast masses in digital mammograms via a deep learning YOLO-based CAD system. Computer Methods and Programs in Biomedicine, 2018, 157: 85-94. DOI:10.1016/j.cmpb.2018.01.017 |

| [17] |

Al-Antari MA, Al-Masni MA, Choi MT, et al. A fully integrated computer-aided diagnosis system for digital X-ray mammograms via deep learning detection, segmentation, and classification. International Journal of Medical Informatics, 2018, 117: 44-54. DOI:10.1016/j.ijmedinf.2018.06.003 |

| [18] |

Al-Antari MA, Al-Masni MA, Kim TS. Deep learning computer-aided diagnosis for breast lesion in digital mammogram. Deep Learning in Medical Image Analysis: Challenges and Applications. Cham: Springer, 2020. 59–72.

|

| [19] |

Baccouche A, Garcia-Zapirain B, Zheng YF, et al. Early detection and classification of abnormality in prior mammograms using image-to-image translation and YOLO techniques. Computer Methods and Programs in Biomedicine, 2022, 221: 106884. DOI:10.1016/j.cmpb.2022.106884 |

| [20] |

赵立新, 邢润哲, 白银光, 等. 深度学习在目标检测的研究综述. 科学技术与工程, 2021, 21(30): 12787-12795. |

| [21] |

Redmon J, Farhadi A. YOLOv3: An incremental improvement. arXiv:1804.02767, 2018.

|

| [22] |

Veit A, Wilber M, Belongie S. Residual networks behave like ensembles of relatively shallow networks. Proceedings of the 30th International Conference on Neural Information Processing Systems. Barcelona: ACM, 2016. 550–558.

|

| [23] |

Lin TY, Dollár P, Girshick R, et al. Feature pyramid networks for object detection. Proceedings of the 2017 IEEE Conference on Computer Vision and Pattern Recognition. Honolulu: IEEE, 2017. 936–944.

|

| [24] |

蒋慧琴, 王博霖, 马岭, 等. 一种双视图信息融合的乳腺肿块自动检测算法. 郑州大学学报(理学版), 2020, 52(4): 28-36. |

| [25] |

徐立芳, 傅智杰, 莫宏伟. 基于改进的YOLOv3算法的乳腺超声肿瘤识别. 智能系统学报, 2021, 16(1): 21-29. |

| [26] |

Baccouche A, Garcia-Zapirain B, Olea CC, et al. Breast lesions detection and classification via YOLO-based fusion models. Computers, Materials & Continua, 2021, 69(1): 1407–1425.

|

| [27] |

Aly GH, Marey M, El-Sayed SA, et al. YOLO based breast masses detection and classification in full-field digital mammograms. Computer Methods and Programs in Biomedicine, 2021, 200: 105823. DOI:10.1016/j.cmpb.2020.105823 |

| [28] |

王杉, 胡艺莹, 丰亮, 等. 基于跨路径特征聚合的改进型YOLOv3乳腺肿块识别算法. 激光与光电子学进展, 2022, 59(4): 0410003. |

| [29] |

Bochkovskiy A, Wang CY, Liao HYM. YOLOv4: Optimal speed and accuracy of object detection. arXiv:2004.10934, 2020.

|

| [30] |

Wang CY, Liao HYM, Wu YH, et al. CSPNet: A new backbone that can enhance learning capability of CNN. Proceedings of the 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops. Seattle: IEEE, 2020. 1571–1580.

|

| [31] |

Liu S, Qi L, Qin HF, et al. Path aggregation network for instance segmentation. Proceedings of the 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Salt Lake City: IEEE, 2018. 8759–8768.

|

| [32] |

Hamed G, Marey M, Amin SE, et al. Automated breast cancer detection and classification in full field digital mammograms using two full and cropped detection paths approach. IEEE Access, 2021, 9: 116898-116913. DOI:10.1109/ACCESS.2021.3105924 |

| [33] |

王杉, 胡艺莹, 詹泽乾, 等. 基于改进YOLOv4的乳腺肿块检测. 制造业自动化, 2023, 45(2): 6-11, 21. |

| [34] |

Kim CM, Hong EJ, Chung K, et al. Health risk detection and classification model using multi-model-based image channel expansion and visual pattern standardization. Applied Sciences, 2021, 11(18): 8621. DOI:10.3390/app11188621 |

| [35] |

Su YY, Liu Q, Xie WT, et al. YOLO-LOGO: A transformer-based YOLO segmentation model for breast mass detection and segmentation in digital mammograms. Computer Methods and Programs in Biomedicine, 2022, 221: 106903. DOI:10.1016/j.cmpb.2022.106903 |

| [36] |

Zhang JX, Tao X, Jiang YH, et al. Application of convolution neural network algorithm based on multicenter ABUS images in breast lesion detection. Frontiers in Oncology, 2022, 12: 938413. DOI:10.3389/fonc.2022.938413 |

| [37] |

Solovyev R, Wang WM, Gabruseva T. Weighted boxes fusion: Ensembling boxes from different object detection models. Image and Vision Computing, 2021, 107: 104117. DOI:10.1016/j.imavis.2021.104117 |

| [38] |

Hara K, Kataoka H, Satoh Y. Can spatiotemporal 3D CNNs retrace the history of 2D CNNs and ImageNet. Proceedings of the 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Salt Lake City: IEEE, 2018. 6546–6555.

|

| [39] |

李珊珊, 张曦, 刘文, 等. 一种乳腺X线影像肿块征象检测算法. 小型微型计算机系统: 1–8. http://kns.cnki.net/kcms/detail/21.1106.TP.20221018.1339.036.html. (2023-04-22).

|

| [40] |

Meng MZ, Zhang M, Shen D, et al. Detection and classification of breast lesions with You Only Look Once version 5. Future Oncology, 2022, 18(39): 4361-4370. |

| [41] |

Ge Z, Liu ST, Wang F, et al. YOLOX: Exceeding YOLO series in 2021. arXiv:2107.08430, 2021.

|

| [42] |

Wang CY, Yeh IH, Liao HYM. You only learn one representation: Unified network for multiple tasks. Journal of Information Science and Engineering, 2023, 39(2): 691-709. |

| [43] |

Long X, Deng KP, Wang GZ, et al. PP-YOLO: An effective and efficient implementation of object detector. arXiv:2007.12099, 2020.

|

| [44] |

Huang X, Wang XX, Lv WY, et al. PP-YOLOv2: A practical object detector. arXiv:2104.10419, 2021.

|

| [45] |

Xu SL, Wang X, Lv WY, et al. PP-YOLOE: An evolved version of YOLO. arXiv:2203.16250, 2022.

|

| [46] |

Li CY, Li LL, Jiang HL, et al. YOLOv6: A single-stage object detection framework for industrial applications. arXiv:2209.02976, 2022.

|

| [47] |

Wang CY, Bochkovskiy A, Liao HYM. YOLOv7: Trainable bag-of-freebies sets new state-of-the-art for real-time object detectors. Proceedings of the 2023 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Vancouver: IEEE, 2023. 7464–7475.

|

| [48] |

Ding XH, Zhang XY, Ma NN, et al. RepVGG: Making VGG-style convnets great again. Proceedings of the 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Nashville: IEEE, 2021. 13728–13737.

|

| [49] |

Gevorgyan Z. SIoU loss: More powerful learning for bounding box regression. arXiv:2205.12740, 2022.

|

| [50] |

Wang CY, Liao HYM, Yeh IH. Designing network design strategies through gradient path analysis. Journal of Information Science and Engineering, 2023, 39(3): 975-995. |

| [51] |

Vaswani A, Shazeer N, Parmar N, et al. Attention is all you need. Proceedings of the 31st International Conference on Neural Information Processing Systems. Long Beach: ACM, 2017. 6000–6010.

|

| [52] |

王琳毅, 白静, 李文静, 等. YOLO系列目标检测算法研究进展. 计算机工程与应用, 2023, 59(14): 15-29. |

| [53] |

陈智丽, 高皓, 潘以轩, 等. 乳腺X线图像计算机辅助诊断技术综述. 计算机工程与应用, 2022, 58(4): 1-21. |

| [54] |

张素素. 网页版乳腺癌计算机辅助诊断系统研究[硕士学位论文]. 南宁: 广西大学, 2022.

|

2023, Vol. 32

2023, Vol. 32