2. 南京理工大学 计算机科学与工程学院, 南京 210094

2. School of Computer Science and Engineering, Nanjing University of Science and Technology, Nanjing 210094, China

轨迹预测任务需要从带噪声的观测中估计目标真实的运动状态, 推理出目标未来的运动轨迹[1]. 移动目标轨迹预测在智能交通[2]、自动驾驶[3]、飞行器拦截[4]等领域具有巨大的研究前景和应用价值. 早期的轨迹预测研究大多先通过归一化、滑动平均[5]、小波分解[6]等数据预处理方法整合提取数据的特征, 帮助模型训练; 再使用一些概率统计方法进行预测. 如差分自回归移动平均模型[7]、卡尔曼滤波器[8]、隐马尔科夫模型[9], 贝叶斯网络[10]等. 然而, 这样的做法经常会导致预测效果取决于预处理效果的问题, 淡化了模型本身的作用, 使模型缺乏普适性[11]. 此外, 在面对复杂、长期的非线性轨迹时, 传统的模型无法对点迹间的相互依赖进行有效建模.

对轨迹序列的预测任务可以看作是对多变量时间序列的处理. 基于神经网络的许多方法已运用于时间序列预测领域. 1986年, Elman等人提出循环神经网络(RNN), 通过递归推理处理序列, 学习序列的非线性特征[12]. 1997年, Hochreiter等人提出长短期记忆力网络(LSTM), 在隐藏层中使用门机制, 记忆门记忆有效信息, 遗忘门遗忘不重要的信息, 缓解RNN梯度消失和爆炸的问题, 并能处理较长的依赖[13]. 但在处理时间跨度更大的任务时, LSTM难以保持长期的依赖, 随着序列的增加, 梯度仍会消失.

Cho等人[14]提出了Seq2Seq结构, 通过编码器(encoder)将输入序列的上下文特征编码为隐藏状态向量c, 解码器(Decoder)将隐藏状态向量c解码, 预测目标序列, 使模型可以应对输入序列和输出序列不等长的情况. DeepAR[15]将Seq2Seq架构与LSTM结合, 使用两个LSTM模块分别作为网络的编码器和解码器, 进行时间序列预测; 但递归式模型的向量c只能由输入序列中最近一个字符的隐藏状态的非线性变换得到, 先前的信息将随着序列长度增加而减少, 难以包含全局的上下文信息. Transformer引入自注意力(self-attention)机制进行编码和解码. 评估点迹间的相关性, 并以此来对上下文分配注意力, 进行全局信息建模[16], 但预测时编码器的递归推理会造成误差累积, 随着序列变长, 精度急剧下降. Informer[17]开创性地使用生成式的推理过程进行序列预测, 一次生成所有的预测轨迹. 解决了误差累积问题, 加快了模型训练的速度, 更适合长序列的预测.

目前已经有许多工作将生成对抗网络(GAN)运用到序列预测任务中, ForGAN[18]将历史轨迹数据作为标签, 通过输入噪声拟合真实未来轨迹的分布, 形成一个Conditional GAN[19]. 但由基于RNN的网络构成的生成器和判别器难以学习非线性序列之间的复杂模式. Wu等人[20]将Transformer与GAN相结合, 将Transformer作为生成器生成预测轨迹, 判别器进一步拟合真实轨迹的分布, 以期减小累积误差. 然而, 全连接网络构成的判别器提取特征能力有限, 难以向生成器提供有效的后验信息和稳定的梯度反馈.

目前移动目标轨迹预测领域的热点主要集中在行人和车辆等交通网络中的多变量轨迹预测. 除了目标的历史轨迹外, 研究很大程度上依靠可观察到的外部环境激励信息. Shafiee等人[21]通过对道路的几何场景等静态物理信息以及其他行人和车辆的动态交互信息进行建模来辅助预测, Wu等人[11]利用滑动平均方法强化时间序列的周期性以提升预测精度. 将外部因素作为协变量和轨迹信息一同输入模型, 期望从多维度原始数据端到端地学习目标的运动意图以提升轨迹预测的效果. 但对于船舶等二维移动目标和飞行器等三维移动目标来说, 天气、洋流、磁场等外部信息难以进行建模, 在时序信息中往往只能表现为状态噪声; 同时还受到雷达探测的观测噪声影响, 使观测轨迹失真, 难以捕捉运动意图. 现有的模型难以在这些任务上取得良好的效果, 而对此的研究又是十分必要的. 因此, 我们通过动力学建模和仿真, 建立了一个DT数据集. 作为上述单变量轨迹预测问题训练和验证的新基准, 并在此验证了本文模型的效果.

本文主要的贡献可以概括如下.

(1)提出时频域信息融合编码器, 在两个通道分别建模输入轨迹的时域信息和时频域信息, 将小波分解嵌入模型中, 配合频域自注意力提取低频趋势特性, 与时域上下文依赖融合, 增强模型建模长期趋势的能力.

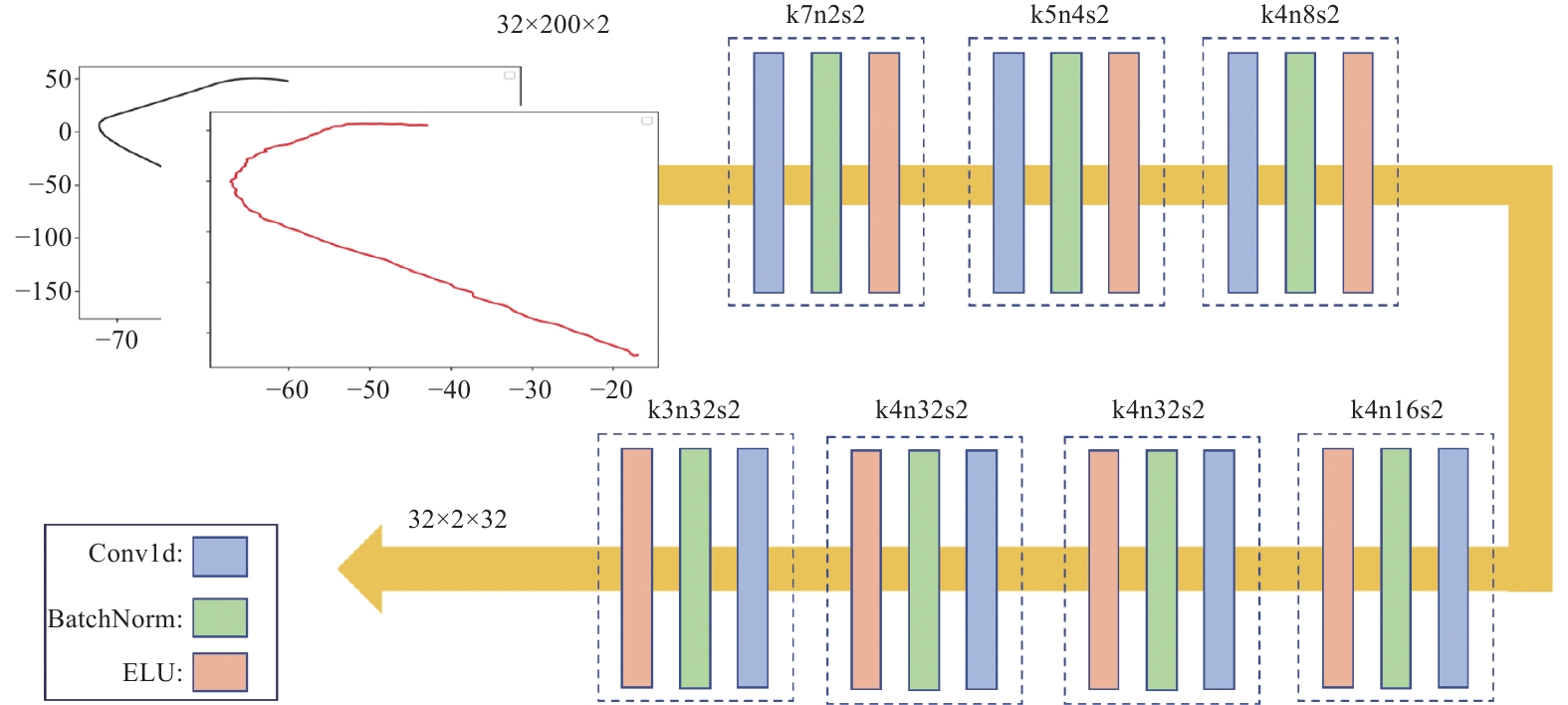

(2)使用一种多尺度卷积判别器网络, 学习捕捉序列之间的多尺度局部动态特征, 通过对抗训练拟合真实轨迹, 提升序列级精度.

(3)在长期轨迹预测数据集DT上与相关的先进算法进行比较, 取得了最好的效果. 验证了模型的有效性.

1 相关工作 1.1 离散小波变换小波变换是序列预测领域最常见的数据分解方法之一. 通过选取恰当的小波基函数, 小波变换可以使信号在时间域和频率域上都体现出良好的局部特性, 从而较好地从信号中获取到信息, 克服Fourier变换不能处理序列中突变和非平稳信息的缺点[22].

小波变换有两个变量: 尺度因子

| $ a = a_0^j, \; b = ka_0^j{b_0} $ | (1) |

其中,

| $ {\psi _{j, k}}(t) = {a^{ - \frac{1}{2}}}\psi (a_0^{ - j}t - k{b_0}) $ | (2) |

小波变换的完整公式如式(3)所示.

| $ {W_f}(j, k) = {a^{ - \frac{1}{2}}}\int {f(t)*\overline {{\psi _{j, k}}(t)} dt} $ | (3) |

通过小波分解, 可以得到一个趋势序列和一个细节序列. 具体分解公式如式(4)和式(5)所示.

| $ {a_{j + 1}} = G{a_j}, \; j = 1, 2, \cdots, N $ | (4) |

| $ {d_{j + 1}} = H{a_j}, \; j = 1, 2, \cdots, N $ | (5) |

其中,

Transformer将自注意机制与Seq2Seq架构相结合. 自注意机制可以根据关联程度向序列中的其他点分配注意力, 加强网络的特征提取能力. 具体地, 将输入乘以不同的权重矩阵, 得到可学习的查询

| $ Attention(Q, K, V) = {\textit{Softmax}}\left(\frac{{Q{K^{\rm{T}}}}}{{\sqrt {{d_k}} }}\right)V $ | (6) |

生成对抗网络由一个生成器G和一个判别器D组成, 生成器接收一个随机噪声

| $ \begin{split} & \arg {{\rm{min}} _G}{{\rm{max}} _D}{E_{x\sim{p_{data}}(x)}}[\log D(x)] + \\ &\qquad\qquad\quad {E_{{\textit{z}}\sim{p_{\textit{z}}}({\textit{z}})}}[\log (1 - D(G({\textit{z}})))] \end{split} $ | (7) |

其中,

通过对抗训练, G的生成能力和D的判别能力都会越来越强, 最终G足以以假乱真, 达到“纳什均衡”状态, 使网络能够拟合真实数据的分布.

2 本文方法 2.1 整体架构模型总体为Seq2Seq架构, 生成器由改进的Transformer构成, 观测序列输入encoder后首先进行升维, 将2维或3维的轨迹提高为512维, 提取高维隐藏状态; 再使用绝对位置编码方式对序列顺序进行编码, 如式(8)所示.

| $ \left\{\begin{split} & P{E_{(pos, 2j)}} = \sin (pos/{(2L)^{\frac{{2j}}{d}}}), \\ & P{E_{(pos, 2j + 1)}} = \cos (pos/{(2L)^{2j/d}}),\\ & j = 1, 2, \cdots, d/2 \end{split}\right. $ | (8) |

其中,

编码器分为时域和时频域两个通道[24]. 时频域通道做一次时域注意后堆叠3个时频域注意模块. 该模块通过小波分解和自注意力机制建模观测序列的低频趋势特性. 仅使用序列的频谱可能会导致时域信息的损失, 因此在另一个通道使用时域注意模块补偿全局时域序列信息. 最后将双通道信息进行融合, 馈入解码器.

在时域通道中, 自注意机制编码时域的全局上下文信息; 前馈神经网络将数据映射到高维, 获取更多的隐藏信息. 层归一化有助于网络层的稳定, 并起到正则化的作用. 通过残差连接, 可以降低模型复杂度, 减少过拟合.

一般信号在频域上相对时域更加稀疏, 且在高频部分的大量信息是所谓“噪声”. 在图像领域, 这些噪声可能是形状的边缘, 代表图片重要的细节. 但在轨迹预测问题上, 噪声往往由观测精度不够或外部环境干扰等原因造成, 无法进行预测[25], 轨迹的长期趋势信息则大部分位于低频. 因此, 本文在频域通过小波变换分离轨迹的高低频分量, 将每次变换后的高频噪声分量丢弃, 对低频信息做进一步的处理.

与传统“预处理+模型”的模式不同, 本文使用Kymatio方法[26], 可以将小波分解嵌入神经网络框架之中, 参与反向传播. 在得到小波分解下的低频信息后, 在频域运用自注意机制, 建模频域特征信息之间的长期依赖, 提取表征趋势的信息, 实现可学习的自适应滤波[27], 进一步强化低频长期趋势依赖.

为了最大程度地刻画时间序列的不规则信息, 时频域选取具有正交性和紧支撑性的“sym8”小波[28]进行离散小波分解, 这个过程可以将向量长度减半, 有效地提取出序列内在的趋势信息. 经过3层的小波分解-自注意力级联, 舍弃各阶段的高频噪声, 得到自适应滤波后的低频频域特征.

|

图 1 网络结构 |

最后,

| $ {X_{{\rm{output}}}} = {\text{Conv1d}}(Concat(X_{{\rm{output}}}^t, MLP(X_{{\rm{output}}}^f))) $ | (9) |

为了进一步提升模型的预测精度, 弥补编码器在短期动态特征建模的欠缺, 模型采用生成对抗网络结构, 通过对抗训练进一步拟合真实的轨迹. 并且, 为了解决传统判别器中全连接网络提取特征能力有限的问题, 将其改进为由全卷积神经网络构成的多尺度判别器[29], 可以有效地提取序列在各个尺度的局部特征信息.

网络结构如图2所示, 由若干个卷积模块构成, 卷积的步长为2, 卷积核大小从

|

图 2 多尺度卷积判别器 |

在单一的生成网络之下, 模型会因过于拟合趋势特性而得到钝化、平缓的结果. 通过在判别器中与ground truth的“动态博弈”过程, 网络可以在不受突变、噪声影响的条件下学习到真实轨迹所具备的局部动态特征, 实现长期趋势与短期特征的均衡表征.

2.4 损失函数为了能将基于Transformer的生成器与对抗训练有效结合, 我们使用了内容损失

| $ {l_G}(\hat Y, Y) = \dfrac{{\displaystyle\sum\limits_{l = 1}^{\vartriangle L} {\displaystyle\sum\limits_{i = 1}^m {{{(\hat Y_l^i - Y_l^i)}^2}} } }}{{\vartriangle L \times m}} $ | (10) |

其中,

多尺度判别器网络的对抗损失函数如式(11)所定义.

| $ \begin{split} {{\rm{min}} _{{\theta _G}}}{{\rm{max}} _{{\theta _D}}}{l_D}({\theta _G}, {\theta _D}) = \frac{1}{N}\sum\limits_{n = 1}^N {{l_{{{mae}}}}({f_D}(G({x_n}), {f_D}({y_n}))} \\ \end{split} $ | (11) |

其中,

| $ \begin{gathered} {l_{mae}}({f_D}(G({x_n}), {f_D}({y_n})) = \frac{1}{L}\sum\limits_{i = 1}^L {||f_D^i(G({x_n})) - f_D^i({y_n})|{|_1}} \\ \end{gathered} $ | (12) |

其中,

| $ l = {l_G} + \lambda {l_D} $ | (13) |

在训练过程中, 采用两个网络交替训练的策略. 首先训练生成器, 在固定判别网络梯度的情况下, 优化生成器网络, 使得生成器输出的序列能够在多尺度上拟合真实轨迹, 即最小化网络总的损失. 接着训练判别器, 在固定生成器对其的输入的情况下, 优化判别器网络, 增强网络对两种轨迹的特征提取和区分能力, 即最大化对抗损失. 不断重复上述过程, 随着训练的进行, 生成器和判别器网络都变得越来越强大. 多次训练后, 判别器能够识别真假轨迹的细微差异, 生成器能够很好地学习拟合轨迹的多尺度特征.

3 实验与分析通过运动学建模和仿真, 我们建立并公开了DT数据集, 作为轨迹预测任务的新基准.

数据集包括二维和三维空间的模拟轨迹, 每个空间包含100000条轨迹的观测值和真实值, 长度均为500个点. 将数据集按照8:1:1的比例进行训练、验证和测试.

在训练阶段, 使用Adam作为优化器, 初始学习率设置为1E–4, 每2个epoch衰减一半, batchsize设置为32, 最终实验结果来自多次实验的平均值. 所有实验都在GTX TITAN 12 GB GPU上运行.

在轨迹预测任务中, 对我们的方法进行了验证. 基准模型包括以下序列预测问题的先进方法, RNN、LSTM、Transformer、LogTrans[30]、Performer[31]和Informer. 由于实验所需预测的轨迹较长, 递归式推理方法会导致内存爆炸, 无法进行实验, 本文的所有模型均采用Informer所使用的生成式推理方法.

3.1 轨迹预测任务轨迹预测任务需要根据观测到的历史轨迹, 推理出目标后续的运动状态. 轨迹预测可分为中期预测和长期预测, 受到误差传播、非线性动力学的复杂模式和不确定性的影响, 长期预测更为困难. 在2D和3D的数据集上, 我们各进行中期和长期的预测实验. 具体地, 中期预测通过400个观测点推测未来100个点, 长期预测通过200个观测点推测未来300个点. 实验比较轨迹预测领域传统的评价指标平均位移误差ADE和终点位移误差FDE[32]. ADE表示所有轨迹的预测点和实际点间的均方误差, FDE表示预测的轨迹目的地和真实目的地的距离, 两个指标越小, 说明预测的效果越好. 计算公式如式(14)和式(15)所示, 其中,

| $ ADE = \frac{{\displaystyle\sum\limits_{n = 1}^N {\displaystyle\sum\limits_{l = 1}^{\vartriangle L} {||\hat Y_l^n - Y_l^n|{|_2}} } }}{{N \times \Delta L}} $ | (14) |

| $ FDE = \frac{{\displaystyle\sum\limits_{n = 1}^N {||\hat Y_l^n - Y_l^n|{|_2}} }}{N}, \; l = \Delta L $ | (15) |

2D数据集上的实验结果如表1所示. 可以看出, 在长期和中期的预测任务中, 我们的方法均取得了最好的效果. 在长期预测中, ADE提升了4.1%–18.5%, FDE提升了17.5%–46%; 在中期预测中, ADE提升了8.1%–55%, FDE提升了16%–54.5%.

3D数据集上的预测结果在表2中列出, 我们的方法同样取得了良好的效果. 在长期预测中, ADE提升了2.4%–15.8%, FDE提升了11.7%–37%; 在中期预测中, ADE提升了9.2%–48.4%, FDE提升了15.9%–54.5%.

2D数据集长期预测的可视化结果如图3所示. 通过分析可知, 本文提出的方法在两种场景下的中长期轨迹预测任务中均取得了最好的效果.

| 表 1 2D数据集轨迹预测任务 |

| 表 2 3D数据集轨迹预测任务 |

|

图 3 2D数据集长期轨迹预测效果图 |

3.2 消融实验

为了分析每个模块对网络模型产生的影响, 本文在2D数据集上进行长期轨迹预测消融实验. 变量分别为频域注意力模块(frequency domain attention, FDA), 时频域信息融合模块(time frequency fusion, TFF), 多尺度判别器模块(multi scale discriminator, MSD). 将Transformer作为基准模型, 所有模型同样均采用生成式推理方法. 消融实验的最终结果如表3所示.

| 表 3 2D数据集长期轨迹预测消融实验 |

结果表明, 通过时频域自适应滤波聚焦长期趋势是提升模型预测效果的有效方法, 多尺度判别器也能通过对抗训练优化网络参数. 并且, 通过将两个模块结合, 兼顾上下文长期趋势和多尺度细节特性, 可以取得更好的预测效果.

4 结论与展望本文提出了一种基于时频域信息融合和多尺度对抗训练的目标轨迹预测方法. 首先建立时域和时频域两个通道. 通过小波分解和自注意机制在时频域进行自适应滤波, 提取轨迹低频趋势特性; 时域通过注意力机制建模长期上下文依赖. 然后将两个通道的信息融合. 最后通过一个全卷积判别器建模轨迹的多尺度短期微运动表示, 进一步拟合真实轨迹. 在轨迹预测任务上的实验结果表明, 本文提出的方法在性能上优于相对比的方法, 证明了本文方法的有效性.

| [1] |

Zhao JX, Xu H, Wu JQ, et al. Trajectory tracking and prediction of pedestrian’s crossing intention using roadside LiDAR. IET Intelligent Transport Systems, 2019, 13(5): 789-795. DOI:10.1049/iet-its.2018.5258 |

| [2] |

路宏广, 赵树恩. 基于鲁棒模型预测的智能汽车轨迹跟踪控制研究. 系统仿真学报, 2022, 34(1): 153-162. |

| [3] |

高秀龙, 葛动元. 基于自动驾驶系统的轻量型卷积神经网络优化. 计算机系统应用, 2020, 29(3): 93-99. DOI:10.15888/j.cnki.csa.007320 |

| [4] |

Li F, Xiong JJ, Lan XH, et al. Hypersonic vehicle trajectory prediction algorithm based on Hough transform. Chinese Journal of Electronics, 2021, 30(5): 918-930. DOI:10.1049/cje.2021.07.003 |

| [5] |

Wang CJ, Ma L, Li RP, et al. Exploring trajectory prediction through machine learning methods. IEEE Access, 2019, 7: 101441-101452. DOI:10.1109/ACCESS.2019.2929430 |

| [6] |

Liu Y, Guan L, Hou C, et al. Wind power short-term prediction based on LSTM and discrete wavelet transform. Applied Sciences, 2019, 9(6): 1108. DOI:10.3390/app9061108 |

| [7] |

Liu CH, Hoi SCH, Zhao PL, et al. Online ARIMA algorithms for time series prediction. Proceedings of the 30th AAAI Conference on Artificial Intelligence. Phoenix: ACM, 2016. 1867–1873.

|

| [8] |

Abbas MT, Jibran MA, Afaq M, et al. An adaptive approach to vehicle trajectory prediction using multimodel Kalman filter. Transactions on Emerging Telecommunications Technologies, 2020, 31(5): e3734. |

| [9] |

Zhang XY, Liu G, Hu C, et al. Wavelet analysis based hidden Markov model for large ship trajectory prediction. Proceedings of the 2019 Chinese Control Conference (CCC). Guangzhou: IEEE, 2019. 2913–2918.

|

| [10] |

Zhang XG, Mahadevan S. Bayesian neural networks for flight trajectory prediction and safety assessment. Decision Support Systems, 2020, 131: 113246. DOI:10.1016/j.dss.2020.113246 |

| [11] |

Wu HX, Xu JH, Wang JM, et al. Autoformer: Decomposition transformers with auto-correlation for long-term series forecasting. Proceedings of the 34th Advances in Neural Information Processing Systems. NeurIPS, 2021. 22419–22430.

|

| [12] |

巩传江, 臧德厚, 郭金, 等. 基于小波卷积网络的高光谱图像分类. 计算机系统应用, 2023, 32(7): 23-34. DOI:10.15888/j.cnki.csa.009186 |

| [13] |

Hochreiter S, Schmidhuber J. Long short-term memory. Neural Computation, 1997, 9(8): 1735-1780. DOI:10.1162/neco.1997.9.8.1735 |

| [14] |

Cho K, van Merriënboer B, Gulcehre C, et al. Learning phrase representations using RNN encoder-decoder for statistical machine translation. Proceedings of the 2014 Conference on Empirical Methods in Natural Language Processing. Doha: ACL, 2014. 1724–1734.

|

| [15] |

Salinas D, Flunkert V, Gasthaus J, et al. DeepAR: Probabilistic forecasting with autoregressive recurrent networks. International Journal of Forecasting, 2020, 36(3): 1181-1191. DOI:10.1016/j.ijforecast.2019.07.001 |

| [16] |

Vaswani A, Shazeer N, Parmar N, et al. Attention is all you need. Proceedings of the 31st International Conference on Neural Information Processing Systems. Long Beach: ACM, 2017. 6000–6010.

|

| [17] |

Zhou HY, Zhang SH, Peng JQ, et al. Informer: Beyond efficient transformer for long sequence time-series forecasting. Proceedings of the 2021 AAAI Conference on Artificial Intelligence. AAAI, 2021. 11106–11115.

|

| [18] |

Koochali A, Schichtel P, Dengel A, et al. Probabilistic forecasting of sensory data with generative adversarial networks—ForGAN. IEEE Access, 2019, 7: 63868-63880. DOI:10.1109/ACCESS.2019.2915544 |

| [19] |

Mirza M, Osindero S. Conditional generative adversarial nets. arXiv:1411.1784, 2014.

|

| [20] |

Wu SF, Xiao X, Ding QG, et al. Adversarial sparse transformer for time series forecasting. Proceedings of the 34th International Conference on Neural Information Processing Systems. Vancouver: IEEE, 2020. 17105–17115.

|

| [21] |

Shafiee N, Padir T, Elhamifar E. Introvert: Human trajectory prediction via conditional 3D attention. Proceedings of the 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Nashville: IEEE, 2021. 16810–16820.

|

| [22] |

申莎莎. 基于小波变换与傅里叶变换对比分析及其在信号去噪中的应用. 山西师范大学学报(自然科学版), 2018, 32(3): 27-32. |

| [23] |

王雪阳, 刘茜. 融合变道意图识别的车辆轨迹预测GAN模型. 计算机系统应用, 2023, 32(4): 354-360. DOI:10.15888/j.cnki.csa.009040 |

| [24] |

Jin BB, Hu Y, Tang QK, et al. Exploring spatial-temporal multi-frequency analysis for high-fidelity and temporal-consistency video prediction. Proceedings of the 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Seattle: IEEE, 2020. 4553–4562.

|

| [25] |

Zhou T, Ma ZQ, Wen QS, et al. FEDformer: Frequency enhanced decomposed transformer for long-term series forecasting. Proceedings of the 39th International Conference on Machine Learning. Baltimore: PMLR, 2022. 27268–27286.

|

| [26] |

Andreux M, Angles T, Exarchakisgeo G, et al. Kymatio: Scattering transforms in python. The Journal of Machine Learning Research, 2020, 21(1): 60. |

| [27] |

Zhou SB, Pan Y. Spectrum attention mechanism for time series classification. Proceedings of the 10th IEEE Data Driven Control and Learning Systems Conference (DDCLS). Suzhou: IEEE, 2021. 339–343.

|

| [28] |

章浙涛, 朱建军, 卢骏, 等. 小波变换在时间序列特征提取中的应用. 测绘工程, 2014, 23(6): 21-26. |

| [29] |

Xue Y, Xu T, Zhang H, et al. SegAN: Adversarial network with multi-scale L1 loss for medical image segmentation

. Neuroinformatics, 2018, 16(3): 383-392. |

| [30] |

Li SY, Jin XY, Xuan Y, et al. Enhancing the locality and breaking the memory bottleneck of transformer on time series forecasting. Proceedings of the 33rd International Conference on Neural Information Processing Systems. Vancouver: NeurIPS, 2019. 5244–5254.

|

| [31] |

Choromanski KM, Likhosherstov V, Dohan D, et al. Rethinking attention with performers. Proceedings of the 9th International Conference on Learning Representations. ICLR, 2020.

|

| [32] |

Liang M, Yang B, Hu R, et al. Learning lane graph representations for motion forecasting. Proceedings of the 16th European Conference on Computer Vision. Glasgow: Springer, 2020. 541–556.

|

2023, Vol. 32

2023, Vol. 32