交通事故是当前驾车出行不可忽视的隐患之一. 交通事故处理不当会导致严重的交通拥堵, 严重增加了人们出行所消耗的时间, 交通治理面临着巨大挑战[1]. 而大多数交通事故只是轻微的碰撞, 不涉及人员伤亡, 仅对双方造成轻微的财产损失. 轻微事故大多发生在城市道路中, 处理这类事故往往需要快速理赔流程, 但是有些司机在事故发生后不按规定撤离现场, 事故双方在马路上理论, 造成车道后方车辆因事故车辆占道引发的拥堵, 给后方车辆造成了很大麻烦. 因此实现快速交通事故检测及责任判定是非常有必要的. 传统的交通事故识别是在全天候采集的视频数据中查找的, 庞大的数据量给人工读取视频信息带来了诸多不便[2]. 如果能够利用计算机视觉技术快速检测交通事故并对事故双方的责任进行划分, 使事故双方快速驶离现场, 有助于保持道路畅通, 防止发生二次事故.

目前, 交通事件检测技术例如模式识别、神经网络、支持向量机等[3-5]都在该领域取得了不同程度的成果. Kisa等人[6]通过对连续的图像序列进行相减操作, 提取出动态车辆之间的相对速度以及距离等信息, 最后通过计算碰撞时间, 对车辆碰撞事件进行检测. Isaloo等人[7]提出了基于车辆运动轨迹的交通事故检测模型, 通过对十字路口处车辆的正常运动轨迹和异常运动轨迹进行学习, 从而对交通事故进行检测. 拜佩等人[8]利用计算机视觉对视频中车辆的运动状态进行分析, 然后分析运动信息判断两个目标物体是否有重叠区域, 从而对车辆碰撞事件进行检测. 上述方法都在一定程度上实现了交通事故的检测, 但只是实现了交通事故检测, 不涉及后续的快速理赔环节, 无法细致到事故车辆责任判定. 并未解决事故车辆快速撤离现场, 无法达到交通拥堵治理的目的. 综上, 本文设计出了一种结合轻量级检测算法SSD和目标分类网络MobileNet的车辆检测模型. 通过车辆行为分析及场景检测方法证明了该模型在快速检测事故及责任判定的可行性.

1 需求分析及系统流程 1.1 需求分析本文所研究的内容来源于项目《交通视频大数据的深度分析及其在拥堵治理中的综合应用》. 项目提出从道路口交通流量计算, 交通事故自动检测与判责, 违停车辆实时检测和公交车的上下车人数统计4个子系统进行视频数据分析, 输出交通状态参数到控制系统, 用于信号灯控制、事件报警或公交线路优化调控等, 达到综合治理拥堵的目的. 本文是对道路上发生的事故进行检测及责任判定, 使事故车辆快速驶离现场, 如果没有及时清理事故车辆造成交通堵塞, 每年会带来约300亿元的工人时间价值损失和燃料消耗损失[9]. 本文提出一种采用视频图像处理为核心方法, 针对视频监控获得的车辆信息做进一步的数据分析, 快速提取车辆在道路中的行为信息, 如速度运动方向等, 对交通事故进行检测并在后续进行责任判定. 为后续快速理赔流程提供建议, 快速处理事故, 预防交通拥堵, 降低二次事故带来的经济损失.

1.2 系统设计流程车辆碰撞检测及责任判定系统流程如图1所示. 首先采用MobileNet轻量级网络结合SSD算法, 形成检测速度快、精度高的SSD-MobileNet模型, 实现车辆目标识别与检测. 随后借助卡尔曼滤波器的目标预测和特征匹配功能获取车辆的运动状态信息, 实现车辆跟踪, 并通过相机标定实现像素坐标到世界坐标的转换, 计算车辆在一定时间内位移得到车辆速度, 接着分析车辆发生碰撞产生的矩形框和矩形框交并比的关系, 对视频中是否发生交通事故做出判断. 最后对车辆发生事故的场景及在该场景中的行为进行分析, 根据《中华人民共和国道路安全法实施条例》及《机动车事故快速处理办法》对发生事故进行分类与责任判定.

|

图 1 碰撞检测识别及判责系统总流程 |

2 车辆目标检测算法 2.1 车辆目标检测

SSD目标检测模型是使用单阶段的目标检测方法的多框预测模型. 由于目标检测中图像中的目标有简单的有复杂的, SSD目标检测模型采用不同尺度的特征图产生不同尺度预测的方法, 有效地提高了检测精度[10].

MobileNet是一种轻量级网络, 具有体积小, 计算量少, 精度高的特点, 应用到目标分类及目标检测中可以大大减少计算量和模型参数. 因此使用MobileNet网络可以实现低延迟、高精度的检测效果[11].

在SSD网络框架上使用轻量级卷积神经网络MobileNet, 代替SSD框架的基础网络VGG16, 并将MobileNet网络中的全连接层和Softmax层去掉, 接着在Conv13后增加8个卷积层, 为提高网络训练的收敛速度, 防止过拟合现象, 在每个卷积层后添加BN层和ReLU层. 得到的SSD-MobileNet模型可以完成视频图像的特征提取工作[12]. 其结构模型如图2所示.

|

图 2 SSD-MobileNet网络结构模型 |

SSD-MobileNet网络模型利用Conv11、Conv13、Conv14_2、Conv15_2、Conv16_2、Conv17_2六个卷积层进行目标检测, 在进行特征提取的过程中采用特征金字塔获取这6个卷积层的特征信息, 进行多尺度多目标的目标检测. SSD-MobileNet模型将输入的图像大小归一化为300×300, 通过卷积和池化的操作, 进行目标的分类和候选框的回归.

2.2 coco数据集识别视频中的车辆识别车辆目标时使用coco数据集, coco数据集是微软标注的一款数据集, 具有权威性, 是一个丰富的物体检测、分割和字母数据集[13]. 通过网络模型对coco数据集中的车辆进行训练, 对日常生活中监控视频中最常发生事故的车辆进行标注, 分类为轿车和卡车, 训练过程中采用图像数据归一化的方法来加速训练网络的收敛性, 可以通过归一化操作加快学习速度. 使用SSD-MobileNet模型对数据集中的轿车和卡车进行检测识别, 其中, 轿车的检测精确度为98.1%, 卡车的检测精确度为97.5%. 针对视频车辆的检测结果如图3.

|

图 3 车辆目标检测结果 |

3 基于卡尔曼滤波器的车辆跟踪

使用SSD-MobileNet模型可以检测到视频中车辆在每一帧中的位置和大小等信息, 要获得目标车辆更多的动态信息, 就需要对车辆进行目标跟踪. 在进行目标跟踪模块中, 采用基于卡尔曼滤波器设计了车辆目标跟踪模型[14].

首先创建卡尔曼滤波器运动模型, 在第一次滤波时, 对被跟踪车辆、目标检测框进行参数初始化操作. 后将检测到的运动目标初始特征值作为初始观测向量输入滤波器, 进行目标预测. 滤波器可以根据视频中相邻两帧图像间的时间间隔来确定过程矩阵中的时间参数, 并根据过程矩阵和状态向量带入卡尔曼滤波器预测过程的公式:

| ˆXk=Fk׈Xk−1+Bk×⇀Uk |

其中,

| Pk=Fk×Pk−1×FTk+Qk |

其中,

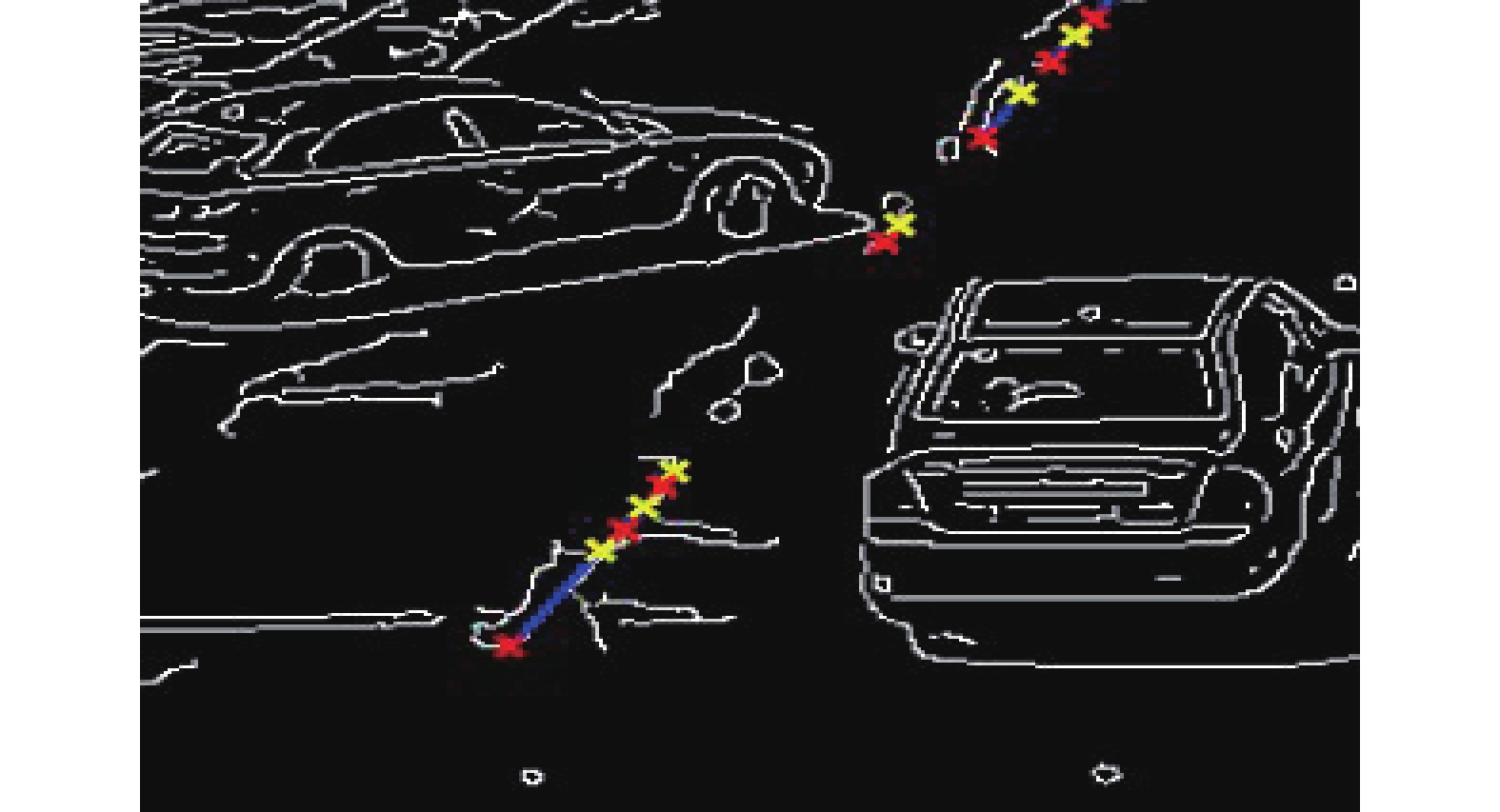

|

图 4 车辆跟踪结果 |

4 车辆碰撞检测算法 4.1 车辆速度检测

车辆速度检测是车辆很重要的信息, 通过速度检测可以得知车辆是否存在超速等行为. 对输入视频的车辆进行测速, 需要根据视频中车辆发生的位移, 通过摄像机标定建立图像像素坐标与空间对应点的世界坐标的映射关系, 求出车辆实际的位移.

通过矩形框横纵坐标

| GU=U1+(U1−U2)/2 |

| GV=V1+(V1−V2)/2 |

随后进行坐标变换, 从像素坐标到相机坐标进行内参变换:

| Pcamera(3×1)=Tpixel−1camera(3×3)×Ppixel(3×1)×depth |

其中,

| Pworld(4×1)=Tcamera−1world(4×4)×Pcamera(4×1) |

其中,

| S(GUGV1)=(fx0cy0fycy001)(r11r12r13t1r21r22r23t2r31r32r33t3)(XYZ1) |

右侧第1个矩阵为相机内参数矩阵, 第2个矩阵为相机外参数矩阵. 因为变换坐标后车辆在

|

图 5 坐标转换结果 |

计算车辆速度采用帧差法[15], 通过计算视频10帧

| S=√(X2−X1)2+(Y2−Y1)2 |

| T=P10/fps |

| V=S/T |

如图6所示, 视频

| T=10/26.03=0.384 |

车辆1位移为3.72, 速度为:

| V=3.72/0.384=9.68 |

车辆2位移为7.04, 速度为:

| V=1.04/0.384=18.33 |

|

图 6 车辆速度检测结果 |

4.2 车辆碰撞检测

通过所述方法实现了对车辆目标检测以及跟踪, 得到了运动车辆的目标检测框、位置、轨迹及速度等信息. 后续进行车辆碰撞检测, 提出了一种基于车辆目标检测矩形框交并比的方法来检测车辆碰撞.

在发生车辆碰撞时, 会产生矩形框的交叠, 因而在发生碰撞时两辆车的交并比会增大, 通过观察分析发生碰撞时两矩形框的交叠部分, 当两辆车的矩形框交并比

| 0.05<IOU=S12/(S1+S2−S12)<0.4 |

则认定两辆车发生了碰撞.

| IOU=6400/(23754+31800−6400)=0.131 |

0.131在所设定的阈值范围内, 可以判断发生了碰撞. 同样的可以得到变道事故中辆车辆的

|

图 7 车辆碰撞检测结果 |

4.3 车道线检测

通过对车道线进行识别检测, 可以将违规变道的车辆分辨出来方便后续责任判定. 首先对图像进行预处理, 将图片转换为灰度图, 当图像是灰度时, 这两种线的对比度非常高, 并且可以对图片进行降噪处理, 结合高斯模糊技术实现突出图像中的车道线条. 最后应用霍夫变换来识别图像中的点来找到车道线[16], 将用轴

|

图 8 车道线检测结果 |

5 车辆行为及事故责任分析 5.1 车辆行为分析

根据直行道路上发生的直行追尾及违规变道的行为进行分析. 在输入发生交通事故的视频后, 为了自动区分是直行追尾还是违规变道导致的事故, 首先针对违规变道引起的交通事故, 通过第4.3节中车道线检测, 当车辆发生左右方向的偏移时, 识别车辆中心坐标是否与车道线重合, 如果车道线不明显时比较事故两辆车行驶过程中的左右偏移量

| loc1=loc2 |

其中,

| dx1>dx2 |

其中,

| V1>V2 |

表示车辆1速度大于车辆2, 承担主要责任, 否则车辆2承担主要责任.

5.2 事故责任分析依照《中华人民共和国道路安全法实施条例》和《机动车事故快速处理办法》对直行道路上的追尾和违规变道引起的交通事故进行检测和责任判定. 供事故双方进行参考, 方便将事故车辆驶离现场, 为后续快速理赔流程提供依据. 在输入一段有交通事故发生的视频时, 分析碰撞前视频中车辆的行为, 图9为直行追尾和违规变道导致的事故的责任判定结果. 图9(a)没有涉及变道, 因此需要分析两辆车的速度. 通过车辆速度检测公式可以得知:

| V1=25.58>0.69=V2 |

|

图 9 交通事故责任判定结果 |

因此车辆1违反《道路安全条例》第四十三条第(一)项“同车道行驶的机动车, 后车应当与前车保持足以采取紧急制动措施的安全距离”. 车辆1并未遵守条例导致发生事故, 因此该事件应为车辆1负主要责任.

图9(b)车辆1与车辆2发生碰撞前存在变道行为, 检测结果显示:

| loc1=loc2=(831,527) |

即车辆1与车道线有交点, 同时:

| dx1=3.35>0.50=dx2 |

结合上述两式, 可以判断车辆1存在违规变道行为导致两车相撞, 依据《道路安全条例》第四十四条“在道路同方向划有2条以上机动车道的, 变更车道的机动车不得影响相关车道内行驶的机动车的正常行驶. ” 因此在该事件中判定为车辆1承担主要责任.

6 结论本文设计的基于图像处理的车辆碰撞检测及责任判定系统, 采用的SSD算法结合MobileNet模型可以快速实现车辆检测, 通过车辆跟踪与碰撞检测算法实现了直行道路中车辆事故检测, 最后通过法律条例完成了对事故车辆的责任判定. 该系统可以快速完成直道上的事故检测及责任判定, 可以在30 s内完成责任判定, 由于交通事故视频难以获取, 本系统在对56起追尾和变道事件的责任判定中正确率达到了89.2%. 如表1所示, 从实验结果来看, 本系统对于车辆事故的责任判定有着较高的准确率同时又有着较快的响应速度, 对于轻微交通事故快速理赔及缓解交通拥堵有一定帮助.

| 表 1 直行追尾及违规变道事故检测及判责系统结果分析 |

| [1] |

谭跃. 2016年全国机动车和驾驶人保持快速增长. 道路交通管理, 2017(2): 7. |

| [2] |

徐子豪, 黄伟泉, 王胤. 基于深度学习的监控视频中多类别车辆检测. 计算机应用, 2019, 39(3): 700-705. DOI:10.11772/j.issn.1001-9081.2018071587 |

| [3] |

Cheu RL, Srinivasan D, Teh ET. Support vector machine models for freeway incident detection. Proceedings of the 2003 IEEE International Conference on Intelligent Transportation Systems. Shanghai: IEEE, 2003. 238–243.

|

| [4] |

Chen SY, Wang W. Decision tree learning for freeway automatic incident detection. Expert Systems with Applications, 2009, 36(2): 4101-4105. |

| [5] |

Dia H, Rose G. Development and evaluation of neural network freeway incident detection models using field data. Transportation Research Part C: Emerging Technologies, 1997, 5(5): 313-331. |

| [6] |

Kisa M, Botsali FM. A real-time computer vision system for vehicle tracking and collision detection. World Academy of Science, Engineering and Technology International Journal of Computer and Information Engineering, 2012, 6(8): 943-945. |

| [7] |

Isaloo M, Azimifar Z. Anomaly detection on traffic videos based on trajectory simplification. Proceedings of the 8th Iranian Conference on Machine Vision and Image Processing. Zanjan: IEEE, 2013. 200–203.

|

| [8] |

拜佩, 李金屏. 一种基于视频的交通事故检测方法. 济南大学学报(自然科学版), 2012, 26(3): 282-286. |

| [9] |

赵晓娟. 基于多源数据的快速路交通事件自动检测算法研究[硕士学位论文]. 北京: 北京工业大学, 2010, 1-4. |

| [10] |

Liu W, Anguelov D, Erhan D, et al. SSD: Single shot MultiBox detector. Proceedings of the 14th European Conference on Computer Vision. Amsterdam: Springer, 2016. 21–37.

|

| [11] |

Howard AG, Zhu ML, Chen B, et al. MobileNets: Efficient convolutional neural networks for mobile vision applications. arXiv:1704.04861, 2017.

|

| [12] |

刘颜, 朱志宇, 张冰. 基于SSD-MobileNet模型的目标检测. 舰船电子工程, 2019, 39(10): 52-56. DOI:10.3969/j.issn.1672-9730.2019.10.012 |

| [13] |

Lin TY, Maire M, Belongie S, et al. Microsoft COCO: Common objects in context. Proceedings of the European Conference on Computer Vision. Zurich: Springer, 2014. 740–755.

|

| [14] |

王建东, 王亚飞, 张晶. 基于卡尔曼滤波器的运动目标跟踪算法. 数字通信, 2009, 36(6): 53-57. DOI:10.3969/j.issn.1005-3824.2009.06.014 |

| [15] |

刘青芳. 基于帧差法的运动目标检测方法研究. 数字通信世界, 2015(11): 54, 120. DOI:10.3969/j.issn.1672-7274.2015.11.044 |

| [16] |

唐佳林, 王镇波, 张鑫鑫. 基于霍夫变换的直线检测技术. 科技信息, 2011(14): 33, 35. |

2022, Vol. 31

2022, Vol. 31