合成孔径雷达是一种主动式微波遥感成像设备, 在侦察, 导航, 制导, 遥感等领域都发挥着重要的作用[1]. 与光学图像不同的是, 由于雷达独特的相干成像特点, SAR图像中不可避免地会出现相干斑噪声, 严重扰动了图像中目标的边缘和纹理信息, 给SAR图像的后续分类、检测和识别等处理带来了很大困难.

近年来, 深度学习网络在众多领域的杰出应用, 使得研究者们逐渐将其引入到SAR图像目标识别领域. 其中卷积神经网络[2]具有自动进行特征提取的特点, 省去了人工特征选择的工序, 并且能够实现对目标潜在特征信息的挖掘. 2014年Chen等人[3]作为初步研究, 采用单级卷积网络自动学习对合成孔径雷达目标识别有用的特征. 在3类和10类目标的MSTAR数据集分类中, 获得了不错的准确率. 2016年, Chen等人[4]针对SAR图像样本较少的问题, 为了减少自由参数的数量, 又提出了一种由5个卷积层和3个子采样层组成的网络结构, 采用卷积层替换全连接层, 并利用随机裁剪和翻转的方法优化了训练数据集, 防止由于样本集数量过少在训练过程中的严重过拟合问题, 该算法在MSTAR数据集中的10类目标的识别结果相对优于传统算法. Wagner[5]提出了一种将CNN和SVM结合使用的识别方法, 利用卷积神经网络进对图像行特征提取, 使用支持向量机分类器进行识别, 这样将卷积神经网络和其他算法相结合使用的方法, 不仅得到了较好的识别率同时算法的鲁棒性也较好. 以上的研究充分体现了卷积神经网络对于提高SAR图像目标识别效果的重要意义.

在SAR图像目标识别的过程中, 特征提取的好坏在很大程度上影响着目标分类的精度. 特征提取的影响因素众多, 其中比较重要的有相干斑噪声[6, 7], 方位角, 俯仰角等因素. 同时由于SAR数据获取成本较高, 没有像传统的光学图像一样拥有巨大的数据量及样本量用来保证网络训练的深度, 样本数量不足对于学习图像的深层特性有着十分不利的影响, 这会使得对SAR图像的识别效果显著降低[8-11], 因此, 针对上述问题, 为了更好地推动SAR应用, 准确、有效地检测出图像中的目标, 完成对目标的识别分类, 本文设计了一个基于数据融合的SAR图像分类方法, 在该网络中, 首先使用神经网络对数据集进行噪声抑制形成新的数据集, 同时为了避免在滤波过程中对图像边缘细节的损失, 使用边缘提取算法对原数据集进行特征提取, 将得到的边缘特征信息与滤波之后的特征图像进行通道融合, 形成一副双通道图像送入神经网络. 同时, 本文在设计网络的过程中, 为了提高对特征的利用, 引入注意力机制, 强化重要信息并且淡化无关细节信息, 为了更好地捕捉图像的特征信息, 本文对卷积神经网络的提取的特征进行高底层特征融合, 使用Softmax分类器对其进行分类处理.

1 数据来源与处理 1.1 数据来源本文使用MSTAR数据集作为实验数据集, MSTAR数据集是美国国防高等研究计划署(DARPA)发布于MSTAR计划中的合成孔径雷达实测数据, 图像分辨率为0.3 m×0.3 m, 像素尺寸大小为158×158, 极化方式为HH, 该数据集包括多种不同型号的车辆目标在多个方位角下的SAR图像信息. 其中数据集中的各类具体目标型号以及数量如表1所示.

| 表 1 各类具体目标型号以及数量 |

1.2 图像去噪

图像噪声的抑制可以看作是把含噪图像映射为干净无噪图像的过程[12]. 卷积神经网络具有较强的特征映射能力, 因此本文使用了一种基于Inception结构、非对称卷积结构、残差学习的卷积神经网络去噪模型, 该网络模型总共有17层, 在网络的第一层使用了多尺度卷积操作, 在该层包含了卷积核尺寸分别为3×3, 5×5, 7×7, 9×9的4种不同尺寸的卷积操作来提取特征信息, 使用concat操作对卷积之后的数据进行拼接, 在网络的第2–16层, 层叠使用非对称卷积块来进行特征提取, 使用非对称卷积块替换掉传统的方形对称卷积块来进行特征映射, 能够提升网络对图像细节的获取捕捉, 增强网络精度, 最后一层使用一个卷积核进行非线性映射, 并引入跳跃连接, 由输入的含噪图像减去使用残差学习思想学习到的残差影像从而得到干净的去噪图像. 在整体网络中, 全部采用ReLU激活函数, 同时在每一层卷积之后增加了批量归一化操作, 使得网络能够更加快速的收敛.

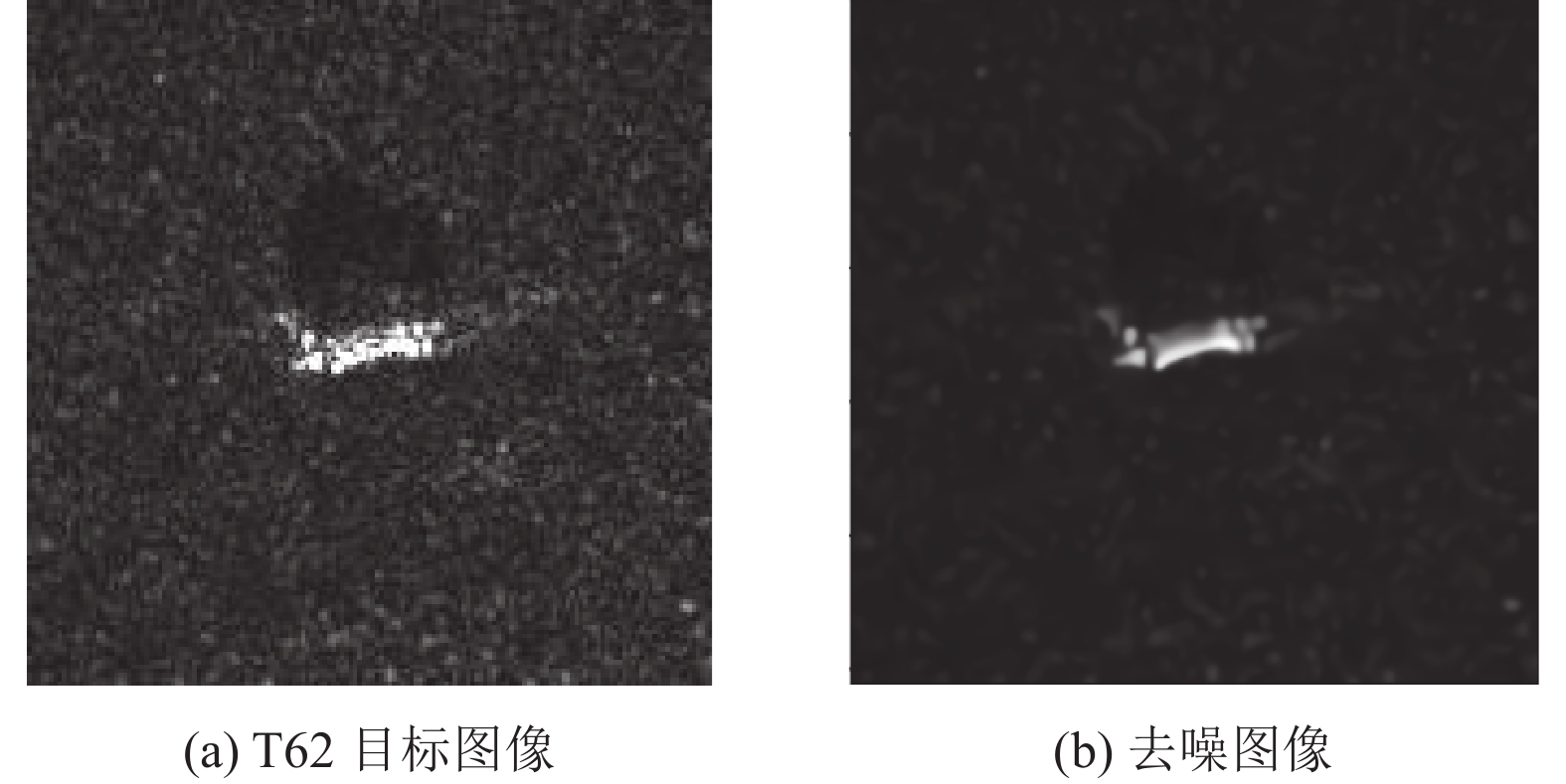

由于模型训练的过程中需要同时存在干净图像和含噪图像来学习映射关系, 而SAR图像本身就是含噪图像, 因此在训练网络时首先对光学数据集添加斑点噪声形成仿真SAR图像, 将仿真SAR图像输入网络, 通过最小化损失函数来不断更迭网络参数, 使网络收敛, 完成模型的训练, 将真实SAR图像送入训练好的网络模型, 输出噪声被抑制的SAR图像, 在本文中使用该算法对MSTAR数据集进行噪声抑制, 得到抑制后的噪声图像, 形成新的10类目标数据集. 如图1所示, 图1(a)为数据集中型号为T62的SAR目标图像, 图1(b)为对其进行噪声抑制之后的图像.

|

图 1 T62目标图像及其去噪图像 |

1.3 边缘特征提取

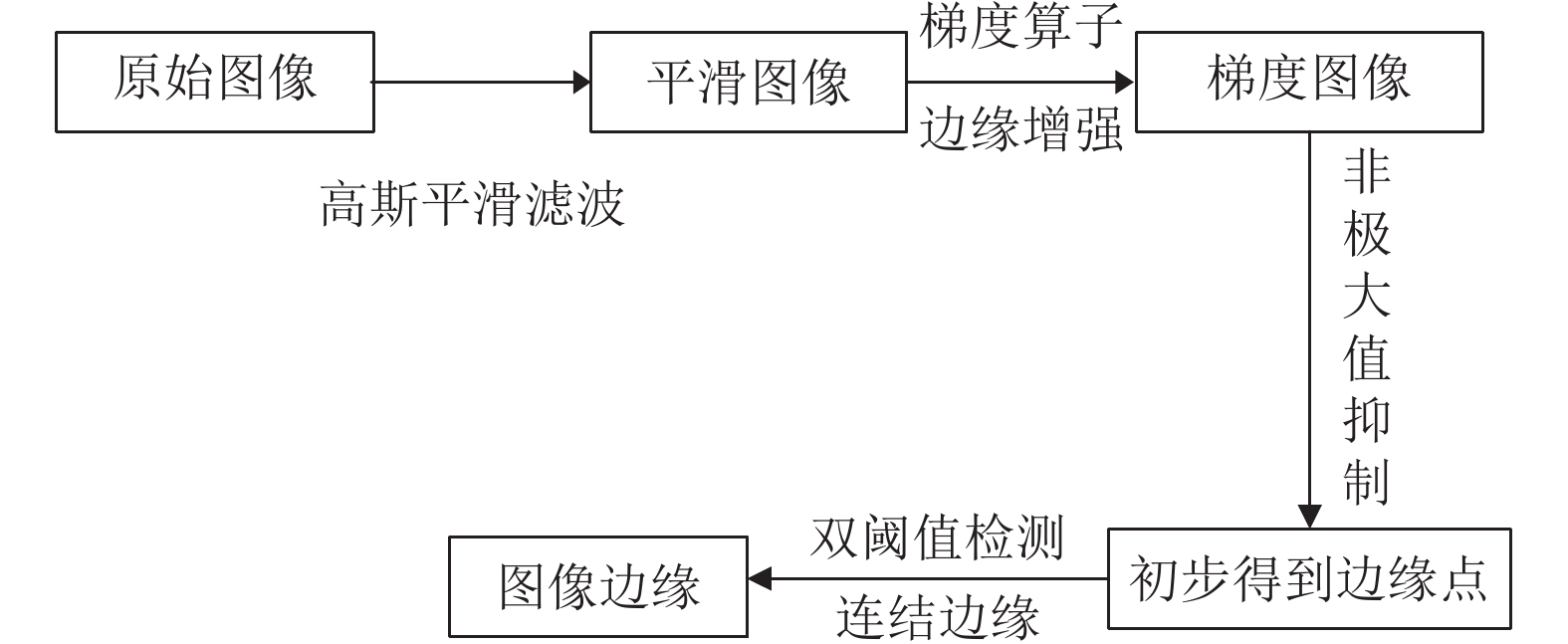

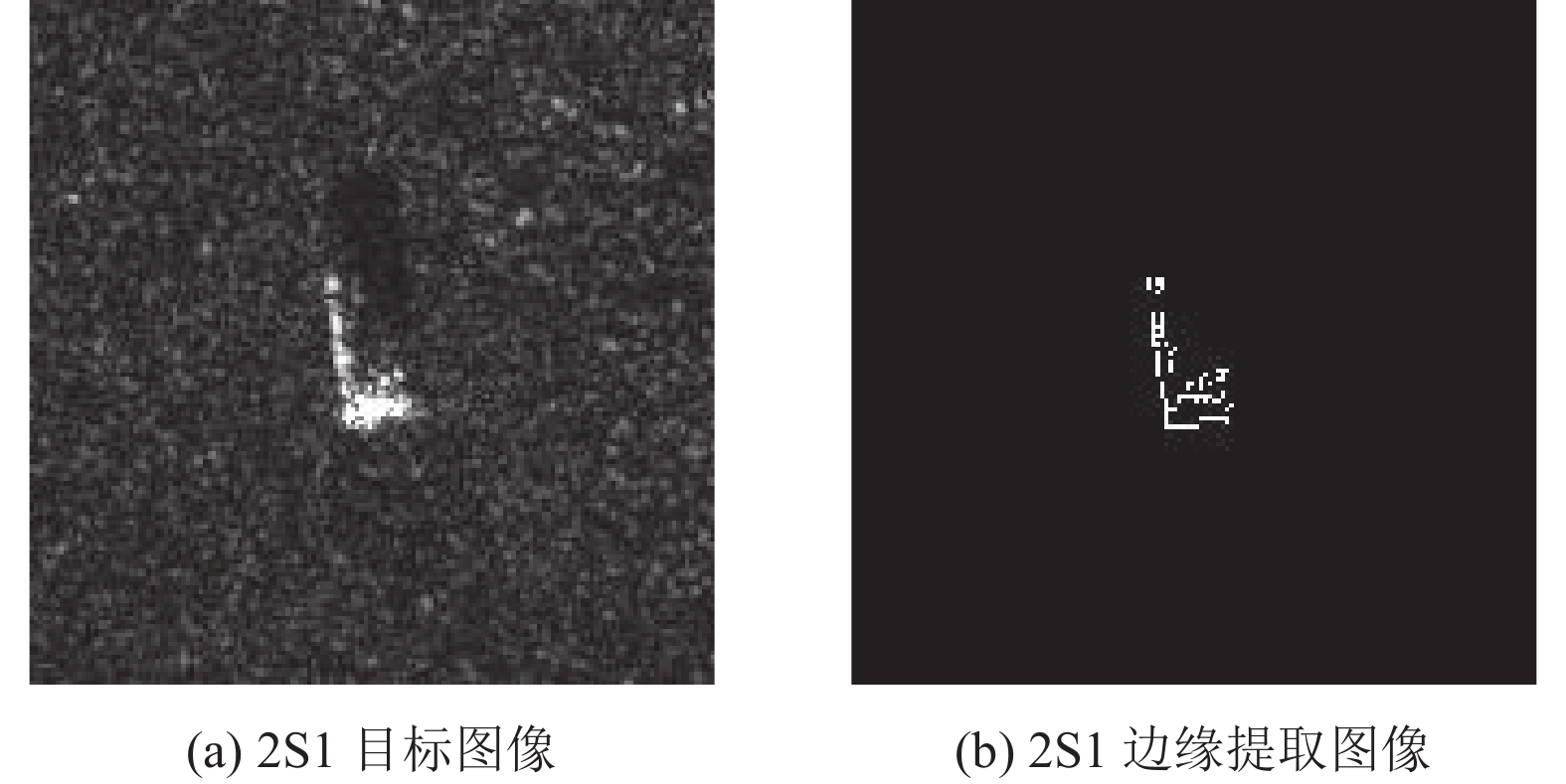

为了避免去噪算法对图像边缘特征造成损失, 本文采用边缘提取算法对原始MSTAR数据集进行边缘特征提取, Canny边缘提取算法在1986年被Canny[13]首次提出, 是目前理论上相对最完善的一种边缘检测算法, 是一种由多个步骤组成的多阶段算法, 能够较为准确地对图像边缘进行检测识别, 错误率较低, 目前仍是主流的边缘检测算法. 具体的Canny边缘提取算法流程如图2所示, 图3是对MSTAR数据集中2S1目标提取的特征图.

|

图 2 Canny边缘检测算法流程图 |

1.4 图像数据融合

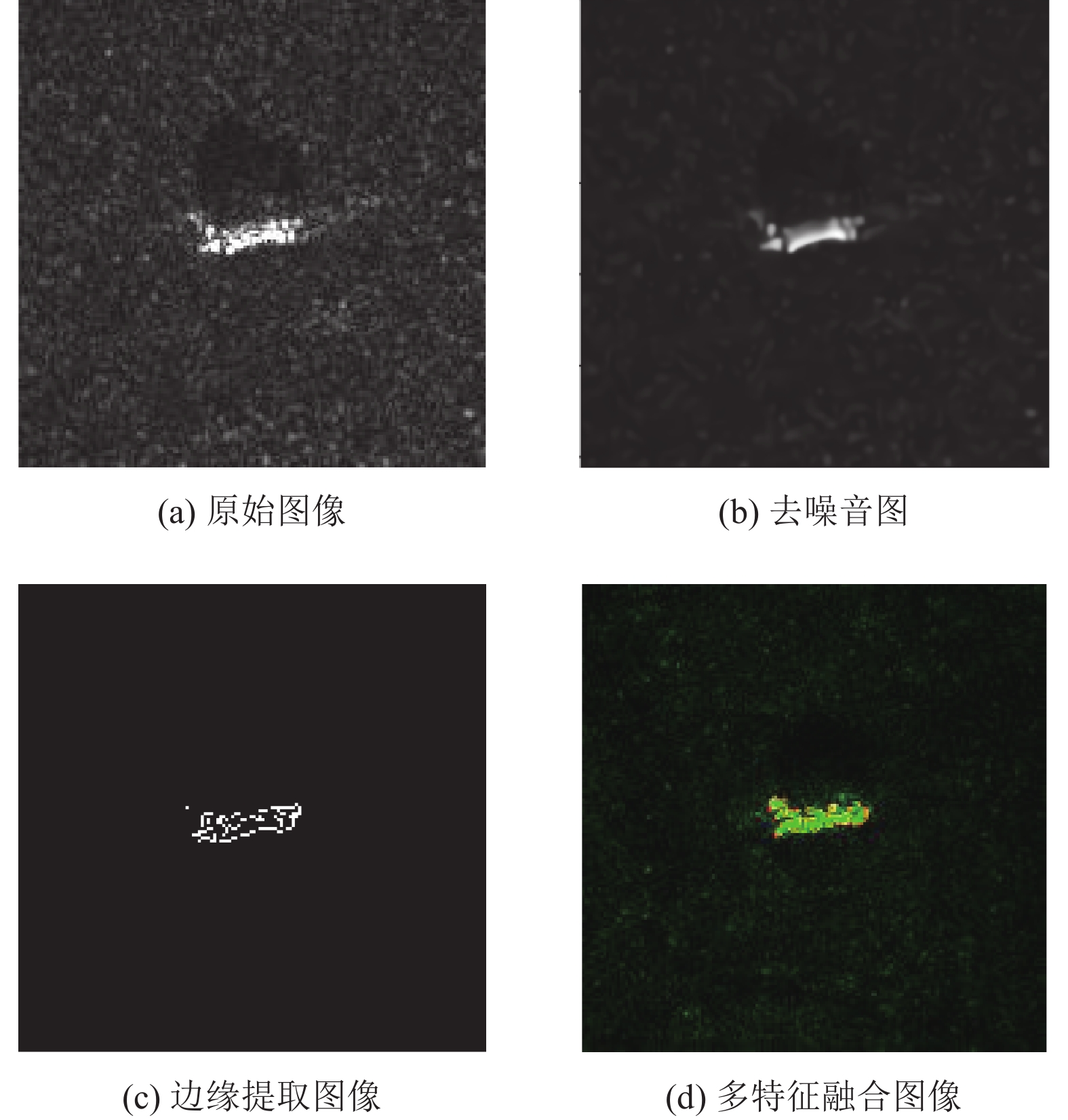

为了丰富输入数据的有效性, 进一步提升识别效果, 本文将去噪后的图像和边缘特征图像进行通道融合, 将两个单通道灰度图像进行自适应融合形成双通道图像. 如图4所示, 是对MSTAR数据集中的T62目标进行融合处理后的效果图, 其中, 图4(b)是对原始图像进行去噪处理之后的图片, 图4(c)是对原始图像进行边缘提取之后的特征图, 然后将这两种单通道灰度特征图进行数据融合处理形成双通道图像(图4(d)). 按照这样的处理方式依次对数据集中的10类目标进行处理, 形成新的数据集, 送入卷积神经网络进行训练. 使用这样的方法对训练样本特征进行扩充, 增加了样本数据量, 一定程度上解决了网络训练中的样本不足的问题, 使得卷积神经网络可以更好地学习样本数据特征分布, 从而提高识别正确率.

|

图 3 2S1目标边缘提取图像 |

|

图 4 T62目标处理图 |

2 识别网络结构

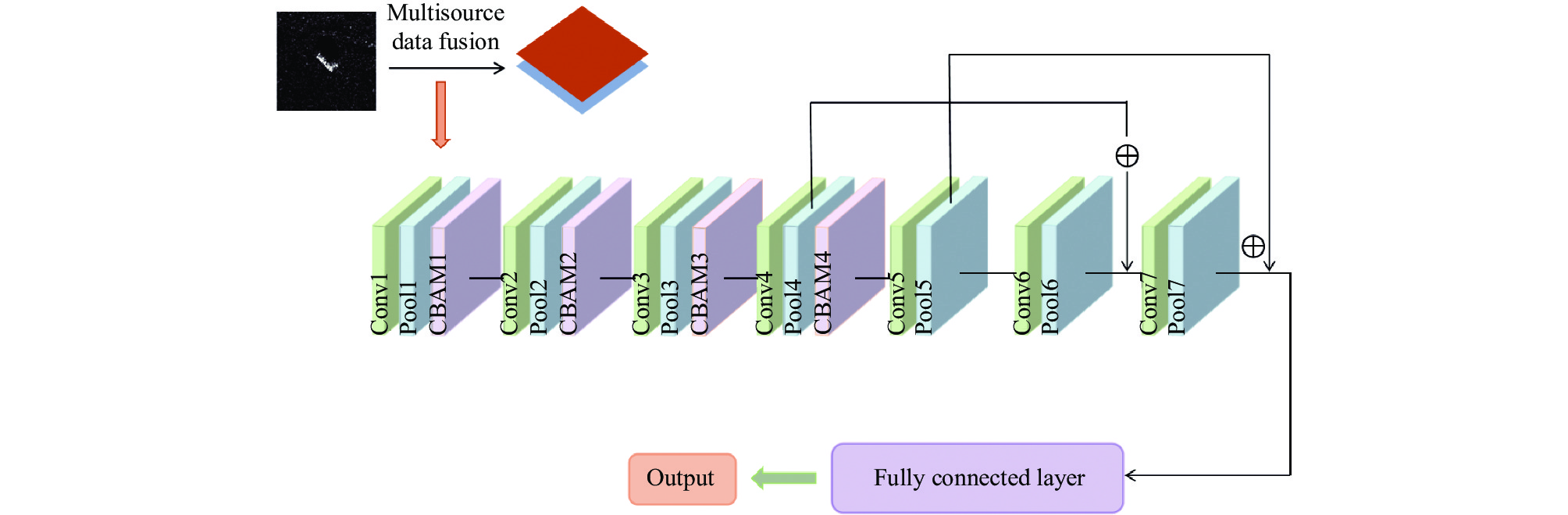

为了提高网络识别精度, 本文提出了基于特征融合的卷积神经网络模型. 本文的整体网络结构图如图5所示, 网络输入为融合数据, 通过层叠的卷积层对数据进行特征提取, 为了提高有效特征的利用, 本文采用了高低层特征融合的方式, 将第4卷积层和第6卷积层提取出来的特征图, 以及第5卷积层和第7卷积层提取出来的特征图进行融合操作. 同时, 为了促进网络对有用特征的学习, 在前4个卷积池化层后引入注意力学习机制, 根据特征图信息量的多少分配学习权重, 促进网络对有效特征的学习从而提高网络的识别精度, 同时, 在每层卷积层后使用批量归一化处理(batch normalization, BN)[14], 使得网络能够快速收敛.

|

图 5 网络结构设计图 |

2.1 特征提取

使用卷积层进行特征提取操作, 网络输入的伪彩色图像的尺寸为158×158×3, 卷积层皆采用64个尺寸为7×7的卷积, 为了保证图像的尺寸大小不变, 对所有卷积操作都进行零填充. 每层卷积操作后, 使用尺寸为2×2的池化层来进行特征维度压缩, 经过7个卷积层进行特征提取后, 使用全连接层进行特征平铺, 紧接着通过Softmax输出目标归于各个类别的概率.

卷积层的具体计算如下:

| Z(l)uv=∑∞i=−∞x(l−1)i+u,j+u⋅k(l)roti,j⋅x(i,j)+b(l) | (1) |

其中, 卷积操作是将前一层的特征向量与对应的卷积核进行卷积, 输出新的特征, 其中b为偏置单元, 卷积核为

通过卷积层对数据进行特征提取的过程中, 低层卷积特征通常包含更多的位置细节信息, 但由于经过的卷积层较少, 会含有更多的噪声信息. 高层特征对细节的感知较少, 但其语义性信息更强, 因此为了改善模型性能, 利用更多的特征信息提升分类精度, 在本文中将高低层特征信息进行融合, 使用concat操作将第4卷积层得到的特征图和第6卷积层得到的特征图进行通道融合然后输入下一个卷积层进行特征提取, 同理将第5和第7卷积层得到的特征进行融合操作送入全连接层. 对多融合后的特征图进行卷积操作, 实现不同特征的提取, 有效提高了特征信息的利用率.

2.2 注意力机制卷积神经网络在训练过程中可能会自动学习无用的特征图, 使得分类器无法有效利用重要特征, 过多的学习信息较少的特征图会对网络造成负面影响使得识别性能下降. 为了避免卷积神经网络对无用特征图的自动学习, 本文在卷积网络的前4层引入混合通道域和空间域的CBAM模块来学习每个通道和每个特征空间的重要程度, 根据特征图的信息量分配学习权重, 促进对包含有效特征较丰富的特征图的学习, 抑制对包含信息量少的特征图的过多学习从而提高对目标的识别准确率.

CBAM模块是通道注意力机制和空间注意力机制进行串联使用, 具体包含两个步骤, 首先是给定一个中间特征图

| MC(F)=σ(MLP(AvgPool(F))+MLP(MaxPool(F)))=σ(W1(W0(FCavg ))+W1(W0(FCmax))) | (2) |

其中, MLP表示共享全连接层,

将输出和特征图进行像素级别的相乘操作得到通道注意力特征图

| F′=MC(F)⊗F | (3) |

第2步是将得到的

| F^{\prime \prime}=M_S\left(F^{\prime}\right) \otimes F^{\prime} | (4) |

注意力特征图是CBAM模块沿着输入特征图的通道和空间两个方向来生成的, 这一方法能够使得图像中的重点信息或重点位置得到关注. 通道注意力模块重点关注对后续处理有意义的数据信息, 经过该模块得到的通道注意力特征图上的每一维权重, 都表示了该维对应的特征图层中信息的重要程度和关联程度. 空间注意力模块串联更侧重于关注关键信息的位置, 将该模块放在通道注意力模块之后, 是对其的一个补充.

2.3 批量归一化在模型训练的过程中, 随着网络训练的进行, 网络中的参量进行迭代更新, 前一层参数的更新调整会对后一层的输入数据的分布产生较大影响, 在训练过程中, 各层网络需要不断对变化后的数据分布进行学习, 网络的前几层发生的微小参数改变引起的数据分布变动, 会不断叠加累积, 使得输出层剧烈变化. 而在训练过程中, 数据分布方式的不断改变, 会极大地增加训练的复杂度. 因此网络引入批量归一化操作来解决网络在反向传播时使用梯度下降算法来更新参数过程中的不稳定问题, 加快网络的收敛速度.

本文在每一层使用激活函数之前, 对卷积层的输出进行归一化操作, 使用一定的规范化方式统一数据分布后, 再使用激活函数进行非线性映射, 输入至下一层, 增加整个神经网络的稳定性, 从而加快神经网络的收敛.

在训练阶段, 批量标准化的计算过程如下:

| \mu_B=\frac{1}{{m}} \sum_i x_i | (5) |

| \sigma_B^2=\frac{1}{{m}} \sum_{i=1}^m\left(x_i-\mu_B\right)^2 | (6) |

然后对其进行白化处理如下:

| \hat{x}_i=\frac{x_i-\mu_B}{\sqrt{\sigma_B^2+\varepsilon}} | (7) |

其中,

| y_{i}=\gamma \hat{x}_{i}+\beta=B N_{r, \beta}\left(x_{i}\right) | (8) |

实验在64位Windows 10系统下进行, 使用TensorFlow深度学习框架进行网络训练, 训练周期epoch的值设为100. 实验中, 使用俯仰角为17°的SAR图像数据作为训练集, 使用俯仰角为15°的数据集作为测试集. 在训练过程中, 本文根据大量实验选取最佳参数设置, 采用Adam迭代优化算法, batch size设置为32. 将模型训练好之后, 将测试集中的每一类别图像输入网络继续进行预测, 得到每一个类别的预测准确率和平均预测准确率.

为了验证本文预处理图像的有效性和合理性, 分别使用原始数据, 去噪数据, 以及对图像进行通道融合后的融合数据. 将这3个输入数据在构建好的卷积神经网络中进行实验.

3.1 数据处理有效性分析与实验对比分别将3个输入数据送入搭建的网络进行训练和验证, 表2是使用原始数据输入网络得到的正确识别率(PCC)混淆矩阵, 混淆矩阵中显示了每个对象的实际类别标签和卷积网络对应预测的类别结果, 由表2看出, 除了BMP2, BRDM_2这两类目标的识别精度达到了100%外, 其他各类目标都有着不同程度的目标类别识别错误, 仔细观察矩阵中识别错误的类别发现大部分是在两个目标中造成混淆, 例如BTR_70中的目标有12个被网络识别作BTR_60目标. 造成这样的原因可能是这两类目标的图像特征较为相近, 网络在训练过程中, 对各类别特征的学习较浅, 以至于识别目标具有相似特征时造成混淆, 表3是使用经过去噪处理后的数据输入网络得到的正确率识别矩阵, 由表3可以看出, 在对数据集进行噪声抑制之后, 随着图像质量的提升, 减少了噪声对目标识别的影响, 以便网络对SAR图像进行有效的特征提取, 网络对目标的识别精度也进一步得到提升, 但在BTR_60和BTR_70这两类目标的识别上还有着相对较大的识别误差, 表4是使用去噪图像与边缘提取特征进行数据融合后的融合数据输入网络得到的正确识别率混淆矩阵, 由表4可以看出, 较前两个样本数据而言, 输入为融合数据的网络识别精度得到了进一步的提升, 整体识别率达到了99.63%, 综合来看该网络每个目标类别都得到了较好的识别准确率, 有6类目标完成了100%识别, 可见, 在使用卷积神经网络对目标特征进行学习的过程中, 包含更多信息的输入数据更有利于网络对深层特征的学习, 进而能够更好地学习和捕捉SAR图像特征, 训练出更为优秀的网络模型. 边缘特征包含较为细节的信息, 将边缘特征与去噪图像进行通道融合, 将灰度图像数据扩充至多维数据输入网络, 丰富了网络输入的有效信息, 通过反向传播算法不断迭代学习图像特征信息, 从而提高网络性能, 使网络得到更优秀的识别精度.

| 表 2 输入为原始数据的识别结果 |

| 表 3 输入为去噪数据的识别结果 |

| 表 4 输入为融合数据的识别结果 |

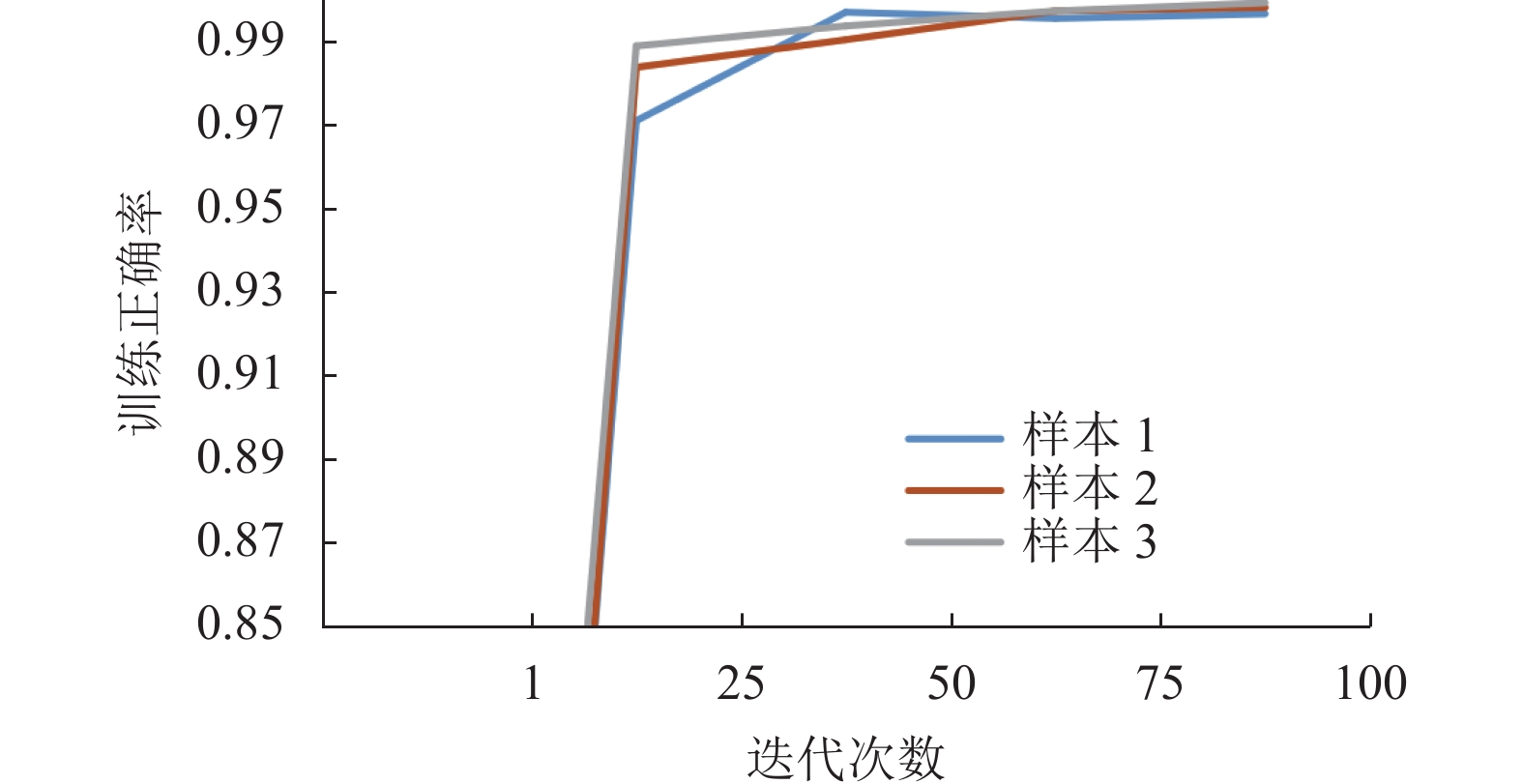

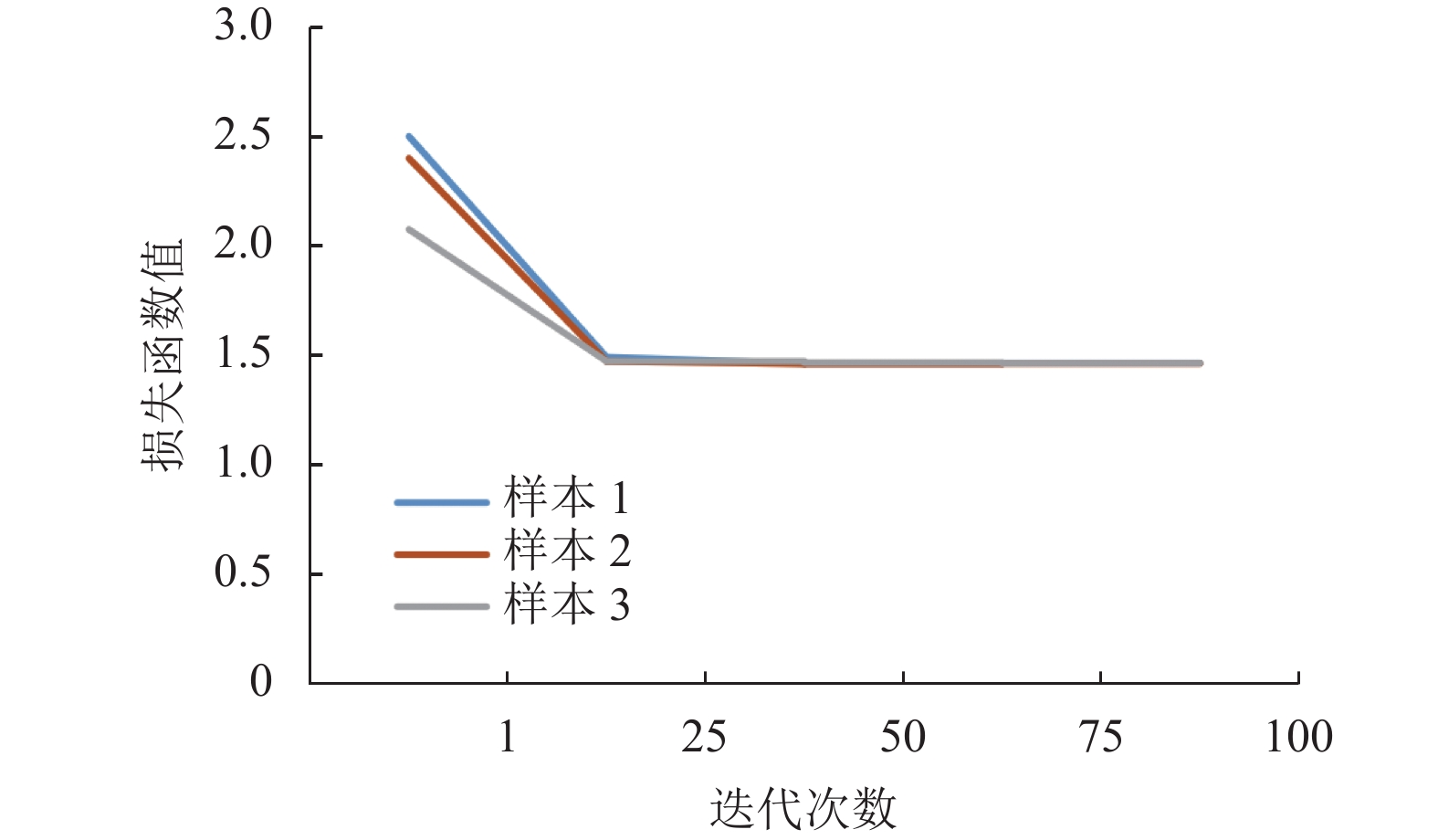

在训练过程中, 各个样本的收敛过程如图6所示, 损失函数与迭代次数的关系如图7所示, 将原始数据记为样本1, 将经过去噪处理后的数据记为样本2, 将经过边缘特征信息与去噪数据进行数据融合之后的输入数据记为样本3, 由图6和图7可以看出, 输入为样本A的网络在迭代次数为25时, 训练精度达到0.97左右, 样本2在同样的迭代次数下, 训练精度可以达到0.98, 同时其损失函数值更低, 当将样本数据融合扩充维度输入网络后, 在迭代次数为25时, 该网络就达到了0.99的训练精度, 随着迭代次数的增加, 损失函数值不断下降, 网络的训练精度继续不断上升, 最终趋于稳定, 相较于前两种数据输入方式, 对输入数据进行融合扩充之后, 在同样的迭代次数下其训练精度最高, 损失函数值最低, 且相较于其他样本, 数值稳定. 可见, 当对输入数据进行融合扩充之后, 随着输入图像特征信息的丰富, 通过网络训练可以得到更高且更稳定的识别精度, 同时在较短的时间内, 网络可以达到收敛, 获得更快速且稳定的识别效果.

|

图 6 训练正确率与迭代次数的关系 |

|

图 7 损失函数与迭代次数的关系 |

3.2 注意力机制有效性实验

本文进行了关于注意力机制有效性的实验验证, 将本文使用的网络结构去掉了注意力模块后在该数据集上进行实验, 记为样本1, 将本文使用的网络结构记为样本2, 对比结果如表5所示.

| 表 5 注意力机制有效性对比实验 |

由表5可见, 样本2相比与样本1, 加入了注意力模块后, 网络识别精度提升了0.63%, 该结果证明了使用注意力机制能够加强网络对有用特征信息的学习, 可以有效学习目标图像的显著性特征, 从而使得网络的识别准确率更高.

3.3 特征层融合有效性实验由于高低层特征融合会对识别效果造成一定的影响, 为了分析研究该方法的有效性, 本文在MSTAR数据集上进行了对比试验, 实验分为3种情况进行: 方法1不进行特征融合, 只保留网络结构的主要干路, 方法2只将第4卷积层得到的特征图和第6卷积层得到的特征图进行融合, 方法3保留网络结构图中原有的两个融合支路.

实验结果如表6所示, 其中, 当不采用高低层特征融合操作, 只保留网络的主干结构, 得到的10类目标识别率为98.9%, 网络结构只保留第4–6层的特征融合, 实验得到的10类目标识别率为99.1%, 相较于方法1而言, 实验识别率提升了0.2%, 而方法3相较于方法2, 识别效率得到了进一步的提升, 这表明将卷积神经网络不同卷积层得到的特征进行融合, 使得浅层信息和深层信息更加均衡, 特征信息含量更为丰富, 从而提高了网络的识别精度.

| 表 6 特征层融合有效性对比实验 |

3.4 对比实验与分析

为证明本文提出的方法能够有效提高SAR图像目标识别的准确率, 在MSTAR数据集上将本文的识别方法与其他经典方法进行对比, 表7展现了几种方法针对MSTAR十类数据集的具体分类结果, 文献[15]通过数据裁剪的方式来强化已有数据, 从而扩充用于网络训练的数据量, 使用了具有18层卷积层的残差网络来进行识别, 最终得到了99.56%的识别精度, 但由于该网络深度较深, 层叠使用的卷积操作, 使网络参数数量较大, 在训练过程中要使用大量的计算资源, 同时会影响网络的效率. 文献[3]为了减少自由参数的数量, 使用了一种新的全卷积网络, 只由稀疏连接的层组成, 没有使用全连接层. 文献[16]在2019年提出了一种结合生成对抗网络和CNN的半监督识别方法. 用GAN生成未标记图像, 并将其与原始标记图像一起作为CNN的输入, 用这样增加数据集的方式来提升网络性能. 文献[17]改进了多视角SAR数据的生成方式, 在不需要许多原始合成孔径雷达图像的情况下可以保证网络训练的大量输入, 降低了对原始SAR图像数量的需求. 由表7可见, 本文所使用的方法得到的识别率对比其他算法来看, 相对较高, 这一方面说明本文设计的网络拥有较好的网络性能和鲁棒性, 另一方面也说明, 本文将数据进行通道融合扩充来作为网络输入的有效性.

| 表 7 与其他方法的对比 |

4 结 语

本文提出了一种基于数据融合的识别方法, 为了避免SAR相干斑噪声对图像处理的影响. 针对MSTAR数据集, 对其进行噪声抑制处理, 使用边缘提取算法对原始数据进行边缘提取得到图像的边缘信息. 将去噪图像和边缘信息图像进行数据通道融合, 即将灰度图像合并成多维伪彩色图像数据, 然后将扩维数据输入网络中, 进行特征学习, 使用Softmax分类器对其进行分类. 这样的处理方式扩充了训练样本的信息, 在经典的SAR图像分类识别数据集上, 本文方法取得了99.63%的识别准确率, 与其他经典方法对比, 识别精度略有提升. 这表明本文构建的网络结构具有一定优越性, 以及在输入部分的优化是较为有效的. 结果表明, 使用这种输入方式, 在数据量不大的SAR数据集上, 可以改善输入的单一性, 增加输入样本的丰富程度, 可以使网络更好地学习与训练, 提高网络的识别率.

| [1] |

何楚, 张宇, 廖紫纤, 等. 基于压缩感知的SAR图像CFAR目标检测算法. 武汉大学学报(信息科学版), 2014, 39(7): 878-882. |

| [2] |

LeCun Y, Bottou L, Bengio Y, et al. Gradient-based learning applied to document recognition. Proceedings of the IEEE, 1998, 86(11): 2278-2324. DOI:10.1109/5.726791 |

| [3] |

Chen SZ, Wang HP. SAR target recognition based on deep learning. Proceedings of 2014 International Conference on Data Science and Advanced Analytics. Shanghai: IEEE, 2015. 541–547.

|

| [4] |

Chen SZ, Wang HP, Xu F, et al. Target classification using the deep convolutional networks for SAR images. IEEE Transactions on Geoscience and Remote Sensing, 2016, 54(8): 4806-4817. DOI:10.1109/TGRS.2016.2551720 |

| [5] |

Wagner SA. SAR ATR by a combination of convolutional neural network and support vector machines. IEEE Transactions on Aerospace and Electronic Systems, 2016, 52(6): 2861-2872. DOI:10.1109/TAES.2016.160061 |

| [6] |

王瑞霞, 林伟, 毛军. 基于小波变换和PCA的SAR图像相干斑抑制. 计算机工程, 2008, 34(20): 235-237. DOI:10.3969/j.issn.1000-3428.2008.20.086 |

| [7] |

Goodman JW. Some fundamental properties of speckle. Journal of the Optical Society of America, 1976, 66(11): 1145-1150. DOI:10.1364/JOSA.66.001145 |

| [8] |

Cui ZY, Dang SH, Cao ZJ, et al. SAR target recognition in large scene images via region-based convolutional neural networks. Remote Sensing, 2018, 10(5): 776. DOI:10.3390/rs10050776 |

| [9] |

刘晨, 曲长文, 周强, 等. 基于卷积神经网络迁移学习的SAR图像目标分类. 现代雷达, 2018, 40(3): 38-42. DOI:10.16592/j.cnki.1004-7859.2018.03.009 |

| [10] |

詹武平, 郑永煌, 王金霞. 基于深度神经网络模型的雷达目标识别. 现代雷达, 2018, 40(1): 16-19. DOI:10.16592/j.cnki.1004-7859.2018.01.004 |

| [11] |

McCann MT, Jin KH, Unser M. Convolutional neural networks for inverse problems in imaging: A review. IEEE Signal Processing Magazine, 2017, 34(6): 85-95. DOI:10.1109/MSP.2017.2739299 |

| [12] |

王琪. 基于卷积神经网络的SAR图像去噪和目标检测与识别[硕士学位论文]. 西安: 西安电子科技大学, 2019.

|

| [13] |

Canny J. A computational approach to edge detection. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1986, PAMI-8(6): 679-698. DOI:10.1109/TPAMI.1986.4767851 |

| [14] |

Loffe S, Szegedy C. Batch normalization: Accelerating deep network training by reducing internal covariate shift. Proceedings of the 32nd International Conference on International Conference on Machine Learning. Lille: JMLR.org, 2015. 448–456.

|

| [15] |

Furukawa H. Deep learning for target classification from SAR imagery: Data augmentation and translation invariance. IEICE Technical Report, 2017, 117(182): 13-17. |

| [16] |

Zheng C, Jiang X, Liu XZ. Semi-supervised SAR ATR via multi-discriminator generative adversarial network. IEEE Sensors Journal, 2019, 19(17): 7525-7533. DOI:10.1109/JSEN.2019.2915379 |

| [17] |

Pei JF, Huang YL, Huo WB, et al. SAR automatic target recognition based on multiview deep learning framework. IEEE Transactions on Geoscience and Remote Sensing, 2018, 56(4): 2196-2210. DOI:10.1109/TGRS.2017.2776357 |

2022, Vol. 31

2022, Vol. 31