2. 长安大学 公路学院, 西安 710064

2. School of Highway, Chang’an University, Xi’an 710064, China

近年来, 高光谱图像分类在军事目标检测和灾害防控等领域受到越来越多的关注[1]. 与传统的多光谱遥感图像相比, 高光谱图像由数百个光谱波段组成, 有助于更加精细地实现地物分类和目标识别. 高光谱图像具有较高的空间分辨率, 可以识别各种土地覆盖类型[2]. 早期的高光谱图像分类方法旨在提升分类性能, 比如支持向量机[3]等; 之后, 出现一些利用特征提取技术进行高光谱图像分类的方法探索地物表面的空间信息, 如基于空间光谱稀疏表示的方法[4]等, 通过建立函数映射以期分离高维空间中的光谱信息, 实现地物分类. 早期的高光谱图像分类方法中的图结构均为人工构造, 无法捕捉不同类之间的细微差别和同类之间的大差别, 普适性差且分类精度较低. 深度学习为高光谱图像的特征提取提供了理想的解决方案[5].

深度学习可以从数据中自适应地提取高光谱图像的光谱空间特征, 具有很好的鲁棒性. Chen等[6]采用卷积神经网络从高光谱图像中提取空间光谱特征, 获得了更好的分类性能; Qin等[7]提出利用半监督图卷积网络将高光谱图像编码成图结构, 并根据相邻像素的光谱相似性和空间距离在像素之间传播信息; Wan等[8]提出上下文感知的动态图卷积网络, 用于捕获远程上下文关系, 细化图边缘权值和图像区域之间的邻接关系; Mou等[9]提出将整张图像作为输入, 同时处理标记和未标记样本数据, 对图像中的所有像素节点进行分类处理; Sellars等[10]提出一种基于图论的超像素高光谱图像分类算法, 降低了算法复杂度. 此外, 通过多尺度和小批次处理高光谱图像成为近期研究的热点, 建立不同邻域的多个输入图, 利用不同尺度的光谱空间相关性细化图信息[11-13]; Yang等[14]通过GraphSAGE归纳学习的方式构造图结构, 对于采样节点数不足的情况, 采取有放回的节点采样方法, 可能造成子图中的局部信息不完整, 导致特征模糊, 从而使算法的分类误差增大.

为了充分利用图结构的空间相关性, 本文提出了基于改进GraphSAGE的高光谱图像分类方法. 首先采用简单线性迭代聚类算法(simple linear iterative clustering, SLIC)[15]将高光谱图像分割为超像素, 降低后续学习的图节点数; 再通过改进的GraphSAGE算法生成目标节点的嵌入, 利用平均采样得到训练样本, 选取平均聚合函数更新多阶节点的信息. 通过提取空间光谱信息来提高性能, 既无须对整张图进行节点嵌入, 也最大化保留了局部图结构的信息, 从而提高算法的分类精度.

1 GraphSAGE算法介绍传统的图卷积网络主要是在单一固定的图像中进行节点嵌入, 无法为未见节点或者全新子图生成快速嵌入. 为解决这种问题, Hamilton等[16]提出了GraphSAGE算法, 通过学习一个嵌入函数, 利用节点的局部邻域取样和聚合特征, 实现未见数据的生成嵌入. 其流程如图1所示.

对于已知无向图

|

图 1 GraphSAGE算法流程 |

(1) 采样: 通过随机游走的方式获取目标节点, 考虑到计算效率, 以有放回采样的方式抽取目标节点的

(2) 聚合: 通过选取聚合函数聚合邻居节点, 更新自身节点信息. 本文选取平均聚合的方式对邻居节点进行聚合, 将目标节点与邻居节点的第

| hkN(v)←Mean({hk−1u,∀u∈N(v)}) | (1) |

其中,

通过聚合后节点特征用于不同层之间的信息传播, 定义如下:

| hkv←σ(Wk⋅CONCAT(hk−1v,hkN(v))) | (2) |

其中,

图卷积网络的节点嵌入需要所有节点参与训练过程, 而GraphSAGE算法通过聚合邻居节点的特征信息, 为局部图节点获取嵌入向量. 新的图结构的节点嵌入只需利用学习的聚合函数, 就能输出低维向量, 进行节点分类.

2 改进GraphSAGE的高光谱图像分类算法 2.1 总体架构本文总体架构流程如图2所示. 对于给定的高光谱图像, 先对其进行预处理, 采用SLIC算法将其分割成若干同质的超像素; 然后采用改进的GraphSAGE算法对这些超像素进行平均采样并聚合节点信息, 使同类的超像素聚合到一起, 再对输入图生成节点嵌入; 最后将生成的低维向量输入到全连接层进行分类, 再输出分类结果.

|

图 2 改进GraphSAGE网络架构 |

2.2 超像素分割

高光谱图像通常包含数十万像素, 且某些像素的差别不明显, 在节点嵌入和分类过程中容易增大计算复杂度. 为了解决这个问题, 采用SLIC算法实现超像素分割, 实现过程如下: 首先将原始图像数据进行均值标准差标准化, 再将其分割成空间连通且光谱相似性很强的均匀图像区域, 即超像素; 其次将超像素的中心表示为一个图节点, 并通过梯度下降法更新节点矩阵; 最后通过建立超像素之间的邻接关系, 将高光谱图像转换成无向图, 构造超像素图像的特征以及标签. 将高光谱图像分割为超像素能显著减少图节点的个数, 有助于保存局部结构信息, 提高计算效率.

2.3 改进的GraphSAGE算法由于在采集高光谱图像的过程中不可避免地会引入一些噪声, 且其边缘部分的像素分布不均匀, 因而传统的GraphSAGE模型采集的样本具有短缺性和随机性. 针对传统GraphSAGE算法中图像边界采样节点数不足以及有放回的采样引起特征误差的问题, 本文提出平均采样的GraphSAGE模型, 采样过程的具体实现流程如算法1所示.

算法1改进GraphSAGE算法的平均采样具体思想是: 每一次迭代, 对目标节点

| V(k−1)←V(k−1)∪Mean{N(u)} | (3) |

算法1. 超像素的邻居采样

输入: 图

输出: 平均采样邻居样本

1)

2) for

3)

4) for

5)

6) end

7) end

结合本文提出的平均采样的思想, 介绍模型具体实现流程, 如算法2所示.

算法2的核心内容是: 先根据平均采样的方式抽取固定数量的邻居节点, 然后学习聚合函数对邻居节点的信息进行聚合得到信息

NLL loss函数如式(4)所示:

| NLloss(j)=ezjK∑k=1ezk | (4) |

算法2. 平均GraphSAGE节点嵌入

输入: 图

输出: 生成向量表示

1) 初始化:

2) for

3) for

4)

5)

6) end

7)

8)

9) end

3 算法仿真分析 3.1 数据集为了验证本文所提网络模型的有效性, 在公开的Pavia University和Kenndy Space Center数据集上进行实验, 并和其他算法的分类结果进行了对比.

(1) Pavia University数据集, 见表1. 该数据集是意大利帕维亚城的一部分高光谱图像. 图像具有610×340个像素以及115个光谱波段, 空间分辨率为1.3 m, 去除受噪声和水汽影响因素后剩余103个波段, 包含9个地物类别.

(2) Kenndy Space Center数据集, 见表2. 该数据集是在美国肯尼迪航天中心上空获得的, 图像包含224个波段和614×512个像素. 空间分辨率为18 m, 去除水汽和受噪声影响的波段后剩余176个波段, 包含13个地物类别.

3.2 仿真实现本文采用改进GraphSAGE算法对Pavia University和Kenndy Space Center两个数据集进行分类实验, 取数据集的10%作为训练样本, 剩余90%作为测试样本. 模型参数设置如下: 学习率为0.01, 权重衰减为5E–3, 迭代次数为100, 使用Adam优化器. 网络训练过程中, 设置采样层数

| 表 1 Pavia University数据集训练、测试样本数 |

| 表 2 Kenndy Space Center数据集训练、测试样本数 |

Pavia University数据集分类实验的训练样本和测试样本数见表1. 将标准化后的数据作为SLIC算法的输入数据, 输入大小为610×340×103的图像. 为提高计算效率, 将原始图像进行2500次分割, 得到1487个超像素. 将得到的超像素作为改进GraphSAGE算法的节点, 最终特征数设置为9, 经训练后输出9个数目为1487的张量, 从而进行分类

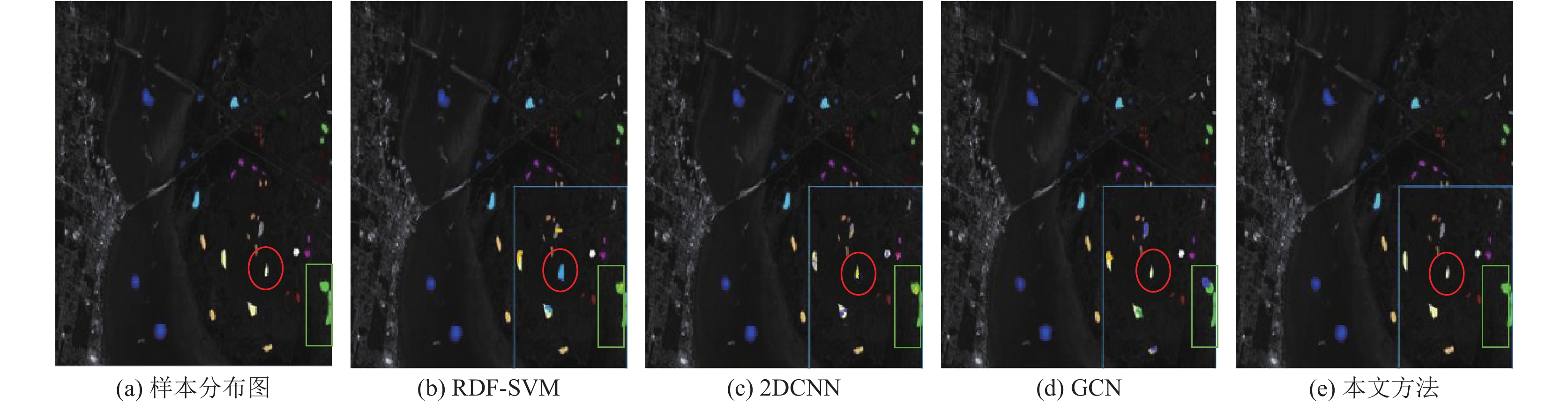

图3为不同方法的Pavia University数据集分类结果, 基于RDF的支持向量机(RDF-SVM)需手动设置专业的参数提取特征, 可能产生较多的误分类; 二维卷积神经网络(2DCNN)无法灵活的获得边界信息, 容易造成特征误差; 传统的GCN只利用像素的光谱特征, 无法表示其内在相似性. 分类结果表明, 本文方法的分类结果和样本分布图具有高度一致性, 可以很好地区分不同的地物类型, 具有较强的空间相关性. 在算法精度方面, 表3 Pavia University数据集上各种分类方法的分类评价指标表明, 在总体分类精度(OA)、平均分类精度(AA)和Kappa系数3个精度指标上, 本文分类方法的精度均优于其他方法, 改良方法的效果十分明显.

|

图 3 Pavia University数据集分类结果 |

| 表 3 Pavia University数据集分类评价指标对比 (%) |

Kenndy Space Center数据集分类实验的训练样本和测试样本数见表2. 训练过程与Pavia University数据集训练过程相同, 原始图像分割后得到1462个超像素, 最终输出13个数目为1462的张量用于图像分类过程.

对比图4的样本分布图与其他算法分类图, 可以发现部分算法的分类结果存在误差. 将每一张分类图的关键区域放大, 其中, 图4(a)红色圆圈中的地物类别是“Swamp”, 图4(b)中是“Mud flats”, 这两种地物类别具有相似的光谱特征. 在所有的分类图中, “Swamp”的部分像素被误分类为“Mud flats”, 其中, 图4(d)中的误分类区域最小. 结果表明, 和Pavia University数据集分类结果相似, 分类结果和实际分类结果具有很好的一致性, 可以很好地区分不同的地物类型. 在算法精度方面, 表4中各种分类方法的分类评价指标表明, 本文分类方法的精度远高于GCN, 略优于RDF-SVM和2DCNN, 改良效果明显.

|

图 4 Kenndy Space Center数据集分类结果 |

| 表 4 Kenndy Space Center数据集分类评价指标对比(%) |

3.3 算法分析

在原有GraphSAGE算法的基础上引入了SLIC超像素分割算法, 对Pavia University和Kenndy Space Center原始图像进行了2500次分割, 将拥有数十万像素的高光谱图像降维成仅有数千个超像素的超像素图像, 即用少量的超像素代替大量的原始图像像素来降低图像维度, 减少了图节点个数, 进而降低后续计算复杂度.

此外, 对GraphSAGE算法的采样过程进行改进, 引入平均采样的思想. 图3与图4可以看出, 改进后的GraphSAGE算法在Pavia University和Kenndy Space Center数据集上的分类结果与真实标签结果十分相近, 误分类区域较少, 尤其是在模型边界处的分类效果较好. 分析表明, 平均采样克服了有放回采样引起特征误差的问题, 以阶层节点的平均光谱特征补充采样值, 能解决图像边界采样节点数不足的问题. 由表3与表4可知, 改进的算法模型分类精度高于其他分类方法, 在大部分物体上获得了比较好的分类精度值. 分析表明, 改进的GraphSAGE算法对各类物的识别具有很强的适用性, 模型分类结果和实际分类结果高度一致, 具有较强的空间相关性, 进一步验证了本文方法的优越性.

4 总结为了提高高光谱图像的分类精度, 本文提出了一种改进GraphSAGE算法的高光谱图像分类网络模型. 为减少图节点个数, 降低计算复杂度, 该模型引入了超像素分割算法对原始图像进行预处理; 针对图像边界采样节点个数不足和有放回采样引起的特征误差问题, 通过平均采样的方式补充边界缺少的节点, 降低了提取特征的误差, 提高了分类准确度. 该模型在Pavia University和Kenndy Space Center数据集上达到了较高的分类精度, 能有效降低计算复杂度, 提高分类效率. 通过一系列对比实验评估本文模型的优越性, 结果表明, 与RDF-SVM、2DCNN和GCN相比, 改进的GraphSAGE算法弥补了边界部分采样节点不足的缺陷, 提高了分类准确度. 但本文网络对邻域大小的确定模式单一, 下一步将会借助注意力机制自适应的学习邻居节点的个数, 加快网络训练速度.

| [1] |

Zhong P, Gong ZQ, Shan JX. Multiple instance learning for multiple diverse hyperspectral target characterizations. IEEE Transactions on Neural Networks and Learning Systems, 2020, 31(1): 246-258. DOI:10.1109/TNNLS.2019.2900465 |

| [2] |

Zhang MM, Li W, Du Q. Diverse region-based CNN for hyperspectral image classification. IEEE Transactions on Image Processing, 2018, 27(6): 2623-2634. DOI:10.1109/TIP.2018.2809606 |

| [3] |

Kuo BC, Huang CS, Hung CC, et al. Spatial information based support vector machine for hyperspectral image classification. Proceedings of the 2010 IEEE International Geoscience and Remote Sensing Symposium. Honolulu: IEEE, 2010. 832–835.

|

| [4] |

Chen Y, Nasrabadi NM, Tran TD. Hyperspectral image classification using dictionary-based sparse representation. IEEE Transactions on Geoscience and Remote Sensing, 2011, 49(10): 3973-3985. DOI:10.1109/TGRS.2011.2129595 |

| [5] |

Chen YS, Wang Y, Gu YF, et al. Deep learning ensemble for hyperspectral image classification. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2019, 12(6): 1882-1897. DOI:10.1109/JSTARS.2019.2915259 |

| [6] |

Chen YS, Jiang HL, Li CY, et al. Deep feature extraction and classification of hyperspectral images based on convolutional neural networks. IEEE Transactions on Geoscience and Remote Sensing, 2016, 54(10): 6232-6251. DOI:10.1109/TGRS.2016.2584107 |

| [7] |

Qin AY, Shang ZW, Tian JY, et al. Spectral–spatial graph convolutional networks for semisupervised hyperspectral image classification. IEEE Geoscience and Remote Sensing Letters, 2019, 16(2): 241-245. DOI:10.1109/LGRS.2018.2869563 |

| [8] |

Wan S, Gong C, Zhong P, et al. Hyperspectral image classification with context-aware dynamic graph convolutional network. IEEE Transactions on Geoscience and Remote Sensing, 2021, 59(1): 597-612. DOI:10.1109/TGRS.2020.2994205 |

| [9] |

Mou LC, Lu XQ, Li XL, et al. Nonlocal graph convolutional networks for hyperspectral image classification. IEEE Transactions on Geoscience and Remote Sensing, 2020, 58(12): 8246-8257. DOI:10.1109/TGRS.2020.2973363 |

| [10] |

Sellars P, Aviles-Rivero AI, Schönlieb CB. Superpixel contracted graph-based learning for hyperspectral image classification. IEEE Transactions on Geoscience and Remote Sensing, 2020, 58(6): 4180-4193. DOI:10.1109/TGRS.2019.2961599 |

| [11] |

Wan S, Gong C, Zhong P, et al. Multiscale dynamic graph convolutional network for hyperspectral image classification. IEEE Transactions on Geoscience and Remote Sensing, 2020, 58(5): 3162-3177. DOI:10.1109/TGRS.2019.2949180 |

| [12] |

Hong DF, Gao LR, Yao J, et al. Graph convolutional networks for hyperspectral image classification. IEEE Transactions on Geoscience and Remote Sensing, 2021, 59(7): 5966-5978. DOI:10.1109/TGRS.2020.3015157 |

| [13] |

Wan S, Pan SR, Zhong P, et al. Dual interactive graph convolutional networks for hyperspectral image classification. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 1-14. |

| [14] |

Yang P, Tong L, Qian B, et al. Hyperspectral image classification with spectral and spatial graph using inductive representation learning network. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2021, 14: 791-800. DOI:10.1109/JSTARS.2020.3042959 |

| [15] |

Achanta R, Shaji A, Smith K, et al. SLIC superpixels compared to state-of-the-art superpixel methods. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34(11): 2274-2282. DOI:10.1109/TPAMI.2012.120 |

| [16] |

Hamilton WL, Ying R, Leskovec J. Inductive representation learning on large graphs. Proceedings of the 31st International Conference on Neural Information Processing Systems. Long Beach: Curran Associates Inc., 2017. 1025–1035.

|

2022, Vol. 31

2022, Vol. 31