2. 华东师范大学 计算机科学与软件工程学院, 上海 200062

2. School of Computer Science and Software Engineering, East China Normal University, Shanghai 200062, China

随着我国经济的高速发展, 我国的电力需求也不断增长, 尤其是特高压电网项目的开展和建设能源互联网的实施, 导致高压线路覆盖面积激增, 形成了日渐复杂的电网架结构. 由于大多数输电线路在荒郊旷野运转. 因而难免受到气候变化, 下方区域地形地势, 气候变化等外界要素的干扰, 进而影响到电网的安全性和可靠性. 为了保障电网能够安全稳定的运转, 对输电线路进行巡检和维护便显得至关重要, 及时发现输电线路中可能存在的安全隐患并对其加以排除和检修, 尽可能地减少损失, 带来经济上长期的收益.

人工检测作业危险, 效率低, 难度大. 一种有效地解决上述问题的方法便是使用无人机航拍巡检, 由于无人机很少受到地形因素的制约, 能够发现难以被人工发现的隐蔽的安全缺陷, 而且操作相对简单, 对塔头巡检效果更好, 成本较低, 巡检过程也更加有效率, 且受天气和环境影响较小, 很适合应用于对高压线路通道环境的巡检. 而无人机在高压线路通道环境巡检也在其他方向得到应用, 如王万国等人[1]使用了RCNN的方法来识别无人机巡检图像电力小部件, 实现了基于无人机的电力部件的识别等. 因此, 本文所要进行的工作便是围绕着使用无人机对高压线路通道环境巡检这一目标展开的. 在场景识别方面Yu和Wang提出了使用图匹配来进行场景解析的方法[2]. 本文提出一种基于超像素和深度神经网络的航拍高压输电线路环境检测的方法. 首先, 采用无人机对高压输电线路通道环境航拍, 将视频图像进行拼接, 得到通道环境的整体图像, 然后使用超像素分割算法实现图像的预分割, 采用SURF (Speeded Up Robust Features)描述子提取特征向量, 最后采用DNN模型进行训练, 对待检测的超像素块进行分类, 从而达到检测的目的.

2 算法本方法的主要过程由图像拼接, 图像特征提取及图像识别这3个步骤组成, 流程图如图1所示, 接下来本文将具体介绍了这3个步骤.

|

图 1 本方法的基本流程图 |

2.1 SURF算法进行图像拼接

本方法的第一步便是将拍摄得到的图像进行拼接. 图像拼接的最常用的方法便是Harris角点检测算法, 由于 Harris角点的尺度不变性较差, 在实际应用中一种最常用的特征点描述方法便是Lowe[3]提出的SIFT算法, 这种算法提取的特征点对空间强度信息进行了充分的描述, 同时对于小范围的变形和局部错误的稳定性较好. 近年来新的拼接算法包括Mills等人提出的动态元素拼接算法[4], Ma等人提出的使用FAST检测器和FREAK 描述的拼接算法[5], Qu等人提出的基于A-KAZE的拼接算法[6]等. 本方法使用的是Bay等人[7]提出的SURF算法, 使用64维特征向量来对特征点进行描述, 其特点在于其尺度不变性更好而且时间复杂度相比SIFT更低.

SURF使用近似Hessian矩阵将特征点提取出来, 并通过积分图大大提升过程中的计算速度, 从而降低了特征检测过程的时间. Hessian矩阵中局部极大值的点被判定为比邻域中其他点更亮或更暗的点, 因此被确定为特征点. 由于通过此方法得到的特征点受尺度影响较大, 因此在进行矩阵的构造前, 利用高斯核服从正态分布的特点, 采用由积分图实现的盒式滤波器近似实现高斯滤波器, 使其受尺度影响较小的同时将运算速度进行提高. SURF尺度空间由多个层组成, 其缩放比率为2, 而每一层又形成了不同尺度的滤波响应图, 不同组间滤波器尺寸逐渐增大, 而同一组不同层滤波器尺寸相同, 其模糊系数渐增. 完成了尺度空间的构建后, SURF在3×3×3大小的邻近区域内采用非最大值抑制, 将比邻近区域内的其他26个点都大的或都小的点置为极值点, 将这些极值点作为初步得到的特征点, 再通过排除掉能量较弱或错误定位的特征点后得到最终稳定的特征点.

在得到两幅图像的特征点后, 本文使用了基于最近邻和次近邻距离比值的方法, 对于图像I1中的一个特征点, 在另一幅图像I2中寻找与其欧式距离最短的点以及欧式距离第二短的点, 其距离分别为d1, d2, 当d1<a*d2, 一般a取0.8时, 认为距离最近点为正确匹配点, 否则为错误匹配点, 对图像I1中所有特征点进行遍历后, 得到I2上所有与这些特征点匹配的特征点. 通过这些匹配的特征点实现对两幅图像的拼接.

2.2 SLIC超像素分割及特征提取在得到待检测通道区域的完整图像后, 为了对图像内容进行检测, 本文采用深度神经网络(Deep Neural Network, DNN)对整张图像直接进行检测, 然而由于图像训练集过小, 直接在如此小的训练集上对网络进行训练可行度较低, 因此先使用超像素分割算法将图像分割为多个超像素块, 之后对各个超像素块的类别进行检测得到图像内容. 超像素分割算法主要包括基于图论的超像素算法和基于梯度的超像素算法两种, 基于图论的超像素分割算法中主要包括Liu等人提出的熵增超像素分割算法[8], Li等人提出的二分图分区算法[9], Fezenszwalb等人[10]提出的基于最短生成树的超像素算法等. 基于梯度上升的超像素算法主要包括 Mean-shift[11]算法, Quick-shift[12]算法和Turbopixels[13]算法. 图像的超像素分割算法中还包括线性光谱聚类超像素分割算法[14]等. 在本方法中使用了SLIC superpixels[15]算法来进行超像素分割, 此方法得到的超像素更加简洁整齐, 而且计算效率相比更高, 得到的超像素在大小上保持相同, 分割效果较好.

SLIC算法的主要思想在于将 RGB彩色模型的图像变换为 CIE-Lab彩色模型的图像, 将每个像素的颜色值(L, a, b)和坐标(x, y)形成一个五维向量V [L, a, b, x, y], 根据两个像素在向量上的欧式距离的大小来度量这两个像素的相似程度的高低.

通过上述算法得到了分割后的超像素块后, 本文提取其中的颜色, 灰度共生矩阵和梯度特征并得到特征向量F=[color, contrast, dissimilarity, ASM, gradient]并使用其对深度神经网络进行训练.

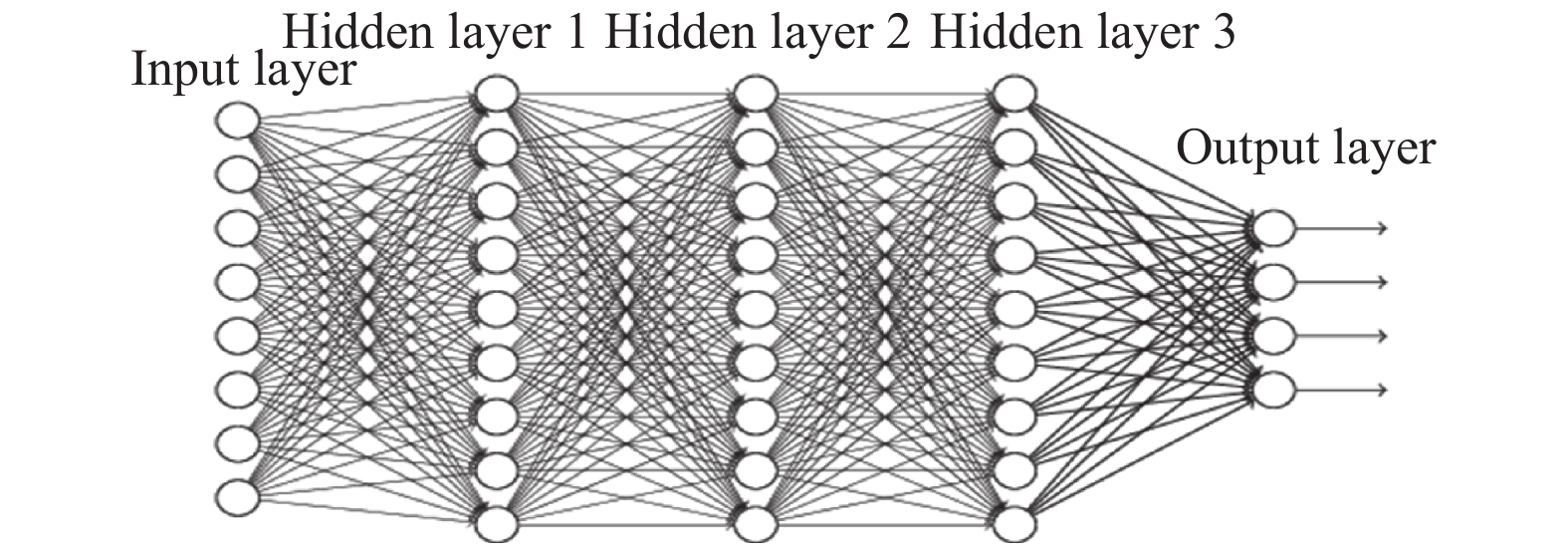

2.3 深度神经网络得到了分割后的超像素块以及它们的对应的特征向量后, 本文通过神经网络进行训练, 常用的神经网络包括全卷积神经网络(Fully Convolutional Networks, FCN)[16]和U形网络(U-Net)[17]等, 近期提出的新的神经网络包括ShuffleNet[18], RefineDet[19], NetAdapt[20]等, 本文中使用的神经网络是DNN, 其优点使用DNN可以将识别率显著地提高, 得到的效果更好.

DNN神经网络模型又叫全连接神经网络, 是现在许多现代AI应用的基础. 具有准确度高, 鲁棒性强等特点. DNN的基本结构如图2所示.

|

图 2 DNN基本结构 |

DNN结构可以按照其位置分为输入层, 隐含层, 输出层3部分, 隐含层位于输入层与输出层之间, 在这些层之间都是全连接的, 即对某一层的一个神经元, 一定与下一层的任意一个神经元都是相连的. 与其他神经网路不同的是DNN包含多于一个隐含层, 输入层接收数据后, 将数据传输到中间的隐含层, 经过多个隐含层的加权处理后, 将结果传递给输出层, 由输出层对其进行处理后得到最后的结果. 在将一个图像输入DNN后, DNN将输出得分向量来实现对图像的分类, 通过对权重的优化将输出得分与正确分类的差值保持最小, 即确保损失函数 loss最小, 即对权重进行训练. 常见的方法是所有训练样本均有标签的监督学习, 本文使用了这种方法, 因此, 其过程由训练和检测两个步骤组成.

得到训练后的DNN模型后, 本文便使用此模型来检测待检测的图像, 实现对通道环境的巡检.

3 实验分析实验分为图像拼接, 超像素图像分割和图像分类并将结果保存3个部分. 实验中使用戴尔G7进行实验, CPU为Intel Core i5-8300H CPU @ 2.30 GHz, 内存为8.0 GB, 硬盘为1 TB, 实验中使用到的支撑软件为Python3.6和OpenCV 2.4.9.

3.1 图像拼接实验本实验的第一步是使用无人机对待巡检的区域进行拍摄, 拍摄得到的图像尺寸均为4000×3000, 如图3为使用无人机对一个区域进行拍摄得到的3张图像, 而对这3张图像进行拼接便可以得到待巡检的区域的整体图像.

|

图 3 对待检测区域进行拍摄得到的图像 |

本文对使用SURF方法进行拼接与使用SIFT方法进行拼接所用的时间进行了比较, 比较结果如表1所示, 可以看到, SURF方法在时间上相比于SIFT方法有很大的优势. 由于基于SURF特征点的拼接算法无论从拼接效果上还是在拼接时间上相比基于SIFT特征点的算法都更有优势, 因此本文使用基于SURF特征点的拼接算法来对拍摄得到的图像进行拼接, 图3的3张图像使用基于SURF特征点的拼接算法进行拼接后得到的区域整体图像如图4所示. 而提取图4中的SURF特征点的结果如图5所示.

| 表 1 图像拼接时间比较(单位: s) |

|

图 4 对图3的3幅图像进行拼接后的结果 |

本文还对SURF方法的拼接结果进行了检测, 在155组待拼接的图像中, 使用本文中的SURF算法成功拼接了其中143组图像, 拼接成功率高达92.26%, 其结果如表2所示.

|

图 5 对图4提取其中特征点的结果 |

| 表 2 图像拼接效果统计 |

3.2 图像超像素分割实验

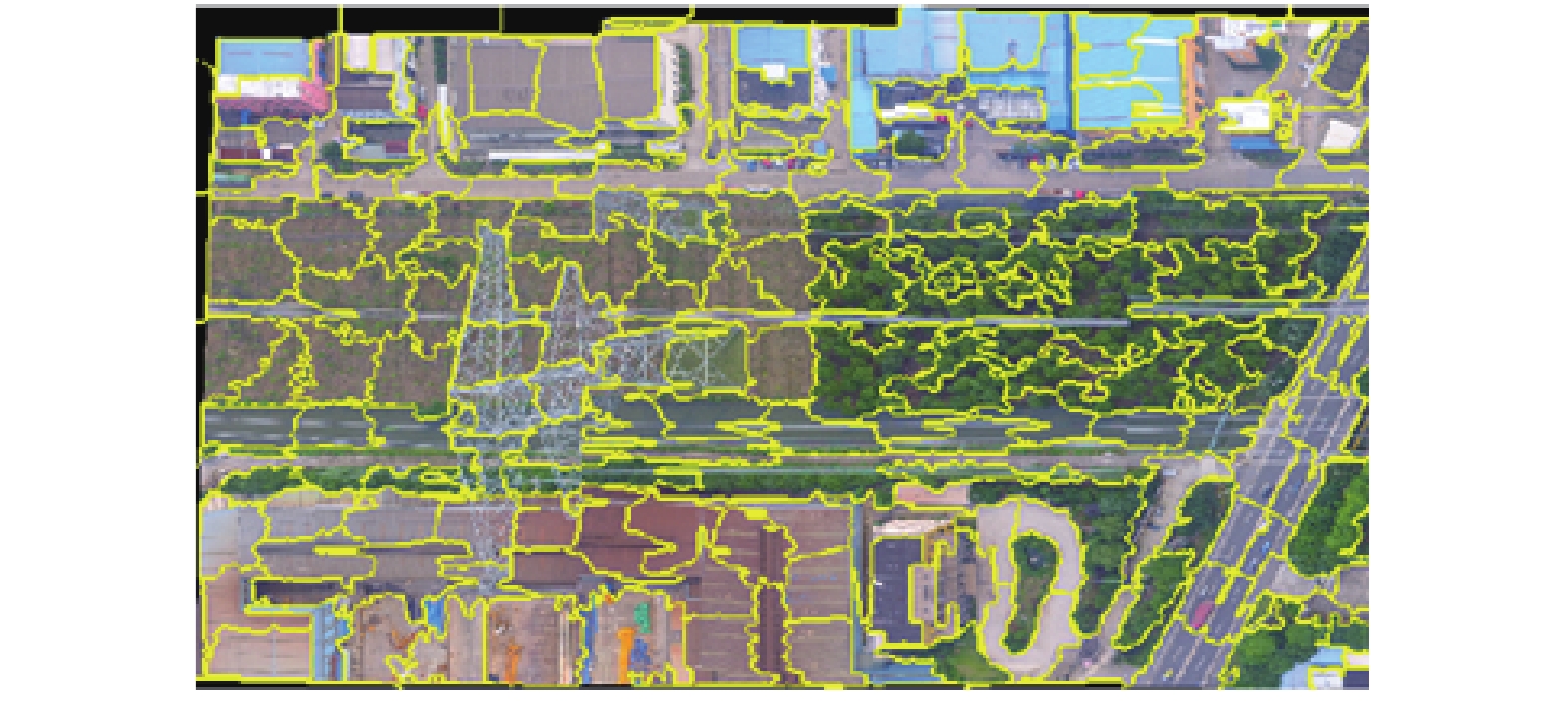

拼接得到区域的整体图像后, 为了增加检测时的图像数据, 本文使用SLIC超像素分割算法将整体图像分割为一定数量的超像素块, 从而通过这些超像素块实现各个区域的识别.

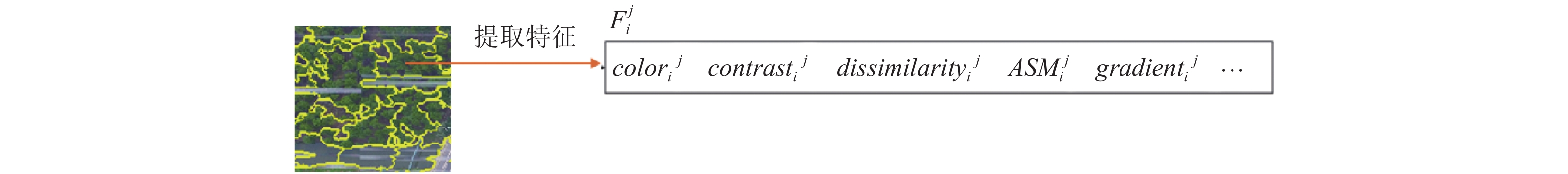

将整体图像分割为一个个超像素块后, 本文在每一个超像素块内提取其颜色, 灰度共生矩阵和梯度特征并对应每一个超像素块都生成一个包含这些特征的特征向量, 其示意图如图6所示. 本文拼接得到的整体图像进行超像素分割后的结果如图7所示, 从图中可以看到, 完整图像已经被分割为许多个具有相似局部信息的超像素块.

3.3 图像识别实验将图像分割为超像素块并提取出其特征后, 根据处理后的真值图像来进行训练得到对应的深度神经网络, 训练过程中本文使DNN对每一超像素块的输出类别尽量接近对应的真值, 通过训练可以得到能够识别绿地区域, 大棚区域和其他区域的深度神经网络模型, 本文对待检测图像进行超像素分割并将分割得到的超像素块输入训练得到的DNN模型后, 可以得到输入的超像素块的输出结果, 将输出结果可视化到图像上后, 就得到了对目标区域图像检测的识别结果, 本实验中识别结果如图8所示, 由于本次实验中的DNN只对绿地, 大棚以及其它区域进行了训练, 因此本文得到的输出结果中只识别了这三种区域类型.

本文对模型的检测结果进行了分析, 其数据如表3所示, 从表3中可以看出, 本文中使用的算法的检测成功率可达95.6%.

|

图 6 分割后的图像超像素块提取特征示意图 |

|

图 7 图像超像素分割结果 |

|

图 8 图像识别结果, 绿色代表绿地区域, 白色代表大棚区域, 灰色代表其他区域 |

| 表 3 检测数量以及成功率 |

4 结论与展望

本方法从基于无人机的高压线路通道环境巡检这一现实要求出发, 实现了一种基于超像素和深度神经网络的航拍高压输电线路环境检测的方法. 实验包括对基于SURF特征的图像拼接算法, 基于SLIC超像素分割技术, 对超像素块的特征提取以及使用DNN进行图像分类检测.

| [1] |

王万国, 田兵, 刘越, 等. 基于RCNN的无人机巡检图像电力小部件识别研究. 地球信息科学学报, 2017, 19(2): 256-263. |

| [2] |

Yu TS, Wang RS. Scene parsing using graph matching on street-view data. Computer Vision and Image Understanding, 2016, 145: 70-80. DOI:10.1016/j.cviu.2016.01.004 |

| [3] |

Lowe DG. Distinctive image features from scale-invariant keypoints. International Journal of Computer Vision, 2004, 60(2): 91-110. DOI:10.1023/B:VISI.0000029664.99615.94 |

| [4] |

Mills A, Dudek G. Image stitching with dynamic elements. Image and Vision Computing, 2009, 27(10): 1593-1602. DOI:10.1016/j.imavis.2009.03.004 |

| [5] |

Ma XM, Liu D, Zhang J, et al. A fast affine-invariant features for image stitching under large viewpoint changes. Neurocomputing, 2015, 151: 1430-1438. DOI:10.1016/j.neucom.2014.10.045 |

| [6] |

Qu Z, Bu W, Liu L. The algorithm of seamless image mosaic based on A‐KAZE features extraction and reducing the inclination of image. IEEJ Transactions on Electrical and Electronic Engineering, 2018, 13(1): 134-146. DOI:10.1002/tee.22507 |

| [7] |

Bay H, Ess A, Tuytelaars T, et al. Speeded-up robust features (SURF). Computer Vision and Image Understanding, 2008, 110(3): 346-359. DOI:10.1016/j.cviu.2007.09.014 |

| [8] |

Liu MY, Tuzel O, Ramalingam S, et al. Entropy rate superpixel segmentation. CVPR 2011. Providence, RI, USA. 2011. 2097–2104.

|

| [9] |

Li ZG, Wu XM, Chang SF. Segmentation using superpixels: A bipartite graph partitioning approach. 2012 IEEE Conference on Computer Vision and Pattern Recognition. Providence, RI, USA. 2012. 789–796.

|

| [10] |

Felzenszwalb PF, Huttenlocher DP. Effcient graph-based image segmentation. International Journal of Computer Vision, 2004, 59(2): 167-181. DOI:10.1023/B:VISI.0000022288.19776.77 |

| [11] |

Comaniciu D, Meer P. Mean shift: A robust approach toward feature space analysis. IEEE Transaction on Pattern Analysis and Machine Intelligence, 2002, 24(5): 603-619. DOI:10.1109/34.1000236 |

| [12] |

Vedaldi A, Soatto S. Quick shift and kernel methods for mode seeking. European Conference on Computer Vision. Berlin, Germany. 2008. 705–718.

|

| [13] |

Levinshtein A, Stere A, Kutulakos K N, et al. TurboPixels: Fast superpixels using geometric flows. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2009, 31(12): 2290-2297. DOI:10.1109/TPAMI.2009.96 |

| [14] |

Li ZQ, Chen JS. Superpixel segmentation using linear spectral clustering. Proceedings of the 2015 IEEE Conference on Computer Vision and Pattern Recognition. Boston, MA, USA. 2015. 1356–1363.

|

| [15] |

Achanta R, Shaji A, Smith K, et al. SLIC superpixels compared to state-of-the-art superpixel methods. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34(11): 2274-2282. DOI:10.1109/TPAMI.2012.120 |

| [16] |

Long J, Shelhamer E, Darrell T. Fully convolutional networks for semantic segmentation. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(4): 640-651. DOI:10.1109/TPAMI.2016.2572683 |

| [17] |

Ronneberger O, Fischer P, Brox T. U-net: Convolutional networks for biomedical image segmentation. International Conference on Medical Image Computing and Computer-Assisted Intervention. Cham. 2015. 234–241.

|

| [18] |

Zhang XY, Zhou XY, Lin MX, et al. Shufflenet: An extremely efficient convolutional neural network for mobile devices. Proceedings of the 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Salt Lake City, UT, USA. 2018. 6848–6856.

|

| [19] |

Zhang SF, Wen LY, Bian X, et al. Single-shot refinement neural network for object detection. Proceedings of the 2018 IEEE Conference on Computer Vision and Pattern Recognition. Salt Lake City, UT, USA. 2018. 4203–4212.

|

| [20] |

Yang TJ, Howard A, Chen B, et al. Netadapt: Platform-aware neural network adaptation for mobile applications. arXiv:1804.03230, 2018.

|

2020, Vol. 29

2020, Vol. 29