车辆识别系统作为智能交通系统(ITS)中的关键子系统. 车标识别提供车辆制造商最重要的信息, 正确识别车标将有助于车辆身份的确定. 因此对于车标快速准确的识别在如违章停车、假套牌检测、违章车辆逃逸等方面有着广泛的应用. 然而, 相比较于目前成熟的车牌识别技术, 专门对于车标识别研究的人员相对较少.

国内外已有不少学者对车标的定位与识别进行研究, 取得了不错的成果[1]. 车标检测识别一般包括两个步骤: 定位和识别. 由于车标的形状各异, 导致了车标定位是比较困难的, 因此一般比较流行的方法采用先验知识作为互补信息[2,3]. 他们首先找到一些明显的对象, 如车牌和车头灯, 根据相对位置或对称性来绘制包含车标的粗糙区域, 然后, 利用大多数标志具有丰富的垂直边缘或者与车身纯背景的可区分的颜色特征, 在该区域从粗略到精细扫描处理, 进行精准定位.

对于车标识别, 现有方法主要是基于模板匹配, 特征点以及边缘检测等. 模板匹配一种比较传统的图像分类方法, 文献[4,5]提出一种使用模板匹配和边缘方向直方图进行车标分类的方法. 然而这种方法通常需要大量的模板样本的收集, 比较耗时, 而且容易受到图像质量的影响, 导致识别结果降低, 而且在匹配的过程比较耗时, 不满足实时性. 为此文献[6]使用主成份分析法(PCA)与不变矩对车标进行识别, 这些方法相对简单, 速度较快, 但准确率较为一般. 基于特征点识别的方法[7–9], 比如SIFT, 文献[9]提出一种基于SIFT的增强匹配算法, 提高的识别精准度, 但是基于特征点的算法对于原始图像要有比较高的分辨率, 对于低分辨率的图像识别效果比较差. 许多车标识别方法基于边缘的特征来对图像进行分类, 如形状描述符. 然而难以从低分辨率图像准确地提取边缘. 随着深度学习的发展, 为提取低分辨图像特征提供了一种新的方法[10–12]. 文献[13]提出了一种基于卷积神经网络模型的方法, 达到了精准识别的要求, 但是训练时间过长, 不满足实时性的要求.

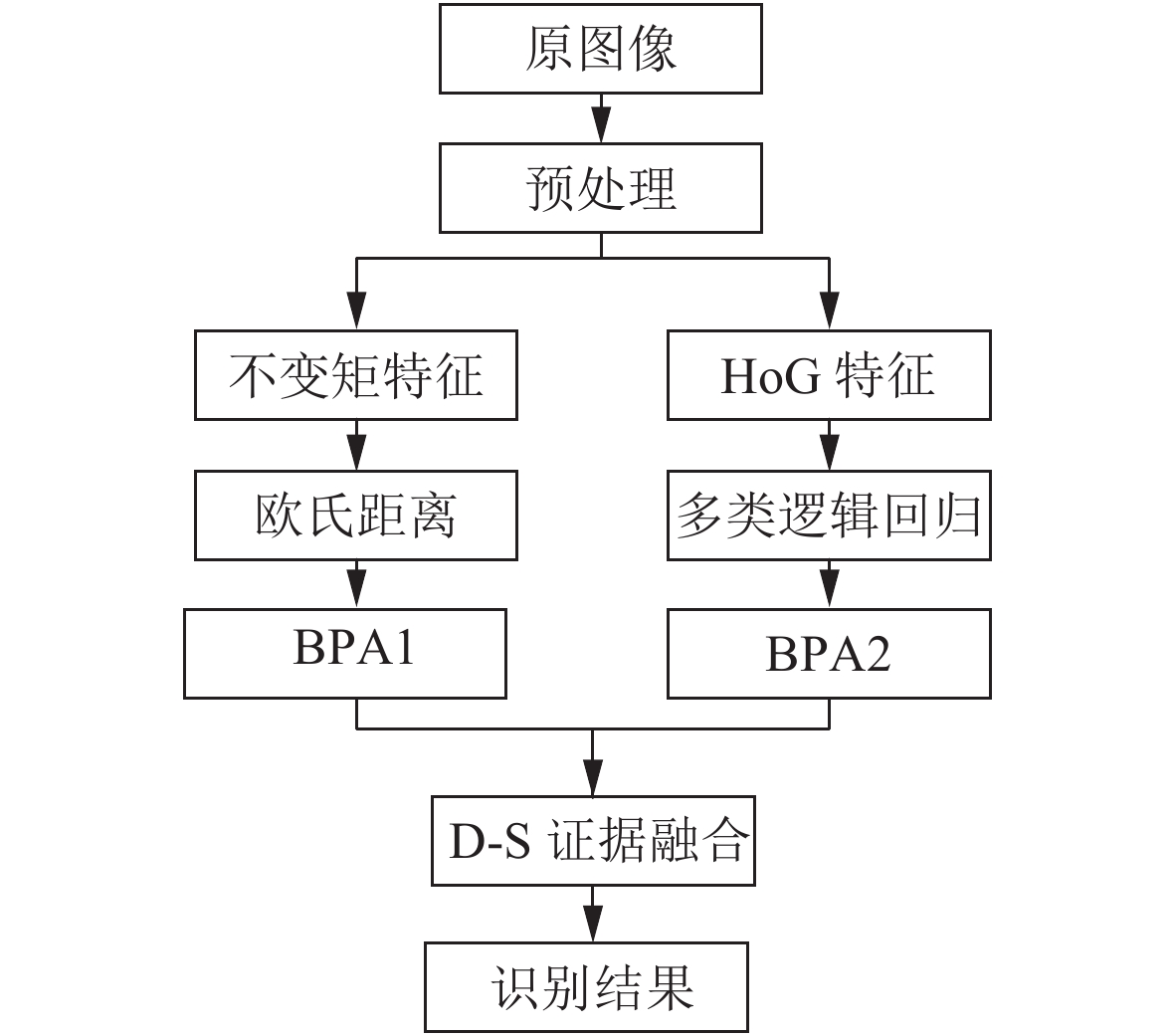

总之, 单一方法几乎不能很好的处理低分辨率图像, 然而在实际应用中, 车辆图像有悬挂在街道交叉口处的相机进行捕获, 具有1024×768的分辨率, 因此对于前视图中车标具有相对较小的尺寸和分辨率. 为了解决这一问题, 本文提出一种基于D-S证据理论的多特征融合方法, 结合不变矩所具有的旋转、缩放和平移的不变性以及HOG特征, 利用D-S证据理论组合不完全、不清晰信息的优势, 根据决策规则得到最终的识别, 有效提高对于低质图像的识别准确度, 相比于单一特征识别更具有鲁棒性.

1 相关工作 1.1 图像预处理帧为了提高识别率, 将采集到得图像进行预处理. 首先对于图像进行几何归一化为70×70, 为了提高图像对光照的鲁棒性, 对图像进行光照预处理, 步骤如下:

Step 1. 对图像进行γ校正, 来抑制高亮和增强高暗像素点:

| ${{I}}\left( {x,y} \right) = I{\left( {x,y} \right)^\gamma }$ | (1) |

Step 2. 对图像进行差分高斯滤波(DoG), 用来消除图像阴影以及一些高频和低频噪音的干扰. 参数根据Tan[9]等实验参数进行设置A1, A2为1.0,

| $\left\{ \begin{array}{l} {{I}}\left( {x,y} \right) = I\left( {x,y} \right)G\left( {x,y} \right)\\ {{G}}\left( {x,y} \right) = {A_1}{e^{ - \frac{{{{\left( {x,y} \right)}^2}}}{{2\sigma _1^2}}}} - {A_2}{e^{ - \frac{{{{\left( {x,y} \right)}^2}}}{{2\sigma _2^2}}}} \end{array}\right. $ | (2) |

Step 3. 对图像进行对比度均衡化, 使得图像的局部特征更加突显.

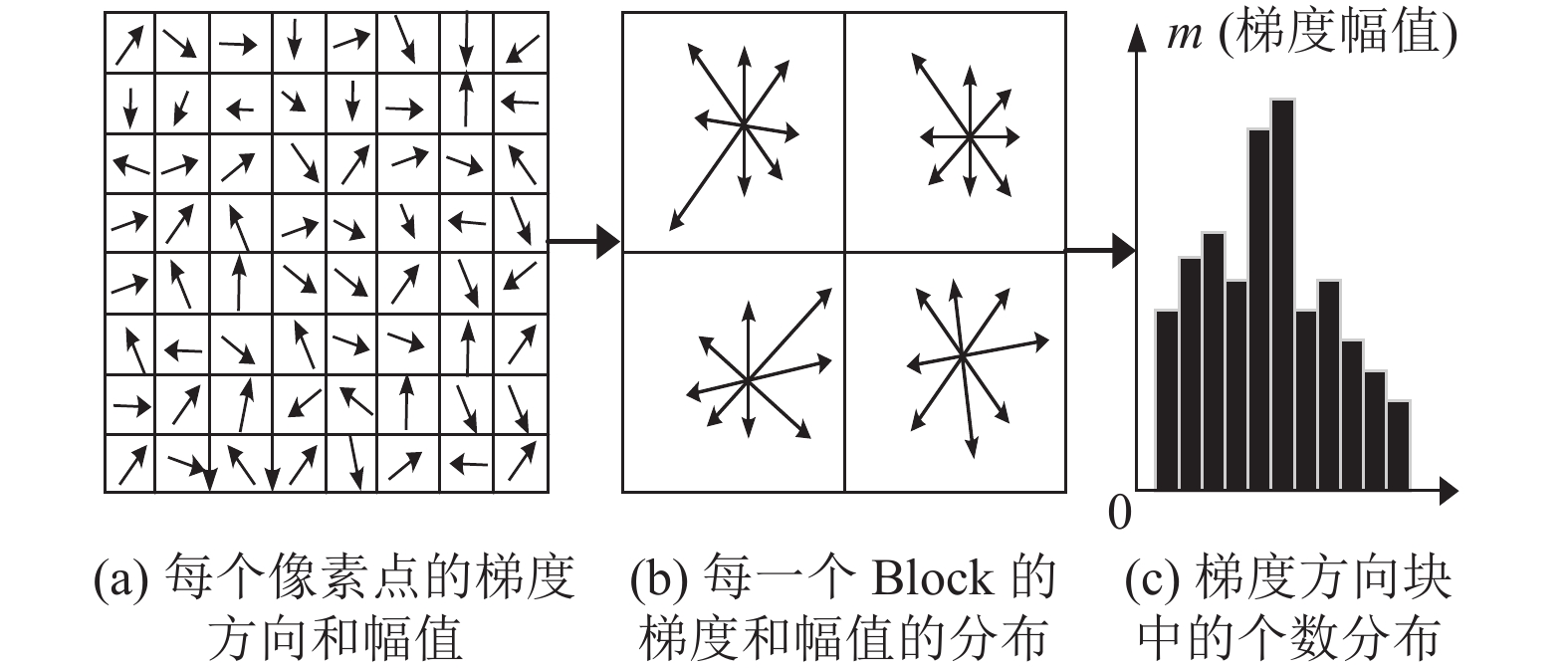

1.2 HOG特征提取HOG特征是由SIFT特征演变而来[14], 主要是通过计算局部区域的梯度方向直方图作为特征.

Step 1. 首先将已预处理后的图像分割为若干个7×7的像素单元block.

Step 2. 将block均匀分成4个小块(此处称为cell)计算cell内每个像素点的梯度方向和幅值. 并将梯度方向划分为m个方向, 统计单元内每个像素的梯度方向落在这m个方向块中的个数即得到该单元的方向梯度直方图. 如图1所示, 式(3), 式(4)中的

|

图 1 HOG特征提取过程图 |

Step 3. 将block内的cell梯度直方图连接成为一个直方图, 表示在该区域的HOG特征.

Step 4. 对于整幅图以7个像素的步长进行滑动检测, 串联所有区域的梯度直方图, 作为整幅图的HOG特征.

| $\theta \left( {x,y} \right) = \arctan \left( {\frac{{I\left( {x,y + 1} \right) - I(x,y - 1))}}{{(I(x + 1,y) - I(x - 1,y)}}} \right) $ | (3) |

| $ {{m}}\left( {x,y} \right) \!= \!\sqrt {{{\left( {I(x\! +\! 1,y)\! -\! I\left( {x \!-\! 1,y} \right)} \right)}^2} \!+\! {{\left( {I\left( {x,y\! +\! 1} \right)\! -\! I\left( {x,y \!- \!1} \right)} \right)}^2}} $ | (4) |

不变矩特征[15]常被用作图像特征的描述参数. 通过提取具有平移、旋转和比例不变性的图像特征, 基于区域的几个矩作为形状特征, 进行图像识别.

一副数字图像

相应的中心距定义为:

| ${\mu _{{{pq}}}} = {\sum\limits_x {\sum\limits_y {\left( {x - \bar x} \right)} } ^p}{\left( {y - \bar y} \right)^q}f(x,y)$ | (5) |

其中,

归一化

| ${\eta _{pq}} = {{{\mu _{pq}}} / {\mu _{oo}^r}}$ | (6) |

其中,

基于区域的不变矩理论构造出7个平移、旋转、缩放和尺度不变矩(简称Hu矩)[15], 以下为7个不变矩的计算公式:

| $\left\{ \begin{array}{l} {\phi _1} = {\eta _{20}}{\rm{ - }}{\eta _{02}}\\ {\phi _2} = {\left( {{\eta _{20}}{\rm{ - }}{\eta _{02}}} \right)^2} + 4\eta _{11}^2\\ {\phi _3} = {\left( {{\eta _{30}}{\rm{ - 3}}{\eta _{12}}} \right)^2} + {\left( {3{\eta _{11}} + {\eta _{03}}} \right)^2}\\ {\phi _4} = {\left( {{\eta _{30}} + {\eta _{12}}} \right)^2} + {\left( {{\eta _{21}} + {\eta _{03}}} \right)^2}\\ {\phi _5} = \left( {{\eta _{30}}{\rm{ - 3}}{\eta _{12}}} \right)\left( {{\eta _{30}} + 3{\eta _{12}}} \right)\left[ {{{\left( {{\eta _{30}} + {\eta _{12}}} \right)}^2}{\rm{ - 3}}{{\left( {{\eta _{21}} + {\eta _{03}}} \right)}^2}} \right]\\ \;\;\;\;\;\;\;\; + \left( {3{\eta _{21}} + {\eta _{03}}} \right)\left( {{\eta _{21}} + {\eta _{03}}} \right)\left[ {3{{\left( {{\eta _{30}} + {\eta _{12}}} \right)}^2}{\rm{ - }}{{\left( {{\eta _{21}}{\rm{ - }}{\eta _{03}}} \right)}^2}} \right]\\ {\phi _6} = \left( {{\eta _{20}}{\rm{ - }}{\eta _{02}}} \right)\left[ {{{\left( {{\eta _{30}} + {\eta _{12}}} \right)}^2}{\rm{ - }}{{\left( {{\eta _{21}} + {\eta _{03}}} \right)}^2}} \right]\\ \;\;\;\;\;\;\;\;\;\; + 4{\eta _{11}}\left( {{\eta _{30}} + {\eta _{12}}} \right)\left( {{\eta _{03}} + {\eta _{21}}} \right)\\ {\phi _7} = \left( {3{\eta _{12}}{\rm{ - }}{\eta _{30}}} \right)\left( {{\eta _{30}} + {\eta _{12}}} \right)\left[ {{{\left( {{\eta _{30}} + {\eta _{12}}} \right)}^2}{\rm{ - }}3{{\left( {{\eta _{21}} + {\eta _{03}}} \right)}^2}} \right]\\ \;\;\;\;\;\;\;\; + \left( {3{\eta _{21}}{\rm{ - }}{\eta _{03}}} \right)\left( {{\eta _{21}} + {\eta _{03}}} \right)\left[ {{{\left( {{\eta _{03}} + {\eta _{12}}} \right)}^2}{\rm{ - }}3{{\left( {{\eta _{12}} + {\eta _{03}}} \right)}^2}} \right] \end{array}\right. $ | (7) |

D-S证据理论[16]由Dempster提出并Shafer完善的, 原理如下:

设

D-S合成规则为: 设

| $ \left\{ \begin{array}{l} m(C) = 0\;\;\;\;\;\;C = \phi \\ m\left( {{C}} \right) = \frac{{\displaystyle\sum\limits_{{B_i} \cap {A_i} = {\rm{C}}} {\mathop \prod \limits_{j = 1}^n {m_j}({A_i})} }}{{\rm{N}}}\\ N = 1 - \displaystyle\sum\limits_{{B_i} \cap {A_i} = C} {\mathop \prod \limits_{j = 1}^n {m_j}({A_i})} \end{array} \right. $ | (8) |

其中, N表示证据间的冲突度. 式(8)为证据理论融合公式, 能够将若干个不同的来源的独立证据结合起来, 获得更加准确的数据.

2 特征融合本文结合不变矩所具有的旋转、缩放和平移的不变性以及HOG特征, 利用D-S证据理论组合不完全、不清晰信息的优势, 根据决策规则得到最终的识别类型. 本文提出的车标识别模型如图2所示, 算法步骤如下:

|

图 2 车标特征识别示意图 |

2.1 基本概率分配的构建 2.1.1 不变矩的基本概率分配

由于欧式距离能够有效反映出不同图像之间的相似度, 距离越大, 则相似性就越小, 针对不变矩所获得的图像特征值, 构建基本概率分配的具体步骤如下:

假设

从

| $ {d_i} = \frac{{{d_j}}}{{\displaystyle\sum\limits_{j = 1}^{n_i} {{d_j}} }} $ | (9) |

其中,

根据式(10)构造满足D-S证据理论的不变矩基本概率分配

| $ m({{{A}}_{{i}}}) = \left\{ {\begin{array}{*{20}{c}} {\frac{{p(i)}}{{\displaystyle\sum\limits_{{{i}} = 1}^{{n_{{i}}}} {p(i)} }} = \frac{{1/d_i^\alpha }}{{\displaystyle\sum\limits_{i = 1}^{n_i} {1/d_i^\alpha } }}},&{{d_i} \ne 0}\\ 1,&{{d_i} = 0} \end{array}} \right. $ | (10) |

为了构造HOG的基本概率分配, 采用Chen等人[11]提出将二分类逻辑回归扩展为多分类. 从训练数据X中获得K类

| $ {{p}}({y_i} = {{K}}|{x_i},W,b){\rm{ = }}\frac{{{e^{(W_K^{\rm{T}}{x_i} + {b_j})}}}}{{\displaystyle\sum\nolimits_{j = 1}^K {{e^{(W_j^{\rm{T}}{x_i} + {b_j})}}} }} $ | (11) |

其中,

由于车标形状各异, 保证多分类逻辑回归具有最佳的性能, 减少LR分类器训练时发生过拟合的情况, 因此本文在定义损失函数

| $ \begin{split} {{L}}(w) =& \displaystyle\sum\limits_{i = 1}^N {\displaystyle\sum\limits_{k = 1}^k {1\left\{ {{y_i} = k} \right\}} } \left\{ { - \log \left( {\frac{{{e^{(w_k^{\rm{T}}{x_i} + {b_k})}}}}{{\displaystyle\sum\nolimits_{j = 1}^k {{e^{(w_k^{\rm{T}}{x_i} + {b_k})}}} }}} \right) } \right.\\ &\left. + {\dfrac{\lambda }{{2N}}\left( {\displaystyle\sum\limits_{{w}} {{w^2}} } \right)} \right\} \end{split} $ | (12) |

其中,

因此对于一个测试样本X*, HOG的基本概率分配函数可定义为:

| $ {{m(}}{{{B}}_{{j}}}{{)}} = p\left( {y * = k|x * ,{{W,b}}} \right) = \frac{{{e^{\left( {W_k^{\rm{T}}x* + {b_k}} \right)}}}}{{\displaystyle\sum\nolimits_{{{i}} = 1}^K {{e^{\left( {W_k^{\rm{T}}x* + {b_k}} \right)}}} }} $ | (13) |

根据上述两个证据在同一个识别框架下的基本概率分布(BPA)分别为

| $ {{m}}\left( C \right) = \frac{{K\displaystyle\sum\limits_{{A_i} \cap {B_j} = C} {m({A_i})} m({B_j})}}{{1 + 1{{ - k}}\lg (1/k)}}\ $ | (14) |

通过式(14)求得融合后的信任度

(1)

(2) 目标类别

(3) 目标类别

(4) 若不满足上述3条, 则识别结果为“不确定”.

3 实验结果分析本文的车标图片来自于交通卡口监控视频拍摄的车辆图片, 共有12种车标图片合计6000张, 其中训练集数据每一类400张车标图像, 测试集每一类车标为100张. 本实验在Intel i5, 2.5 GHz CPU, 4 GB内存的Windows平台下进行. 车标图像归一化为70×70像素, 如图3所示为经过车标定位获得, 分别为Buick、Chery、Citroen、Honda、Hyundai、lexus、Mazda、Peugeot、Toyata、Volkswagen、Chevrolet、Benz.

|

图 3 车标样本 |

为了验证本文所提出方法, 提取车标的HU不变矩特征和HOG特征, 分别比较单一特征分类的识别结果和本文所提出的融合方法识别结果. 根据式(7)对每一个训练样本进行计算, 取平均值从而获得对应每一类车标特定的7个特征值. 根据欧式距离公式求得车标测试样本的分类结果,如表1所示.

对于所提取的HOG特征, 采用多分类逻辑回归作为作为分类器, 实验结果如表2所示.

根据上述实验结果可知单一特征识别率偏低, 主要由于车标样本的分辨率以及光照变化的影响比较大, 导致单一特征的识别信度值偏度, 缺乏可靠性和稳定性. 因此本文提出一种基于D-S证据理论, 融合不变矩特征和HOG特征, 融合后的信度值相比于单特征的信度值, 能够增加实际目标的信任度, 降低目标识别的不确定性. 对1200张测试样本进行混合分成5组, 实验结果如表3所示.

| 表 1 Hu不变矩分类结果 |

| 表 2 HOG分类结果 |

| 表 3 不同算法的识别结果 |

为了更好验证融合特征的优越性, 本文将与文献[17]提出的一种基于LBP与HOG联合特征的车标识别方法进行比较, 在同等条件下, 本文提出基于D-S证据理论, 进行特征融合, 相比于文献[17]所提算法在光照变化和噪声污染等情况下, 都保持着较高的车标识别率, 具有一定的鲁棒性, 但在算法识别的时间上, 本文提出的算法相对更短, 更加满足实时性的要求, 识别结果如表4所示.

4 实验结论传统的单一特征识别的算法虽然取得不错的识别结果, 但是对车标图像的质量要求比较高, 不能很好识别出低分辨、低质的车标图像, 因此本文提出一种基于D-S证据理论, 进行特征融合的方法, 对于每一类车标提取的特征进行融合, 以信度值得大小作为最终的判别依据, 能够有效解决对于低分辨图像提取特征不足导致识别率较低的问题.

| 表 4 本文算法与文献算法分析比较 |

| [1] |

张力, 张洞明, 郑宏. 基于联合层特征的卷积神经网络在车标识别中的应用. 计算机应用, 2016, 36(2): 444-448. DOI:10.3969/j.issn.1001-3695.2016.02.029 |

| [2] |

Sam KT, Tian XL. Vehicle logo recognition using modest AdaBoost and radial tchebichef moments. Proceedings of the 2012 4th International Conference on Machine Learning and Computing. Singapore. 2012. 91–95.

|

| [3] |

李侠, 李文举, 孙娟红, 等. 基于模板匹配和边缘检测的车标定位方法. 计算机工程与设计, 2011, 32(10): 3453-3456. |

| [4] |

李侠. 车标定位技术研究[硕士学位论文]. 大连: 辽宁师范大学, 2011.

|

| [5] |

罗彬, 游志胜, 曹刚. 基于边缘直方图的快速汽车标志识别方法. 计算机应用研究, 2004, 21(6): 150-151, 157. DOI:10.3969/j.issn.1001-3695.2004.06.054 |

| [6] |

王枚, 王国宏, 高小林, 等. 基于PCA和边缘不变矩的车标识别新方法. 计算机工程与应用, 2008, 44(4): 224-226, 229. DOI:10.3778/j.issn.1002-8331.2008.04.069 |

| [7] |

耿庆田, 于繁华, 王宇婷, 等. 基于SIFT的车标识别算法. 吉林大学学报(理学版), 2018, 56(3): 639-644. |

| [8] |

杨飚, 周阳. 基于HOG和ASIFT特征的车标二次识别. 计算机仿真, 2015, 32(9): 194-198, 322. DOI:10.3969/j.issn.1006-9348.2015.09.042 |

| [9] |

Psyllos AP, Anagnostopoulos CNE, Kayafas E. Vehicle logo recognition using a SIFT-based enhanced matching scheme. IEEE Transactions on Intelligent Transportation Systems, 2010, 11(2): 322-328. DOI:10.1109/TITS.2010.2042714 |

| [10] |

Pan C, Yan ZG, Xu XM, et al. Vehicle logo recognition based on deep learning architecture in video surveillance for intelligent traffic system. Proceedings of 2014 IET International Conference on Smart and Sustainable City. Shanghai, China. 2014. 123–126.

|

| [11] |

Li H, Wang L, Qin YJ. Vehicle logo retrieval based on Hough transform and deep learning. Proceedings of 2017 IEEE International Conference on Computer Vision Workshops. Venice, Italy. 2017. 967–973.

|

| [12] |

Xia YZ, Feng J, Zhang BL. Vehicle Logo Recognition and attributes prediction by multi-task learning with CNN. Proceedings of the 201612th International Conference on Natural Computation, Fuzzy Systems and Knowledge Discovery. Changsha, China. 2016. 668–672.

|

| [13] |

Stauffer C, Grimson WEL. Learning patterns of activity using real-time tracking. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2000, 22(8): 747–757.

|

| [14] |

Dalal N, Triggs B. Histograms of oriented gradients for human detection. Proceedings of 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. San Diego, CA, USA. 2005. 886–893.

|

| [15] |

张伟, 何金国. Hu不变矩的构造与推广. 计算机应用, 2010, 30(9): 2449-2452. |

| [16] |

袁鹏慧, 张清华, 谢刚, 等. 基于K-S和加权证据理论的复合故障诊断方法. 机床与液压, 2018, 46(7): 146-151. DOI:10.3969/j.issn.1001-3881.2018.07.032 |

| [17] |

张素雯, 张永辉, 杨洁, 等. 一种基于LBP与HOG联合特征的车标识别方法. 网络新媒体技术, 2016, 5(6): 49-55. DOI:10.3969/j.issn.2095-347X.2016.06.010 |

2019, Vol. 28

2019, Vol. 28